想訓練自己專屬的 AI 語音模型嗎?這篇 GPT SoVITS v2pro 的完整使用教學,就能讓你輕鬆達成。GPT SoVITS v2pro 是一套強大又免費的開源語音克隆工具,使用者只要預先準備好你講話的音檔,接著照著軟體的步驟操作,就能輕鬆打造專屬的語音模型。不論你是想用來製作影片旁白、新聞播報,還是打造個人虛擬角色,這套軟體就能輕鬆達成。本文會全程手把手教學,讓你學會如何將你的聲音 AI 化 :

( 圖片來源 : GPT 生成)

GPT SoVITS v2pro 下載教學

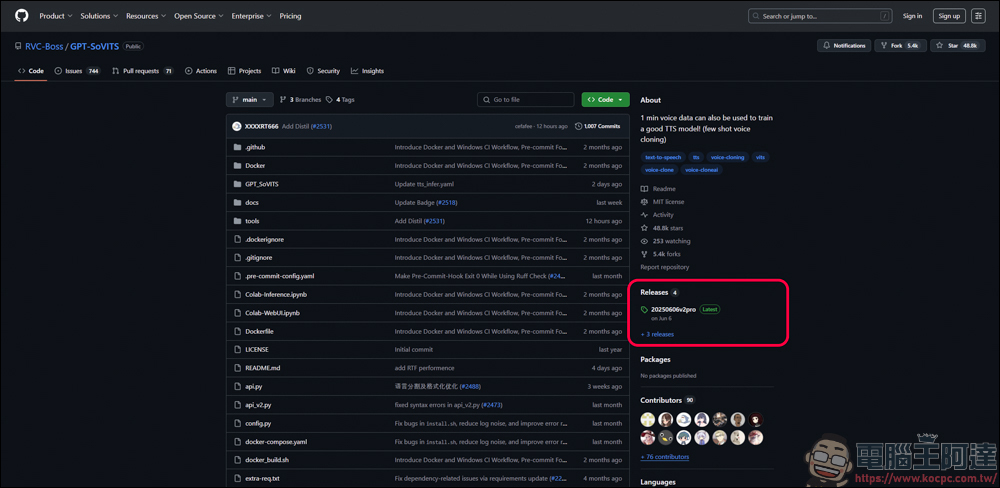

GPT SoVITS v2pro 是免費的開源模型,點進上方的網址後,找到紅圈處的地方按下進行下載 :

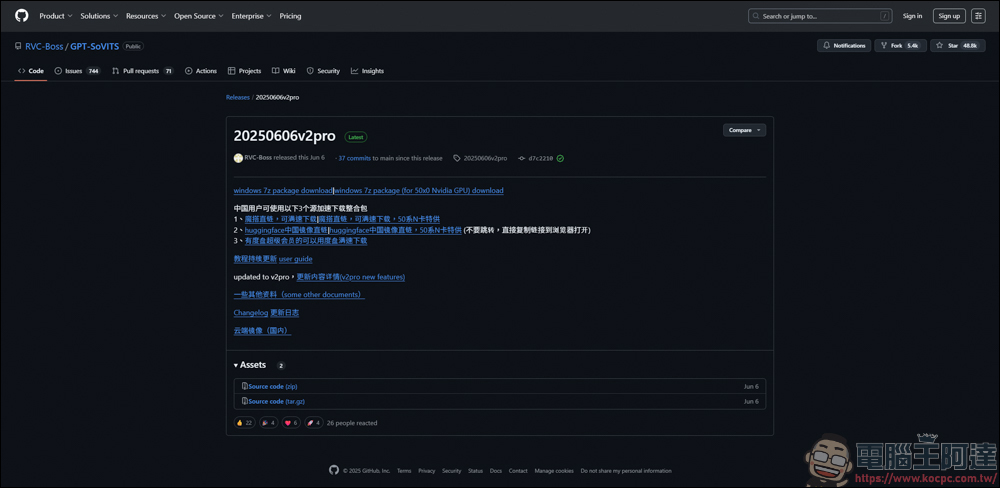

目前僅能在 Windows 上運行,如果你的 GPU 是 50 系列的版本,記得抓支援 50 系 GPU 的軟體,名稱上有寫 :

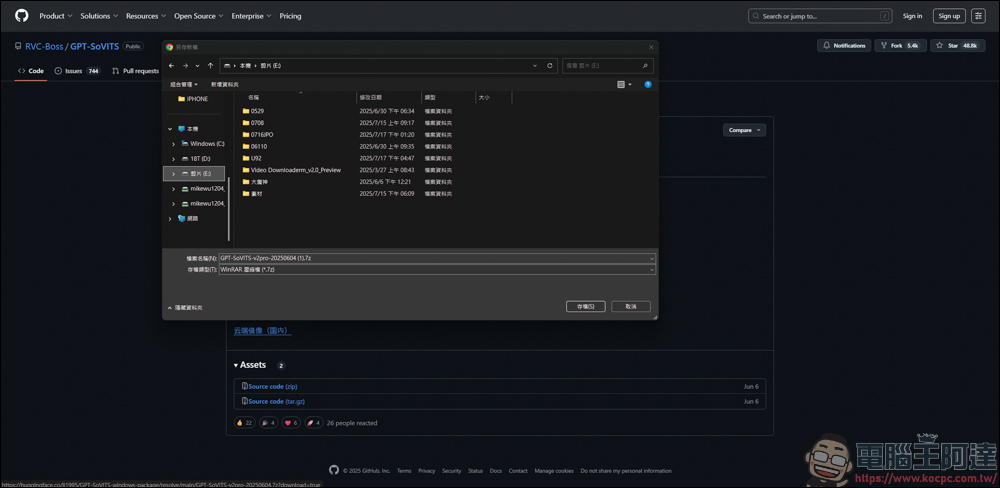

下載 :

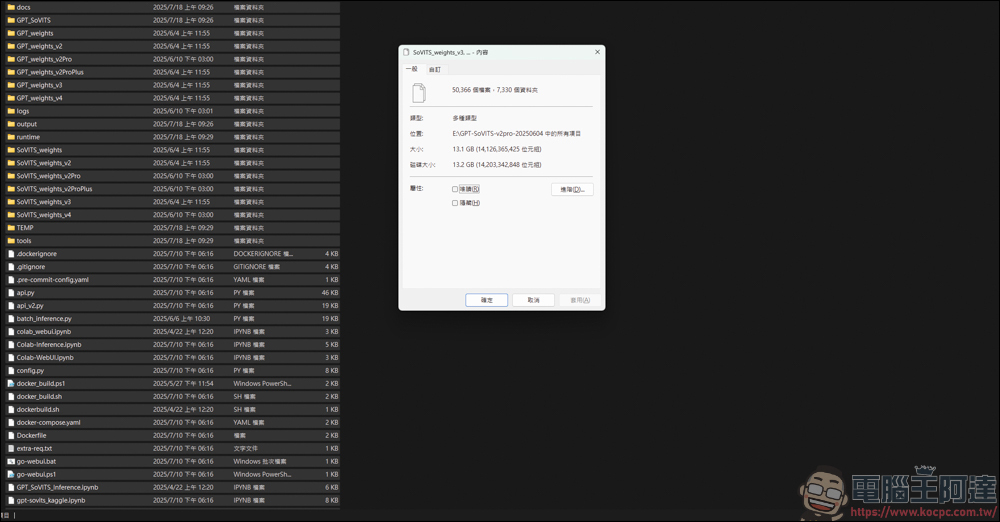

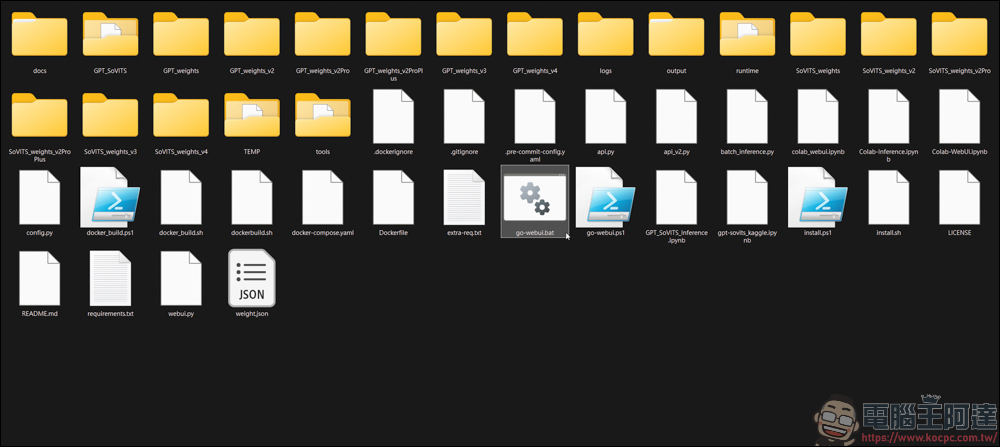

檔案滿大的,解壓縮玩有 13.1GB 左右 :

GPT SoVITS v2pro 使用教學

解壓縮完之後就要開始執行使用,雙擊 go-webui.bat 即可運行 GPT SoVITS v2pro :

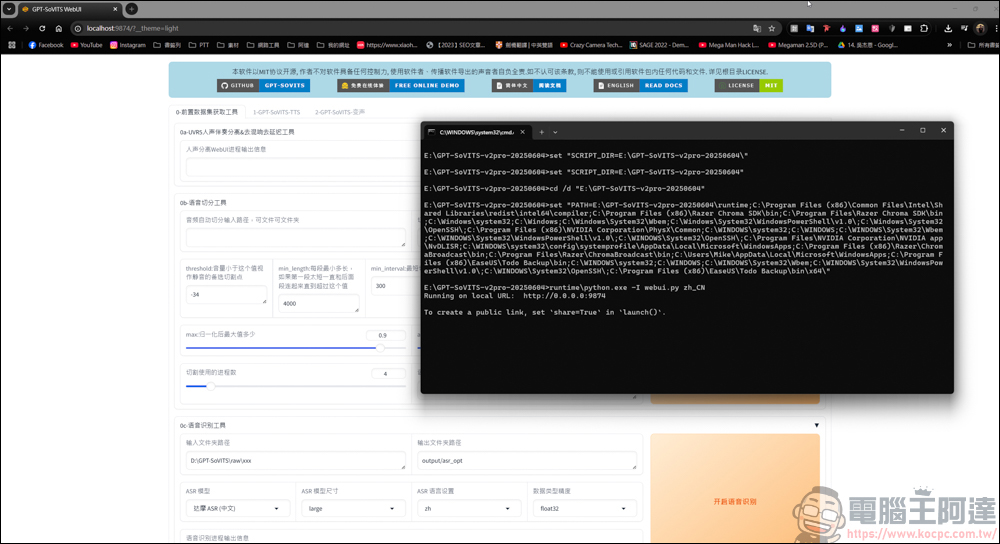

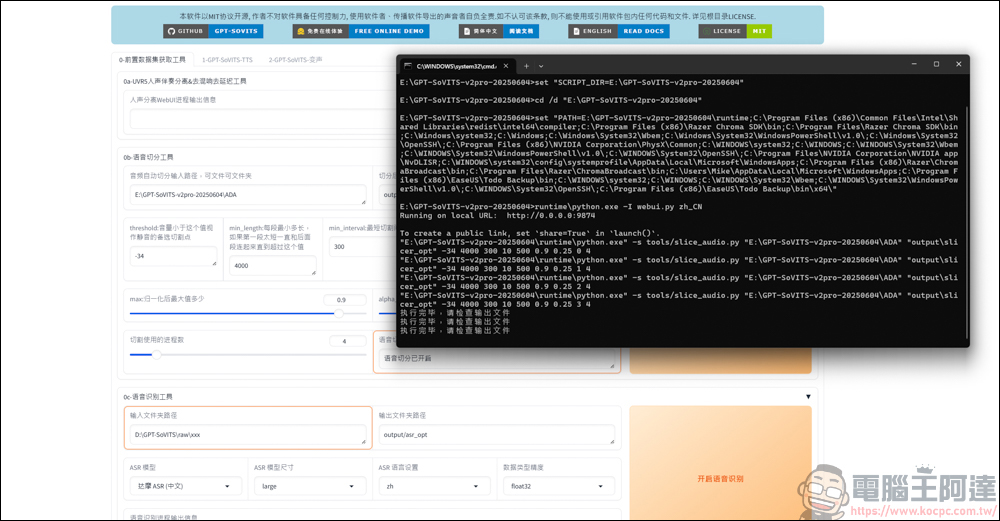

系統會先運行 DOS 視窗,接著會跳出訓練的主頁面。這邊一定要記得,DOS 視窗絕對不能關掉,關掉後訓練的主頁面是會沒有任何作用的 :

建議直接把 DOS 視窗縮到最小,以免訓練的過程去動到它 :

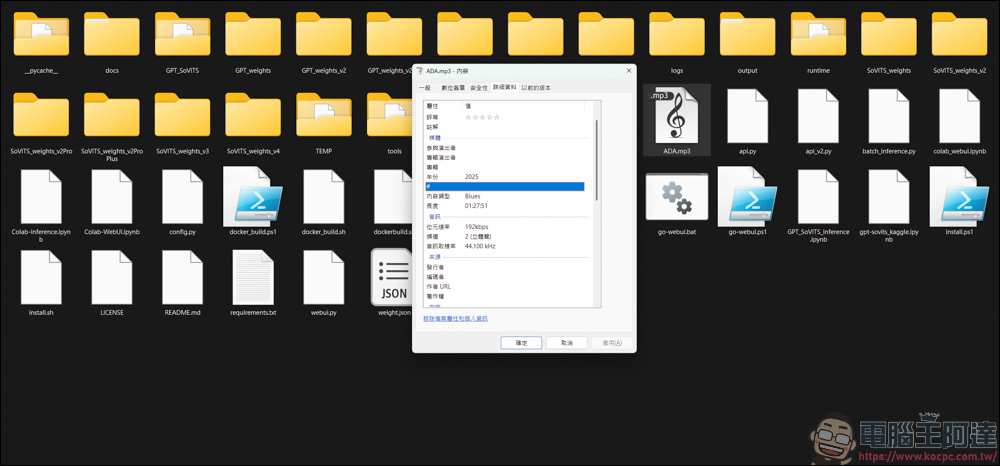

在開始訓練聲音之前,必須先將聲音素材準備好,你可以使用相機、手機進行講話的錄音,錄音的時間越長越好,這樣訓練的模型會更準確。這邊我準備了一段 1 小時 27 分鐘的純講話音檔要來訓練,建議另開一個資料夾單獨放這音檔,待會指定目錄的時候會用到 :

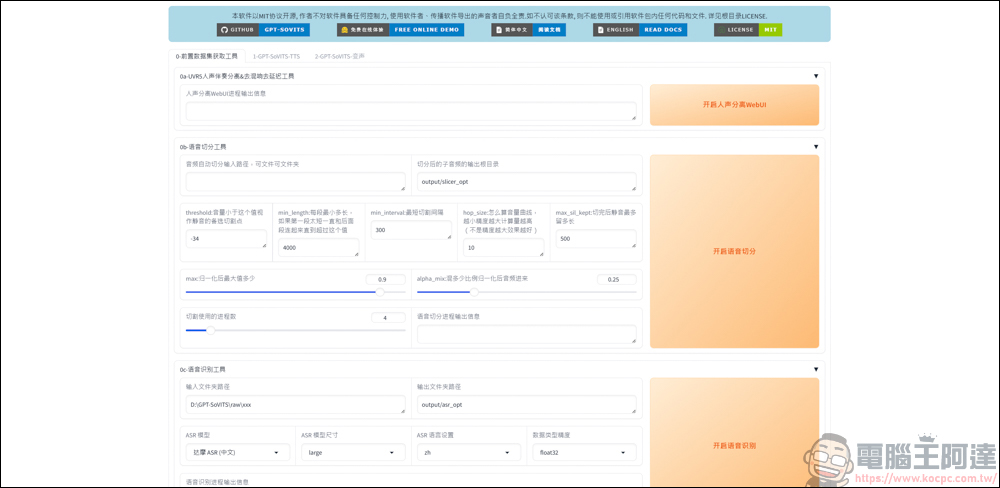

素材準備好之後,接著就要來訓練聲音了。在第一個選項有 UVR5 人聲伴奏分離&去混響去延遲工具,如果你的音檔是有背景音的,可以用這個功能去除背景音。但因為今天我準備的素材是純講話聲,所以直接跳過。

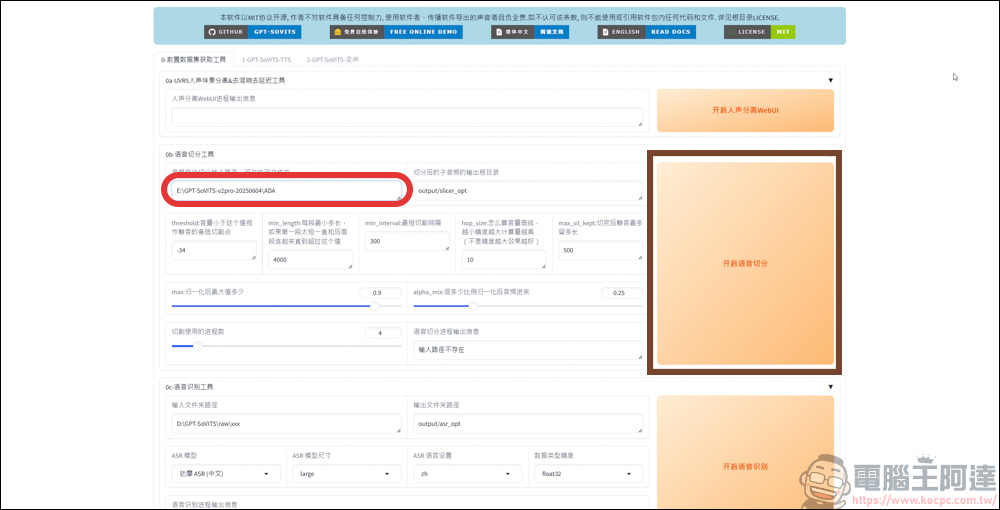

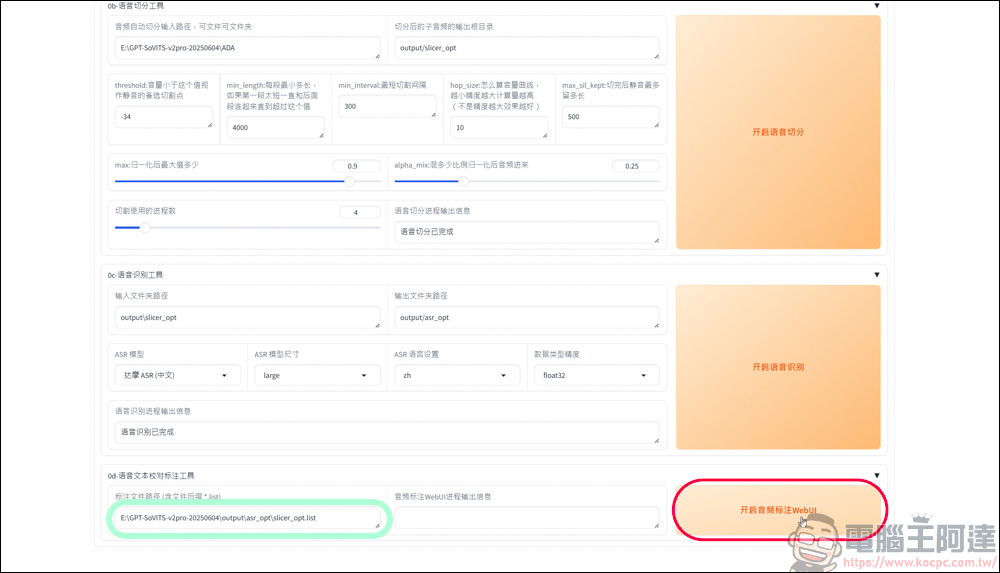

直接到語音切分工具這,在紅色框框貼上上面那段音檔所在的資料夾位置後,再按右邊的棕色框框開始切分音頻 :

執行完成後,DOS 跟主頁面就會顯示執行完畢 :

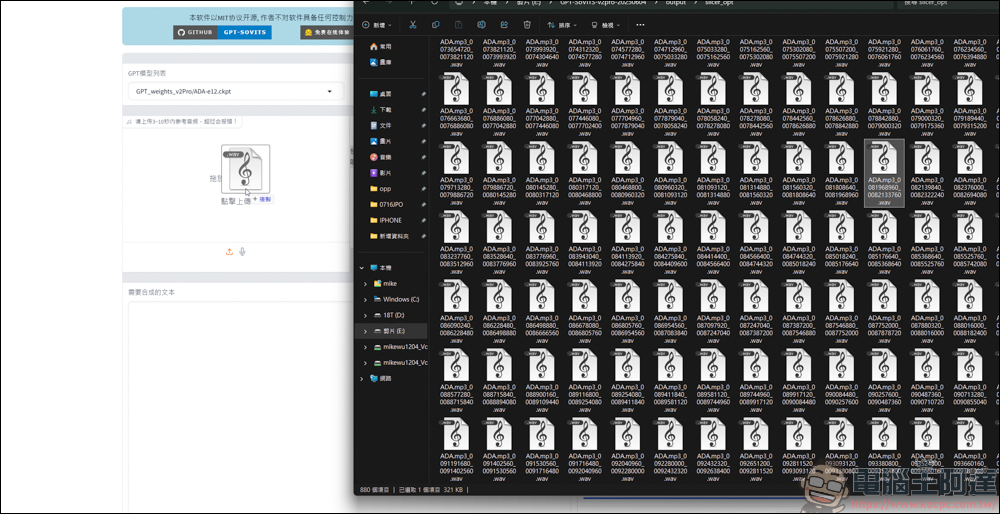

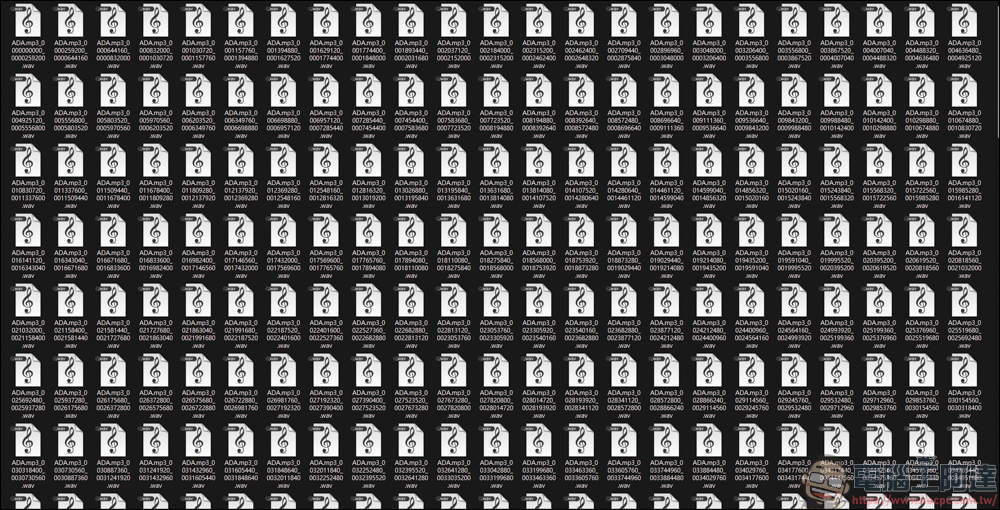

可至 \output\slicer_opt 查看剛剛切出來的音檔 :

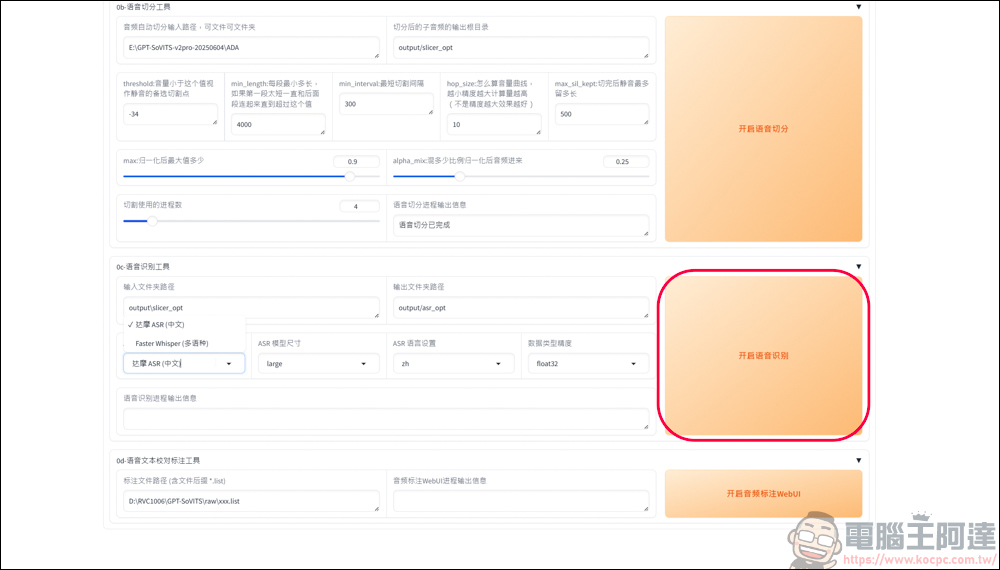

接著是語音識別功能,基本上不需要更改設定,除非你的語音是中英文參雜才需要改 Faster Whisper,這邊我先以中文為範例。選好之後,按下紅色框框的開啟語音辨識 :

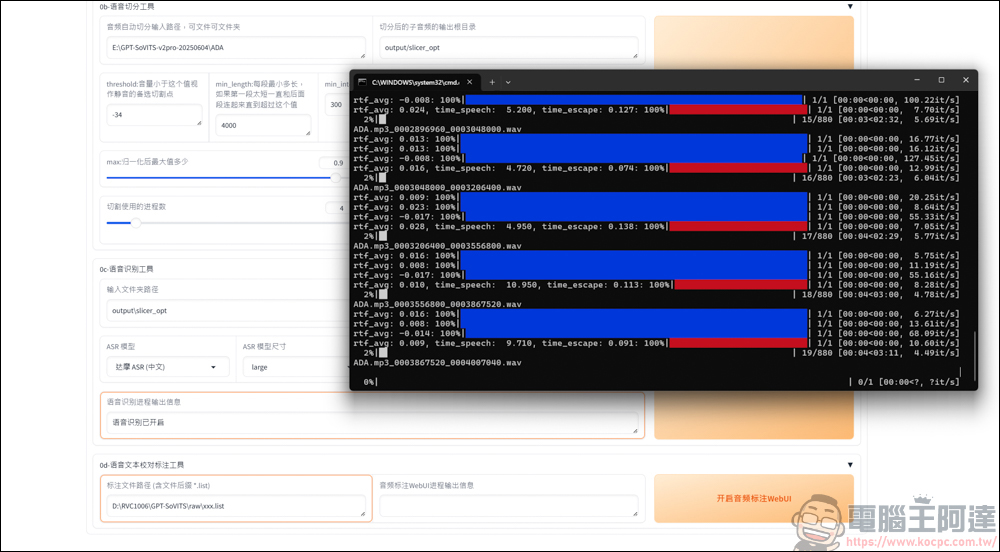

等待識別 :

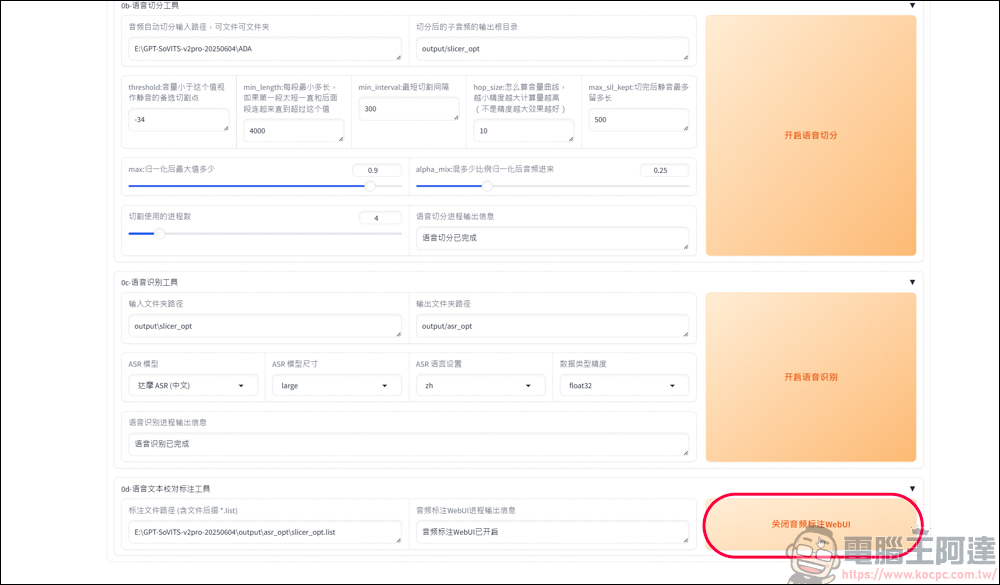

識別完之後,在下方選項的語音文本校對標註工具中,貼上你 GPT-SoVITS-v2pro\output\slicer_opt 的所在位置 ( 像我是 C:\Users\Mike\Desktop\GPT-SoVITS-v2pro\output\slicer_opt ),貼完之後按下紅色框框的開啟音頻標註 WebUI :

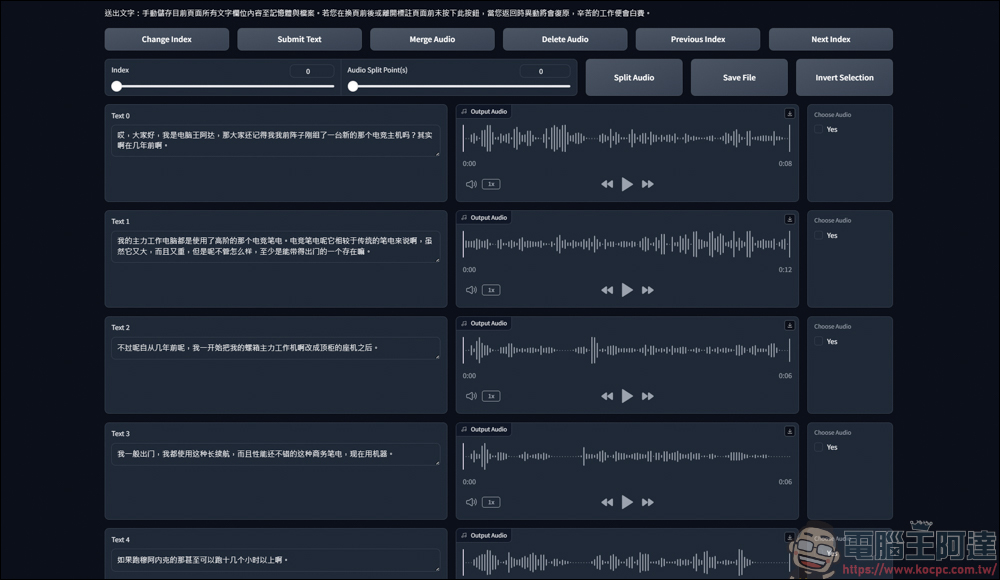

在音頻標註功能裡,會出現好幾段剛剛裁切的音頻,系統雖然已經幫你識別文字了,但使用者還是必須聽一遍確認文字的正確度,這樣才能提高 AI 的精準度 :

可以看這段示範 :

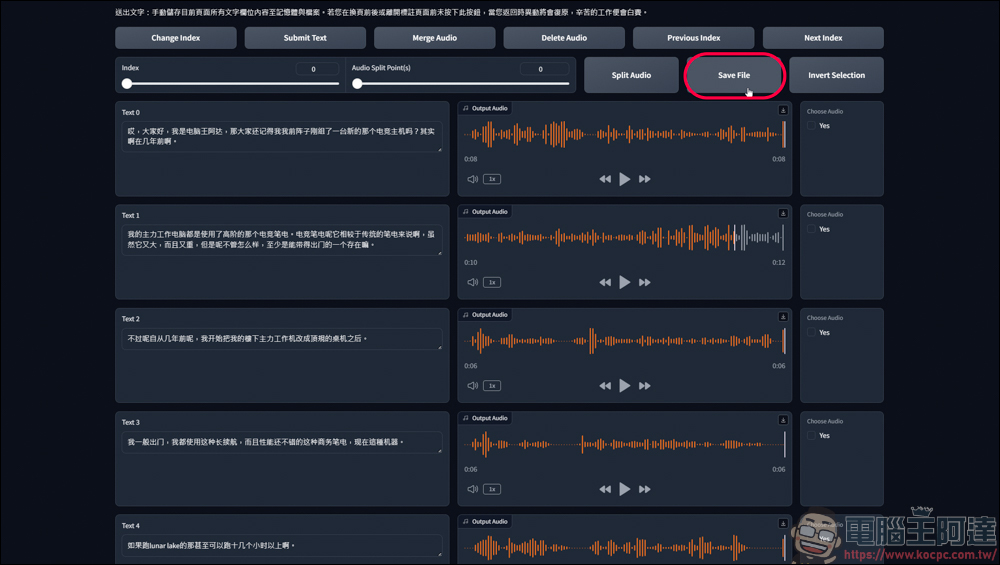

都調整好之後,按下 Save File :

回到剛剛的頁面後,按下關閉音頻標註 WebUI :

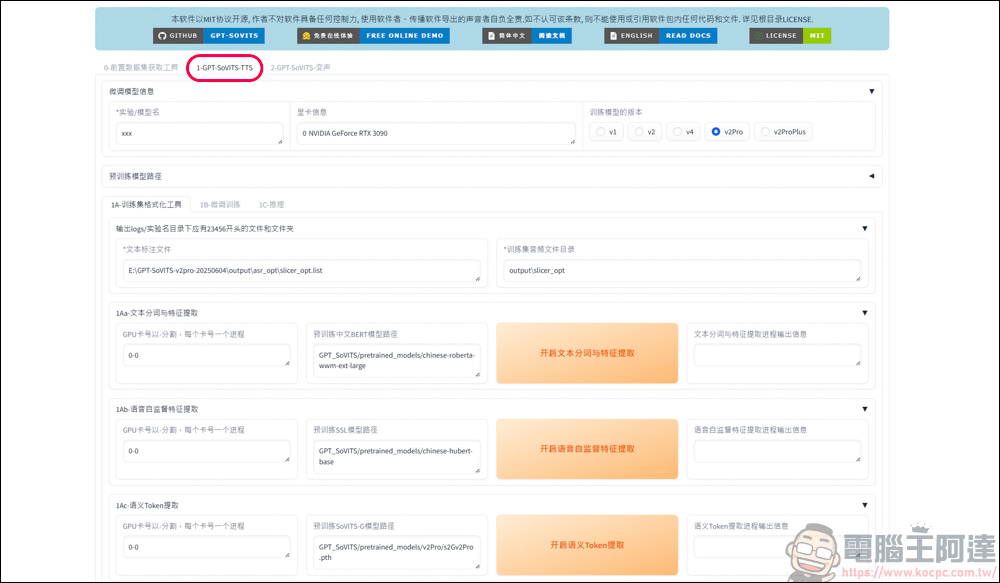

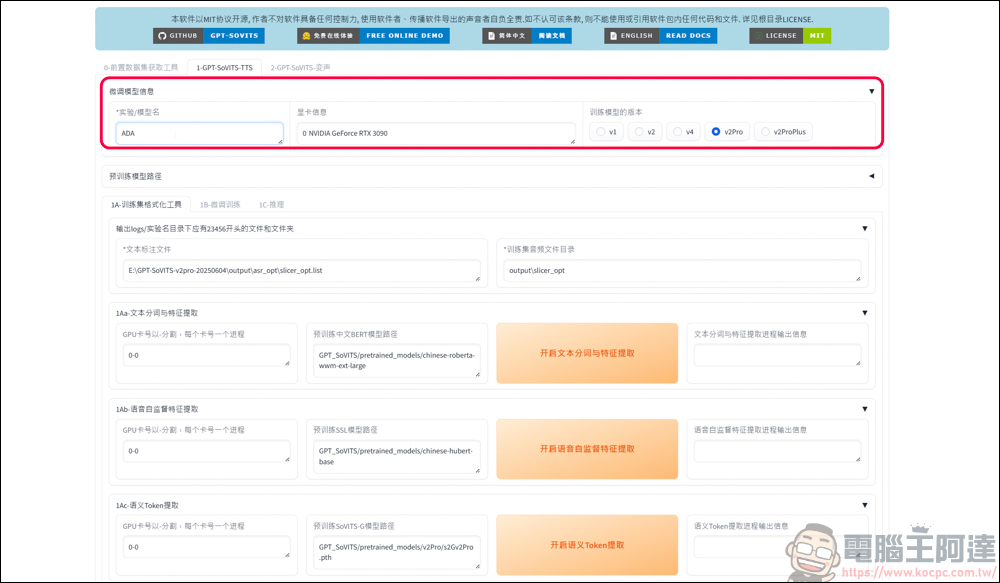

處理完之後將畫面拉到上方,點選紅框處的 GPT-SoVITS-TTS,就會跳轉到下面這個畫面 :

在框起來的紅圈處,可填入此訓練模型的名稱以及選擇使用的模型版本,這次我用 v2Pro 模型來當作範例 :

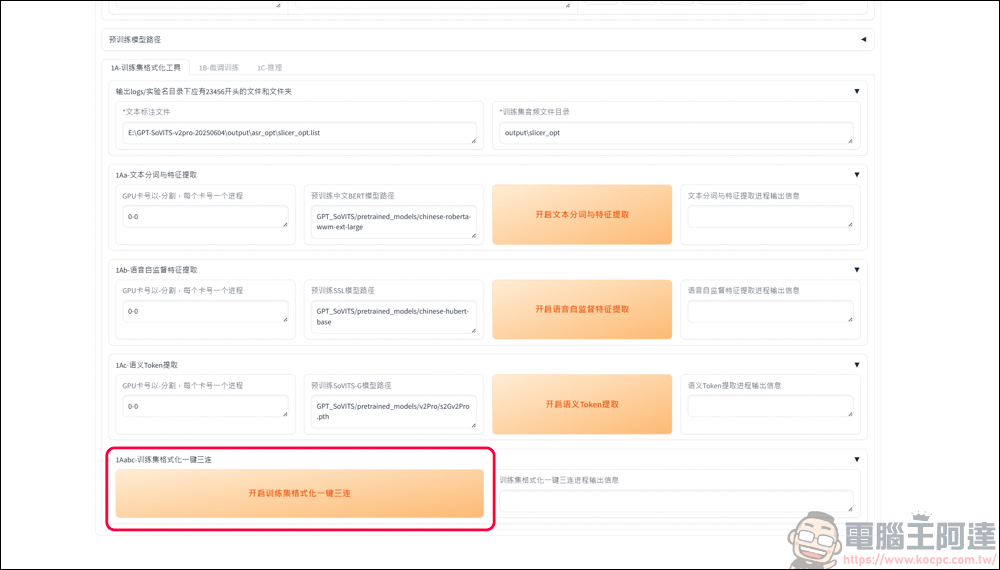

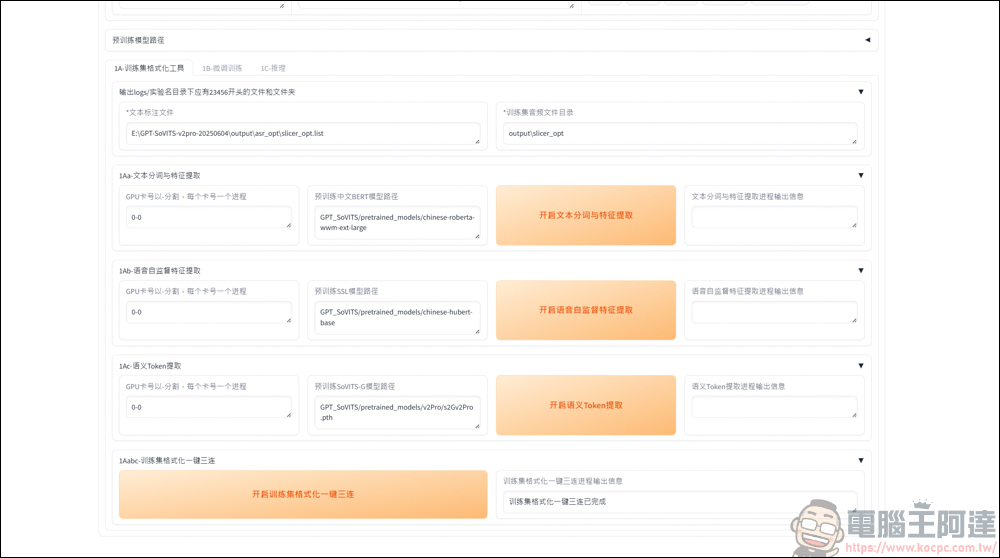

基本上前一項功能都有確實做,那上面的一些參數及模型路徑它都會幫你自動設定,不需要一個一個調整。使用者可以直接拉到頁面最下方,點擊開啟訓練及格式化一鍵三連 :

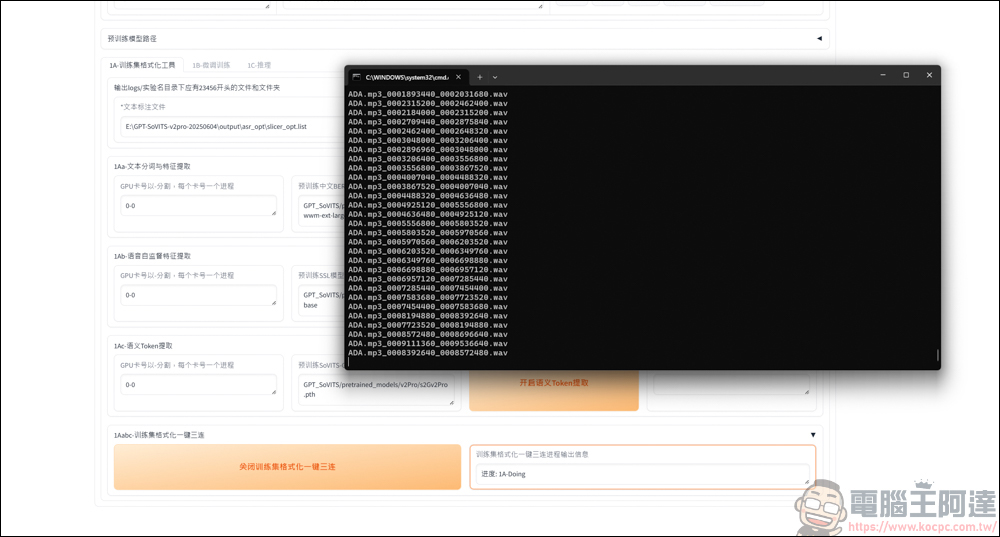

接著系統就會訓練剛剛切割的音頻 :

當下方出現已完成時,就表示完成了 :

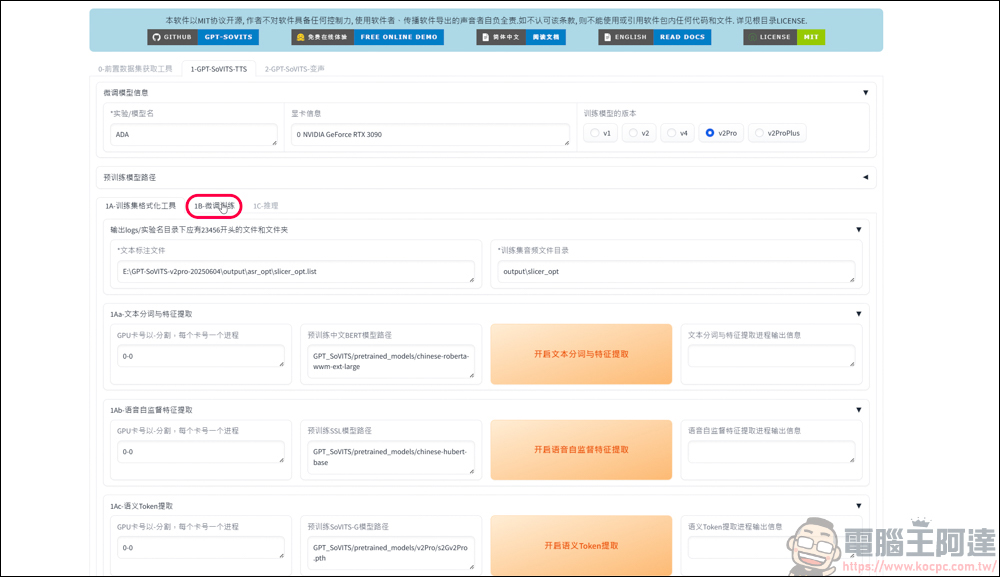

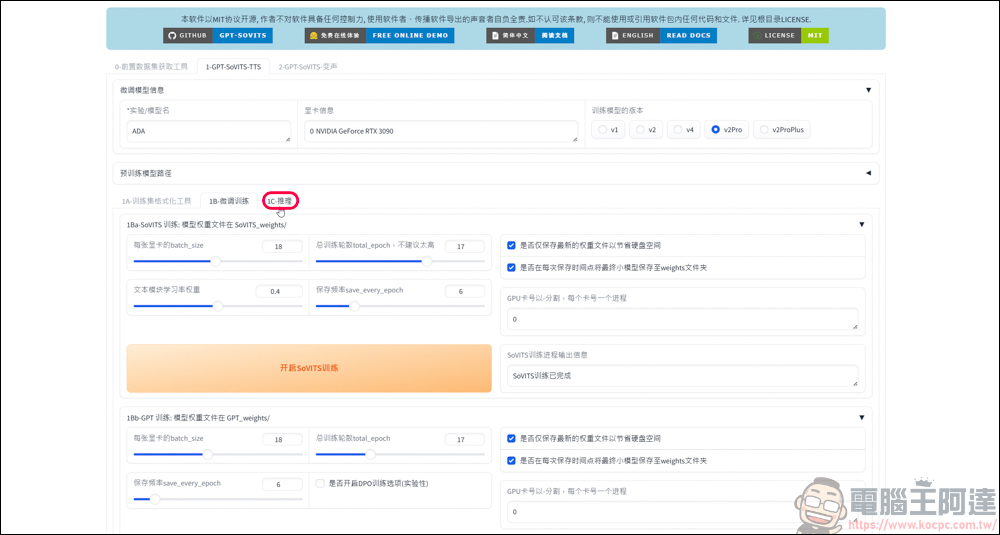

接著視窗往上拉,找到紅圈處的 1B-微調訓練 :

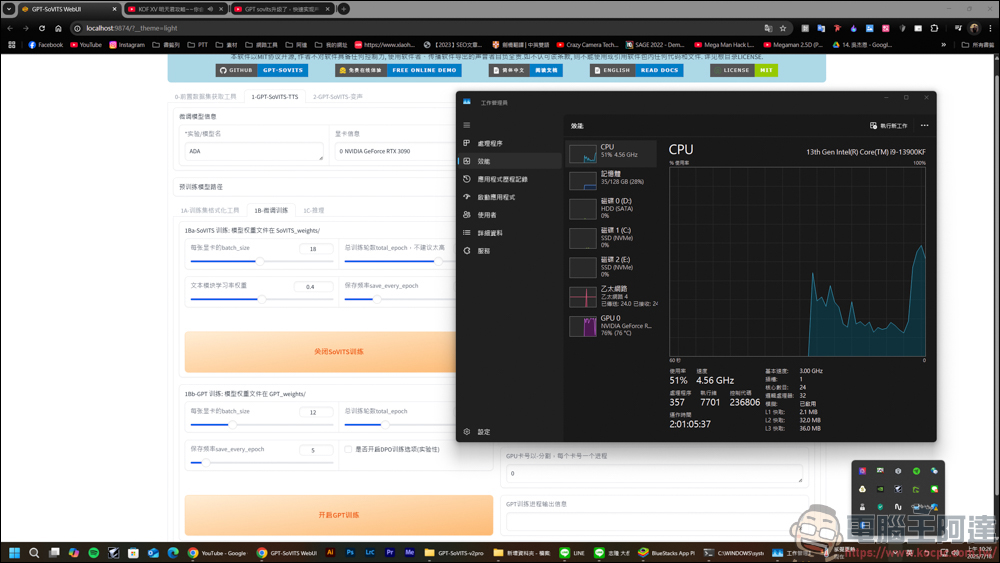

在這個頁面中,才是真正要來訓練你的語音轉換以及克隆,這頁的設定都非常吃顯卡效能,如果你的顯卡算力不高,不建議參閱我以下的數值設定。

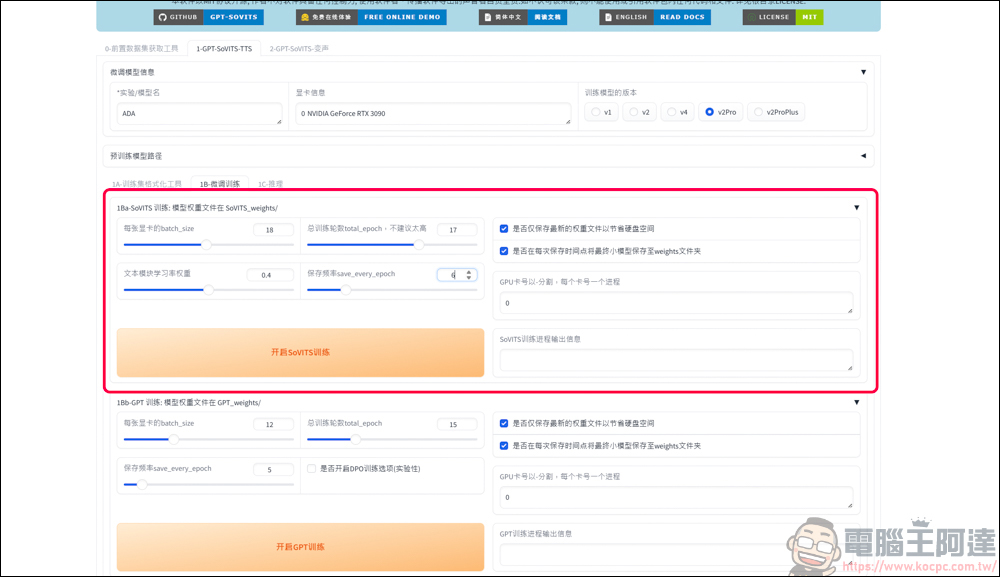

首先我們先進行 So-VITS 的訓練,目前我的電腦顯卡是 GeForce RTX 3090 VENTUS 3X 24G OC,算力很高,所以在顯卡的 batch_size 數值我先設定為 18,這項數值的高低取決你顯卡的內存。右邊的總訓練數 total_epoch 我則是設定 17,系統有建議不要設太高,但高一點的訓練數值會比較精準;保存頻率 save_every_epoch 就看你要在 total_epoch 的數值中,幾輪儲存幾次模型 :

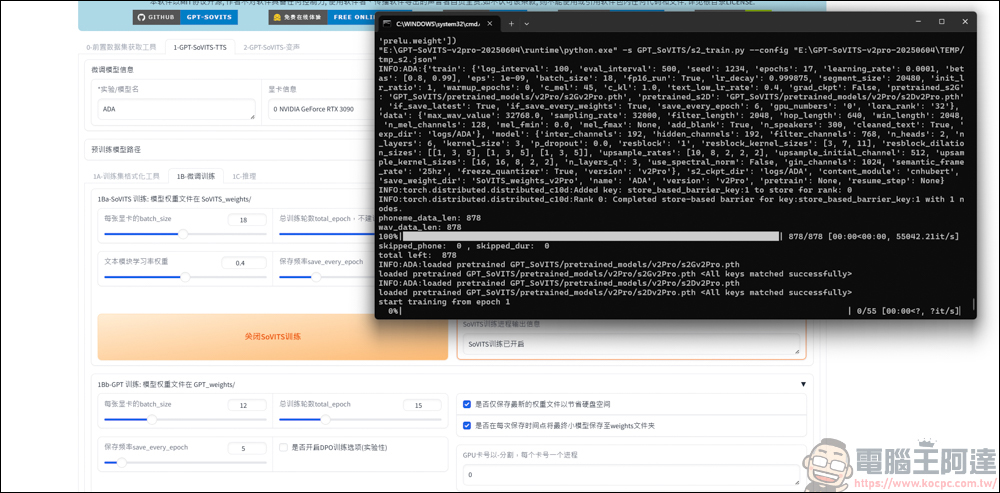

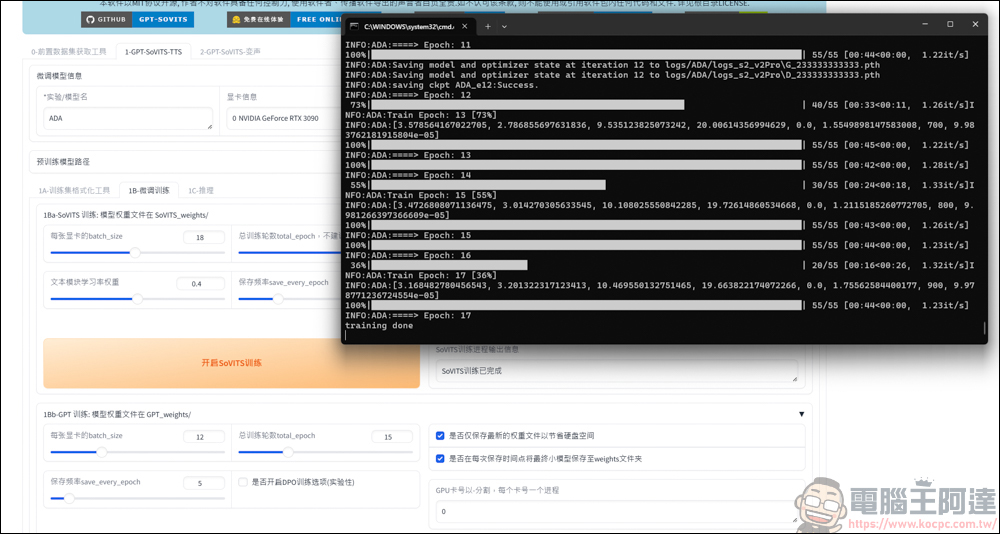

選好之後點擊 So-VITS,然後就會進行長時間的訓練運算,以我上面設定的數值來說,大概跑了 20-30 分鐘才訓練完,一切看你顯卡的運行速度 :

可以看到 GPU 是一直在運行的,但沒有吃滿,看來 batch_size 的數值還可以再高一點 :

訓練完成後,DOS 及頁面都會出現完成的字樣 :

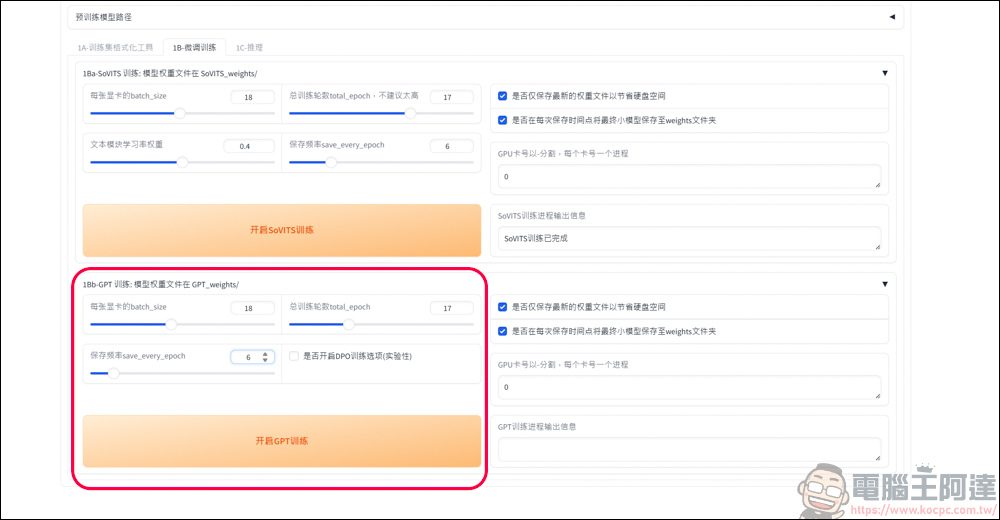

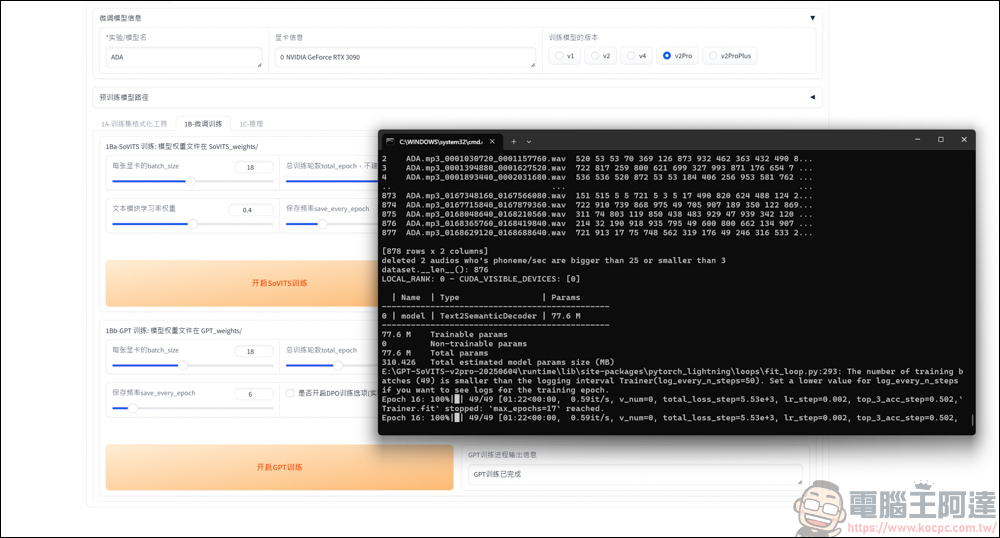

接下來是 GPT 訓練,設定的數值可以跟上面一樣,確認完後點擊開啟 GPT 訓練 :

GPT 訓練所花費的時間就會比較久一點,建議在電腦閒置時用來做訓練就好 :

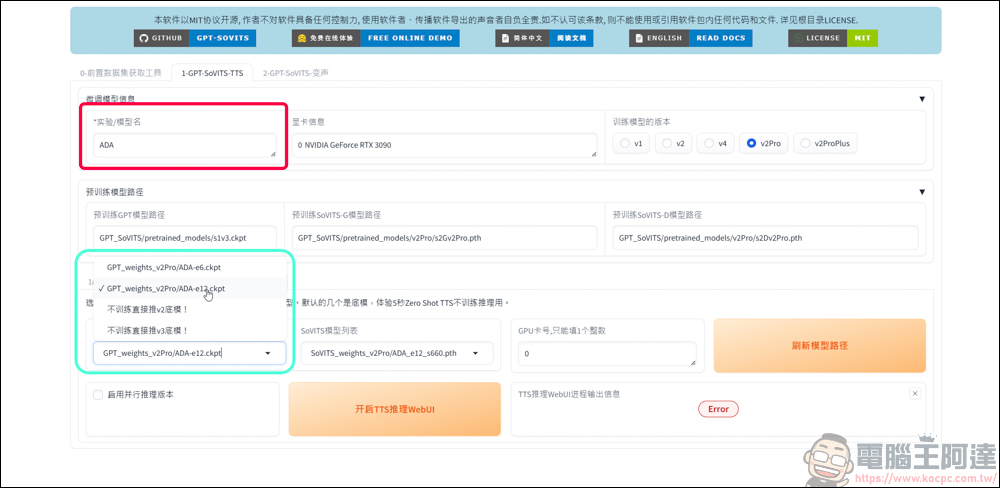

兩項功能訓練完之後,回到上方找到 1C-推理 :

推理就是準備來讓機器人念你指定的文本,在紅框處輸入模型名稱,然後在綠框處選擇訓練後的 GPT 模型,結尾有數字的就是剛剛訓練的模型,可選擇一個來進行訓練測試 :

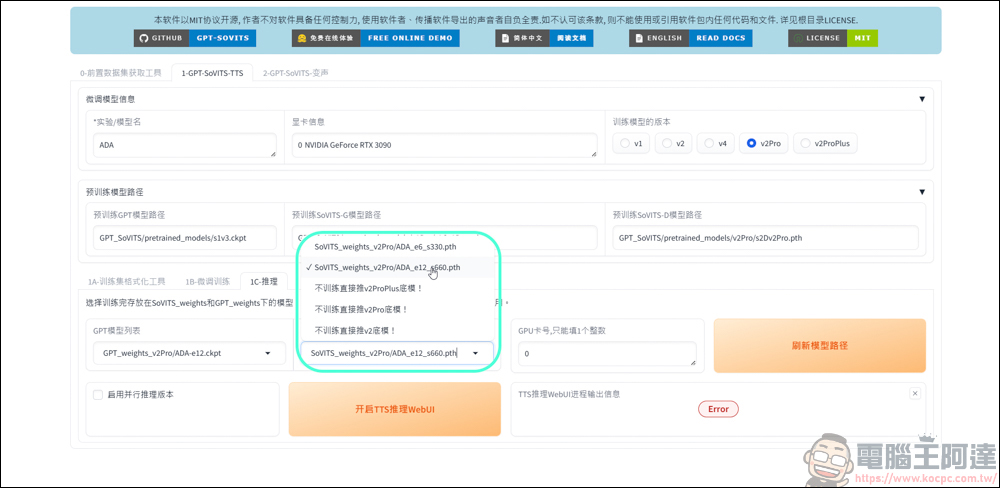

另一個 So-VITS 模型也是一樣要選 :

選擇完後點選開啟 TTS 推理 WebUI,這時要先等一下 :

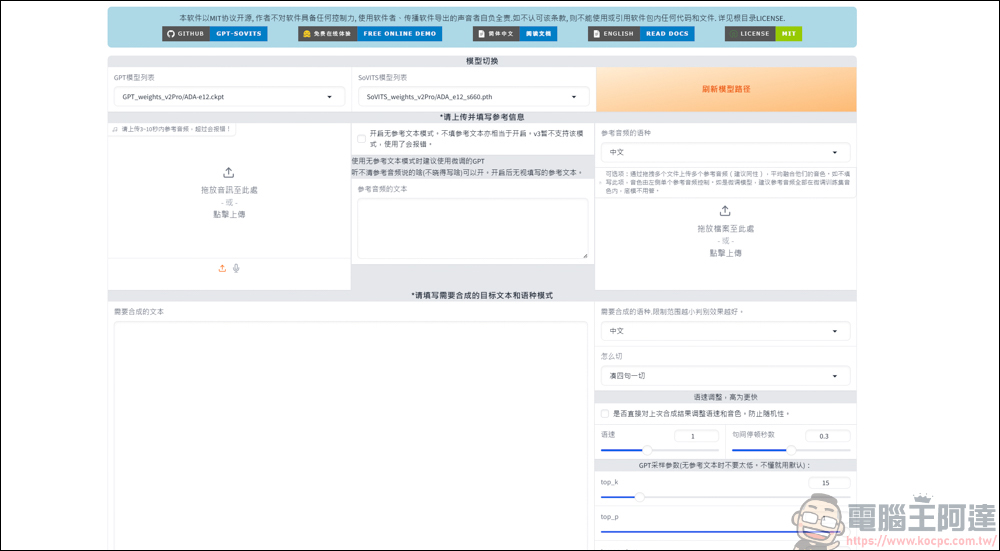

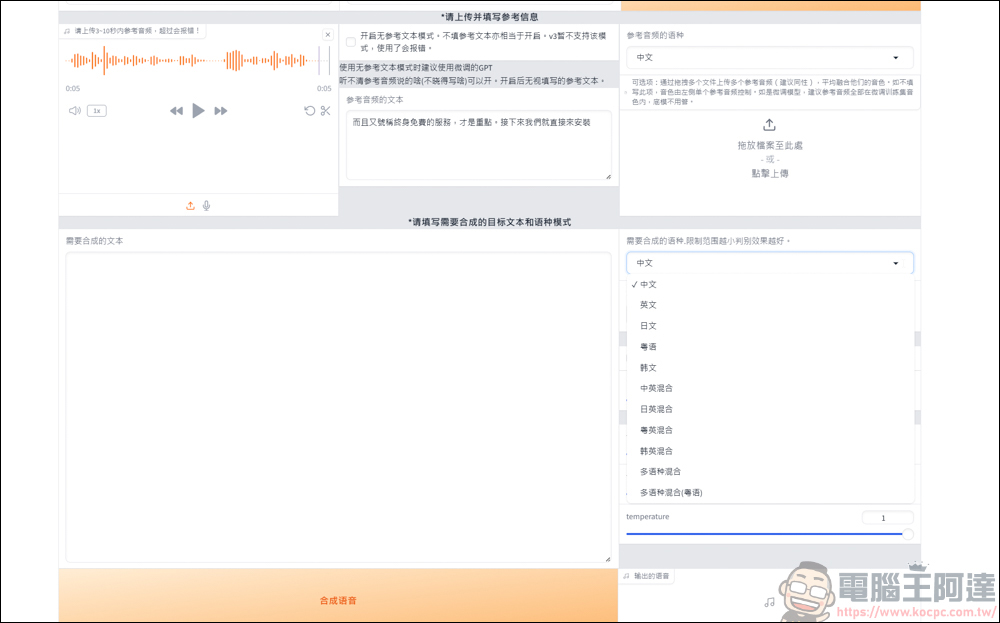

接著就會另外跳出 TTS 推理 WebUI :

在這頁面中,要先讀入使用者的音檔,可選擇一個剛剛裁切後的音檔丟入左上角 :

丟入之後,跟剛剛的音頻標註功能一樣,將綠框處音檔的文字內容打入在紅框處,記得要給標點符號 :

在右側處選擇要合成的語種,這邊選中文 :

然後在左邊的空白處,輸入你要機器人講的文字內容 :

按下合成語音就能輕鬆克隆你的聲音進行念稿 :

生成後的效果可以看以下影片的範例,雖然講話不像真人講話那麼完美,但這樣的效果其實已經很不錯了。要用來做做小影片或是快速介紹新聞的話,這方式就不錯,反正用自己的聲音生成XD

如果你對語速、斷句不滿意的話,也可以進行微調再重新生成,不斷地去測試哪種語速跟語調是最適合用的。

當然,如果你怎麼調都不滿意的話,我會建議你重新訓練模型,很有可能是你用來訓練的素材太短導致精準度很低,像下面這個範例我是直接用我們剪輯好的影片去擷取音檔的,因為影片本身剪的有點碎,所以機器人講話的語調就有一點點不正常,可能還會再另外訓練一次吧!

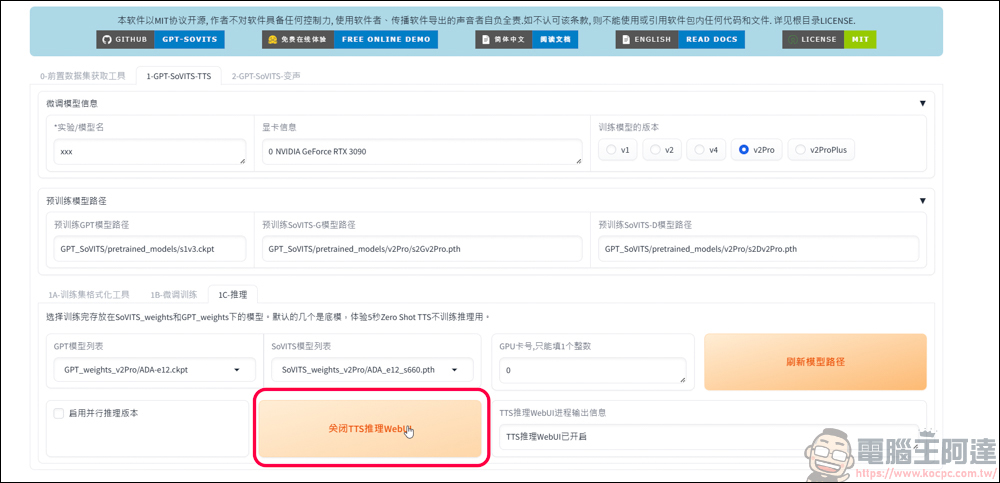

另外,之後如果要生成一份新的文本,在打開 go-webui.bat 後,請直接從 1C-推理進入,就能進入上面的合成語音功能,不要傻傻地以為還要再重新訓練一次模型 :