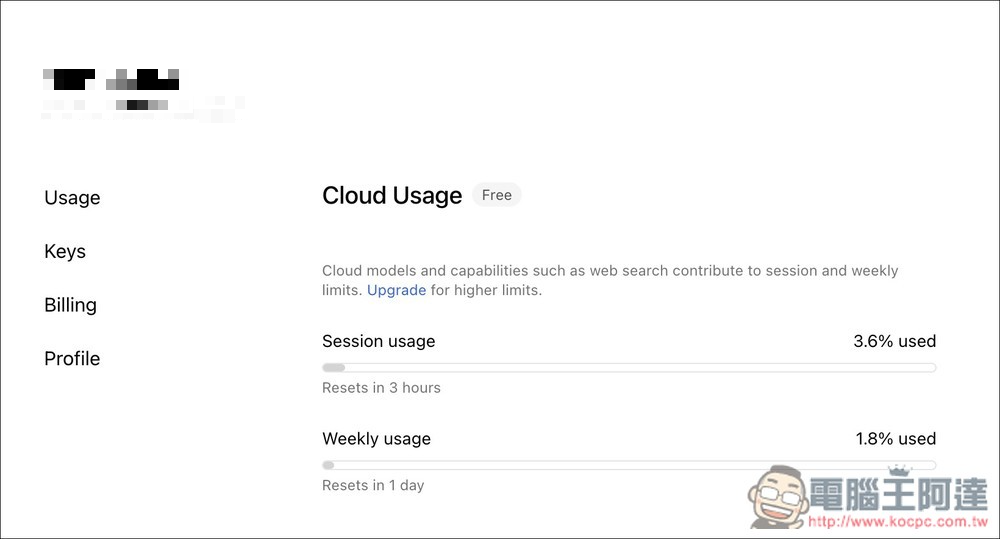

雖然我們寫過 OpenClaw 的安裝教學文章和教學影片,但對於一些電腦小白來說,可能還是覺得有些困難,這篇就要帶來一個好消息!Ollama 近日推出「一指令安裝 OpenClaw」的功能,無需任何複雜的設定,更棒的是,不僅能使用本地模型,還能直接串免費雲端模型使用(登入你的 Ollama 帳號),給得額度也超佛,我測試一開始的基本設定連 5% 用量都不到,每週額度就會重置,這真的超讚。

Ollama 介紹

對於不知道 Ollama 是什麼的人,這邊也快速介紹一下。

Ollama 是一款提供用戶於本地運行大型語言模型(LLM)與管理的 AI 免費工具,也就是使用者能在自己的電腦上快速部署與使用各種人工智慧模型,不用依賴雲端服務。透過簡單的指令介面,使用者可以下載、啟動與切換不同模型,例如 Qwen、Llama、Gemma、GPT 等,並直接在終端機或應用程式裡與 AI 互動。

除了本地模型,Ollama 也提供雲端模型整合功能,讓硬體資源有限的使用者也可以使用高效能 AI 模型。

而幾天前 Ollama 就在官網上宣布,已經整合目前最夯的 OpenClaw 龍蝦,不僅將安裝過程精簡化,如果是選擇使用雲端模型,還會自動安裝網頁搜尋外掛,讓 OpenClaw 馬上獲得網路搜尋的能力。

下面就來一步步教你怎麼安裝。Mac 或 Linux 系統都支援,我以 Mac 版為例。(Windows 用戶可透過 WSL 安裝 OpenClaw)

教你如何透過 Ollama 一指令安裝 OpenClaw,串連免費雲端模型使用

首先需確認以下兩款工具你的 Mac 裡都有:

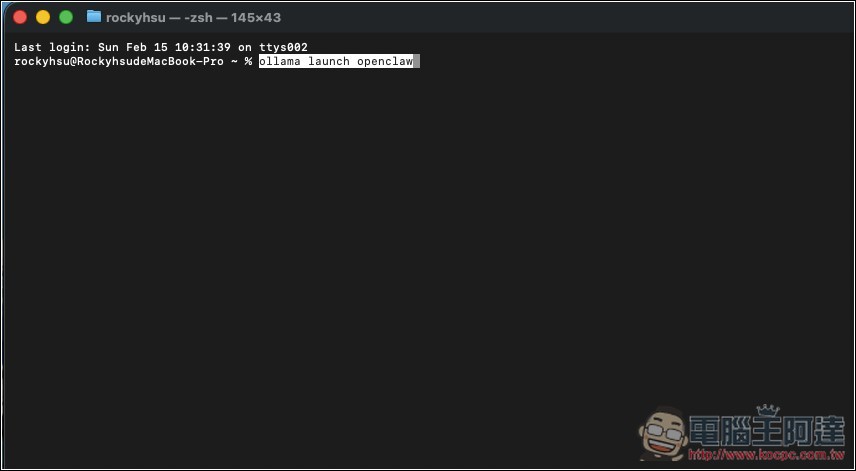

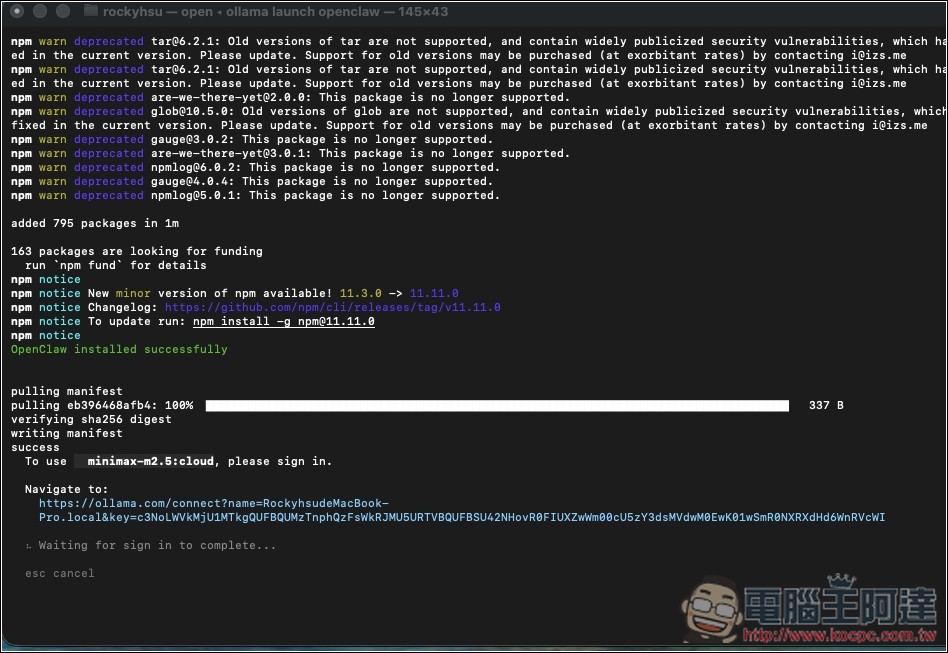

以上兩個都安裝好後,打開終端機,輸入「ollama launch openclaw 」,未來要啟用 Openclaw 也是用這指令:

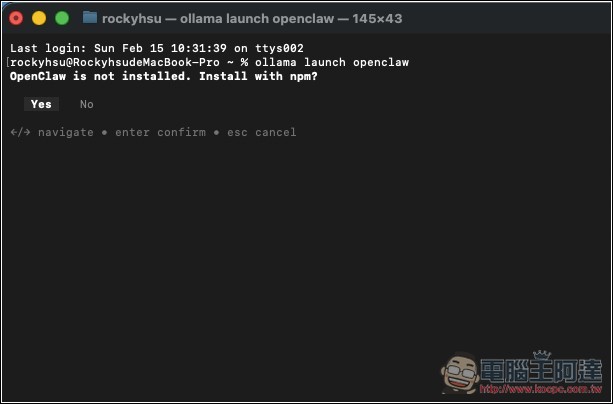

會自動偵測你的 Mac 裡有沒有 OpenClaw,如果沒有會自動安裝,選擇 Yes:

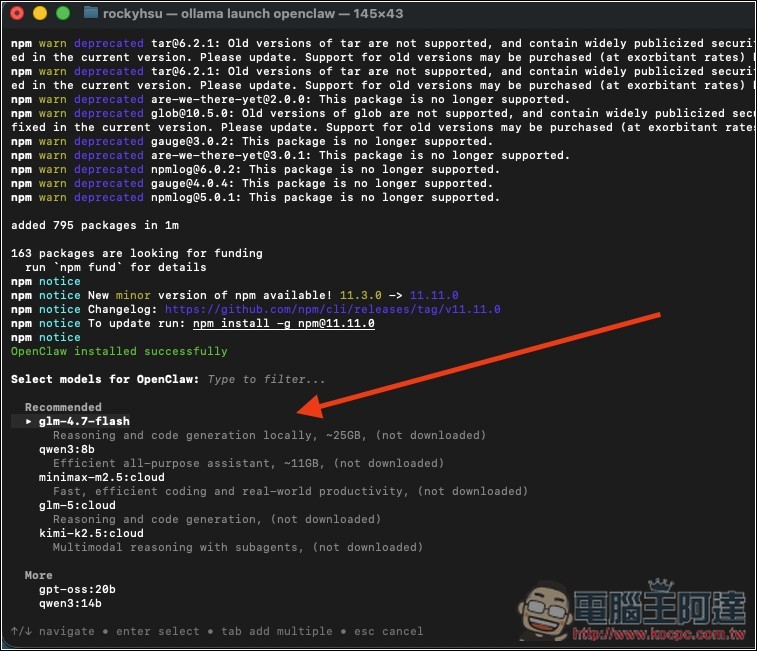

安裝好後,會讓你選擇要使用的模型,目前支援:

- 雲端模型:kimi-k2.5:cloud、minimax-m2.5:cloud、glm-5:cloud

- 本地模型(建議 25GB VRAM 以上 ):glm-4.7-flash、qwen3-coder

我用雲端 minimax-m2.5:cloud 這一個:

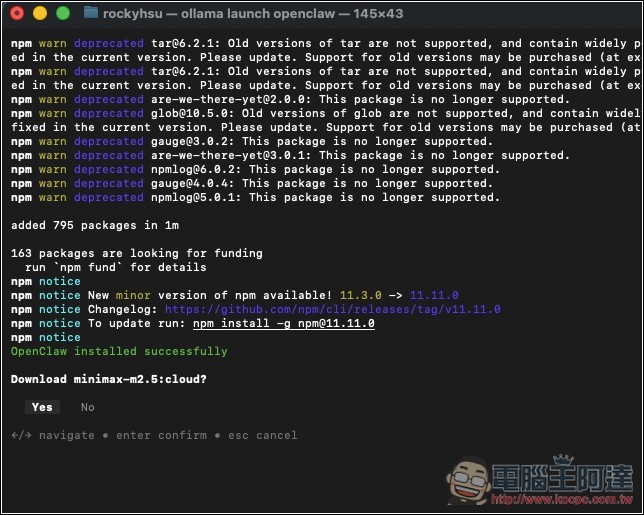

選擇好後,會讓你確認下載,按 Yes:

下載完成後,瀏覽器會自動打開登入網頁,如果你的沒有,也能複製終端機顯示的網址,瀏覽器貼上:

登入你的 Ollama 帳號,沒有的人就免費註冊一下:

確認連接:

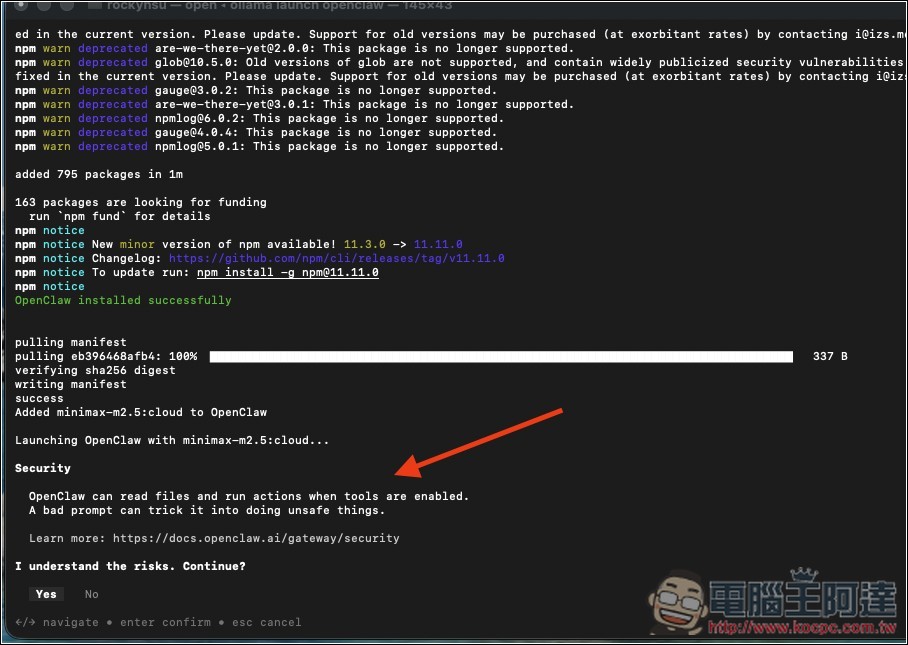

這樣模型就設定好後,接著會顯示一些安全說明,按 Yes:

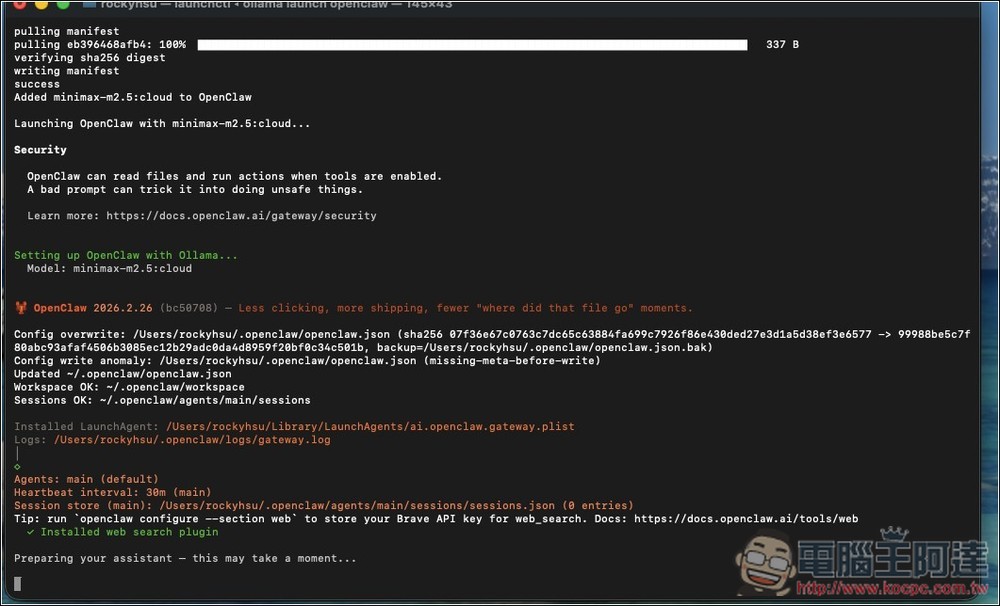

就會進到 OpenClaw 的畫面,等待它跑完:

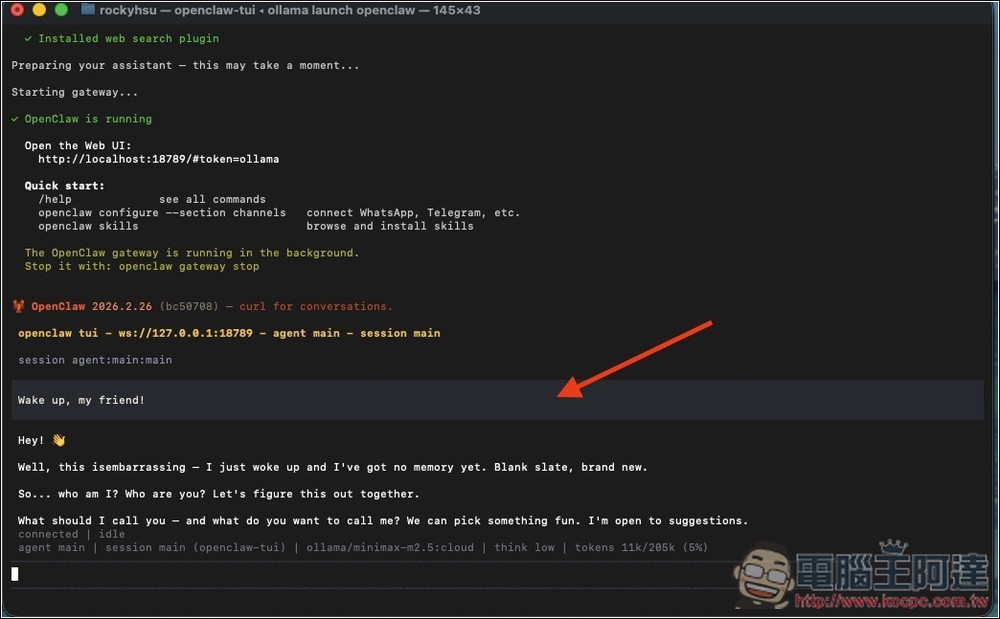

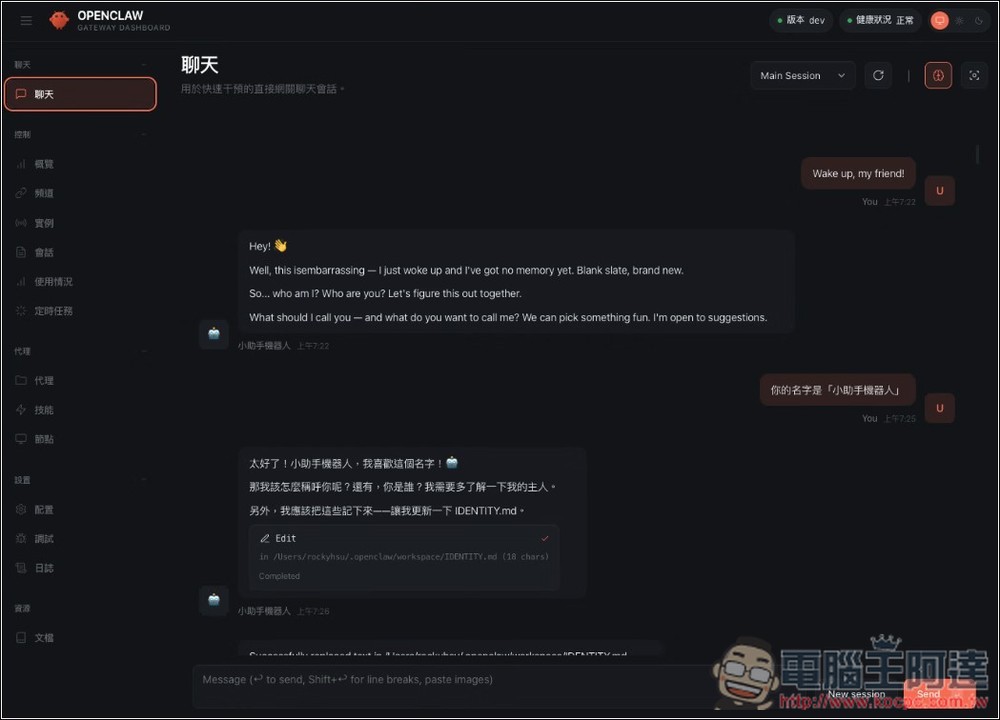

這樣就成功了!你可以在終端機裡面對話,也能複製終端機上方的「Open the Web UI」網址,打開網頁介面:

即使是免費模型,回應速度也非常快:

網頁版介面:

免費模型的用量可到 Ollama 後台查到(Usage),下圖是我設定好 OpenClaw + 串連 Telegram 後的用量,Weekly usage 僅使用 1.8%,由此可見給的額度真的很慷慨,而且每週都會更新。比較值得注意的是 Session usage,這是計算短時間的額度,如果你短時間突然大量使用,達到 100% 後,就需要等待幾個小時後重置,一般來說,如果你都正常使用很難滿: