在未來數週內,Instagram 將為啟用家長監督功能的家庭推出一項新的安全措施:當青少年在短時間內多次嘗試搜尋與自殺或自殘相關的關鍵字時,家長將收到提醒。這項更新旨在強化青少年帳號的保護機制,並協助家長在可能需要介入的時刻獲得必要資訊。

Instagram 新功能可在青少年搜尋自殺、自殘等內容時通知家長

Instagram 深知這類議題的敏感性,也理解家長在收到相關通知時可能會感到不安。值得強調的是,絕大多數青少年並不會在平台上搜尋這類內容;而當有人嘗試搜尋時,Instagram 會立即封鎖搜尋結果,並引導使用者前往能提供協助的資源與支援服務。新的提醒機制並非要放大恐慌,而是希望在青少年反覆搜尋相關內容時,讓家長能及早察覺並獲得合適的協助工具。

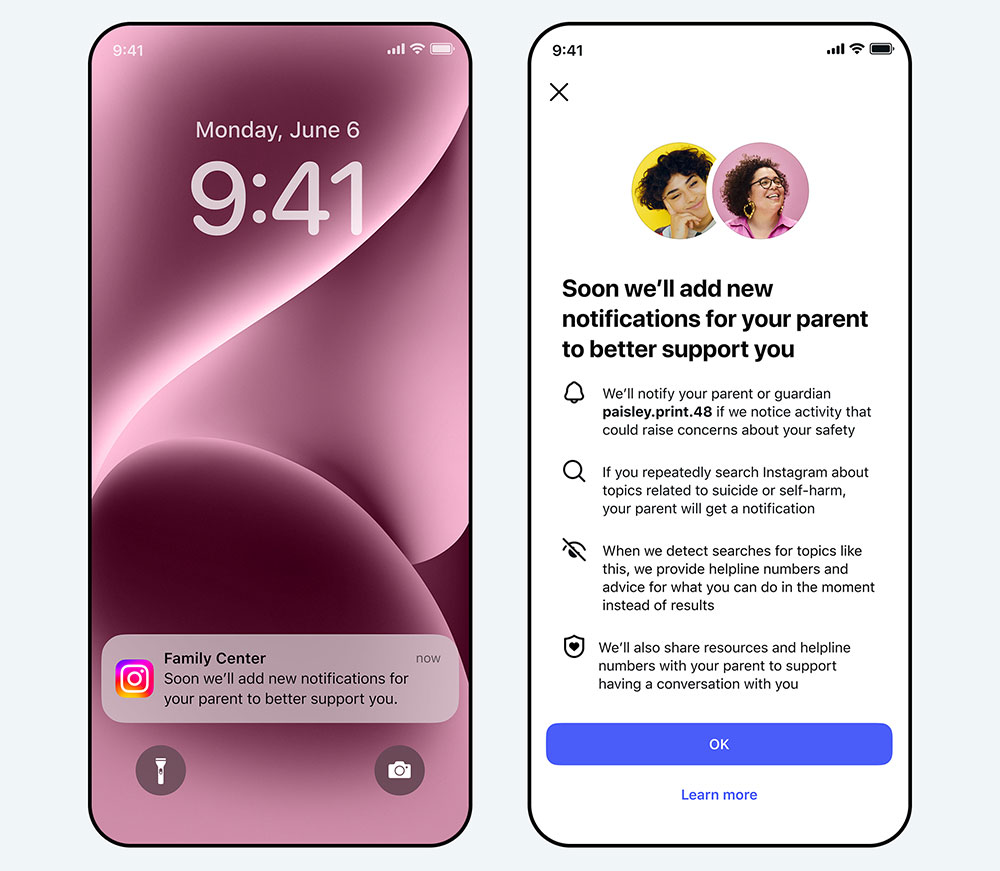

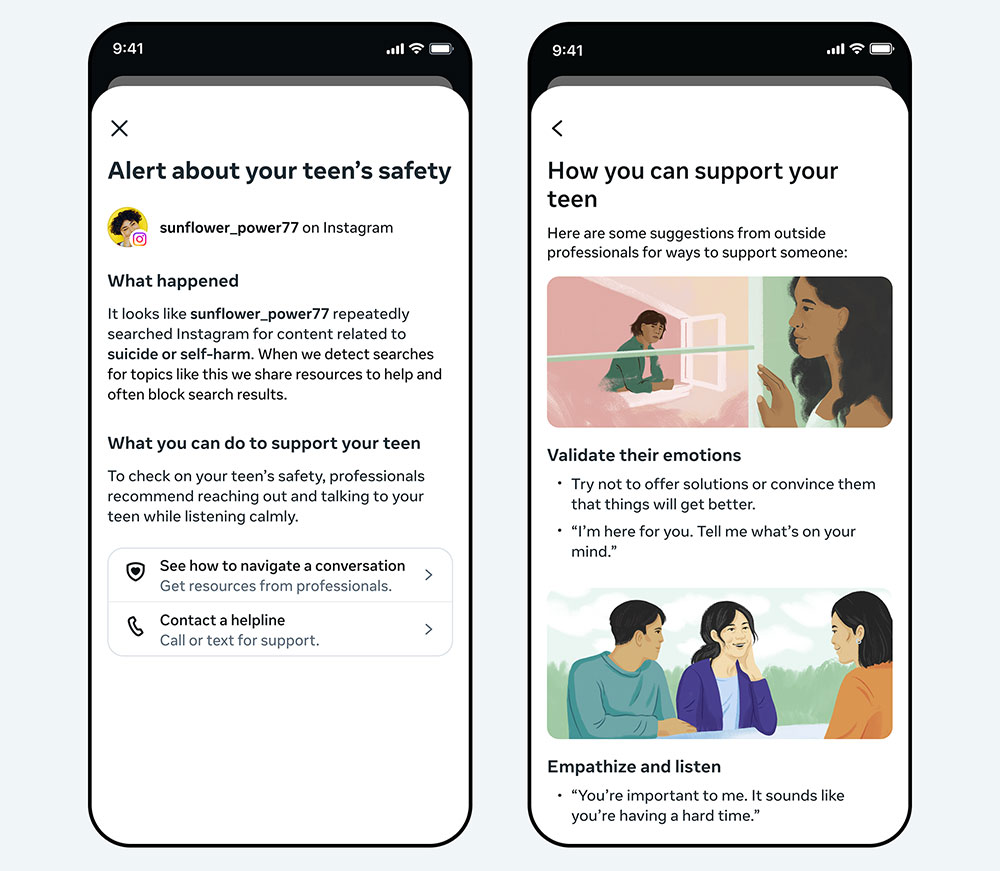

從下週開始,已加入監護服務的家長與青少年將收到通知,說明 Instagram 將依據青少年的搜尋行為啟動新的提醒流程。觸發提醒的搜尋包括宣揚自殺或自我傷害的語句、暗示自我傷害傾向的字詞,以及「自殺」「自殘」等明確詞彙。提醒將透過家長設定的聯絡方式發送,例如電子郵件、簡訊或 WhatsApp,同時也會在 Instagram 應用程式內顯示通知。家長點擊通知後,會看到一則全螢幕訊息,說明孩子在短時間內多次搜尋相關內容,並提供專家整理的資源,協助家長與孩子展開可能較為敏感的對話。這項功能將率先在美國、英國、澳洲與加拿大推出,並預計於今年稍晚擴展至更多地區。

Instagram 表示,這項更新的核心目標是讓家長在青少年可能需要協助時能及時介入,同時避免過度提醒造成反效果。為了取得適當的平衡,團隊分析了平台上的搜尋行為,並諮詢自殺與自我傷害領域的專家意見,設定了一個既能反映風險、又不至於過度敏感的觸發門檻。Instagram 也坦言,這可能偶爾會在沒有實際危險的情況下發出提醒,但專家普遍認為這是合理且必要的起點,未來也會持續調整。

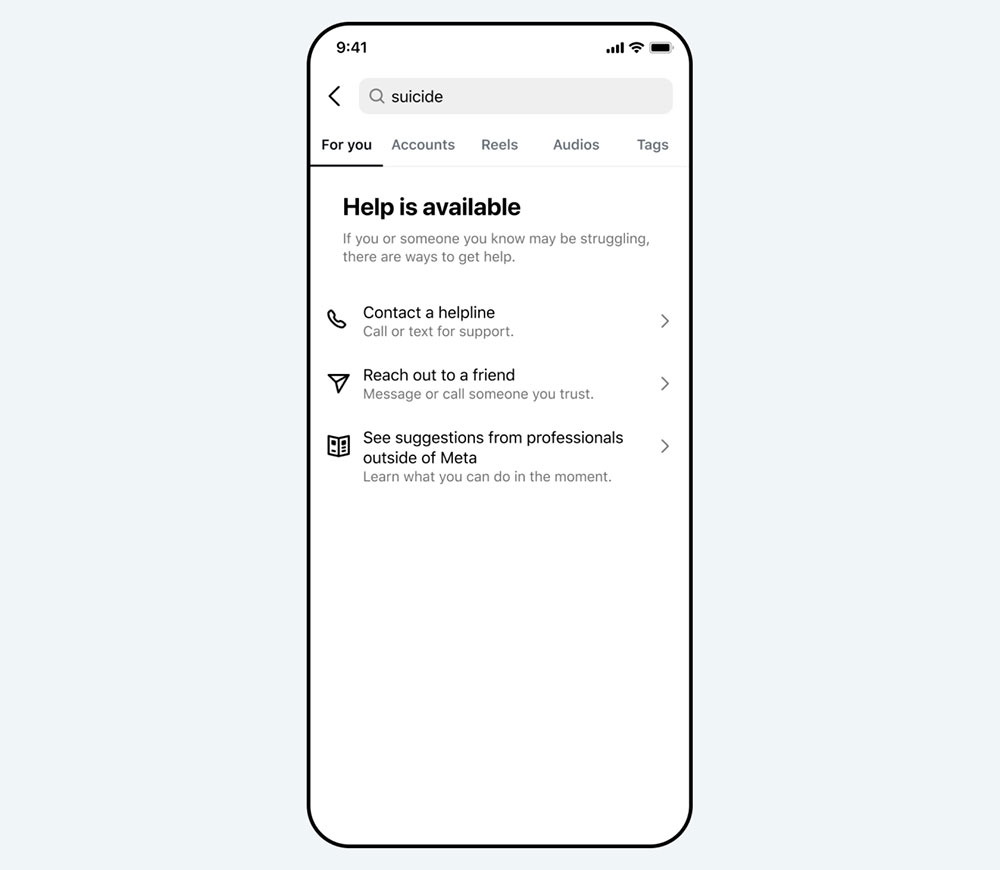

這項提醒機制延伸自 Instagram 既有的安全政策。平台嚴格禁止任何宣揚或美化自殺、自我傷害的內容;即使允許使用者分享自身的困境與經驗,這類內容也會對青少年進行隱藏處理。對於明確與自殺或自我傷害相關的搜尋,Instagram 會封鎖結果並引導使用者前往支援資源。即便搜尋內容較為廣泛、與心理健康相關,平台也會提供求助資訊。若系統判定有人面臨迫切的身體危險,Instagram 仍會通知當地緊急服務單位,這項措施過去已成功挽救生命。

除了搜尋功能,Instagram 也注意到越來越多青少年會向人工智慧尋求協助。因此,平台正著手為部分 AI 互動體驗建立類似的家長提醒機制,如果青少年試圖與 AI 進行與自殺或自我傷害相關的特定類型對話,家長也會收到通知。這項工作仍在開發中,Instagram 計畫在未來幾個月分享更多細節。整體而言,這項更新反映了 Instagram 在青少年安全領域的持續投入。平台希望在尊重青少年隱私與自主性的同時,讓家長在真正需要的時刻能夠伸出援手,並透過更完善的工具與資訊,陪伴孩子度過可能的難關。