在生成式 AI 蓬勃發展的當下,大型語言模型的記憶體瓶頸一直是困擾產業的核心難題。隨著模型規模不斷擴大、上下文視窗持續增長,鍵值緩存(KV Cache)所消耗的記憶體資源已經成為限制 AI 應用普及的關鍵障礙。傳統的向量量化技術雖然能夠壓縮數據,但往往伴隨著額外的記憶體開銷與精度損失,難以在實際部署中發揮理想效果。然而,Google 研究院於 3 月 25 日發布的一項全新壓縮算法,正在徹底改變這一局面:這項名為 TurboQuant 的技術,不僅能將 KV Cache 壓縮至僅 3 bits,更能在零精度損失的前提下,實現記憶體占用銳減 6 倍以上,推理速度提升高達 8 倍,Google 這項技術的發佈甚至還導致昨晚美股記憶體類股全面重挫。

TurboQuant:重新定義 AI 效率的極致壓縮技術

Google 研究院發布的 TurboQuant 是一種全新的極端壓縮算法,專門針對大語言模型(LLM)運行過程中的記憶體瓶頸問題而設計。該技術的核心目標是解決鍵值緩存(KV Cache)所帶來的記憶體壓力,這是目前 AI 模型在處理長文本或大規模搜尋時最常遇到的性能限制因素。

傳統的高維向量量化技術雖然能夠壓縮數據,但通常需要為每個微小的數據塊計算和存儲量化常數,這種額外的「記憶體開銷」往往會抵消壓縮原本帶來的優勢。TurboQuant 的創新之處在於,它能夠在完全不犧牲 AI 模型預測性能的前提下,大幅削減 KV Cache 的記憶體占用,同時避免傳統方法所帶來的額外負擔。

雙階段技術架構:PolarQuant 與 QJL 的完美協作

TurboQuant 的運作機制分為兩個關鍵步驟,結合了兩項核心底層技術:PolarQuant 與 QJL(量化 Johnson-Lindenstrauss)。

第一階段:PolarQuant 高品質主體壓縮

PolarQuant 採用了一種突破性的方法,放棄了傳統的笛卡爾座標系,轉而將數據向量轉換為極座標。這種轉換將數據映射到邊界已知的固定「圓形」網格上,從而免去了昂貴的數據歸一化步驟,徹底消除了傳統量化方法所必須承載的記憶體開銷。

更具體地說,PolarQuant 將每個向量分離為半徑(代表數據強度)和角度(代表數據方向或含義)。由於角度分布是可預測且高度集中的,該方法無需執行傳統量化器所需的昂貴逐塊歸一化步驟,從而實現高品質壓縮且零記憶體開銷。

第二階段:QJL 消除殘差誤差

在 PolarQuant 完成主體壓縮後,TurboQuant 利用 QJL 算法處理遺留的微小誤差。QJL 僅需 1 bit 的殘差壓縮算力,就能像數學糾錯機一樣消除偏差,確保模型計算出精準的注意力分數。

QJL 使用稱為 Johnson-Lindenstrauss 轉換的數學技術,將複雜的高維數據縮小,同時保留數據點之間的基本距離和關係。它將每個結果向量數字減少到單個符號位元(+1 或 -1),創建一個零記憶體開銷的高速速記系統。

實測數據:6 倍記憶體壓縮、8 倍速度提升

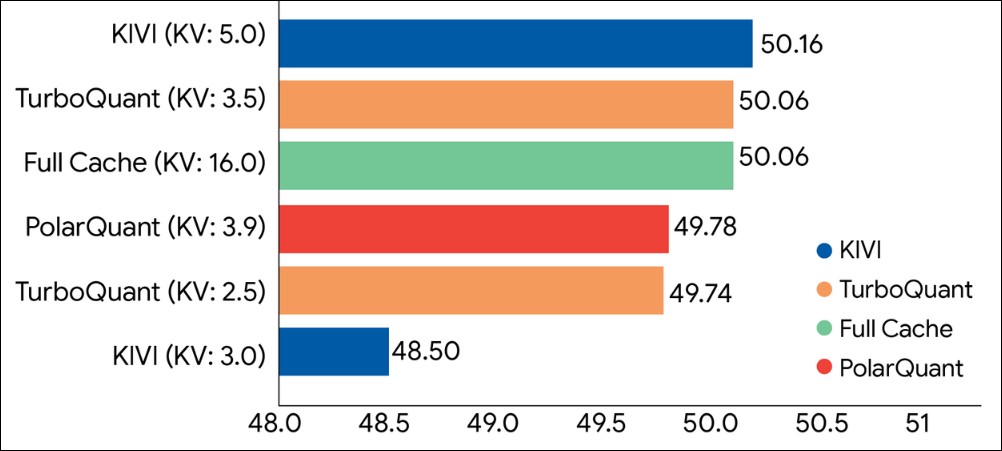

研究團隊在 Gemma 和 Mistral 等開源大模型上進行了嚴格的基準測試,測試範圍涵蓋 LongBench、Needle In A Haystack、ZeroSCROLLS、RULER 和 L-Eval 等標準長上下文基準。

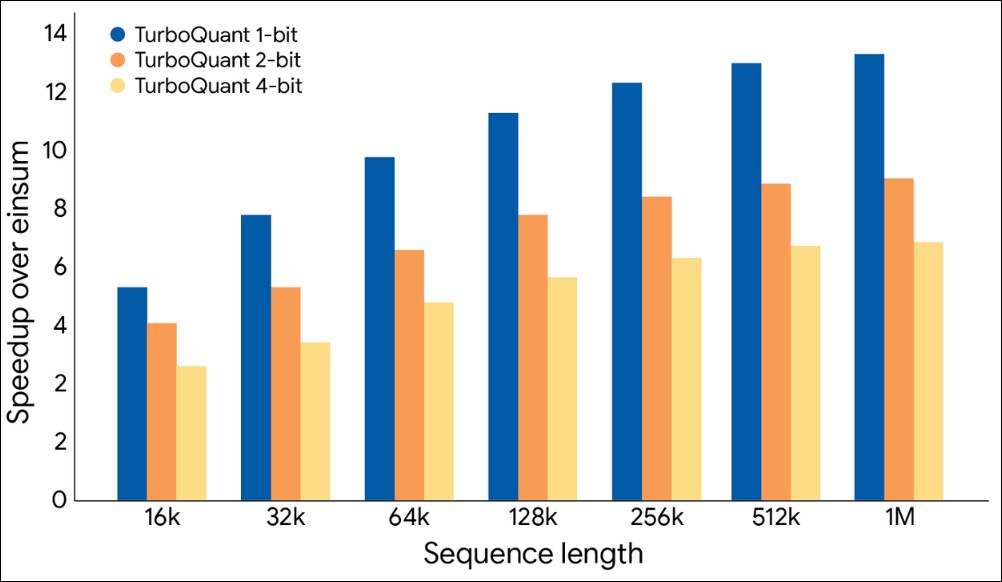

實驗數據表明,TurboQuant 無需任何預訓練或微調,就能極其高效地將 KV Cache 壓縮至 3 bits,並在「大海撈針」等長上下文測試中實現零精度損失,同時將記憶體占用降低至 1/6。在 H100 GPU 加速器上,4-bit TurboQuant 的運行速度比未量化的 32-bit 基準提升了高達 8 倍。

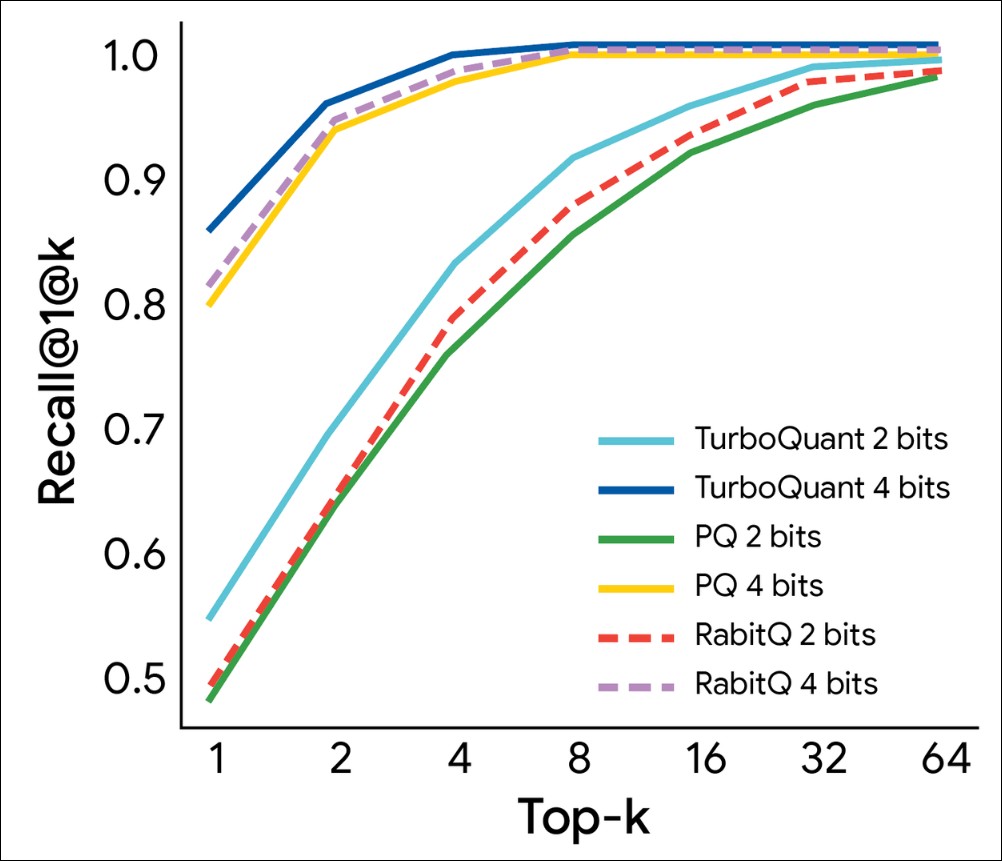

在 LongBench 測試套件(涵蓋問答、程式碼生成和摘要等任務)中,TurboQuant 在所有任務上都達到或超過了 KIVI 基線的性能表現。在向量搜尋方面,TurboQuant 在 GloVe 數據集上對比 Product Quantization 和 RabbiQ 方法,實現了最高的 1@k 召回率,即使這些基線方法依賴更大的碼本和數據集特定調優。

產業衝擊:記憶體晶片股價集體重挫

TurboQuant 的發布不僅在技術層面引發關注,更在資本市場掀起波瀾。由於該技術能夠大幅減少 AI 應用對記憶體容量的需求,投資者擔憂這將影響記憶體晶片的長期需求前景。消息公布後,存儲晶片板塊巨頭股價全線重挫。截至收盤,美光科技(Micron)下跌 4%、西部數據(Western Digital)下跌 4.4%、希捷(Seagate)下跌 5.6%,閃迪(SanDisk)更是重挫 6.5%。

這一波跌勢反映出市場對於 AI 記憶體需求結構可能發生根本性轉變的擔憂。如果 TurboQuant 這類技術能夠被廣泛採用,未來 AI 數據中心對於高容量記憶體的需求增長可能會低於先前預期。(真是太好了!!)

觀點

TurboQuant 的出現,標誌著 AI 基礎設施優化進入了一個新的階段。這項技術的價值不僅僅在於其驚人的壓縮比和速度提升,更在於它無需預訓練或微調即可應用於現有模型的特性。這意味著 Google 可以立即將其部署到 Gemini 等生產環境中,而其他 AI 公司和開發者也能夠快速受益,無需承擔昂貴的模型重訓練成本。

從產業角度來看,這項技術可能加速 AI 應用的普及。更低的記憶體需求意味著更低的部署成本,這對於希望在本地或邊緣設備上運行大型語言模型的開發者來說是一大利好消息。同時,對於雲端 AI 服務提供商而言,更高的運算效率將直接轉化為成本優勢和服務能力的提升。

然而,記憶體晶片股價的集體下挫也提醒我們,技術創新往往伴隨著產業格局的重組。傳統硬體供應商可能需要重新思考其產品策略,在容量增長之外,尋找新的價值創造點,例如更高頻寬、更低延遲或更專業化的應用場景。