近年來,AI 的快速崛起引發了大量討論,許多人擔心 AI 正在逐步取代人類技能,甚至威脅某些職業的存在。然而,這個現象其實還有另一面:AI 的普及反而迫使人類進化,培養新的能力,尤其是辨識資訊真偽的能力。面對 AI 自信滿滿卻可能錯誤的輸出,我們逐漸學會如何保持懷疑、如何驗證內容、如何在限制中找到使用 AI 的最佳方式,這些都是過去我們不曾需要如此強烈依賴的技能。

微軟給 Copilot 新增一條免責聲明,強調「娛樂用途」

事實上,許多使用者在這幾年已經變得相當擅長「AI 識讀」。我們知道模型可能會幻覺、可能會誤解問題、可能會把錯誤講得像真理一樣,也因此,AI 公司通常會在產品頁面、技術文件或使用條款中加入免責聲明,提醒使用者不要盲目信任輸出內容。Google 的 Gemini 簡介就是一個典型例子:它在介紹模型能力的同時,也清楚列出限制,並強調使用者應該自行判斷資訊的可靠性。

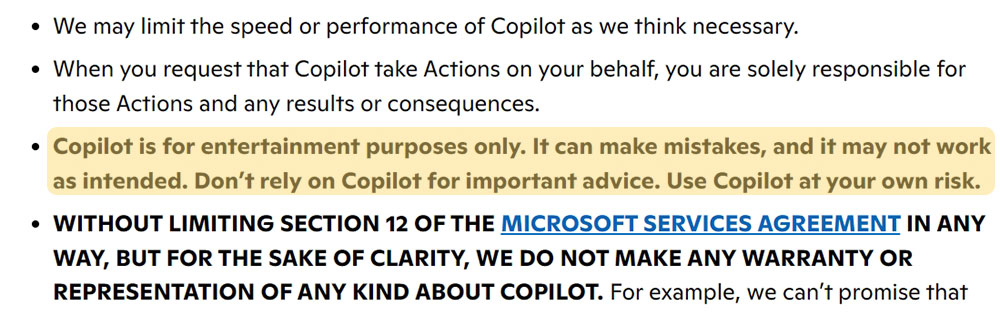

然而,微軟最近的一項做法卻引起了不少討論。和其他 AI 公司一樣,微軟積極宣傳 Copilot 的強大功能,展示它如何協助企業制定策略、撰寫文件、分析資料、提升效率。這些宣傳看起來完全合理,畢竟現代 AI 平台都會強調自己能幫助使用者完成重要任務。但問題出在另一個地方,微軟的 Copilot 使用條款中出現了一段令人意外的文字。根據 Tom’s Hardware 的整理,條款裡寫著:

「Copilot 僅供娛樂用途。」

這句話看似簡單,卻讓整份文件的語氣瞬間變得詭異。畢竟,微軟前一秒還在告訴企業客戶 Copilot 能協助制定策略、提升生產力,下一秒卻在法律文件裡說它「只能拿來娛樂」。這種落差讓人不禁懷疑:微軟到底希望使用者把 Copilot 當成什麼?

條款接著補充:

「它可能會出錯,也可能無法如預期運作,請勿依賴 Copilot 提供重要建議,使用 Copilot 需自行承擔風險。」

如果單看這段內容,其實並不特別。所有 AI 公司都會提醒使用者:模型可能會犯錯、輸出需要驗證、不要把 AI 當成專業顧問,這些都是合理且必要的警語。但真正奇怪的是,微軟似乎覺得這樣還不夠,於是在文件中多次加入類似「這是開玩笑」的語氣,彷彿在強調 Copilot 不應被視為任何嚴肅用途的工具。這種語氣與微軟在市場上的定位完全不符,也難怪會引發外界的困惑與嘲諷。

從實務角度來看,這很可能是法律團隊為了降低風險而採取的極端寫法。畢竟,AI 的不可預測性確實讓公司承擔一定責任,而律師往往會選擇最保守的方式來保護企業。然而,這種「矯枉過正」的做法反而讓微軟陷入尷尬:一方面它希望企業把 Copilot 視為提升效率的核心工具,另一方面卻在條款裡暗示「別太認真,這只是娛樂」。這種矛盾讓人忍不住想,如果微軟真的擔心 Copilot 的輸出可能造成誤導,那麼它是否應該先讓 Copilot 自己檢查一下條款,找出那些令人困惑的地方?但根據條款本身的說法,Copilot 顯然不是用來做這種事的,因為它「僅供娛樂」。

這整件事凸顯了一個更大的問題:AI 公司在推廣產品時,往往希望強調能力;但在法律文件中,又必須承認限制,這兩者之間的張力越來越明顯,也反映出整個產業仍在摸索如何在創新與責任之間取得平衡。最終,這些條款提醒我們:無論 AI 多麼強大,人類仍然需要保持批判思維。AI 可以協助我們,但不能替我們做決定;它能提供資訊,但不能保證正確;它能加速流程,但不能取代判斷。或許,這正是 AI 時代最重要的技能,懂得如何與不完美的智慧共存。