每當你使用 Google 搜尋資料時,在頁面頂端出現的那段 AI 摘要你有想過它的內容可能是錯的嗎?《紐約時報》委託 AI 新創公司 Oumi 進行大規模測試,結果發現 Google 內建 Gemini 驅動的 AI Overview 準確率僅約 90%:也就是每 10 次搜尋就有 1 次會給出錯誤答案。以 Google 每日數十億次的搜尋量計算,這代表 AI Overview 每小時可能產生數十萬則錯誤資訊,一整天下來高達數百萬則 。

從 85% 到 91%:號稱進步,但錯誤數量依然驚人

這項測試採用 OpenAI 開發的 SimpleQA 基準:一套包含超過 4,000 個可驗證答案的題庫,用來衡量生成式 AI 的事實正確性。Oumi 從去年 Gemini 2.5 時期開始進行測試,當時 AI Overview 的 SimpleQA 分數為 85%;今年重新測試時,Gemini 3 更新後的 AI Overview 已提升至 91% 。

數字看起來進步了,但問題在於:即使錯誤率只有 9%,乘上 Google 每日數十億次搜尋,錯誤答案的總量仍是天文數字,Oumi 的估算指出,AI Overview 每天產生的錯誤資訊數量達到數百萬則。

錯誤案例:自信引用錯誤內容

《紐約時報》的報告列出了多個具體錯誤案例,每一個都顯示 AI 並非「找不到答案」,而是在有資料來源的情況下仍自信地給出錯誤答案:

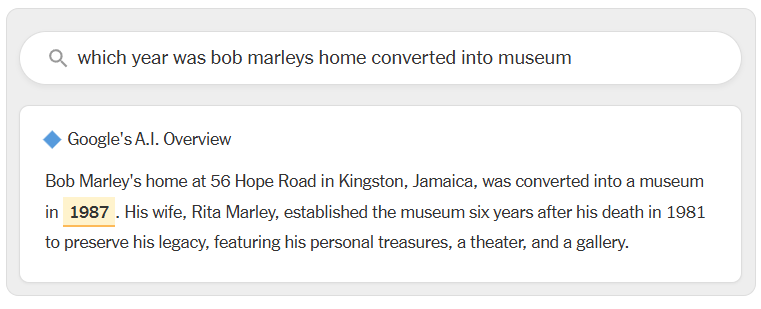

案例一:Bob Marley 故居博物館日期

查詢「Bob Marley 故居改為博物館的日期」,AI Overview 引用了三個頁面:其中兩個根本沒談日期,唯一談到日期的維基百科還列出兩個矛盾的年份。AI Overview 果斷選了錯誤的那個 。

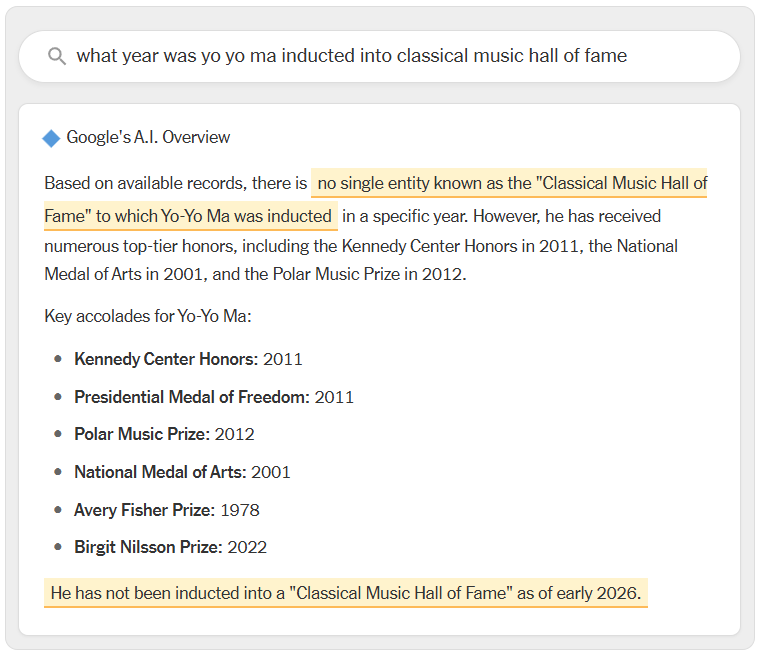

案例二:馬友友名人堂爭議

查詢「大提琴家 Yo-Yo Ma(馬友友)獲選進入古典音樂名人堂的日期」,AI Overview 引用了該組織官網的內容,卻聲稱「根本沒有這個名人堂」,事實上該名人堂確實存在。

這些錯誤的共同點在於:AI 並不是胡亂生成,而是選擇性地引用了錯誤來源的錯誤內容,誤導程度更勝「查不到」。有資料支撐的謊言,比一無所知的空白更危險。

Google 反駁:SimpleQA 本身有問題

面對這項研究,Google 發言人 Ned Adriance 向《紐約時報》表示:「Google 相信 SimpleQA 基準本身包含不正確的資訊 。」他強調,Google 內部使用的是另一套稱為 SimpleQA Verified 的測試,題目經過更嚴格的人工審查,規模較小但品質更高。

「這項研究有嚴重的漏洞,」Adriance 表示,「它並沒有反映人們實際在 Google 上搜尋的內容 [2]。」Google 的立場是:SimpleQA 測試的是通用知識題型,而非用戶最常搜尋的操作型或比較型問題,因此 SimpleQA 的結果無法直接類推到真實搜尋行為。

Benchmark 測試本身的極限

然而,分析指出,AI 評測本身就像一門尚未成熟的藝術,每家公司有自己的偏好評測方式,而生成式 AI 的非隨機性更讓結果難以複現。同一個問題,即時重新執行一次,AI 有時候答對、有時候又答錯,讓獨立核查變得極度困難。Oumi 甚至本身也使用 AI 工具來進行評測,等於是「AI 裁判 AI」。

此外,SimpleQA 的題目偏向「簡單事實型」問題(如日期、人名、數字),而非 Google 用戶最常搜尋的操作型或比較型問題,兩類題型的難度結構根本不同 。

AI 搜尋時代的信任危機

無論這項研究的方法論是否有漏洞,一個根本問題已經浮上檯面:當 Google 把 AI Overview 放在搜尋結果最頂端,越來越多使用者開始把 AI 的回答當成標準答案,而不是像過去一樣,把文章連結當成起點、自己一一解讀內容。AI Overview 的錯誤也因此比傳統網頁錯誤更容易被直接接受。

簡單來說:過去 Google 給你一頁連結,錯了是你的問題;現在 Google 給你一個答案,錯了……是誰的問題?