如果有一天,開發者再也不需要手動調整 AI 的系統提示詞(system prompt),讓 AI 自己找出更好的版本,而這件事,現在正在發生。人工智慧研究機構 Nous Research 日前在 GitHub 上開源了一個名為 Hermes Agent Self-Evolution 的新專案,讓旗下的開源 AI Agent「Hermes Agent」擁有自我進化的能力:透過分析自身的執行記錄,自動產生改良版的技能指令(skill)、工具描述(tool description)與系統提示,並在測試通過後提交為候選升級版本。

這個框架的核心引擎叫做 GEPA(Genetic-Pareto Prompt Evolution),一套獲得頂尖 AI 學術論壇 ICLR 2026 最高榮譽「Oral」認可的提示詞優化演算法。在六項任務的實測中,GEPA 的表現比主流強化學習方法 GRPO 平均高出 6%,最高差距達 20 個百分點,同時所需的訓練資料量僅為後者的三十五分之一。

什麼是 Hermes Agent Self-Evolution?

Hermes Agent 是 Nous Research 在 2026 年 2 月推出的開源 AI Agent 框架,功能涵蓋網頁瀏覽、程式撰寫、檔案操作、記憶管理等,強調「越用越聰明」的自我優化設計。上線後短短數週即登上 GitHub Trending 排行,並迅速累積超過數萬顆星,成為近期 AI 開源社群最受矚目的專案之一。

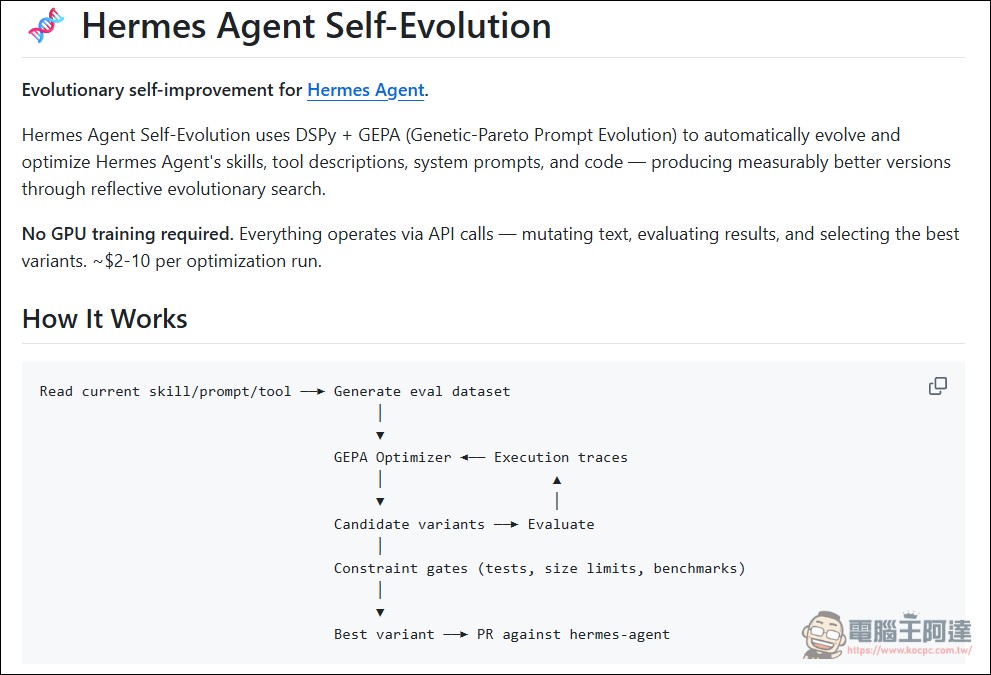

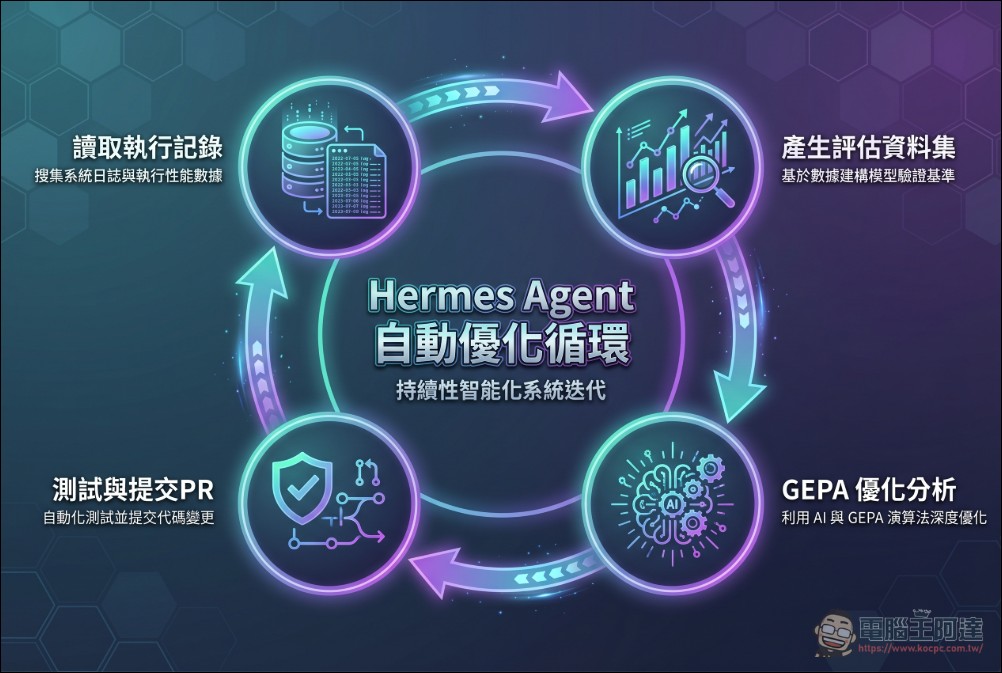

此次開源的子專案 hermes-agent-self-evolution,是 Hermes Agent 的自動優化管道,主要由 Nous Research 聯合創辦人 teknium1 主導開發。根據 GitHub README,整套系統的運作邏輯如下:

- 讀取 Agent 當前使用的技能描述檔、工具說明或系統提示

- 根據真實執行記錄(reasoning、tool calls、tool outputs)自動產生評估資料集

- 交由 GEPA 優化器分析失敗原因、提出候選改良版本

- 每個候選版本必須通過完整測試套件(包含 pytest 測試 100% 通過、大小限制、語意保留等關卡)

- 通過所有關卡的最佳版本,以 Pull Request 形式提交供人工審查,不直接寫入

值得注意的是,整個流程不需要 GPU 訓練,僅透過 API 呼叫即可完成。官方估計每次優化執行成本約 NT$65 至 NT$325(約美元 2 至 10 元,按匯率約 32.5 換算),相較於傳統強化學習動輒消耗大量算力的訓練方式,門檻大幅降低。

GEPA 是什麼?為何比強化學習更有效率?

GEPA 的全稱是 Genetic-Pareto Prompt Evolution,由研究人員以論文形式發表於 arXiv(論文編號 2507.19457),並獲得 ICLR 2026 Oral 認可,是當屆會議的最高等級論文之一。

傳統強化學習方法(如 GRPO)在讓 LLM 學習新任務時,通常需要數千次 rollout(模型執行嘗試)才能有效更新策略。GEPA 的出發點是:語言模型本身就能理解「為什麼失敗」,而不只是接受「失敗了」這個訊號。

因此 GEPA 的做法是:讓模型讀取自己的執行軌跡(包含推理過程、工具呼叫紀錄),用自然語言反思找出問題,再提出改良版提示、測試各版本,最終從「帕雷托前緣」(Pareto frontier)挑選出互補性最高的優化成果加以合併。這使得 GEPA 在少量資料下就能產生顯著的品質提升。

論文揭露的量化成果相當亮眼:

- 在六項任務中,GEPA 平均比 GRPO 高出 6%,最大差距達 20 個百分點

- 使用的 rollout 資料量僅為 GRPO 的 1/35(約少用 35 倍資料)

- 在 AIME-2025 數學題庫測試上,GEPA 比當前最強的提示優化工具 MIPROv2 高出 12%

- 同時展現出作為推理時搜索策略的潛力,在程式碼優化任務上效果顯著

自我進化的範疇:四個階段、兩套引擎

hermes-agent-self-evolution 目前公布的路線圖分為五個演化階段,採用兩套不同引擎:

- Phase 1(已實作):技能描述檔(SKILL.md)的自動優化——這是 Hermes Agent 用來記錄各項任務操作方式的核心文件,決定了 AI 在面對特定任務時的行為框架

- Phase 2(計劃中):工具描述(tool descriptions)的優化,讓 AI 更精確地理解何時該呼叫哪個工具

- Phase 3(計劃中):系統提示(system prompt)各區段的自動優化

- Phase 4(計劃中):工具實作程式碼本身的優化,採用外部開源工具 Darwinian Evolver(以 Git commit 為單位模擬生物演化)

- Phase 5(計劃中):連接前四階段的持續優化自動化管道

主引擎 DSPy + GEPA 採 MIT 授權開放使用;Phase 4 計劃引入的 Darwinian Evolver 則採 AGPL v3 授權,將以外部 CLI 工具形式調用,不直接整合入核心。整個框架也對安全性做出明確承諾——所有優化後的改動均需透過 Pull Request 流程接受人工審查,不允許自動直接寫入正式版本。

Prompt Engineering 的終結?

對許多 AI 開發者而言,「寫好 system prompt」(系統提示詞)是目前實際部署 AI Agent 時耗費最多心力的環節之一。hermes-agent-self-evolution 所開啟的,正是一條讓這件事自動化的路徑:不是由工程師手動實驗各種 prompt 寫法,而是讓框架自己讀取失敗案例、自己提出改良、自己驗證成效。

當然,這套系統目前仍處於早期階段:Phase 1 的技能檔優化已實作,但更核心的系統提示與程式碼優化都尚在規劃中。且即便優化流程可以自動化,人工審查這道關卡依然保留,顯示 Nous Research 並未打算讓 AI 完全自主地改寫自己。

但從更宏觀的視角來看,這個方向已然清晰:AI Agent 的下一個競爭維度,將不只是「功能多不多」或「模型強不強」,而是它能否在使用中持續優化自身的行為方式。Nous Research 的這步棋,可能是這場競賽中最早的幾張牌之一。