在傳言了大半年之後,被譽為「最強開源戰神」的 DeepSeek 於今日(2026 年 4 月 24 日)正式宣佈旗下最新的大模型 DeepSeek V4 Preview 正式上線並全面開源。這款新一代模型不僅在參數量級上突破至 1.6 兆(1.6 Trillion),更將 100 萬(1M)超長上下文 列為全系列標配。根據 DeepSeek 官方披露,V4 系列在 Agent(智慧體)執行能力上實現了質的飛躍,其實際編程交付質量已在公司內部測試中超越了知名的 Claude 3.5 Sonnet。而且最讓黃仁勳擔心的狀況也發生了:全程使用中國華為的國產 GPU 完成 DeepSeek V4 的訓練推理。

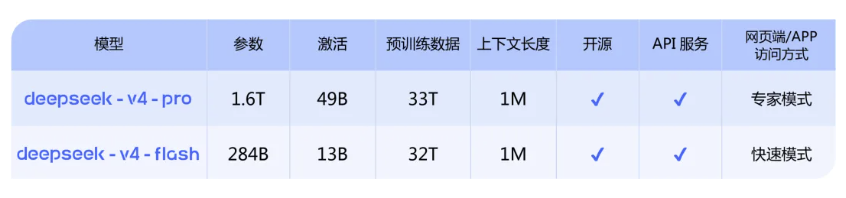

雙版本齊發:Pro 與 Flash 的定位策略

本次發佈包含兩款核心模型,均支援 native 多模態輸入(文本、圖像、影音):

- DeepSeek-V4-Pro (旗艦版)

- 總參數:1.6 兆(1.6T)

- 激活參數:每 Token 激活約 490 億(49B)

- 定位:專門為複雜的 Agent 任務、高難度程式開發與深度推理設計。其效能已達到目前開源模型的最高水準,並比肩世界級頂尖閉源模型。

- DeepSeek-V4-Flash (高速版)

- 總參數:2,840 億(284B)

- 激活參數:每 Token 激活約 130 億(13B)

- 定位:主打極速反應與經濟效益。在簡單 Agent 任務上與 Pro 版旗鼓相當,是追求吞吐量與低成本應用的首選。

Agent 能力專項優化:內部實測超越 Sonnet

DeepSeek V4 這次在 Agentic Coding (智慧體編程) 領域下足了功夫,針對 Claude Code 、OpenClaw、OpenCode、CodeBuddy 等主流的 Agent 產品進行了適配和優化,在代碼任務、文檔生成任務等方面表現均有提升。官方表示,V4-Pro 已成為 DeepSeek 內部員工日常使用的主要編程模型,能力方面多項指標也超越目前主流的幾個知名閉源模型。

- 交付質量對標:內部評測反饋顯示,V4-Pro 的使用體驗優於 Claude 3.5 Sonnet,且交付質量已非常接近 Claude Opus 4.6 的非思考模式。雖然在應對極端複雜邏輯時與 Opus 4.6 的「思考模式」仍有小幅差距,但在開源界已是無人能敵。

- 主流框架適配:新模型針對 Claude Code、OpenCode、CodeBuddy、OpenClaw 等主流 Agent 產品進行了深度優化,顯著提升了跨檔案代碼重構與文件生成的連貫性。

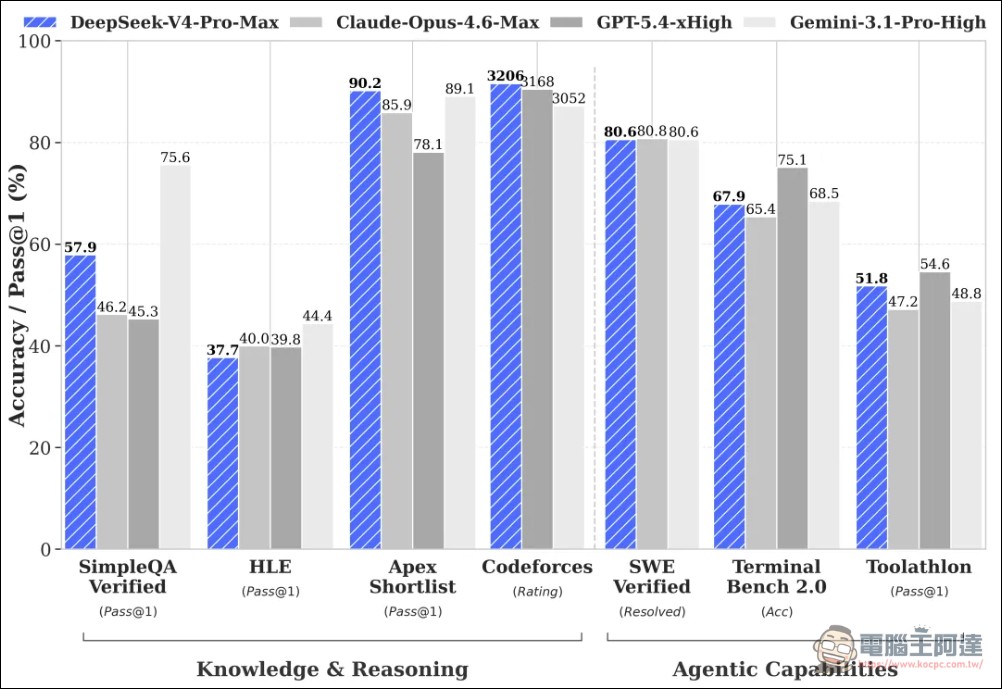

效能實測:世界知識與推理性能表現

- 世界知識:在綜合性世界知識測評中,V4-Pro 大幅領先其餘開源模型,排名僅次於頂尖閉源模型 Gemini-Pro-3.1。

- STEM 與推理:在數學、科學與競賽型代碼測試中,V4-Pro 展現了比肩世界頂尖閉源模型的成績,展現了強大的邏輯推演能力。1M 上下文普惠:DeepSeek 宣佈「1M 上下文將是未來所有官方服務的標配」。透過獨創的 Token 維度壓縮技術與 DSA 稀疏注意力機制,V4 在 100 萬 Token 的負載下,計算與顯存需求大幅降低。

架構創新:Engram 與 mHC 的技術護城河

DeepSeek V4 能夠在有限算力下驅動兆級參數,歸功於三項關鍵創新:

- Engram 條件記憶:將事實性知識與動態推理分離,讓模型在百萬字長文中「精準導航」,檢索準確率在 Needle-in-a-Haystack 測試中達到 97%。

- 流形約束超連接 (mHC):透過數學框架將梯度信號波動限制在 2 倍內,解決了兆級參數訓練時梯度爆炸的難題,讓訓練成本大幅下降至約 1,000 萬美元。

- DSA 稀疏注意力:替代傳統密集注意力,將長上下文所需的算力減少了約 50%。

API 服務升級與「思考模式」

DeepSeek API 已同步更新,並引入了靈活的調用參數:

- 支援兩種模式:V4-Pro 與 Flash 同時提供「思考模式」與「非思考模式」。

- 強度可調:使用者可透過

reasoning_effort參數設定思考強度(high/max)。官方建議在複雜 Agent 場景下開啟max模式。 - 介面退場提醒:舊有的

deepseek-chat與deepseek-reasoner接口將於 2026 年 7 月 24 日正式停止支援,建議開發者儘速切換至deepseek-v4-pro或deepseek-v4-flash。

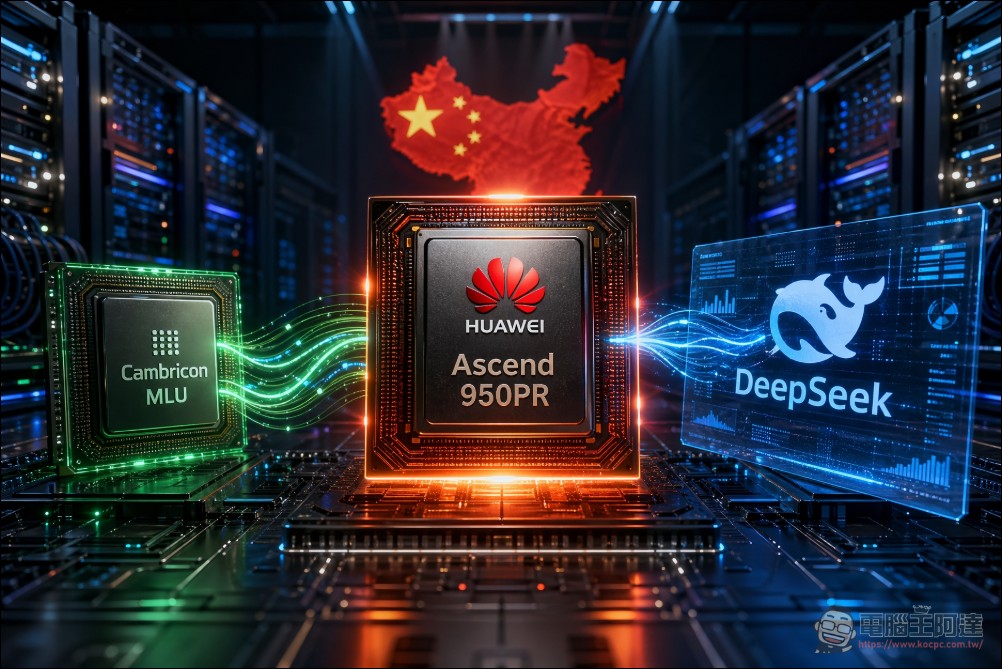

硬體與開源:轉向華為生態與 Apache 2.0

在地緣政治因素導致高端 GPU 供應受限的背景下,DeepSeek V4 展示了對 華為昇騰 950PR 與 寒武紀 MLU 晶片的深度優化。華為昇騰 950PR 在運行 V4 時,效能甚至達到英偉達 H20 的 2.87 倍。

模型權重已同步發佈於 Hugging Face 與 ModelScope,採用 Apache 2.0 協議開源。這意味著全球開發者不僅可以免費使用,還能根據自身需求進行微調與商用。

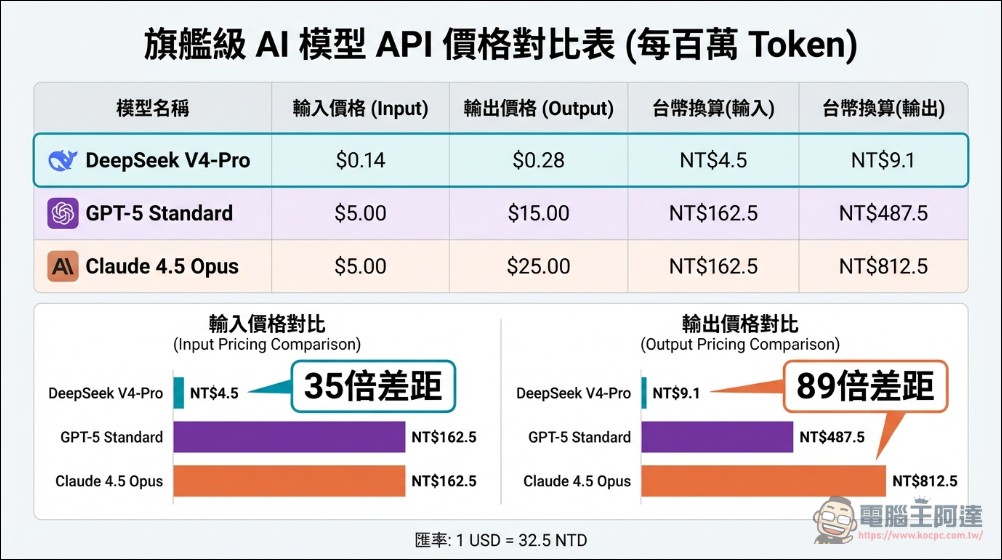

顛覆性的定價優勢

不讓人意外,DeepSeek V4 再次展現了「價格屠夫」的本色:

- 定價對比:GPT-5 或 Claude 4.5 的 API 每百萬輸入 Token 約需 NT$480 – NT$650。

- DeepSeek V4 預估定價:每百萬輸入僅需約 NT$4.5 (約 $0.14 USD),直接將前沿 AI 的使用門檻降至競爭對手的 1% 至 2%。

結語

DeepSeek 在官方文中引用了「不誘於譽,不恐於誹,率道而行,端然正己」,展現了其專注於技術創新的態度。DeepSeek V4 的發佈不只是參數量級的堆砌,更是對 AI 基礎架構、Agent 應用場景與運作成本的一次全面重構。隨著開源權重的釋出,全球 AI 格局或將迎來新一輪的劇烈震盪。