隨著全球 AI 產業重心由模型訓練轉向推理應用,傳統以「GPU 每小時租金」作為計價單位的 AI 基礎設施市場,也快速朝向以「每百萬 Token 成本」為核心的全新模式轉移。NVIDIA 在 2025 年底以約 200 億美元(約 NT$6,500 億) 的天價收購了 AI 推理晶片新創 Groq,這不僅是 NVIDIA 史上最大一筆收購案,現在看來更是一項深思熟慮的戰略布局:透過整合 Groq 的 LPU 技術,NVIDIA 在推理晶片領域進一步鞏固了其幾乎無法撼動的市場主宰地位。

定價模式革命:從 GPU 時租到 Token 計價

傳統上,AI 運算基礎設施的價格取決於 GPU 型號以及容量是預留還是隨需使用。根據雲端基礎設施提供商 Nebius 專家接受 AlphaSense 訪談提供的數據,當前 NVIDIA 各代 GPU 的隨需定價如下:

- H100:每小時 $2.95 美元(約 NT$96)

- H200:每小時 $3.50 美元(約 NT$114)

- Blackwell B200:每小時 $4.90 至 $6.50 美元(約 NT$159 至 NT$211)

若簽訂 1-2 年長期合約且保證採購至少 10,000 顆 GPU,價格則會大幅下降:H100 降至 $1.50 美元、H200 降至 $2.20 美元、B200 則降至 $3.50 美元以上。

然而,專家指出市場正快速轉向以「每百萬 Token」為單位的計價方式。這一轉變背後的根本驅動力在於:推理(Inference)如今已佔日常 AI 工作負載的 90% 至 95%。隨著各種模型越來越成熟,企業大量依賴預訓練模型或 API 服務,而非從頭開發自己的模型,大模型的推理效率取代訓練效能成為決定 AI 成本關鍵因數。

200 億美元收購 Groq 的戰略意義

2025 年 12 月,NVIDIA 以約 200 億美元收購 Groq 的晶片資產與工程團隊,震驚業界。這筆交易背後有兩層核心意義:

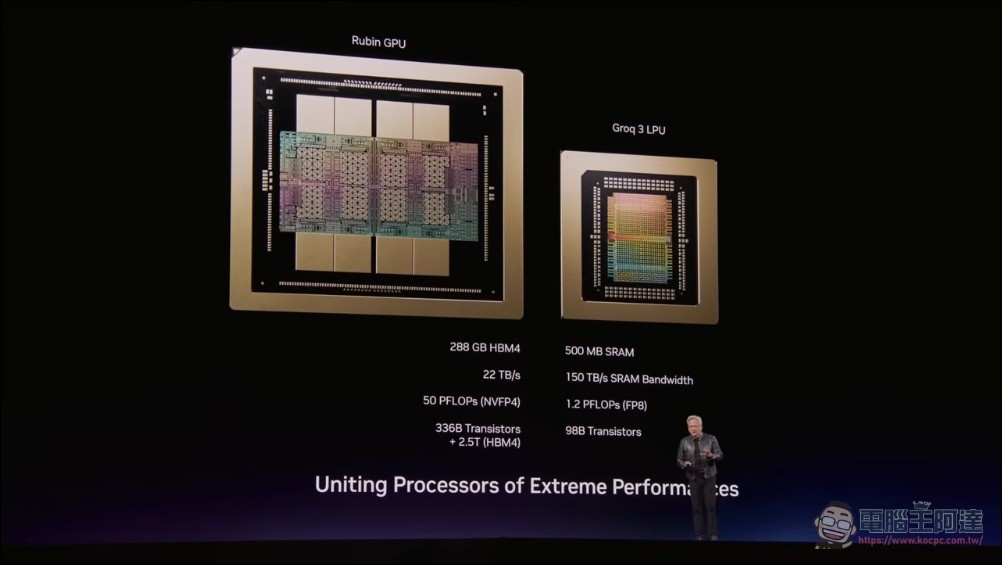

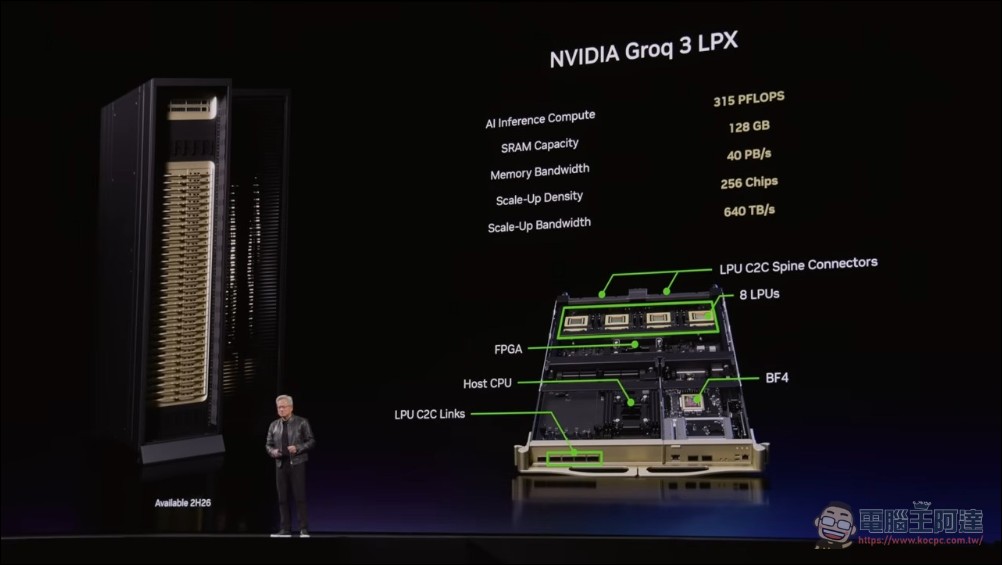

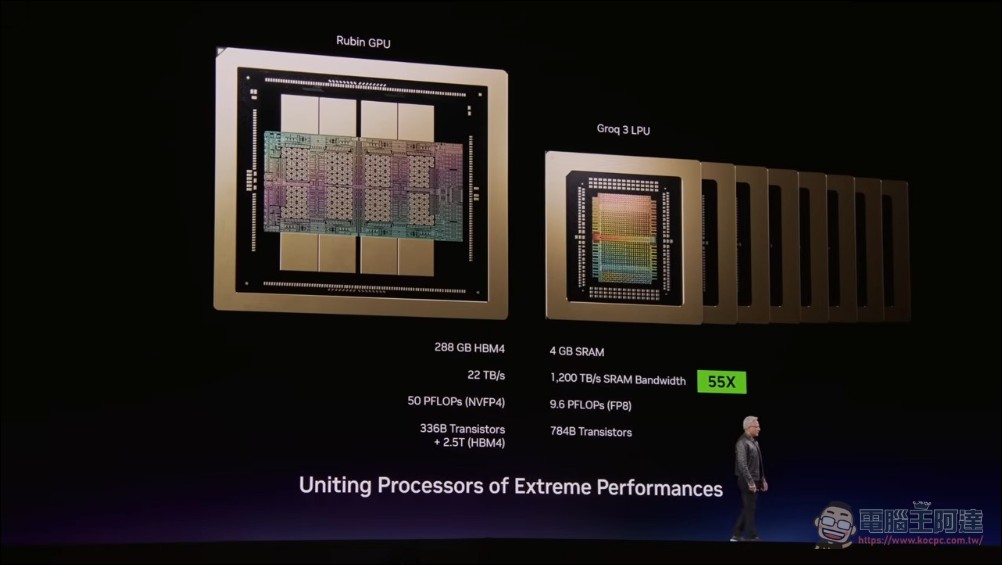

- LPU 架構的戰略補充:Groq 的 LPU(Language Processing Unit)採用獨特的「軟體定義架構」(Software-Defined Architecture),與 NVIDIA 傳統的 GPU 路線完全不同。NVIDIA 看上的是 Groq 在推理延遲方面無可匹敵的優勢。

- 雙軌推理策略:在收購後,NVIDIA 形成了「Blackwell 高吞吐量訓練 + Groq LPU 超低延遲推理」的雙軌產品線。在 2026 年 GTC 大會上,NVIDIA 副總裁 Ian Buck 坦言 LPU 的推理效率是 H100 的 5 倍以上。

NVIDIA 內部雙架構對比

| 指標 | NVIDIA Blackwell B200 | NVIDIA Groq LPU(收購後整合) |

|---|---|---|

| 每百萬 Token 成本 | $0.25 美元(約 NT$8.1) | $0.05 – $0.10 美元(約 NT$1.6 – NT$3.3) |

| Token 輸出速度 | 450 tokens/sec | 800 tokens/sec |

| 主要應用場景 | 訓練 + 企業級推理 | 高速度推理(極低延遲) |

這意味著如今 NVIDIA 同時擁有 兩種完全不同的推理晶片架構:Blackwell 負責高強度訓練與通吃型任務,Groq LPU 則專注於需要極低延遲的即時推理場景。這不是「挑戰者 vs 霸主」,而是 NVIDIA 對整個 AI 基礎設施的全面主宰。

Blackwell 的 35 倍世代躍進

與此同時,NVIDIA 自家 Blackwell 架構也展現了驚人的世代躍進。根據官方基準測試,從 Hopper 世代(H200)到 Blackwell,每百萬 Token 成本從 $4.20 美元驟降至 $0.12 美元,降幅高達 35 倍。

更具說服力的是實際吞吐量對比:在運行 DeepSeek-R1 模型時,Blackwell GB300 NVL72 配置每顆 GPU 可生成 6,000 個 Token,而 H200 僅為 90 個 Token。雖然 Blackwell 每 GPU 小時成本約為 $2.65 美元(高於 H200 的 $1.41 美元),但實際 Token 產出相差近 67 倍。

同時,Blackwell 的能效表現同樣驚人:每百萬瓦可產生 280 萬個 Token:是 Hopper 的 50 倍以上。對於擁有長期電力合約的企業資料中心而言,這項優勢遠比晶片標價更具決定性。

黃仁勳的「Token 經濟學」與「AI 工廠」

在 GTC 2026 大會上,NVIDIA 執行長黃仁勳花了相當大的篇幅推廣全新的「Token 經濟學」(Token Economics)。他主張資料中心已經變成了「AI Token 工廠」,衡量標準不該再是 FLOPS 或 GPU 小時,而應該是「每 Token 的生產成本」。

黃仁勳更進一步描繪了一個大膽的未來藍圖:「未來,每個工程師除了薪水,還會有一份 Token 預算。我會再拿出薪資一半的金額給他們使用,讓他們靠 AI 實現 10 倍的產出。」

他強調 NVIDIA 的「推理冰山」框架:包含 FP4 精度支援、推測解碼(Speculative Decoding)、KV-Cache 卸載、以及剛進入量產階段的 Dynamo 服務層,才是決定實際 Token 產出的真正關鍵。缺乏這些軟體層優化的晶片,無論峰值規格多高,實際能產出的 Token 都將大打折扣。

Rubin 平台:下一個里程碑

NVIDIA 的佈局並不止於 Blackwell。預計於 2026 年底推出的下一代 Rubin 平台,根據分析,號稱能將 Token 成本在 Blackwell 的基礎上再降低 90%。這顯示 NVIDIA 正以多代架構同時發展的方式,持續拉大與競爭對手的差距。

企業的選擇:建置 vs 租用 vs 擁抱 AI Factory

對於企業來說,好消息是主流雲端合作夥伴:包括 CoreWeave、Nebius、Nscale 與 Together AI都已大規模部署 Blackwell 基礎設施。企業無需鉅額資本投入,即可享受到每百萬 Token 低於 1 美元的先進推理經濟效益。Gartner 更預測,到 2030 年 AI Token 成本將再暴跌 90% 以上,而 NVIDIA 的數據顯示這一降價趨勢已經在加速發生。

結語:NVIDIA 的完全勝利

從 GPU 時租到 Token 計價,從 H100 到 Blackwell 再到 Rubin,從 GPU 到 LPU 雙架構布局:NVIDIA 正在打造一個覆蓋訓練、推理、延遲敏感場景的全方位 AI 基礎設施帝國。200 億美元收購 Groq 僅是這盤大棋中的一步。

未來,「每百萬 Token 的成本是多少」將取代「用哪顆 GPU」成為企業決策的首要問題。而在這個新時代,NVIDIA 已經同時掌握了所有答案。