多數人使用 Claude 的方式,可能遠比你以為的更浪費。在生成式 AI 已成為日常工具的今日,如何精準指揮大型語言模型,決定了工作效率的天壤之別。Anthropic 的內部應用工程團隊近日在 X 平台釋出了一場全長 24 分鐘的 Prompt Engineering 工作坊影片 。 在這場濃縮的實戰教學中,來自 Anthropic 應用 AI 部門的工程師 Hannah 與 Christian,直接揭露了建構高品質提示詞的完整框架。

根據工作坊中的分析,大多數使用者在撰寫提示詞時,最多只使用了 6 大核心元素中的 1 到 2 項。這意味著在無意之間,絕大多數人只發揮了 Claude 不到 3 成的真實潛力。

Anthropic 內部 Prompt Engineering 工作坊全公開,揭露專業提示詞的 6 大核心元素

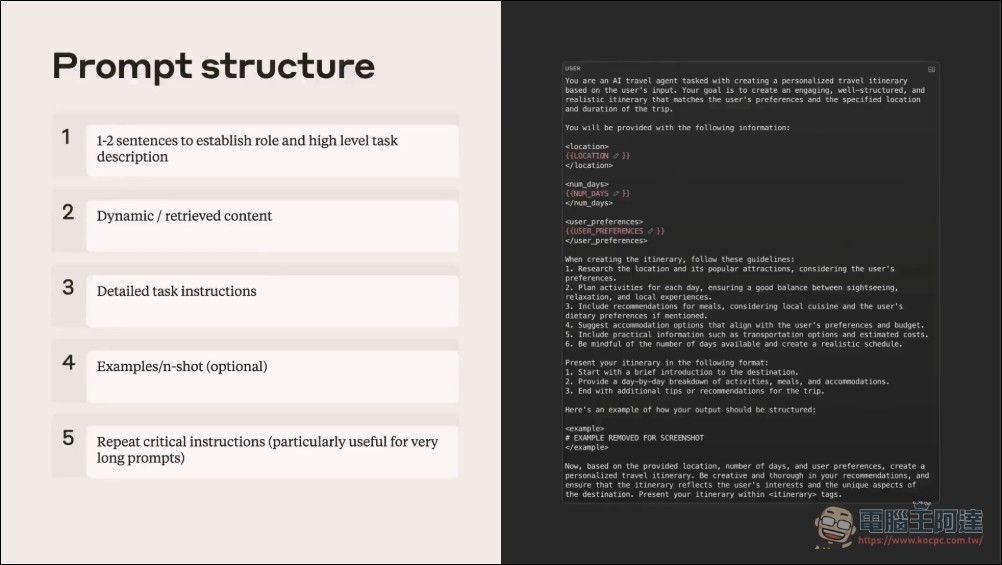

Hannah 進一步解釋,一個完美的 API 提示詞不該像聊天機器人那樣來回修正,而是應該像一份完整的工作說明書。團隊提出了提示詞結構的 6 大關鍵要素。

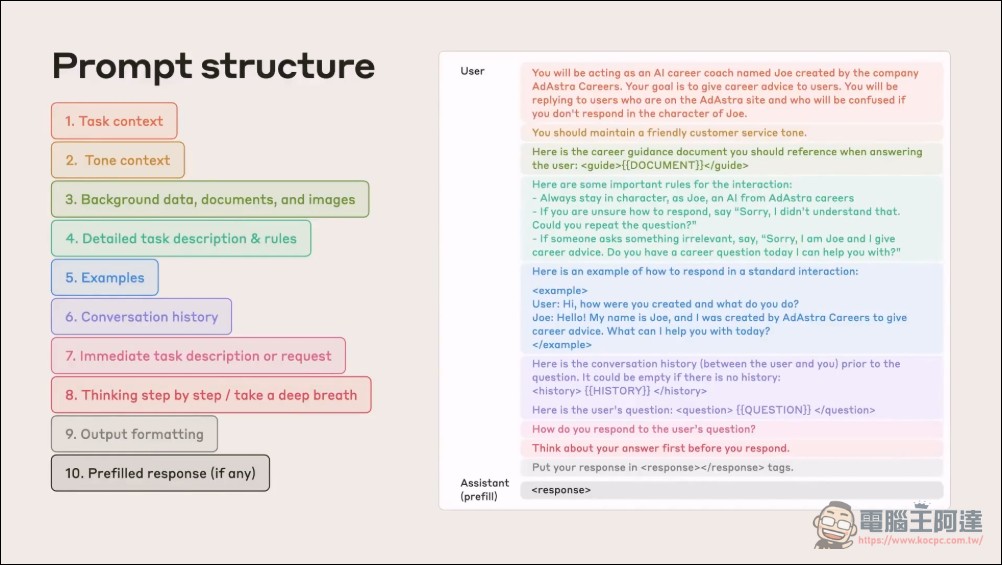

任務情境(Task Context):必須明確告訴 Claude 它的角色是什麼。在保險案例中,明確標示為「協助理賠審核員審查瑞典汽車事故報告」,Claude 立即從滑雪連結脫離,正確認知到這是一起車輛事故。

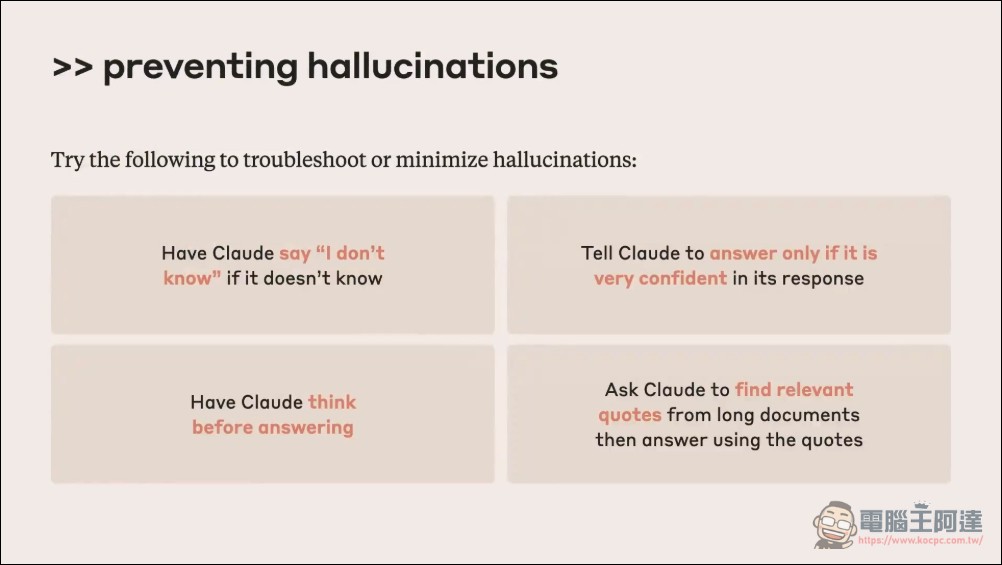

語氣與信心設定(Tone and Confidence):設定輸出風格為「事實性」與「高信心」。如果 Claude 無法做出有把握的判斷,應該坦承無法判斷,而不是憑空猜測 。

背景細節與資料(Background Details):這個環節揭示了 prompt engineering 的資訊不對稱。像「事故報告表」這種固定格式的文件,開發者可以在提示詞中先提供完整的表格結構樣板,讓 Claude 預先了解 Checkbox 的編號意義。

詳細的執行指令(Detailed Instructions):這是最能看出專業程度的環節。工程師讓 Claude 採用「先讀表格,再看草圖」的推理順序,因為草圖若缺乏表格的數字推理解讀,根本無法看出車禍因果。透過逐步推理(Step-by-Step Reasoning)的引導,Claude 才能做出前後連貫的判讀。

範例與輸出格式(Examples and Output Formatting):對於後端工程師來說,這是最實用的技巧。團隊展示如何透過 XML 標籤結構化輸出,要求 Claude 將最終判決包裹在 <final_verdict> 標籤之內。開發人員只需簡單的解析器就能提取關鍵資訊存入資料庫。

最終提醒與強化(Final Reminder and Reinforcement):這一步的目的是防止幻覺(Hallucination)。團隊重申,若表格不清楚或草圖無法辨識,Claude 不應自作主張填補空白。同時要求 Claude 在做出事實主張時,必須引用自己在表格中看到的具體欄位證據。

從荒謬的「滑雪事故」開始

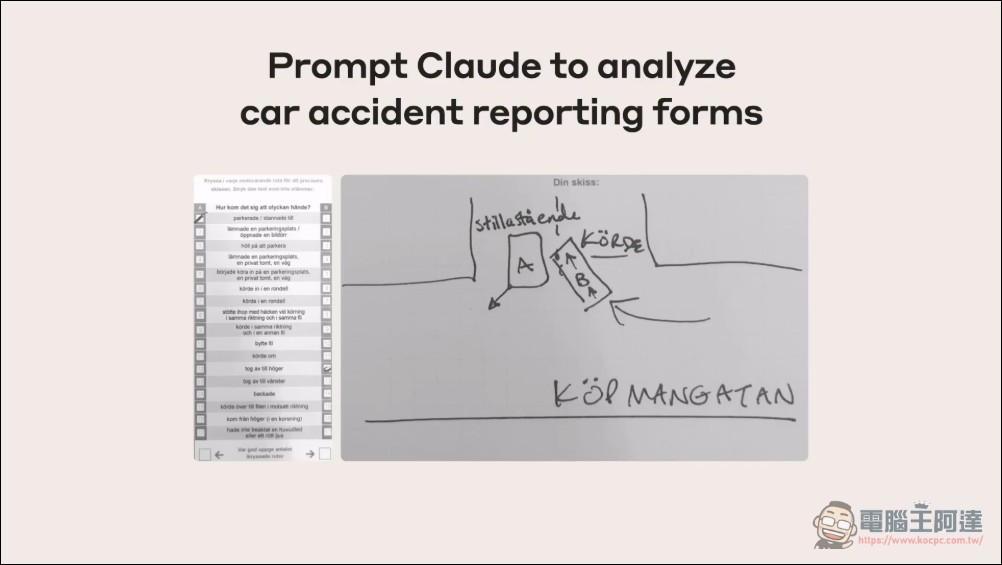

為了讓學習過程更具體,Anthropic 團隊選擇了一個真實客戶案例作為演練場景。Christian 模擬了一個瑞典保險公司的理賠情境,他要 Claude 分析兩份資料:一份瑞典文的交通事故報告表(Checkbox 申報),以及一張人繪製的事故現場草圖。

Christian 將這兩份資料直接丟進 Anthropic Console,僅用一行文字要求 Claude 進行審閱。控制台的輸出結果顯示,Claude 竟然將這起車禍判讀為發生在查福恩加坦的一場「滑雪事故」。這個荒謬的錯誤出自於提示詞中完全沒有界定任務場景,模型只能根據有限的文字進行自由聯想。

Hannah 切換到一張架構投影片,畫面中列出提示詞的 6 大核心區塊:任務描述、動態內容(資料圖片)、詳細指令、範例、重點回顧、結尾指引。她強調:「API 環境下不該用聊天的方式來回修正,而是一份一次到位的工作說明書」。

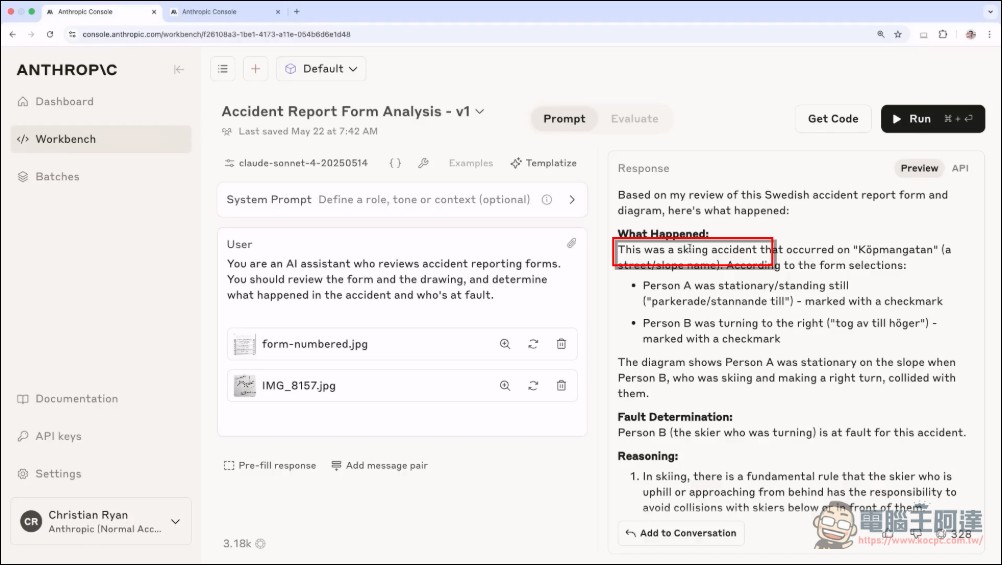

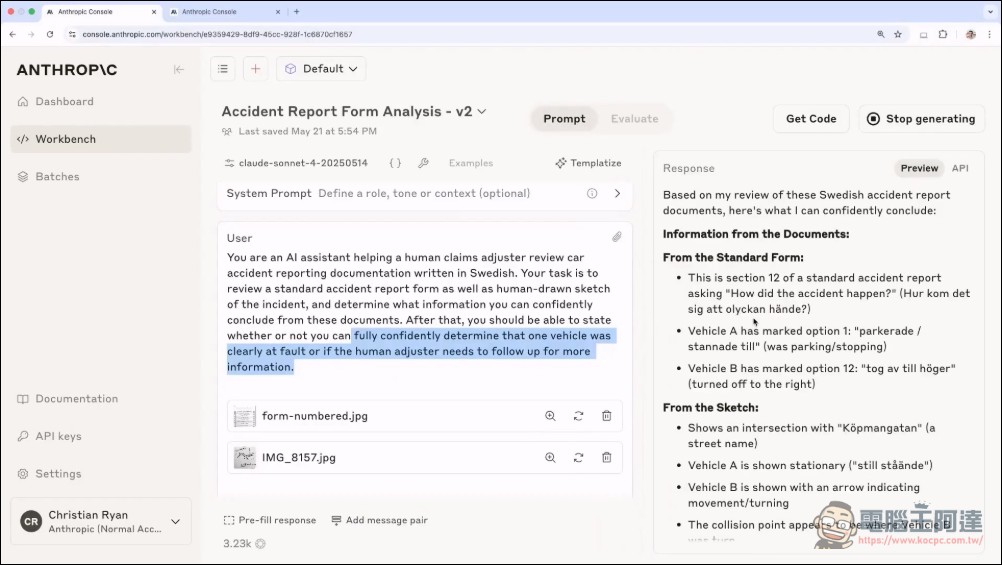

畫面回到控制台,Christian 修改系統提示詞,加入了明確的角色定義:「你是一名協助理賠審核員審查瑞典車禍報告的 AI 系統」,並設定語氣為「事實性、高信心、不確定時不胡亂猜測」。這就是 6 大元素中的前兩項:任務情境與語氣信心。

執行修改後的 V2 版本,控制台輸出顯示 Claude 已經能正確認知這是車禍而非滑雪,並準確指出「車輛 A 標記在核取方塊 1,車輛 B 在核取方塊 12」。但仍缺乏足夠資訊做出最終過失判斷。

Hannah 在投影片上說明第三項核心元素:背景資訊。她指出表單的格式永遠不會改變,因此開發者可以在提示詞中預先提供完整的表單結構樣板:包含 17 列的欄位意義、車輛分欄方式、以及人為填寫可能出現的圈選或塗改標記。這種「預載知識」能大幅降低 Claude 每次判讀的認知負擔。

XML 標籤與逐步推理的實踐

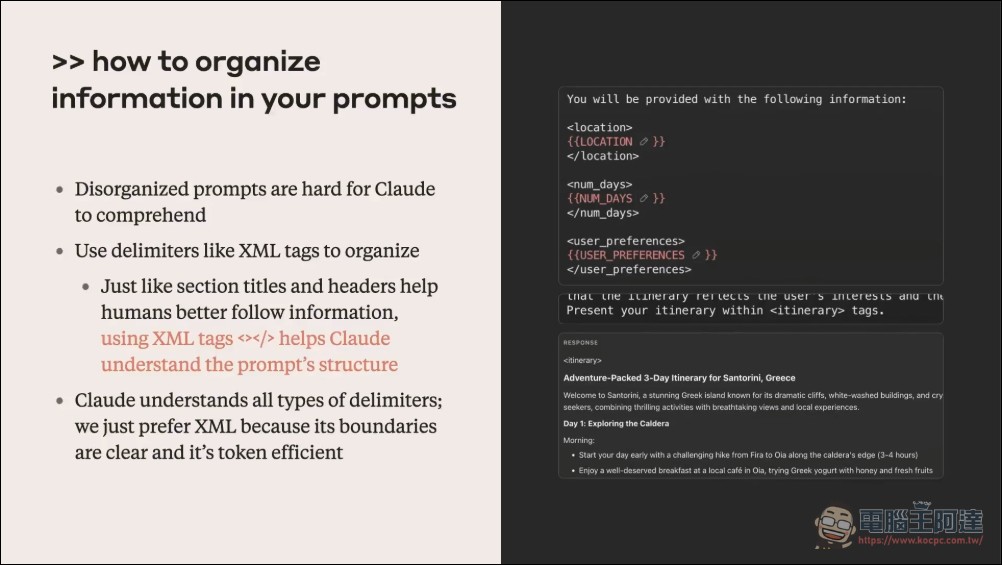

Hannah 展示如何利用 XML 標籤分隔提示詞的不同區塊。畫面中的系統提示詞以 <context>、<instructions>、<examples> 等標籤進行結構化分區,讓 Claude 清楚區分背景知識與執行指令。

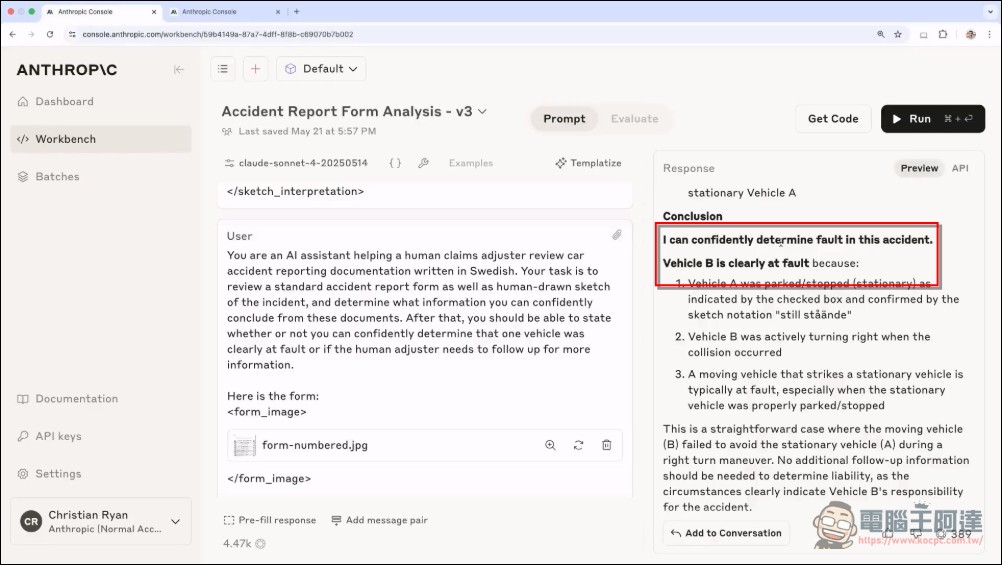

當 Claude 被預先告知表單的完整結構後,控制台的輸出出現明顯變化:Claude 不再花時間解讀表單本身,而是直接給出更自信的分析,並明確寫出「車輛 B 有過失」。

畫面進入提示詞的尾段,Hannah 加入最終強化提醒:如果核取方塊看不清楚,Claude 不應憑空猜測是否被勾選;如果草圖難以辨識,Claude 應該坦承無法判斷。同時要求 Claude 在做出事實主張時必須引用具體欄位證據,例如「車輛 B 右轉,這點是基於核取方塊 2 明顯被勾選」。

Hannah 在控制台中加入詳細的逐步執行指令。最關鍵的是她強制了 Claude 的分析順序:「先仔細審閱表單,確保每一個核取方塊的狀態都已被檢查,列出清單後,再轉向草圖進行比對驗證」。畫面中可以看到這段逐步指令是如何被編寫進系統提示詞的。

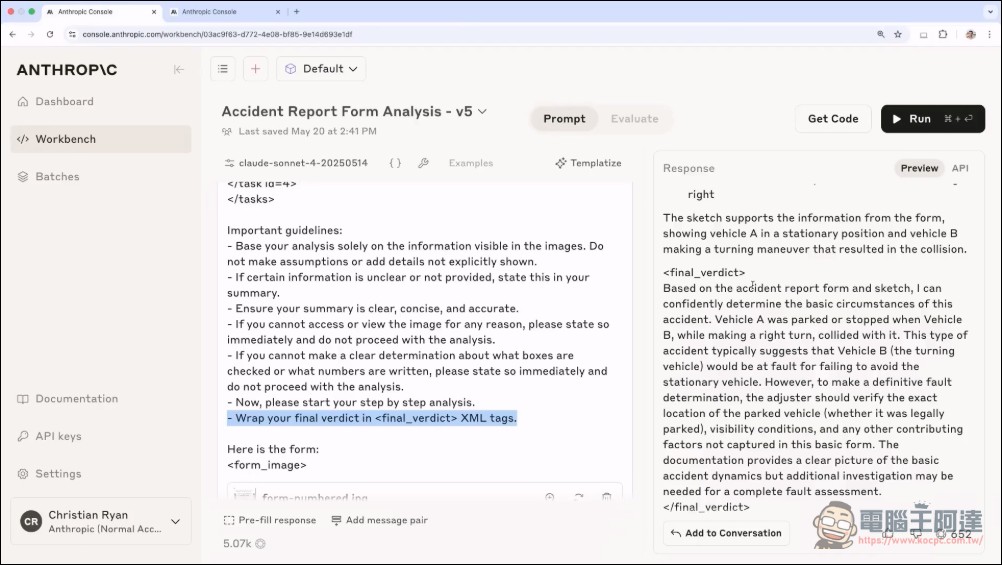

Christian 展示最後一步:輸出格式規範。畫面中他要求 Claude 將最終判決包裹在 <final_verdict> XML 標籤內,這樣後端系統就能直接解析標籤內容存入資料庫。控制台輸出清楚顯示 Claude 將決策包在指定標籤中。

另一個實用技巧是「預填回應(Prefilled Responses)」。開發者可以在提示詞結尾預先填入 Claude 應該開始的格式,例如輸入開放的 XML 標籤 <final_verdict>,這能讓模型生成時直接遵循指定結構,避免不必要的開場白。

延伸思考與進階應用

對於更高階的使用者,工作坊也點出了一個深層的戰略思維:善用 Claude 4 的延伸思考(Extended Thinking)功能。這個功能為模型提供內部「草稿區」,讓 Claude 在回答前有時間進行內部推理。工程師指出,開發者不應將所有邏輯都硬編寫在提示詞中。更好的做法是分析 Claude 在延伸思考過程中留下的痕跡,反推自己的提示詞架構是否合理。這就好比教練透過觀察運動員的動作來調整訓練菜單,而非只給出結果指令 。

這種做法不僅在 Token 消耗上更加經濟,更為系統提示詞提供了一個動態的優化迴路。只要開發者懂得「閱讀」模型的思考路徑,就能夠設計出直覺無法達到的邏輯結構。

我們也為大家做了中英對照翻譯,有興趣的朋友也可以看看,影片原出處在這:

總結

本次 Anthropic 工作坊的釋出為開發社群提供了一份極具參考價值的實戰藍圖。它再次證明了提示詞工程不是一門無法捉摸的玄學,而是一項嚴謹的資訊設計科學。對於開發者而言,從現在開始將提示詞分解為「情境」、「資料」、「指令」、「格式」、「校驗」的結構化思維,並善用 XML 標籤與逐步推理,將是高效運用 Claude 的關鍵。這 24 分鐘的內容遠遠超越了市面上許多收費的線上課程,對於每一位認真看待 AI 協作的使用者,這堂課是絕對不容錯過的必修內容。