Google 於 5 月 5 日宣布為其開放原始碼模型 Gemma 4 推出 Multi-Token Prediction(MTP)Drafters (多權杖預測投機模型)技術,這項技術可利用「投機解碼」(Speculative Decoding)機制,讓 Gemma 4 在本地端執行推理時速度最高提升 3 倍,且完全不影響輸出品質。

什麼是 MTP 與投機解碼?

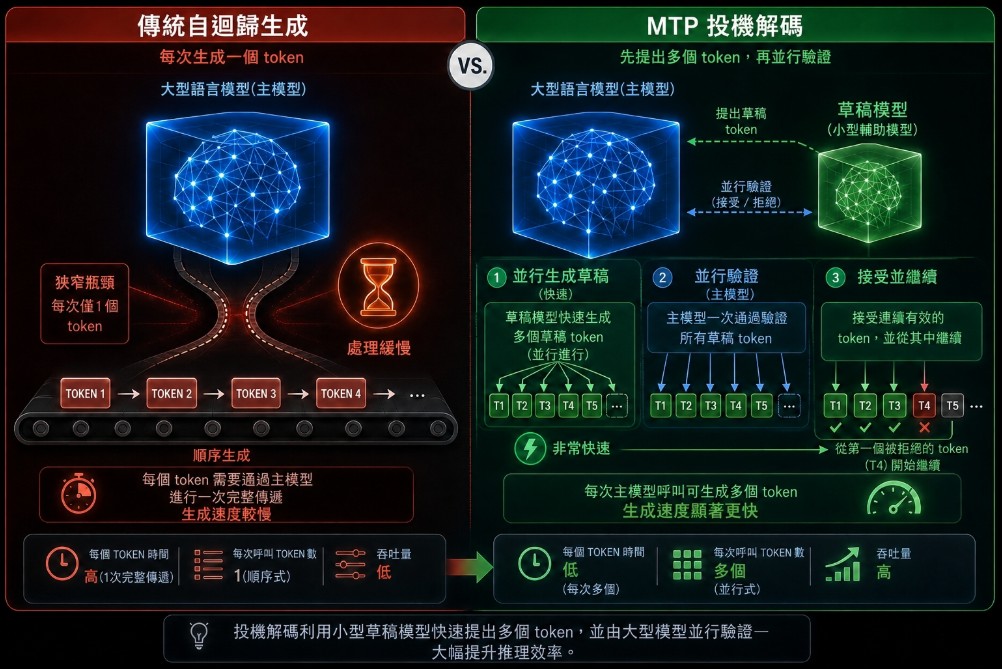

傳統大型語言模型(LLM)的推理方式稱為「自迴歸生成」(Autoregressive Generation),也就是一次只產生一個 token(文字片段),而且每個 token 都需要把數十億個參數從 VRAM 搬到運算單元,導致運算單元大部分時間處於閒置等待狀態。這就是本地端 AI 反應緩慢的根本原因,並非模型不夠聰明,而是記憶體頻寬成了瓶頸。

MTP 的核心概念是「投機解碼」,這項技術最初由 Google 研究人員在 2022 年發表的論文《Fast Inference from Transformers via Speculative Decoding》中提出。做法是為主模型搭配一個極輕量的「草稿模型」(Drafter),由 Drafter 快速預測多個可能的 token 序列,再由主模型一次性平行驗證這些預測。

如果主模型同意草稿的預測,就整段接受並在單次前向傳遞中完成,同時還會多生成一個自己的 token。這意味著應用程式可以在原本只能產生一個 token 的時間內,輸出整個草稿序列外加一個新 token。

Google 官方說明,Drafter 模型會直接使用主模型的 KV 快取(Key-Value Cache),因此不需要重新計算主模型已經處理過的上下文資訊,大幅降低了額外開銷。

實際效能提升有多少?

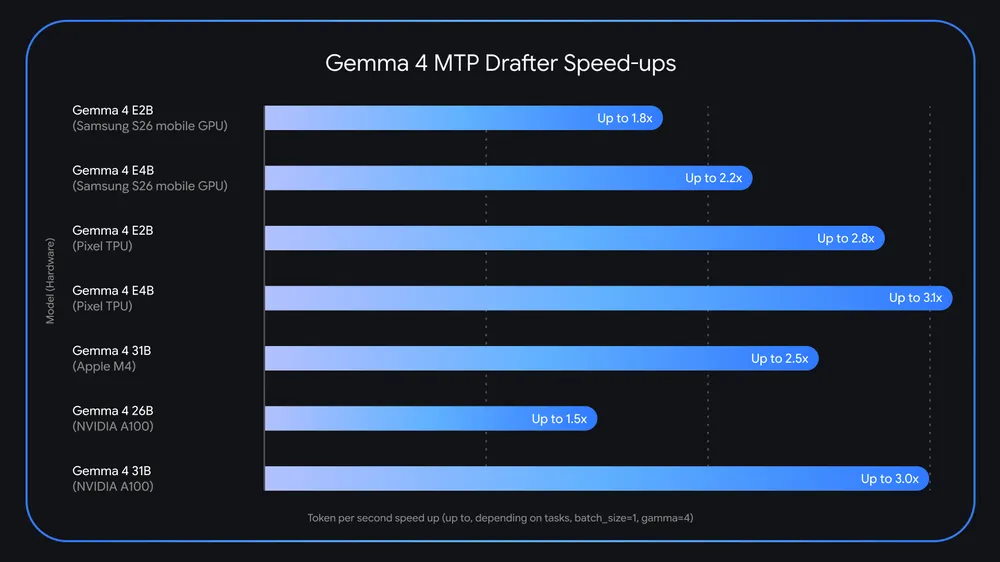

根據 Google 公布的測試數據,在不同硬體上 MTP 帶來的加速效果如下:

在 Pixel 手機上,輕量級的 E2B 模型可加速 2.8 倍,E4B 模型更達到 3.1 倍。在 Apple M4 晶片上的 Gemma 4 31B 模型可獲得 2.5 倍加速。在中高階的 NVIDIA RTX PRO 6000 顯示卡上,26B MoE 模型搭配 MTP 後輸出速度約為原來的兩倍。

需注意的是,3 倍是理論上限,實際加速幅度仍取決於硬體規格與使用情境。例如在 Apple Silicon 上,批次處理 4 至 8 個請求時可達到約 2.2 倍加速。Google 也正在針對不同硬體架構進行最佳化,包括 Apple Silicon 與 NVIDIA A100。

對開發者與使用者的意義

對於開發者來說,推理速度往往是將 AI 模型部署到正式環境的最大瓶頸。MTP 的推出讓以下場景有了實用性提升:

即時對話應用:過去本地端 AI 對話總有明顯延遲,現在能在接近即時的狀態下運作。

程式碼助手:開發過程中逐行推理的等待時間大幅縮短,讓離線程式碼輔助變得真正可用。

語音互動:語音介面對於延遲極度敏感,MTP 能讓本地端語音助理的反應速度提升到實用水準。

代理型任務(Agentic Workflows):需要多步驟規劃的 AI 代理,每一步之間的等待時間將顯著減少。

此外,由於主模型仍然負責最終驗證,MTP 不會對輸出品質造成任何影響,也就是 Google 所說的「零品質損失」(Zero Quality Degradation)。模型的正確性與推理能力完全由主模型把關,Drafter 只負責加速。

如何取得與使用

MTP Drafters 與 Gemma 4 同樣採用 Apache 2.0 授權,即日起可從 Hugging Face、Kaggle、Google AI Edge Gallery 等平台下載模型權重。支援的框架包括 Hugging Face Transformers、MLX(Apple Silicon)、vLLM、SGLang 以及 Ollama。

對一般使用者來說,最簡單的嘗試方式是透過 Ollama 執行:ollama run gemma4:31b-coding-mtp-bf16。Android 與 iOS 使用者則可透過 Google AI Edge Gallery 應用程式體驗。