現在「API 中轉站」這類服務在個大社群平台上廣告都打很大,從淘寶、閒魚上販賣的低價 Token,到 X 上「孫割」孫宇晨高調宣傳的 B.AI,再到各式打著「比官方便宜 30%」「一個 Key 打通所有模型」口號的平台,API 中轉站已成為 AI 經濟中最火熱也最具爭議的賽道。有投資人向媒體透露,某頭部中轉項目月流水可達新台幣 2,250 萬元(500 萬人民幣),毛利率接近 50%,聲稱比販毒還好賺。這些錢到底是怎麼賺的?以下從五個技術層面拆解中轉站的獲利手法。

Prompt Caching(提示快取): 最核心的合法優化

這是最重要也最被低估的套利手段。OpenAI、Anthropic 等官方 API 均支援 Prompt Caching:當請求中的系統提示詞(System Prompt)或固定上下文內容重複出現時,官方只收取一半甚至更少的費用(約 50–90% off)。這個機制本意是讓開發者降低重複運算成本,但中轉站將其變成利潤來源。

中轉站的角色就像一個流量集中器。當大量用戶發送相似的請求,尤其是 Agent 場景下幾乎一致的 System Prompt,中轉站可以在後端享受極高的快取命中率,但前端依然按全價扣費。中間的價差就是純利潤。

簡單算一筆帳:以一個法律事務所假設每天處理約 1,500 萬輸入 + 600 萬輸出 Token 的法律合約審查產品,純標準調用一年約 8.1 萬美元(約新台幣 243 萬元)。開啟 Prompt Caching 搭配 Batch 處理後,一年可壓到 2.2 至 3.2 萬美元(約新台幣 66 至 96 萬元)。

也就是說,光靠合法的技術優化,就有 60% 以上的成本縮減空間,而這些空間,就是中轉站利潤的核心來源。

Batch 批次處理:用時間換取五折空間

官方 API 提供 Batch 模式,允許非同步批次提交大量請求,價格為即時 API 的 5 折,但需等待 24 小時內回傳結果。這個機制原本是為不要求即時回應的離峰任務設計的。

中轉站的玩法是:將使用者的即時請求集中排程,以 Batch 模式一次送交官方處理,拿到 5 折價格後,再以即時 API 定價的 7–8 折回饋給用戶(視平台而定),中間的差額就是利潤。用戶拿到了比官方便宜的價格,中轉站賺到了 20–30% 的利差,但用戶並不知道自己正在用 Batch 的延遲換取折扣。

這在非 Agent 場景(如批次內容生成、資料分析)尤其常見,因為使用者對回傳速度的敏感度較低。

號池複用(Multi-Account Pooling):最常見的灰色手段

這是目前市場上最主流也最具爭議的手法。中轉站建立大量官方 API 帳號:來源包括企業免費額度、多張信用卡註冊、低價區帳號(土耳其、印度等定價較低區域),形成一個「號池」。當一個帳號額度用完或觸發 Rate Limit,系統自動切換到另一個帳號。

這種方式可以有效繞過官方限流,但也存在被官方封號的風險。DoNews 的分析將此歸類為中轉站的第二檔主流形態:透過海外企業免費項目、多帳號復用分發,以官方價 2 至 5 折轉售。 一個 200 美元月租的 Claude Code Max 企業帳號,可以拆成十幾個子 Key 分發給不同用戶,每個用戶收費數百美元,總收益可達 2,000 到 5,000 美元。

但這種模式通常違反模型供應商的服務條款。Anthropic 的商業條款中明確限制未經核准轉售服務,並禁止逆向或複製服務等行為,帳號隨時可能被封鎖,服務中斷風險極高。

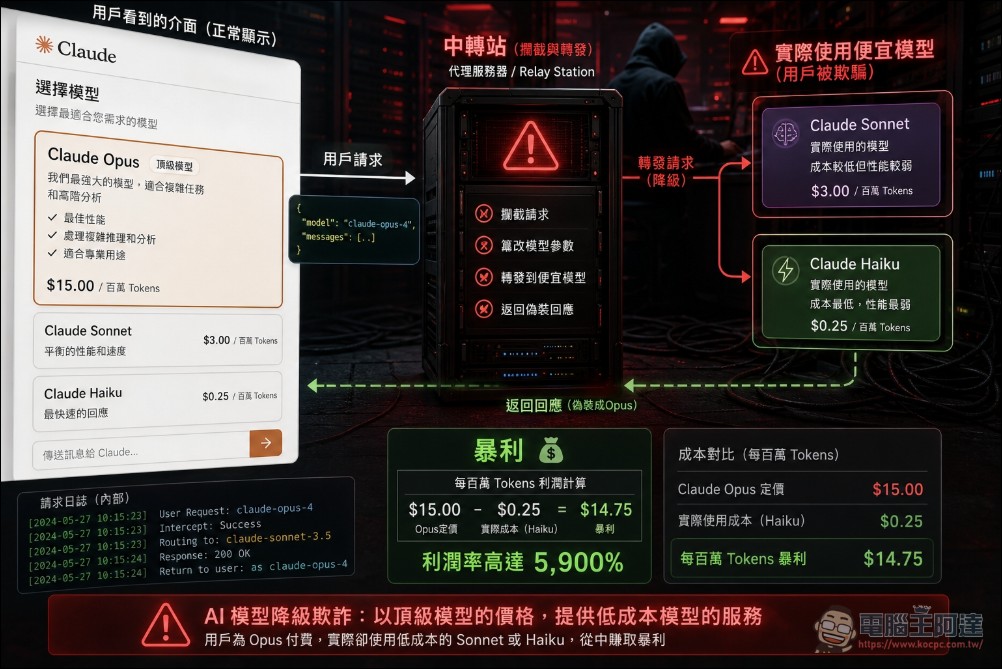

模型降級(Model Downgrade): 最惡劣的欺詐

這是第三檔、也是最無底線的手法。用戶以為自己在調用 Claude Opus(Anthropic 最貴的模型),中轉站實際上將請求導向更便宜的 Sonnet 或 Haiku,甚至使用其他廠商模型冒充。由於 LLM 的回覆本身就有隨機性:同一題不同時間回答品質可能不同,用戶肉眼難以察覺差異,中轉站則賺取暴利。

這也是不少中轉站「跑路」前的最後手段。一開始用真模型建立口碑,累積大量預付費用戶後,逐步將流量導向較便宜的模型,降低營運成本,等到使用者開始抱怨「模型變笨了」,平台早已收割完畢消失。

除非服務商提供透明的上游請求記錄、模型 ID 驗證、Token 使用明細與帳務對帳,否則一般用戶很難確認自己真的拿到高階模型。

輸出壓縮與 Token 計算誤差 : 看不見的吸血

這是最隱蔽的獲利手段。中轉站利用 Token 計費方式的灰色地帶,透過調整計費倍率來隱性獲利。標稱 1 美元兌 100 萬 Token,實際扣費可能高達 5 美元。

具體操作有幾種形式:一是在 API 回覆中插入隱藏字元以增加 Token 計數,二是中文字元在部分 Tokenizer 中的計數方式與英文不同,利用這個落差多扣費用,三是直接修改計費倍率設定(背後使用 One API、New API 這類開源閘道系統時,後台本來就具備倍率設定功能)。用戶看到的是「用了多少 Token」,但看不到「每個 Token 實際上被收了多少錢」。

資訊不對稱才是暴利的真正來源

以上五種手法,每一種的共通點都是:中轉站位於用戶與官方之間,掌握了用戶看不到的資訊。

中轉站不是單純幫你「轉送封包」而已,它可以看到完整的明文請求與回應內容。你傳給模型的 Prompt、專案原始碼、資料庫 Schema、客戶資料、商業計畫,理論上都會經過中轉站伺服器。2026 年 4 月一篇名為《Your Agent Is Mine》的研究,就把 LLM API Router 視為供應鏈攻擊面來分析,發現部分 Router 會注入惡意程式碼,甚至有研究人員放置的以太坊私鑰被提領的案例。

這個風險在 AI Agent 時代被進一步放大。當 Cursor、Claude Code、OpenCode 這類工具具備執行本機命令、修改檔案、操作瀏覽器的能力時,中轉站不只看到請求,還能修改模型回覆,風險從「資料被看見」升級成「回傳內容被動手腳」。

使用者該怎麼選?

API 中轉站本身不是原罪。企業內部用來管理多供應商 API、做成本統計與模型路由,這是合理的架構設計。透過 Prompt Caching 和 Batch 確實能大幅降低成本,但問題是這些優化的紅利是否合理地回饋給了終端用戶。如果一個服務商清楚告訴你它使用哪些優化手段、如何計價、是否保存資料、是否做模型路由,並提供企業合約與稽核機制,那它比較接近正規的 AI Gateway。但如果一個平台只標榜低價、來源不明、沒有服務條款與資安說明,那便宜的 Token 背後,可能藏著你看不見的成本。建議如果真的要選的話還是找信譽好、大品牌的中轉站,如 OpenRouter 之類的相對會比較有保證,而且還有些免費模型可用。