在本週舉行的 WWDC 2025 大會上,大家是否注意到蘋果對於自家語音助理 Siri 幾乎沒有任何著墨?根據《彭博社》知名記者 Mark Gurman 最新爆料指出,蘋果其實早已準備讓 Siri 進化為結合大型語言模型的智慧助理,但這項計畫卻屢遭延期,最新目標可能要等到 2026 年 3 月隨 iOS 26.4 版本才會看到新 Siri 上線。

深度整合語境,新版 Siri 將變身數位副駕

根據相關報導,新版 Siri 將擺脫過往單一問題回答與被動語音命令的框架,進化為具備上下文理解與多步驟執行能力的 AI 助理。其背後的核心驅動技術,正是蘋果自研的大型語言模型「Siri LLM」。這意味著,Siri 將不再只是「聽懂」一個指令後執行對應任務,而是能夠理解你當下正在使用的 App、螢幕顯示的內容,並根據這些資訊主動提供建議或自動完成任務。舉例來說,當使用者正在 Safari 上閱讀一篇文章時,Siri 有可能主動提示是否要加入閱讀清單、轉為語音朗讀,甚至預測使用者下一步可能要查詢的相關資訊。蘋果內部將這個全新定位稱為「數位副駕」(Digital Co-Pilot):不只是語音助手,更是一位全方位的智慧陪伴者。

新版 Siri 最快要等到 2026 年春季才有可能上線

蘋果原訂於 2024 年秋季推出新版 Siri,但內部測試表現未達標,導致時程不斷延後。首先延期至 2025 年初,之後又順延至同年 5 月,最終目前確定目標是 2026 年春季的 iOS 26.4 更新。這一連串的延遲並非偶然。報導指出,蘋果在技術上遭遇嚴峻瓶頸,其核心問題來自於「混合式架構」的整合失敗:也就是嘗試將舊有 Siri 系統與全新語言模型接合。據悉,測試結果顯示錯誤率高達三分之一,無法達成蘋果一貫對使用體驗與品質的高標準。(這也許也是蘋果最近的論文說 LLM 沒在思考,錯誤百出的原因之一)

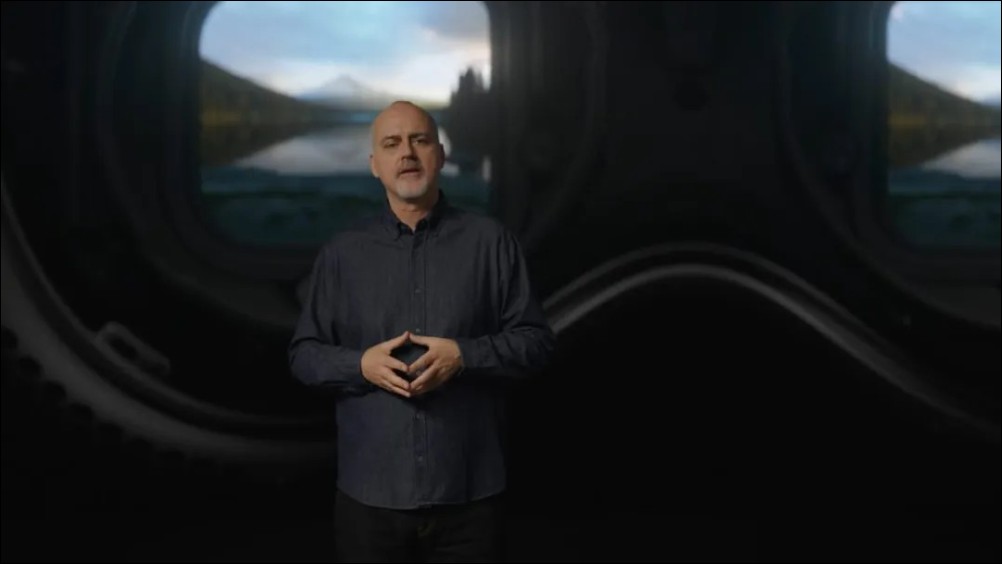

這些技術問題讓蘋果內部不得不重新審視整個專案方向。甚至連蘋果軟體工程部門負責人 Craig Federighi 在 WWDC 期間都罕見地公開承認:「我們還需要更多時間,才能達到我們對品質的要求。」

技術舊包裝難容新內容:混合式架構的掙扎

此次技術困境的一大主因在於 Siri 本身是建構於十餘年前的語音識別與語意分析架構上。這些基礎原先僅設計來處理單一問句與有限語境,與現代生成式 AI 所需的龐大參數模型與上下文管理系統格格不入。蘋果原先嘗試將新的語言模型「外掛」至原有系統,希望能保留使用者熟悉的操作邏輯並平滑過渡,但結果顯示無論是穩定性還是理解準確度都無法符合預期。

領導層更動:AI 部門權力重洗牌

除了技術面挑戰之外,人事變動也是這次 Siri 改革遲滯的另一大原因。據報導指出,原先主導 Siri 與 AI 發展的 John Giannandrea(前 Google AI 高層),已逐步被邊緣化,近年轉向處理偏向資料與平台層的任務,與面向消費者的 Siri 產品漸行漸遠。取而代之的,是 Craig Federighi 與 Vision Pro 的負責人 Mike Rockwell。兩人目前正在領導團隊從零重建 Siri 所依賴的核心 AI 模型與推論系統。這樣的領導重整被視為蘋果對 AI 長期戰略重新聚焦的象徵:不僅要推出功能,更要掌握技術主導權。

Siri 將搭配「Knowledge」App 建立開放式 AI 生態

除了升級 Siri 本身的能力外,蘋果也正積極開發一款代號為「Knowledge」的獨立 chatbot 應用,預計將整合 Siri 模型、延伸語意搜尋、連接公開網路資訊,打造出一種介於 Siri 和 ChatGPT 之間的新型智慧查詢工具。

這款 App 將補足 Siri 難以處理的開放式問答需求,讓使用者能更自然地提出問題,甚至進行連續式對話,而非僅限於裝置內部任務管理。未來 Siri 很可能與「Knowledge」緊密整合,共同建構出一個蘋果式的 AI 生態圈:封閉、安全、但同時具有高度智慧化與個人化潛力。