Google 於今(9)日凌晨的「The Android Show | XR Edition: AI Glasses」線上發表會中公布了最新的 AI 眼鏡發展,這款智慧眼鏡搭載了 Gemini AI 助理,旨在將人們每天佩戴的眼鏡變得更智慧、更實用,讓使用者能更專注於當下,簡化日常生活。與過去的智慧眼鏡不同,Google 這次採取了與知名眼鏡品牌 Warby Parker 和 Gentle Monster 合作的策略,以確保產品兼具時尚外觀與日常穿戴的舒適性,這也是 Google Android XR 平台首次與眼鏡品牌合作。

兩大 AI 眼鏡款式:滿足不同需求

Google 計劃推出兩種主要款式的 AI 眼鏡,均搭載 Android XR 平台並由 Gemini 驅動:

-

AI 眼鏡(Audio-Only AI Glasses)

-

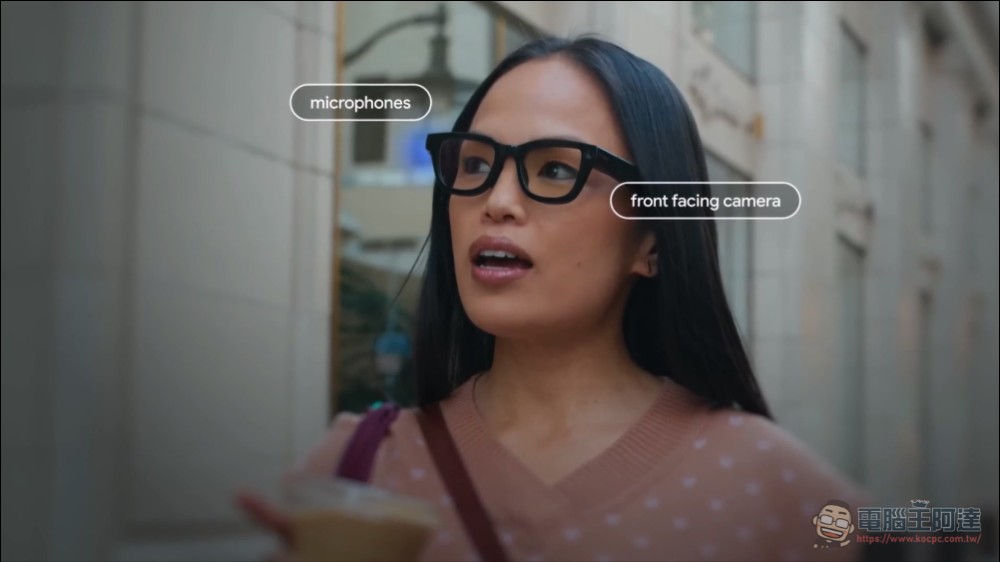

核心功能: 內建喇叭、相機和多個麥克風。

-

用途: 讓使用者能與 Gemini 進行對話,聽音樂、撥打電話、拍照等。它主要作為一個免持、螢幕解放的 AI 助手。

-

-

Display AI 眼鏡(Display AI Glasses)

-

核心功能: 在 AI 眼鏡的基礎上,增加了一個小型顯示器。

-

用途: 能夠私下顯示有幫助的資訊,且資訊只在使用者需要時才出現。這就是 Google 在 I/O 大會上曾示範的款式。

-

賦予眼鏡「情境感知」的 Gemini AI

Gemini 是這款智慧眼鏡的核心賣點,它能夠透過眼鏡上的鏡頭、麥克風等感應器「看見」和「聽見」使用者周遭的世界,從而提供情境感知和即時協助。

-

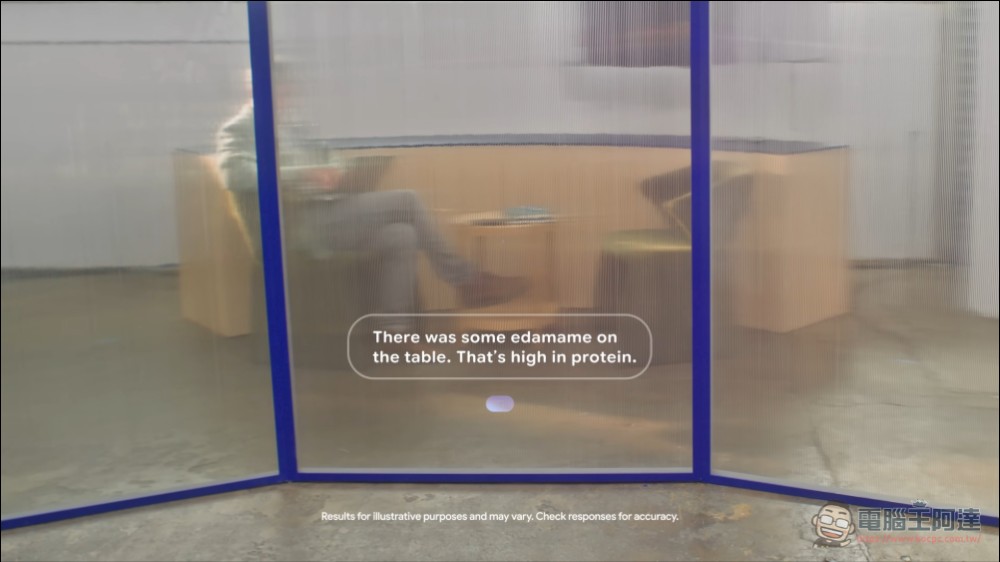

即時問題解答: 詢問眼中所見的物體,例如辨識桌上的零食名稱與吃法。

-

視覺化記憶與提醒: 提醒某個地點 或辨識高蛋白食物(如毛豆)並加入購物清單。

-

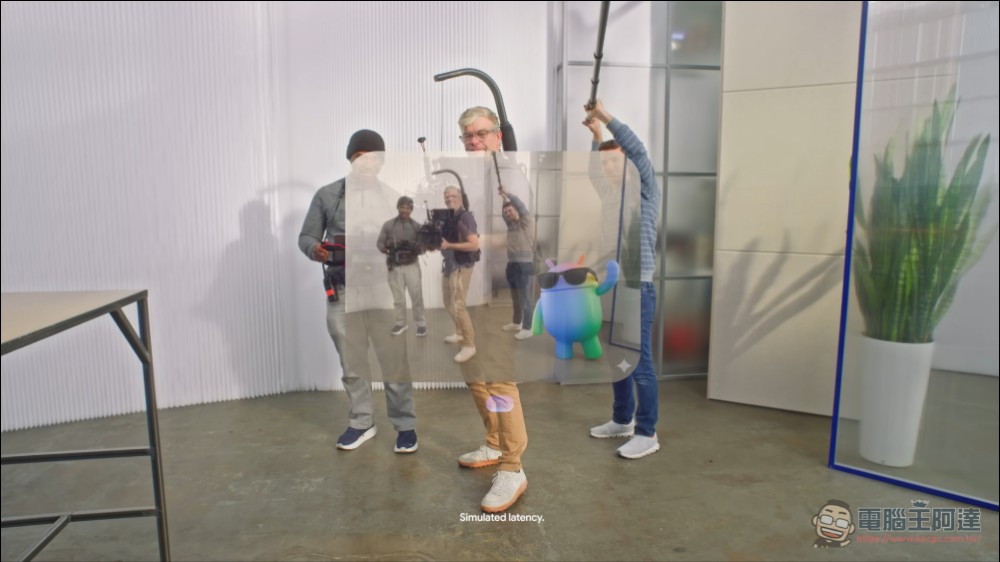

擴增實境創意: 透過語音指令拍照,並加入 Android 機器人等數位元素。

-

即時翻譯: 在與不同語言的人交談時,即時進行語音翻譯。

-

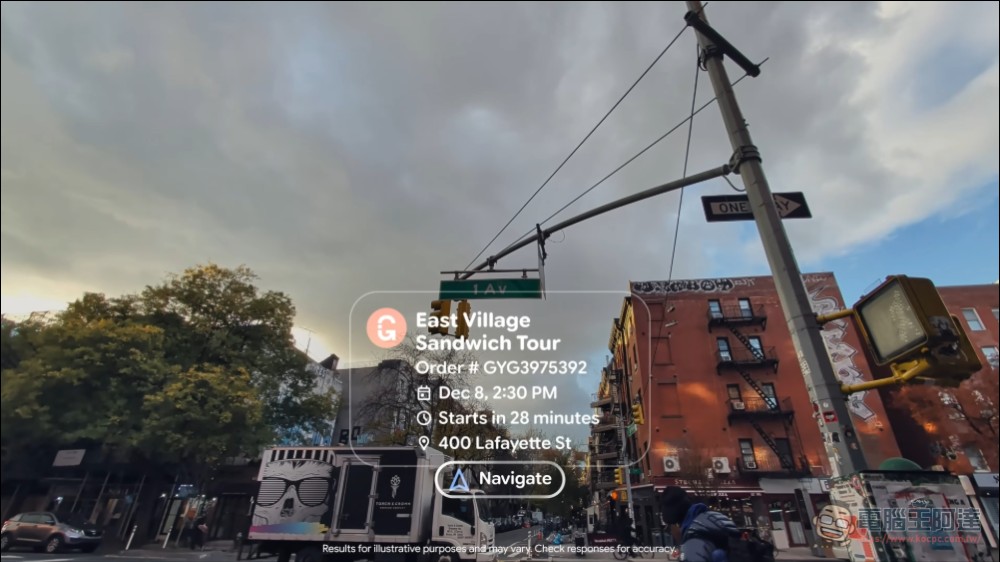

導航與生活協助: 提供逐步導航、訊息通知、預約排程等功能。

合作夥伴展望:重新定義日常穿戴與 IoT

Google 的合作夥伴也對 AI 眼鏡帶來的可能性感到興奮,認為它們將取代部分智慧型手機的功能,讓使用者不再需要頻繁拿出手機,更專注於生活。

-

Gentle Monster / Warby Parker: 視眼鏡為「強而有力的自我表達形式」;認為未來所有眼鏡都將是智慧的,且不再需要被特別稱為 AI 眼鏡。

-

Get Your Guide (旅遊): 整合 AI 眼鏡來提升旅遊體驗,例如在美食導覽中,讓眼鏡協助尋找集合點或記錄地點。

-

Uber (交通): 正在研究如何利用 Display AI 眼鏡的螢幕,在機場等複雜環境中,即時顯示叫車狀態、ETA、車牌號碼和導引方向,讓取車體驗更順暢直覺,避免使用者在騰不出手時還要拿出手機。Uber 認為這重新定義了 IoT(物聯網)的可能性。

與 META 僅支持自家生態(FB、IG、WhatsApp…)不同,Google 也針對軟體開發者釋出 Android XR SDK Developer Preview 3 與 AI 眼鏡專屬工具: Jetpack Glimmer (UI 工具包)、Jetpack Projected Library (App 移植)、AR Core 地理空間能力 等工具,以未來發展性來講 Google AI 眼鏡用途會廣很多。

我們也整理翻譯了 The Android Show 裡面有關 AI 眼鏡的影片內容,可以直接觀看影片版本:

市場競爭與未來展望

Google AI 眼鏡的推出,被視為對 Meta Ray-Ban 智慧眼鏡的直接挑戰。Meta 的產品目前主要專注於拍照、錄影和基礎語音功能(新款的 Display 也僅支持它自家生態),而 Google 則將 Gemini AI 深度整合,使其成為一個更為強大的情境感知助手。因有之前 Google Glass 的失敗經驗,Google 這次的新策略是吸取了過去的教訓,轉而注重時尚設計和實用、無縫的 AI 體驗。這場 AI 穿戴裝置的戰局正日益升溫,Apple 也傳聞將在 2026 年左右推出 AI 智慧眼鏡,搭載 Gemini 的 Google AI 眼鏡預計將在 2026 年陸續上市。