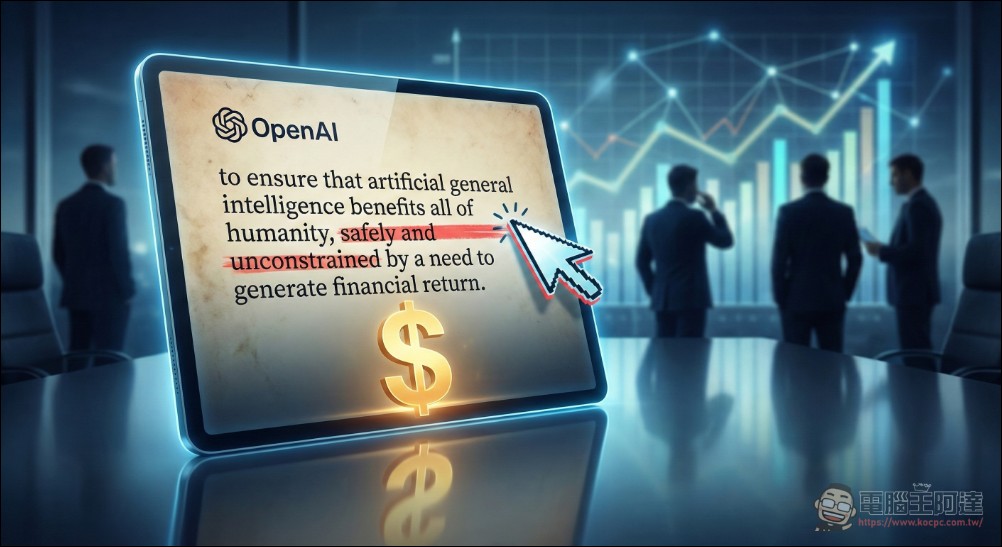

OpenAI,這家曾以「確保通用人工智能造福全人類」為崇高使命而聞名的公司,近期被發現已悄悄修改其核心使命宣言。在2024年底更新的稅務文件中,兩個關鍵用詞已經消失:「安全地(safely)」以及「不受產生財務回報需求限制(unconstrained by a need to generate financial return)」。這一變化不僅是文字遊戲,更反映出這家 AI 巨頭在商業化道路上的根本性轉向。

OpenAI 悄悄刪除「安全」與「不受利潤限制」使命宣言

回顧2023年的官方使命宣言,OpenAI 明確承諾:「構建能夠安全地造福人類、不受產生財務回報需求限制的通用人工智能(AGI)」。這段話體現了公司創立時的非營利本質:技術發展的首要目標是人類福祉,而非股東利益。然而,在2024年底提交的稅務文件中,這句話被修改為:「確保通用人工智能使全人類受益」。看似保留了「造福人類」的核心精神,但「安全地」與「不受營利約束」這兩個關鍵限定詞已被刪除。

這兩個詞彙的刪除絕非無關緊要。在 AI 發展的語境中,「安全」意味著對齊(Alignment)、風險評估、負責任的部署節奏;而「不受營利約束」則是對商業利益凌駕於公共利益的根本性防護。它們的消失,預示著 OpenAI 已經徹底脫離了創立時的純粹理想主義。

組織重組:安全團隊的解散

文字修改只是表象,組織架構的調整才更為關鍵。OpenAI 之前早就已經解散了首席科學家 Ilya Sutskever 專責 AI 安全的「超級對齊團隊(Superalignment Team)」,該團隊原本負責確保 AI 系統的行為與人類價值觀保持一致。與此同時,多位負責 AI 安全的高層主管相繼離職或被解職,Ilya Sutskever 後來與丹尼爾·格羅斯(Daniel Gross)和丹尼爾·利維(Daniel Levy)共同創立了以 AI 安全為重點的公司Safe Superintelligence(SSI),該公司專注超級對齊與希望開發遠超人類能力的安全人工智慧系統。

這些人事變動與使命宣言的修改相互呼應,形成一個清晰的趨勢:OpenAI 正在將資源從長期的安全研究轉向短期的產品開發與商業化。對於一家聲稱正在開發可能改變人類文明進程的 AGI 的公司而言,這樣的優先級調整令人憂慮。

法律戰場:Elon Musk 的指控

OpenAI 的轉型也成為法律訴訟的焦點。OpenAI 公司早期共同創辦人 Elon Musk 正對 OpenAI 提起訴訟,指控該公司違背了創立時的非營利承諾,將商業利益置於公共利益之上。Musk 的訴狀中特別強調,OpenAI 與 Microsoft 的緊密合作關係,已經讓這家公司淪為「Microsoft 的閉源子公司」。

馬斯克:我贊助了一個非盈利組織去保護森林,結果它去砍伐森林成為一家木材公司……

我頓時明白了 OpenAI 的鬧劇~ pic.twitter.com/njWbwf1iab

— LEI (@TheMarketMemo) September 27, 2024

雖然 Musk 本人的動機也飽受質疑,他後來自己也創立了 xAI:但其訴訟中提出的核心問題卻難以迴避:當一個以「造福全人類」為名籌集資金與人才的組織,最終轉型為追求利潤最大化的商業實體時,是否構成對早期參與者的欺騙?

從非營利到「利潤上限」

OpenAI 的組織結構轉型是一個漸進的過程。最初,它是一個純粹的非營利研究機構;2019年,為了籌集足夠資金支持大規模 AI 訓練,公司創立了「利潤上限(capped-profit)」模式:投資者的回報被限制在一定倍數,超出部分將流入非營利基金會用於 AI 安全研究。然而,隨著 ChatGPT 的成功與估值飆升,這個「上限」變得越來越模糊。最新一輪融資中,OpenAI 的估值已超過5000億美元,而關於利潤上限的具體執行細節,外界知之甚少。而且 OpenAI 正考慮進一步調整公司結構,可能完全取消利潤上限,轉型為傳統的營利公司。這將徹底終結其與非營利根源的最後一絲聯繫。

OpenAI 的轉向對整個 AI 產業具有指標性意義。作為生成式 AI 領域的領導者,它的價值觀與優先級選擇,往往會影響其他公司的策略方向。當 OpenAI 將「安全」從使命宣言中刪除,並縮減安全研究團隊時,這向整個產業傳遞了一個危險的訊息:在激烈的商業競爭中,安全可以為速度與利潤讓路。Anthropic 等較小規模的競爭對手雖然仍在強調 AI 安全的重要性,但它們的聲音在資本與市場的洪流中顯得相對微弱。

更廣泛的社會意涵

AI 安全不僅是技術問題,更是關乎人類社會未來的治理問題。通用人工智能一旦實現,其影響力將超越任何單一國家或企業的控制範圍。在這樣的背景下,開發者是否將「安全」作為不可妥協的核心原則,關係到全人類的利益。

OpenAI 使命宣言的修改,反映出一個更深層的張力:在資本主義體系中,如何確保具有變革性潛力的技術不被少數企業的短期利益所綁架?當技術的開發成本動輒數十億美元時,純粹的非營利模式是否真的可行?

這些問題沒有簡單的答案,但 OpenAI 的選擇:刪除「安全」與「非營利」的承諾,顯然不是朝著正確方向邁進。

觀點

OpenAI 刪除「安全地」與「不受營利約束」這兩個關鍵詞,絕非偶然的文字潤飾,而是公司戰略轉型的明確訊號。從組織層面看,安全團隊的解散與高層異動已經預告了這一天的到來;從商業層面看,數百億美元的估值與 Microsoft 的深度合作,早已讓「非營利」成為難以維持的姿態。然而,問題的核心在於 AGI 的特殊性質。這不是普通的消費科技產品,而是可能徹底改變人類文明軌跡的變革性技術。當開發者不再將「安全」視為與「能力」同等重要的核心目標,當商業回報成為優先於人類福祉的考量,我們是否正在走向一個風險不可控的未來?

OpenAI 的改名:從「Open」到實際上的「Closed」,從「非營利」到「利潤最大化」:或許是資本邏輯下的必然結果。但這個結果本身,正是為什麼 AI 治理不能僅依賴企業自律的根本原因。當技術的影響力超越國界,當開發者不再受公共利益約束,社會需要更強有力的監管框架來填補這個真空。

當年 OpenAI 的創立初衷,馬斯克等人為了避免 AGI 被 Google、Meta 等少數科技巨頭壟斷並用於牟利。諷刺的是,它最終成為了自己原本想要對抗的那種存在,也難怪馬斯克要告 Sam Altman 求償天價賠償金了。