知名科技 YouTuber Alex Ziskind 近日發表了一支標題為「NVIDIA didn’t want me to do this」的影片,展示了他如何將 8 台 NVIDIA DGX Spark 等級(四台 DGX Spark、兩台 Dell GB10、一台 MSI EDGEXPERT、一台華碩 ASCENT GX10)的個人 AI 電腦組建成擁有 1TB 統一記憶體的超級集群。這項創舉突破了 NVIDIA 官方文件僅支援最多 2 台集群的限制,為個人用戶運行超大規模語言模型開闢了新思路。

NVIDIA 可能不開心?國外 YouTuber 用 8 台 DGX Spark 組建出 1TB VRAM 超級集群

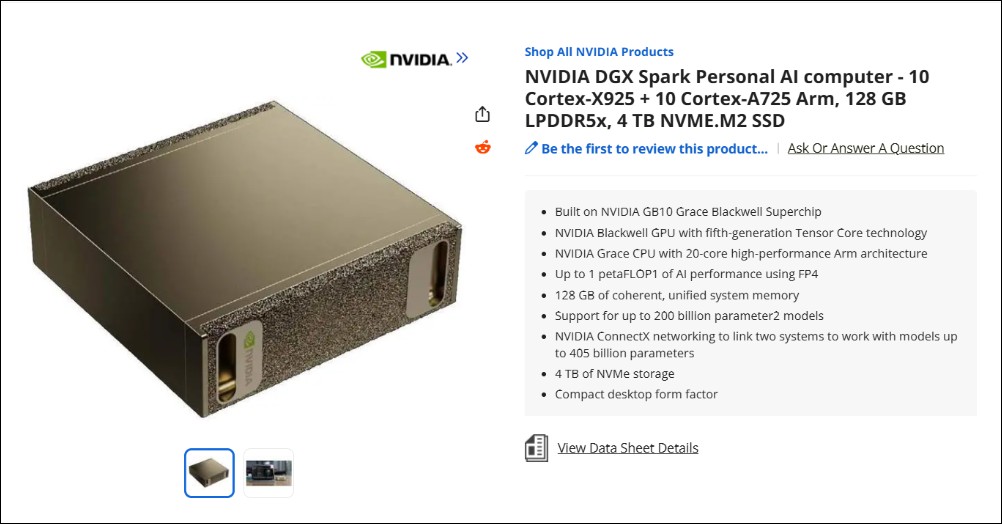

DGX Spark 硬體規格深度解析

每台 NVIDIA DGX Spark 配備以下頂級規格(其他主機基本也是一樣規格,只是不同廠商製造):

- 處理器:10 核 Cortex-X925 + 10 核 Cortex-A725 Arm 架構

- 記憶體:128GB LPDDR5x(可用於大型語言模型的訓練和推理)

- 儲存:4TB NVMe M.2 SSD

- 網絡介面:NVIDIA Connect-7(單購價格約 $1,000-1,500 美元)

- 散熱:集中式熱排氣設計(被作者形容為「超級熱」)

集群優勢

當多台 DGX Spark 通過高速互連組建集群時,可實現:

| 集群規模 | 總記憶體 | 適用場景 |

|---|---|---|

| 單機 | 128GB | 中小型 LLM 推理 |

| 雙機集群 | 256GB | Qwen 235B 等超大模型 |

| 四機集群 | 512GB | 多模型並行、大型訓練任務 |

| 八機集群 | 1TB | 極限規模 AI 研究 |

集群組建技術細節

Alex 採用的是網狀網絡(Mesh Network)拓撲,所有節點均可互相通信:

關鍵配置步驟:

- SSH 無密碼認證:各節點間建立 SSH trust relationship

- 網絡速度測試:使用

ethtool驗證鏈路速度 - RDMA 配置:啟用直接記憶體存取以實現張量並行

張量並行原理解析

影片中詳細解釋了張量並行(Tensor Parallelism)與傳統集群的差異:

| 連接方式 | 擴展特性 | 性能表現 |

|---|---|---|

| 傳統以太網 | 機器越多越慢 | 網絡瓶頸嚴重 |

| RDMA 高速互連 | 機器越多越快 | 線性擴展性能 |

技術原理:

- RDMA(Remote Direct Memory Access)允許直接訪問遠端記憶體,無需 CPU 介入

- Connect-7 介面提供超高頻寬和低延遲

- 張量並行將模型權重分散到多個 GPU,協同計算

踩坑實錄:買錯纜線的慘痛教訓

Alex 在影片中坦白承認自己犯了昂貴的錯誤:「我幾個月前買了整整一堆纜線…但恰好買錯了型號。」

問題根源:

| 纜線類型 | 速度 | 密度 | 結果 |

|---|---|---|---|

| QSFP28 | 100Gbps | 標準 | ❌ 限速 50Gbps |

| QSFP56 | 200Gbps | 標準 | ✅ 正確規格 |

| QSFP-DD | 400Gbps | 雙倍密度 | ✅ 最佳選擇 |

代價:數月時間只能運行在半速狀態,直到更換正確的 QSFP56 纜線才解決問題。

DGX Spark 的後吹散熱設計也帶來了意外困擾:

- 排氣方向:集中向單一方向吹送熱風

- 影響範圍:熱氣流足以干擾攝影機運作

- 噪音表現:風扇安靜但風壓極強

成本分析

根據影片描述和連結,完整四機集群的成本估算:

| 項目 | 單價 | 數量 | 小計 |

|---|---|---|---|

| DGX Spark | ~$4,000 | 4 | ~$16,000 |

| MikroTik 400G 交換器 | $1,300 | 1 | $1,300 |

| QSFP56 breakout 纜線 | ~$200 | 4 | ~$800 |

| Connect-7 介面卡 | ~$1,250 | 4 | ~$5,000 |

| 總計 | ~$23,100 |

若擴展至八機集群,總投資可能超過 $40,000 美元(約130萬台幣)。聽起來好像價格驚人,但相較傳統企業級的解決方案竟然性價比很高:

- NVIDIA DGX A100:單機 8×A100 GPU,售價約 $200,000(約600多萬台幣)

- DGX H100:單機 8×H100 GPU,售價約 $300,000+(可能超過千萬台幣)

Alex 的方案以約 1/10 的成本實現了相近的記憶體容量,雖然計算能力有所妥協,但對於 LLM 推理和輕量訓練已足夠使用。

實際應用場景

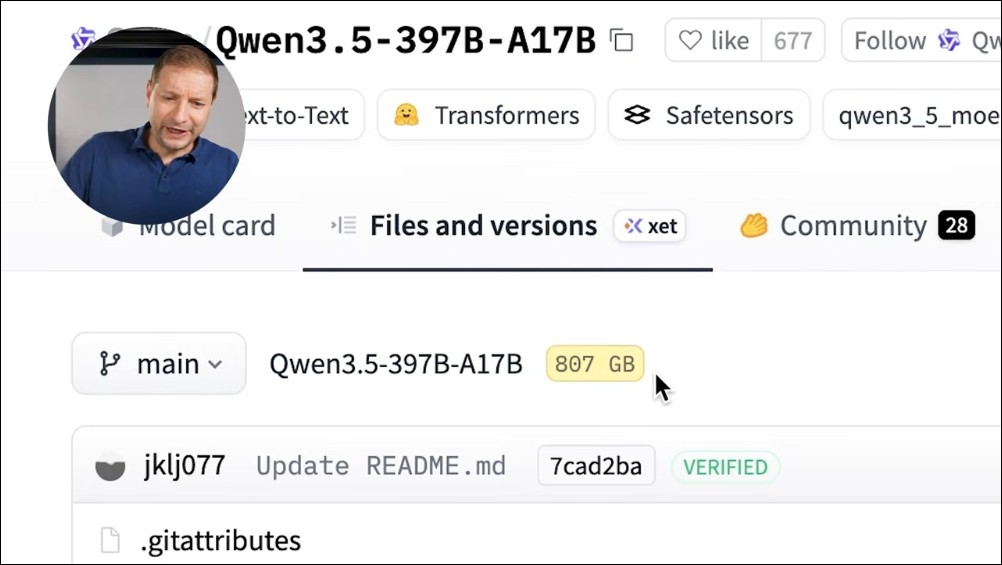

根據記憶體需求估算,他最後也測試了 Qwen 3.5 與 KIMI K2.5 這類剛推出的中國開源大模型,雖然吐字速度不算快,但能在家跑這種全尺寸無量化的大模型已經是突破:

| 模型 | 參數量 | FP16 記憶體需求 | 所需集群規模 |

|---|---|---|---|

| Llama 3 | 70B | ~140GB | 2 台 DGX Spark |

| Qwen 2.5 | 72B | ~144GB | 2 台 DGX Spark |

| Grok-1 | 314B | ~628GB | 6-8 台 DGX Spark |

| 自訂超大模型 | 500B+ | ~1TB+ | 8 台 DGX Spark |

效能優勢

透過 RDMA 和張量並行,集群可實現:

- 線性擴展:增加節點不會降低速度

- 低延遲推理:適合即時對話應用

- 批量訓練:支援 LoRA 等微調技術

有興趣的朋友可以看看這部影片真的很 Hardcore:

結語

Alex Ziskind 的實驗展示了消費級硬體也能構建企業級 AI 基礎設施的可能性。這種「DIY 超級電腦」模式具有多重意義:

首先,它打破了大型語言模型訓練和推理必須依賴雲端服務或昂貴企業設備的迷思。透過巧妙的集群設計,個人研究者和小型團隊也能運行數千億參數的模型。其次,這個專案凸顯了社群驅動創新的重要性。NVIDIA 官方文件僅涵蓋雙機集群,正是社群成員的探索和分享,才讓更多人能夠突破這一限制。這種開放協作的精神,正是技術進步的核心動力。

然而,高昂的入門成本仍然是主要障礙。即使是最精簡的四機集群,也需要超過 2 萬美元的投資,這對於大多數個人用戶而言仍是天文數字。隨著技術成熟和規模效應,期待未來能看到更具性價比的解決方案(當然你的口袋也要夠深),蘋果的 M3 Ultra 512GB 買兩台 EXO 也有1TB 的記憶體,似乎更具性價比?對岸我也有看到四台的方案,可能要大家自己去試試看了。