2026 年 2 月底的 AI 產業可說是「戰雲密布」。美國國防部(五角大樓;現在也被稱為戰爭部)在短短 24 小時內接連對兩大 AI 公司:OpenAI 與 Anthropic下達重大決策,引發科技業地震。不只如此,就連 Google 與 OpenAI 的員工也罕見地聯手表態,共同聲援 Anthropic。這場 AI 產業與軍事機構之間的角力,正在重新定義 AI 安全的邊界。

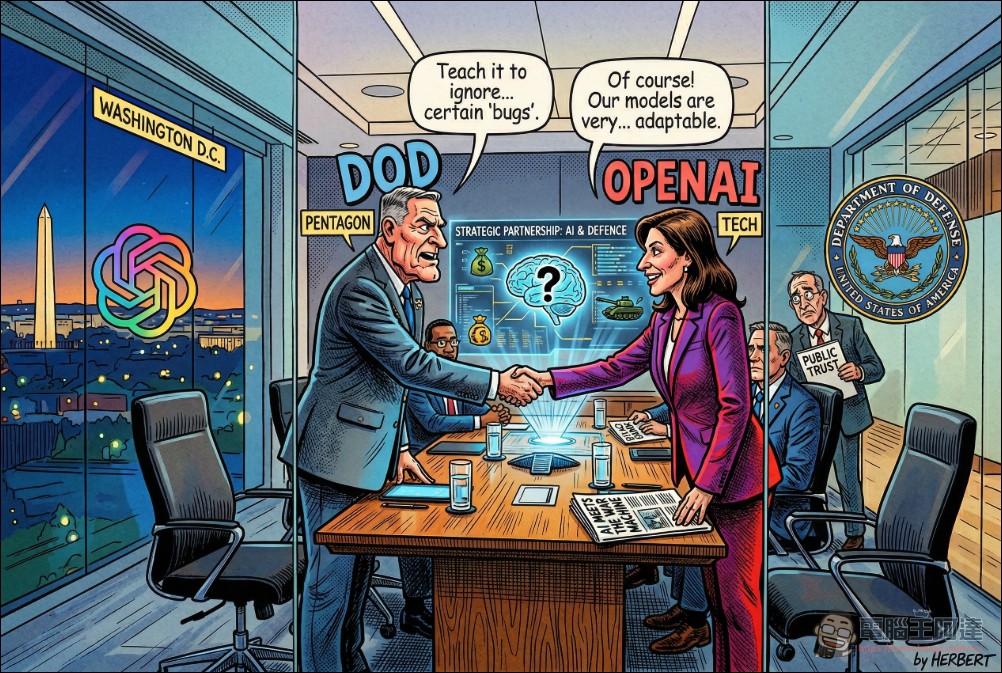

OpenAI 與五角大樓達成協議 模型將部署於美國機密網絡

OpenAI 創辦人 Sam Altman(奥特曼)稍早在社群媒體上宣布,OpenAI 已與美國國防部(簡稱「戰爭部」)達成協議,將在國防部的機密網絡中部署 OpenAI 的 AI 模型。Altman 強調,人工智慧的安全與普惠受益是 OpenAI 使命的核心,並列出兩項最重要的安全原則:

- 禁止國內大規模監控

- 武力使用必須由人類負責,包括自主武器系統

Altman 表示,國防部認同這些原則,並將其體現在法律與政策中,OpenAI 也已將這些原則寫入協議。此外,OpenAI 將構建技術安全保障措施,確保模型按預期運行,同時部署功能開發工程師協助模型工作並保障安全,且僅在雲網絡中部署。

Tonight, we reached an agreement with the Department of War to deploy our models in their classified network.

In all of our interactions, the DoW displayed a deep respect for safety and a desire to partner to achieve the best possible outcome.

AI safety and wide distribution of…

— Sam Altman (@sama) February 28, 2026

OpenAI 更呼籲國防部向所有人工智慧公司提供相同條款,認為所有企業都應該願意接受。Altman 也強調,OpenAI 強烈希望事態降溫,從法律與政府行動轉向理性協商。

Anthropic 槓上五角大樓 痛批「史無前例」將訴諸法院

與 OpenAI 的「和解」姿態形成強烈對比的是,Anthropic 與五角大樓的緊張關係持續升級。根據報導,Anthropic 表示尚未收到「戰爭部」或白宮就談判進展的任何直接溝通,並明確表示將在法庭上挑戰任何將其列為供應鏈風險的認定。美國總統 Trump 週五表示,已指示美國政府機構停止使用 Anthropic 的技術。隨後,五角大樓宣布將 Anthropic 列為供應鏈風險企業。Anthropic 在聲明中痛批:

「將 Anthropic 列為供應鏈風險將是一個前所未有的舉動,此舉歷來只針對美國的對手,此前從未公開適用於任何美國公司。我們對這一事態的發展深感痛心。」

據悉,五角大樓希望在法律允許的範圍內,無限制地使用 Anthropic 的 Claude 聊天機器人。然而,Anthropic 始終堅持,Claude 不得用於針對美國人的大規模監控,也不得用於完全自主的武器操作。五角大樓隨後向 Anthropic 發出通牒,在週五之前不放寬規定就取消 Anthropic 的合約:但 Anthropic 選擇拒絕。

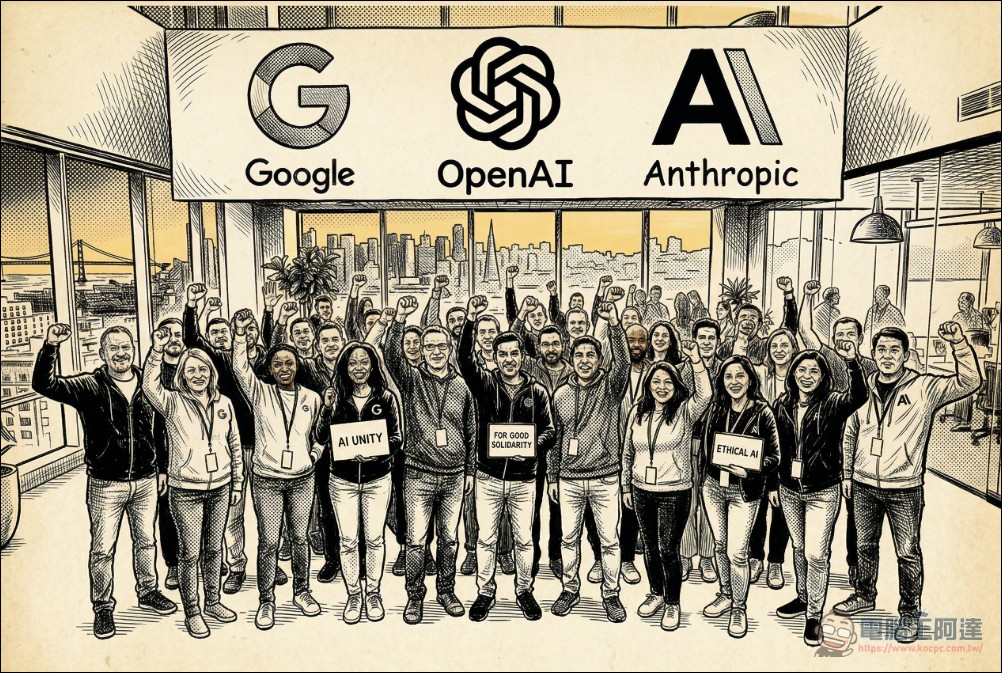

Google、OpenAI 員工罕見聯合 300 多人署名聲援 Anthropic

就在五角大樓給 Anthropic 的合規截止日期(週五下午)即將到期之際,局勢出現戲劇性轉折。超過 300 名 Google 員工與 60 多名 OpenAI 員工聯合簽署公開信,敦促各自公司的領導層支持 Anthropic,並拒絕這種單方面的使用要求。這封公開信的內容特別呼籲 Google 與 OpenAI 的高管堅守 Anthropic 針對大規模監控和全自動武器設定的紅線。公開信寫道:

「他們試圖用『對方會妥協』的恐懼來分化每家公司。這種策略只有在我們互不了解彼此立場時才會奏效。」

「我們希望領導層能放下分歧,團結一致,繼續拒絕『戰爭部』當前的需求。」

這些來自 AI 巨頭公司員工自發簽署的公開信的連署者強調,他們支持 Anthropic 反對將人工智慧用於國內大規模監控和自主武器的理念,他們希望鼓勵各自雇主「放下分歧,團結一致」,堅守 Anthropic 劃下的道德底線。目前,兩家公司的高層尚未對這封信作出正式回應。

觀點:AI 產業的「軍事化」趨勢與道德紅線

這一系列事件揭示了 AI 產業面臨的深刻抉擇:當國家安全與商業利益交織時,技術公司如何在「配合政府」與「堅守價值觀」之間取得平衡?從 OpenAI 的角度來看,選擇與國防部達成協議、並將安全原則寫入合約,或許是一種「務實」的生存策略。透過確保兩項核心紅線(禁止大規模監控、人類必須對武器使用負責),OpenAI 在維持合作的同時也保留了道德底線。

然而,Anthropic 的強硬立場則代表了另一種選擇,即使面臨被列為供應鏈風險、被斷絕政府合約的可能,仍堅決拒絕讓步。Anthropic 的立場很清楚:AI 不能用於傷害無辜人民,不能成為極權監控的工具。

至於 Google 與 OpenAI 員工的聯合署名,則顯示了科技業內部對於「AI 軍事化」的疑慮正在發酵。員工們選擇公開站在 Anthropic 這一邊,不僅是聲援同行,更是對自身公司的一種「內部監督」。

未來觀察重點:

- Anthropic 是否會真的對國防部的決定提起訴訟?

- OpenAI 與國防部的合作示範,是否會引發其他 AI 公司效仿?

- Google 與 OpenAI 高層將如何回應員工的公開呼籲?

這場 AI 道德與國防的世紀爭議,其實才剛剛開始,大家覺得該不該禁止科技巨頭的 AI 參與到國防項目呢?實話說我個人是採保留態度的,如果改天 AI 真的覺醒變成類似終結者中「天網」的存在,而且它又能操控這種無人大規模殺傷性武器時,其實真的蠻可怕的。