現在 AI 不只是大模型越來越強,小模型也逐漸拉近距離,稍早阿里巴巴正式推出全新 Qwen3.5 小模型全系列,讓不少人都驚艷,連馬斯克本人都在下方留言稱讚「智慧密度驚人」。這次新模型的重點在「更多智慧、更少運算」,其中 90 億參數的 Qwen3.5-9B 模型在多項第三方基準測試中,接近甚至超越參數為 13 倍以上的 OpenAI GPT-OSS-120B 模型,即便在一般的筆電也能順暢運行。

圖片來源:pandaily

阿里巴巴 Qwen3.5 小型開源模型系列登場:9B 版本逼近 GPT-OSS-120B

這次推出的 Qwen 3.5 小模型系列共有四款開放權重模型,分別為:

- Qwen3.5-0.8B(8 億參數)

- Qwen3.5-2B(20 億參數)

- Qwen3.5-4B(40 億參數)

- Qwen3.5-9B(90 億參數)

技術層面部分,Qwen3.5 系列採用混合注意力架構,結合 Gated DeltaNet 線性注意力機制與 Gated Attention,每 8 個區塊中以 3:1 比例交替使用,能有效提升推理吞吐量並降低記憶體消耗。更重要是,這四款模型皆為原生支援多模態,能同處理文字、圖片和影片。原生上下文長度為 262,144 個 tokens,4B 和 9B 可擴充到 1,010,000 tokens。

也具備 Agent 能力,原生支援工具呼叫、多輪思考模式與視覺代理任務,如:桌面操作、文件解析或自主程式碼生成,經強化學習優化後適合建構輕量級智慧代理。

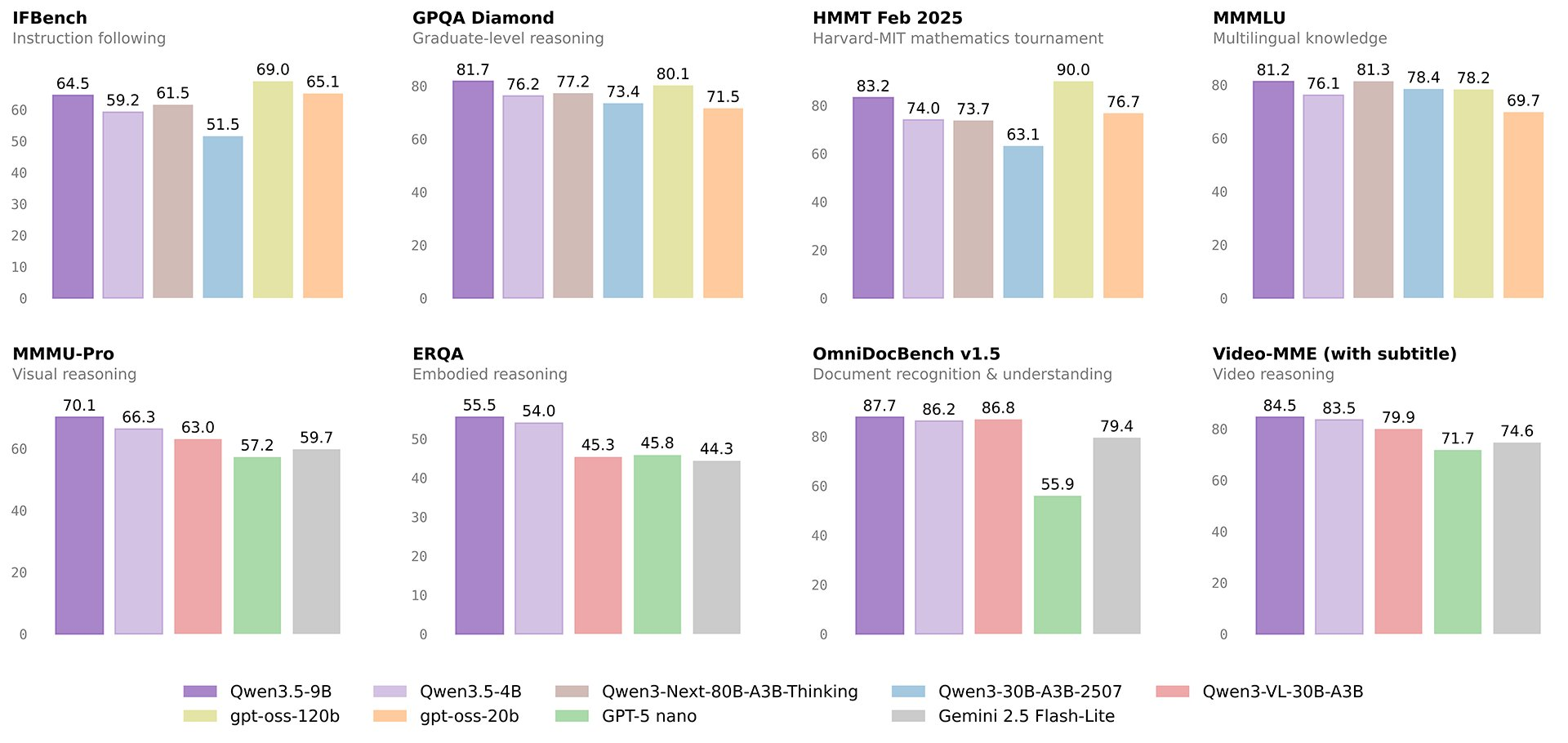

在實際效能測試部分,Qwen3.5-9B 可說表現突出。

研究生級科學推理基準的 GPQA Diamond,9B 得分為 81.7,高於 GPT-OSS-120B 的 80.1,多語言知識基準 MMMLU 達 81.2 也同樣領先。視覺推理部分,MMMU-Pro 得分 70.1,超越 Gemini 2.5 Flash-Lite(59.7)與前代 Qwen3-VL-30B-A3B(63.0);影片理解 Video-MME(含字幕)得分 84.5;數學基準 HMMT 得分 83.2;文件處理 OmniDocBench 得分 87.7:

與上一代 Qwen3 系列相比,Qwen3.5-4B 效能已接近前代 80B A3B 模型,而 9B 版本在 GPQA、IFEval、長上下文 LongBench v2 等項目,更是全面超越前代大 3 倍的 Qwen3-30B,由此可見真的猛:

以下是各模型適合到硬體環境:

- 0.8B 與 2B 版本記憶體需求極低,可在智慧型手機、邊緣裝置或 IoT 設備上運行。

- 4B 版本可在標準筆電、M1 MacBook Air、甚至是網頁瀏覽器中流暢執行,適合用在輕量的代理應用。

- 9B 版本經 4-bit 量化後,可在搭載 12 至 24GB 記憶體的 GPU 或一般筆電上運行。

國外已經有開發者將 2B 版本放入 iPhone 17 Pro 使用:

對於有興趣的人,可 Hugging Face 或阿里巴巴 ModelScope 下載使用。

隨著阿里巴巴 Qwen3.5 小模型系列的推出,也打破「參數越大越強」的傳統思維,證明透過混合架構、多模態原生設計與強化學習,小型模型也能提供頂尖推理、視覺理解與 Agent 能力,很推薦大家玩玩看。