很多人都會想在電腦本地運行 AI 模型,不過不是每個人都知道自己的電腦,適合運行多少參數的模型,參數太高速度會變慢,太低使用起來又會顯得有點笨,也不知該怎麼測試比較準確。如果你正被這個所困擾,這篇就要推薦一個「llmfit」開源工具,只需一秒就能辨識出你電腦硬體能順暢運行哪些 AI 模型,Windows、Mac 都能用,而且支援市面上絕大多數的開源模型。

llmfit 介紹和操作教學

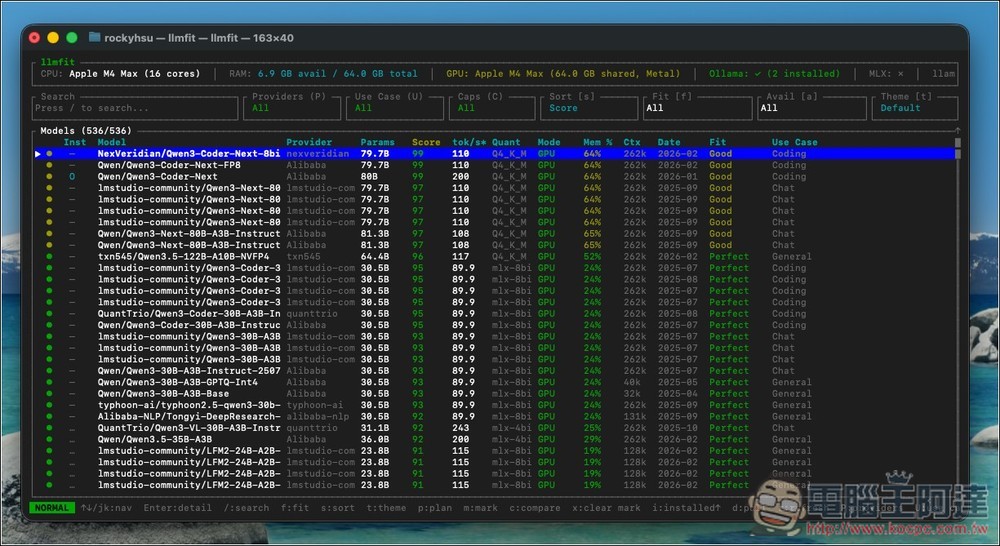

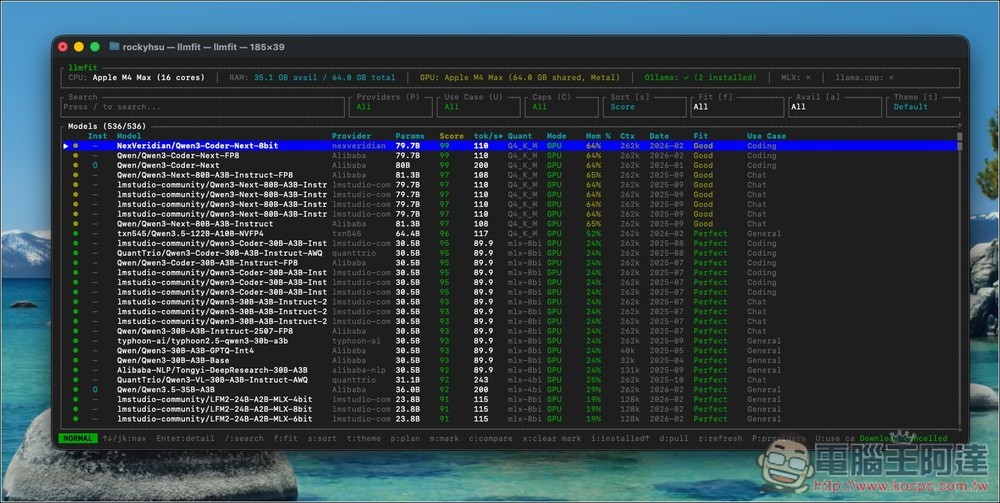

llmfit 是一款終端機工具,會自動偵測你的電腦硬體規格,包括 CPU 核心數、系統記憶體、GPU 型號與 VRAM,接著將這些資訊與資料庫中的數百個 AI 模型進行比對,計算出哪些模型最適合在你的電腦上運行。

與一般單純列出模型清單的工具不同,llmfit 會針對每個模型進行多維度評分,例如模型品質、推理速度、記憶體使用效率以及上下文長度等,最後整合成一個綜合分數,並依照適合程度排序,因此你可以很快知道該選擇哪些模型,大幅降低挑選模型的時間成本。

此外,llmfit 還提供互動式 TUI(Terminal UI)介面,能像操作應用程式一樣瀏覽模型資訊、搜尋模型、排序或篩選條件,甚至直接下載模型。它同時支援 Ollama、llama.cpp、MLX 等本地 AI 執行環境,讓模型管理與部署變得更加方便。

主要特色

- 自動偵測硬體環境:會自動分析 CPU、RAM、GPU 型號與 VRAM,判斷電腦可運行的模型範圍。

- 智慧推薦 AI 模型:內建數百個 AI 模型資料庫,根據硬體條件推薦最適合的模型。

- 多維度模型評分系統:依照品質、速度、記憶體使用效率與上下文能力進行綜合評分。

- 互動式終端機介面(TUI):在終端機中提供類似 GUI 的操作體驗,可搜尋、排序與查看模型細節。

- 支援多種本地 AI 執行環境:可與 Ollama、llama.cpp、MLX 等常見本地 AI 平台整合使用。

- 支援模型下載與安裝:直接從工具內下載模型並整合到本地 AI 執行環境。

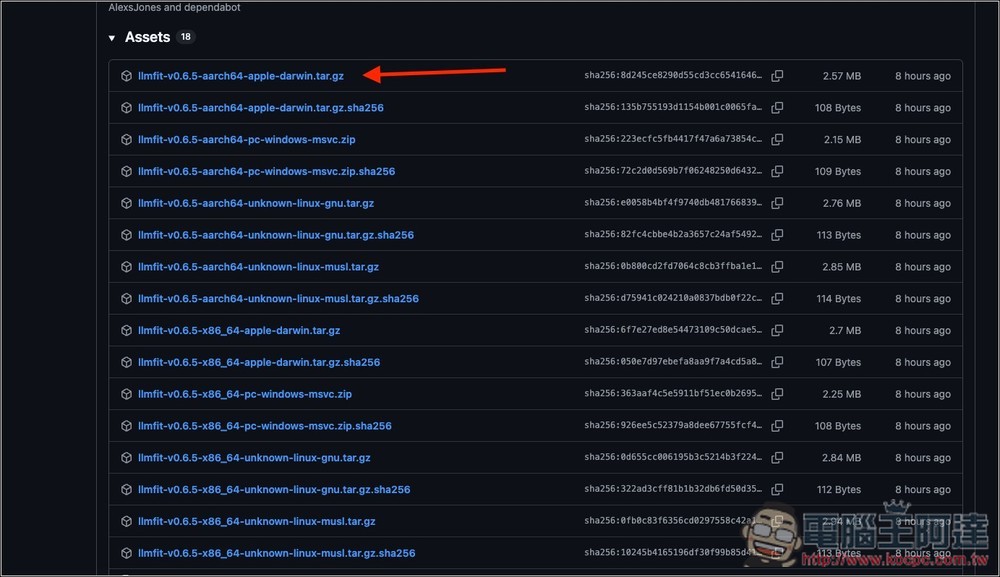

按上方連結進到 llmfit 的下載頁面後,選擇適合你作業系統的版本,我是用 M 系列 Mac,因此選擇第一個。ARM 架構的 Windows 選 aarch64 開頭,Intel 或 AMD 則是 x86 開頭:

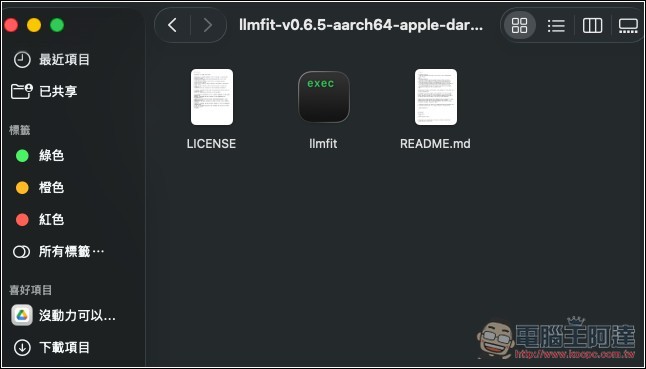

解壓縮後會有這三個檔案,點兩下打開 llmfit:

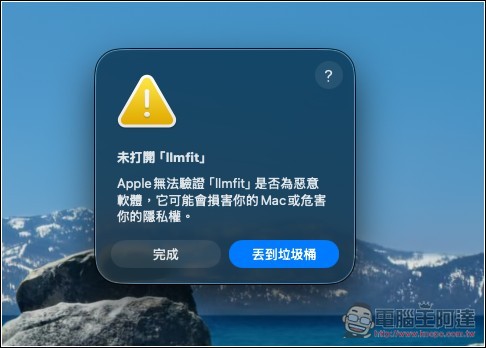

Mac 版可能會出現無法驗證所以不能打開的提示:

這時請打開設定 -> 隱私權與安全性,右側滑到安全性的欄位,就會看到「強制打開」的按鈕:

接著再按強制打開,並輸入你的登入密碼:

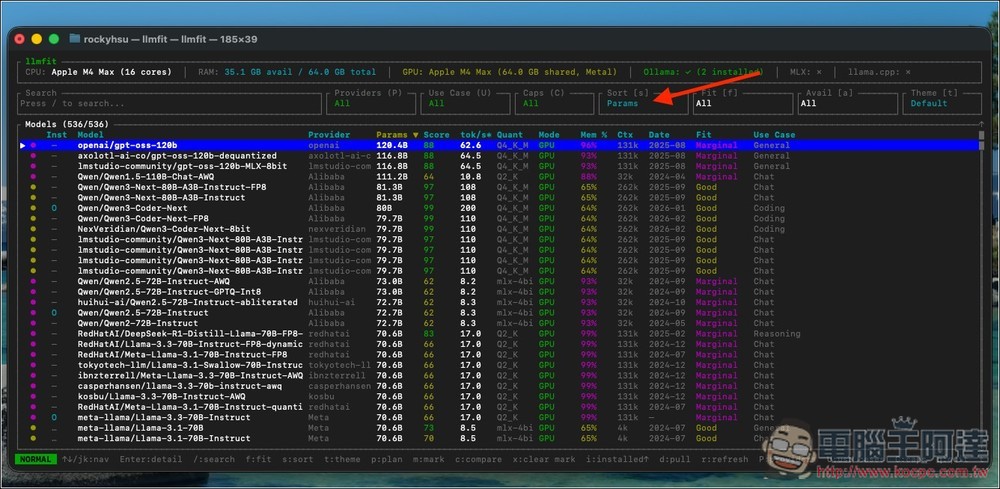

就能正常打開了。介面看起來似乎有點複雜,但其實蠻簡單的。下方列出的就是所有支援模型,目前有 536 個,每個模型都會註明提供者、參數大小、分數、Tok/s、推出日期、Fit 程度、以及用途(Use Case)等等:

由於數量太多,找起來會有些困難,如果你有特定喜歡的模型,建議直接搜尋最快。

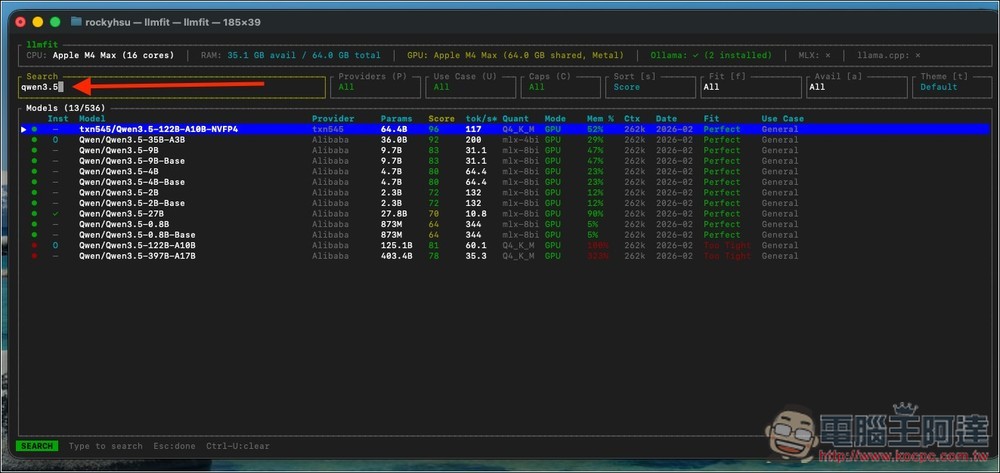

按鍵盤的 / 後,就能在左上角的 Search 欄位輸入關鍵字,像我輸入 qwen3.5,下方就會顯示符合的結果,這時我就能透過右側的分數、Fit 程度和用途來快速找出哪個參數的 AI 模型運行起來順暢。以 qwen3.5 來說,參數最大的 64.4B 也沒問題(Qwen3.5-122B-A10B-NVFP4),分數有到 96,Fit 為 Perfect。而再往上達 125.1B 參數的 Qwen3.5-122B-A10B 就不行,Fit 用紅色標示 Too Tight:

如果你沒有任何感興趣的模型,想從大參數模型開始找的話,可以按 s 來切換排列,切換到 Params 就是從最大參數模型往下排列,且會自動排除那些完全無法運行的模型:

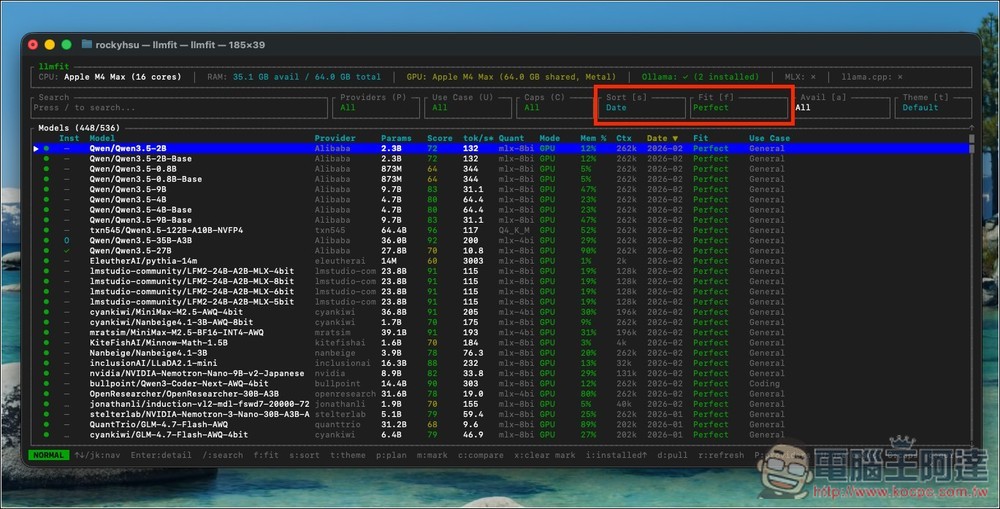

按 s 把排列設定成日期,再按 f 切換成只顯示 Perfect 的 LLM 模型,這時下方就會列出,所有在你電腦裡能順暢運行的模型:

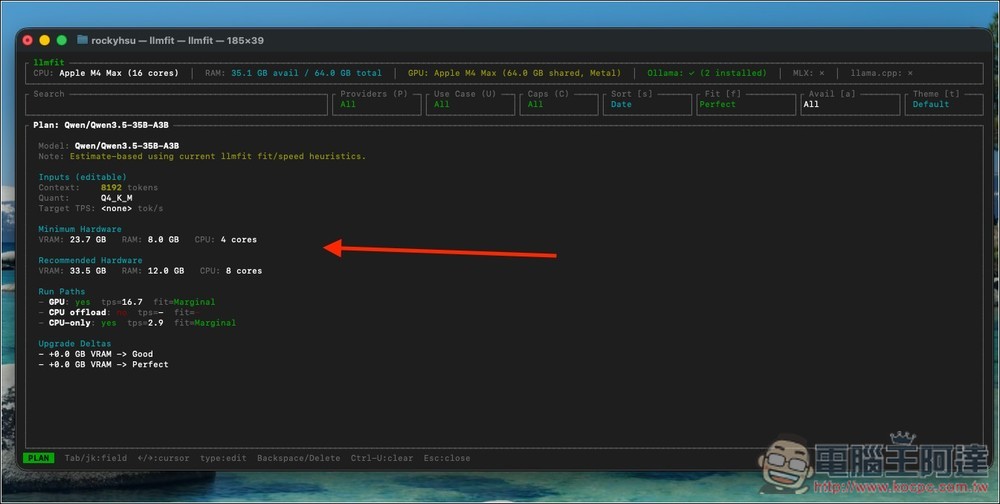

按 P 可以查看該模型的細節和規格要求: