Google 在近日推出了專為即時互動設計的旗艦級模型:Gemini 3.1 Flash Live。這款被官方定調為「Google 史上最高品質的音訊與語音模型」的新作,不僅標誌著語音優先(voice-first)應用分支的獨立發展,更透過底層架構的根本變革,解決了過往 AI 助理最令使用者詬病的延遲與失憶問題。相較於專注於文字處理的 Gemini 3.1 Flash,Flash Live 則是在音訊處理與即時反應上達到了前所未有的高度。

告別傳統四步流程:原生音訊處理將延遲壓低至感官極限

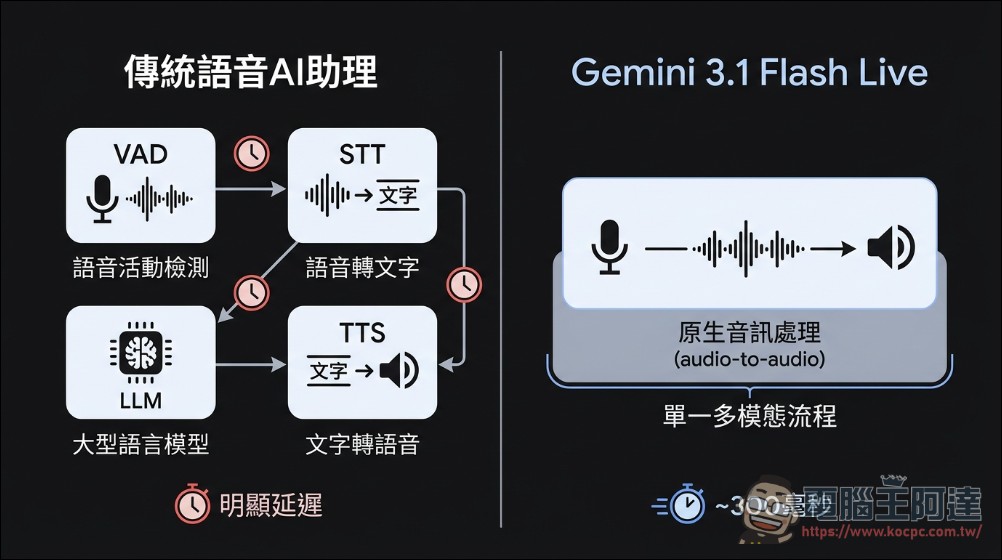

在 Gemini 3.1 Flash Live 問世之前,幾乎所有的語音 AI 助理都受限於一種「串聯式」的工作流程。當使用者說話時,系統必須依序經過:語音活動檢測(VAD)以確認說話結束、語音轉文字(STT)將波形轉化為 tokens、大型語言模型(LLM)生成文字回覆,最後再由文字轉語音(TTS)將回覆讀出來。這種多層轉譯的過程,不可避免地會產生明顯的等待空窗,讓對話顯得生硬且不連貫。

Gemini 3.1 Flash Live 實現了關鍵的技術突破:原生音訊處理(audio-to-audio),透過將上述所有環節整合為單一的多模態處理流程,該模型能夠直接理解原始音訊輸入,並即時生成音訊輸出。這使得理論延遲大幅縮減至 300 毫秒左右,這已經逼近人類在自然對話中的語音感知門檻。這意謂著當你對著手機說話時,AI 的反應幾乎是即時的,不再有那種令人尷尬的「機器思考時間」。

不只是快:細膩的情緒捕捉與雙倍的「長效記憶」

除了速度提升,Gemini 3.1 Flash Live 在對話的「深度」與「質感」上也展現了顯著進化。首先是語調理解能力的飛躍,新模型不僅能辨識字面意義,更能精準偵測使用者語音中的語氣、節奏與情緒。例如,當使用者語帶急促時,模型能動態調整回覆的長度與語氣,以更簡短、高效的方式回應;反之,若在閒聊情境下,模型則能展現更溫暖、擬人的共情能力。

另一個令開發者與使用者驚艷的突破是對話記憶能力,過去的 AI 助理常在長時間交談後忘記初衷,或在切換話題後無法銜接先前的脈絡。Gemini 3.1 Flash Live 將思路延續能力提升至先前的兩倍,有效解決了傳統助理常見的「失憶」問題。配合強化的工具觸發準確率,AI 可以在即時對話中精準呼叫外部工具(如行事曆、智慧家居控制等),即使是複雜的多步驟指令也能應對自如。

此外,針對現實生活中的複雜應用場景,Google 強化了模型的噪音過濾技術。無論是在喧鬧的交通背景聲中,還是在有多人交談的環境裡,Flash Live 都能有效分離出目標使用者的語音,確保指令接收的準確度不受環境音干擾。

開發者福音:Multimodal Live API 開啟視聽雙模態連線

為了讓這項技術快速落地,Google 同步在 Google AI Studio 開放了 Multimodal Live API 的預覽存取。這套 API 採用了有狀態、雙向的 WebSocket 連線技術,允許應用程式與模型之間建立穩定的數據流。開發者可以直接傳送 16kHz 的原始 PCM 音訊,模型也會以同樣格式直接回傳音訊,完全跳過了獨立的 TTS 環節,從根本上確保了低延遲表現。

值得注意的是,這套 API 不僅限於音訊。它同時支援每秒約 1 幀(fps)的影像輸入,這意謂著未來的 AI 助理可以透過攝影機鏡頭「看見」世界,並與使用者進行視訊對話。API 還具備「打斷」(barge-in)功能,使用者不需要等 AI 講完所有話,隨時可以插話修正或提出新問題,讓互動更貼近真實的人類交流。

針對不同場景需求,Google 為開發者提供了「可配置的思考等級」。以下是不同模式下的效能表現:

| 思考模式 | Big Bench Audio 準確率 | 平均反應時間 |

|---|---|---|

| 高思考模式 | 95.9% | 約 2.98 秒 |

| 最小思考模式 | 70.5% | 約 0.96 秒 |

這項設定讓開發者可以在「回答品質」與「反應速度」之間取得平衡。例如,處理複雜科學問題時可切換至高思考模式,而日常簡單對答則可使用最小思考模式以追求極致速度。[

Benchmark 數據:傲視群雄的音訊推理能力

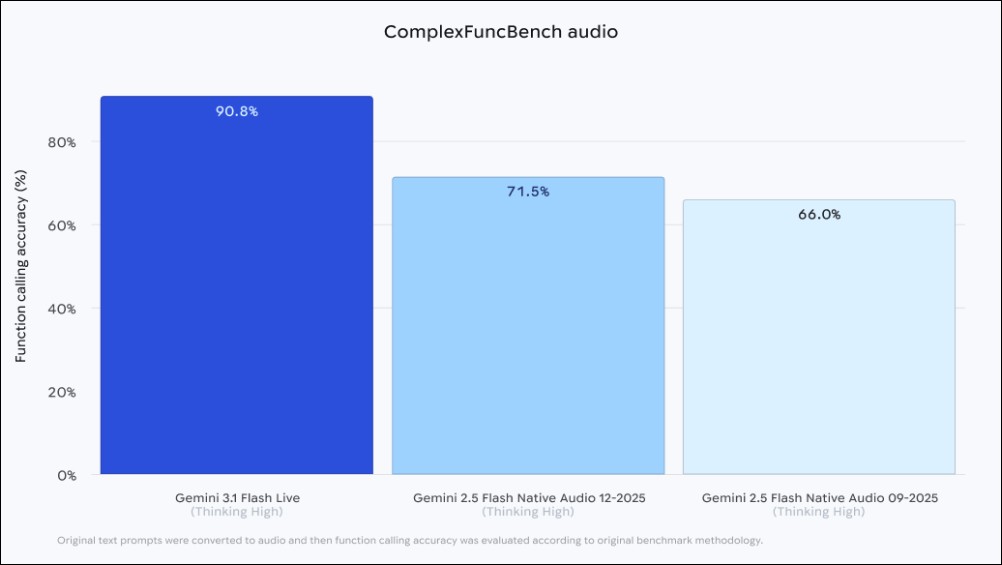

在多項嚴苛的基準測試中,Gemini 3.1 Flash Live 展現了其作為語音旗艦模型的實力。在 Big Bench Audio(高思考模式)測試中,其準確率達到驚人的 95.9%。針對多步驟函式呼叫的 ComplexFuncBench Audio 測試,該模型也拿下了 90.8% 的高分,顯示其在即時對話中執行複雜任務的穩定性。

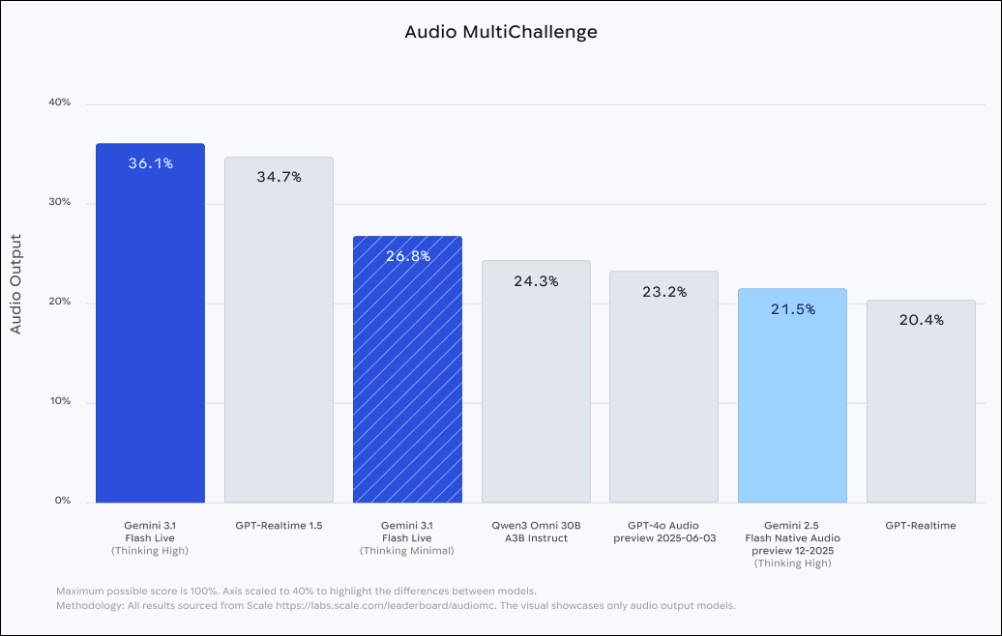

即便是在極具挑戰性的 Scale AI Audio MultiChallenge(測試即時複雜指令遵循與推理)中,Flash Live 仍取得了 36.1% 的成績。雖然數字看似不高,但在目前即時音訊推理領域中已是領先群倫。這些數據說明了 Google 不僅在追求反應快,更在追求「聽得懂」與「做得對」。

落地應用:從個人手機到企業客服的全方位布局

Gemini 3.1 Flash Live 技術正迅速進入終端市場。首先受益的是 Android 與 iOS 平台上的 Gemini Live,使用者將體驗到回覆更快、停頓更少且能根據語境動態調整風格的全新互動體驗。

搜尋功能也迎來了重大變革。全新的 Search Live 搭配 AI Mode,支援語音與相機鏡頭的即時對話式搜尋。這項功能即日起已向超過 200 個國家與地區擴展,支援超過 90 種語言,徹底改變了使用者尋找資訊的方式。使用者只需開啟相機對著物體發問,AI 就能在觀看畫面的同時提供即時解答。

在企業市場方面,Google 推出了 Gemini Enterprise for Customer Experience 企業客服套件。目前已與 Home Depot、Verizon 以及語音技術公司 LiveKit 等展開合作測試。這項技術有望讓自動化客服系統不再冰冷死板,而是能像真人專員一樣進行有溫度、高效率的溝通。

安全防護:SynthID 音訊浮水印捍衛真實邊界

隨著 AI 生成語音變得越來越難以區分,社會各界對於 AI 濫用、語音詐騙的擔憂也日益增加。為了應對這一風險,Google 宣布所有由 Gemini 3.1 Flash Live 輸出的音訊都將內嵌 SynthID 數位浮水印。這種浮水印技術對人耳而言完全不可察覺,不會影響聽覺體驗,但專門的偵測工具卻能輕易識別。

此舉旨在防止 AI 生成語音被惡意偽裝成人類語音進行欺詐或傳播不實資訊。Google 強調,隨著 AI 對話能力的增強,確保內容可追溯與身分可辨識是技術發展中不可或缺的安全責任。

定價策略與未來展望

對於開發者而言,Gemini 3.1 Flash Live 的定價策略顯得相當明確。音訊輸入定價為每小時 0.35 美元,而音訊輸出則為每小時 1.40 美元。相較於其提供的高品質即時互動能力,這樣的定價顯示出 Google 推廣這項技術的野心。

總體而言,Gemini 3.1 Flash Live 不僅是模型參數的升級,更是從「靜態輸入輸出」轉向「動態即時流」的範式轉移。當 AI 不再需要經過文字轉譯的中介,能夠直接感知與回饋聲音的頻率與情緒時,我們與機器的界線正變得前所未有的模糊。這不僅提升了工具的易用性,更為未來具備視覺與聽覺意識的 AI 代理程式(AI Agents)奠定了堅實的基礎。