長期以來,在 Mac 上使用 Ollama 執行大型語言模型(LLM)時一直面臨一個根本性的瓶頸:統一記憶體(Unified Memory)的頻寬優勢,始終無法被充分發揮。傳統的 llama.cpp 搭配 Metal 加速,雖然能在蘋果晶片上運行模型,但因為沒有針對 Appke MLX 架構進行優化,所以表現一直並不理想。近日,Ollama 正式宣布整合 Apple MLX 框架,透過直接針對統一記憶體架構最佳化的設計,為 Apple Silicon 上的本地 AI 推論帶來質的飛躍。

最新版 Ollama 整合 Apple MLX 框架:Mac 本地 AI 推論速度飆升兩倍

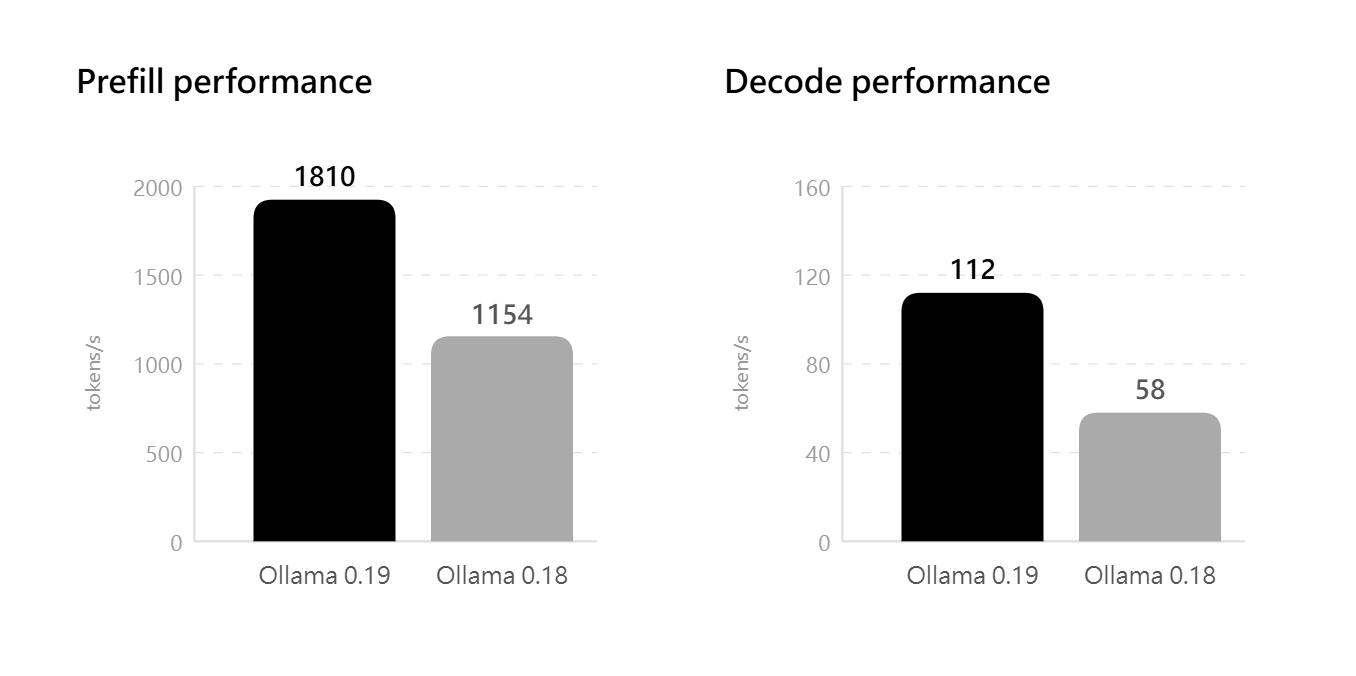

Ollama 在官方部落格上表示,新版 Ollama 0.19 採用 MLX 統一記憶體架構,直接解決了過去傳統推論引擎必須頻繁在 CPU 與 GPU 之間複製資料的效能損耗問題。根據多家獨立測試的數據,MLX 的速度優勢相當顯著:在 M4 Max 晶片上,MLX 的推論速度可達每秒 60 至 70 個 token,而傳統 Ollama(llama.cpp 搭配 Metal)約為 35 個 token/s,差距接近兩倍;若單看提示詞處理(prefill)階段,差距更擴大至五倍。

M5 晶片上 Qwen3.5-35B 的效能突破

根據 Ollama 官方公布的資料,配備 int4 量化格式的 Qwen3.5-35B-A3B 模型,在 M5 晶片上可達到每秒 1851 個 token 的前饋速度(prefill rate),以及每秒 134 個 token 的解碼速度(decoding speed)。這意味著,即便是一款 350 億參數規模的大型模型,如今在蘋果的高階硬體上已能實現流暢的即時互動,不再只是理論上可行。

不過完整的 35B 模型需要大量記憶體支援,根據測試,想要充分發揮這套新架構的效能,使用者需要一台配備 32GB 以上統一記憶體的 Mac 裝置。

| Chip | Qwen3.5-35B-A3B Q4 via Ollama | Qwen3.5-35B-A3B Q4 via MLX | MLX advantage |

|---|---|---|---|

| M1 Pro (16GB) | ~15-18 tok/s | ~25-35 tok/s | ~1.5-2x |

| M3 Pro (18GB) | ~18-22 tok/s | ~35-45 tok/s | ~1.8-2x |

| M4 Pro (24GB) | ~25-30 tok/s | ~45-55 tok/s | ~1.8x |

| M4 Max (64GB) | ~30-38 tok/s | ~60-75 tok/s | ~2x |

| M3 Ultra (192GB) | ~35-45 tok/s | ~70-90 tok/s | ~2x |

MLX 為何更快:統一記憶體架構的深度最佳化

要理解 MLX 的速度優勢,必須先了解傳統推論引擎在 Apple Silicon 上面臨的結構性問題。過去的 llama.cpp 搭配 Metal 方案,模型權重與計算過程中產生的資料,仍需要在 CPU 記憶體空間與 GPU 記憶體空間之間來回複製。這道資料複製的程序,在統一記憶體架構上並不會消失,反而因為蘋果晶片特殊的記憶體管理設計而產生額外開銷。

MLX 的核心突破,在於它從底層就以蘋果統一記憶體架構為設計前提。MLX 直接在統一記憶體中完成模型權重的儲存與運算,不再區分傳統意義上的 CPU 記憶體與 GPU 記憶體,徹底消除了跨空間複製的效能損耗4]。這種從硬體特性出發的原生最佳化,正是 MLX 能夠在相同硬體上展現壓倒性速度優勢的根本原因。

Ollama 0.19 這次更新的設計方向,不僅是效能提升,更瞄準了開發者工作流程中的實際需求。新版專為編碼代理(coding agent)場景進行優化,支援 Claude Code、OpenClaw 等主流開發工具。

快取與檢查點技術:對話體驗的全面改善

除了純粹的推論速度之外,Ollama 0.19 也在記憶體管理機制上做了重要改進。新版的快取(Caching)機制,允許在多輪對話之間重複使用已計算的內容,大幅降低重複處理相同提示詞的資源消耗。此外,「智慧檢查點」(smart checkpointing)技術能夠在提示詞處理的關鍵環節減少冗餘計算,進一步縮短回應延遲。

這些改進的綜合效果,意味著使用者在實際操作中將感受到更流暢的對話體驗,不只回應速度更快,模型在處理漫長的對話上下文時,也能維持更穩定的效能表現,不會因為上下文累積而出現明顯的延遲爬升。

對本地 AI 推論生態的影響與未來展望

Ollama 整合 MLX 的這一役,對於整個本地 AI 推論生態具有深遠的指標意義。在此之前,開發者與研究者若想在蘋果硬體上運行大型模型,往往需要在「速度」與「便利性」之間艱難取捨:傳統方案速度有限,而完整的最佳化方案往往需要繁瑣的手動編譯與參數調校。Ollama 0.19 的推出,在某種程度上降低了這道技術門檻,讓更多使用者能夠在蘋果生態系中直接受益於高效能的本地推論。

不過,此技術只是增加了模型的前饋與解碼速度,如果你要使用參數更大的模型,還是需要搭配規格更高、記憶體更大的 Mac 機型,這一點並不會因為 MLX 的進步有所差異,就如同 Google 剛推出的記憶體壓縮技術,並不會讓記憶體容量較小的機型能夠順暢使用更大參數的模型(但多少會有點改善),有興趣的朋友可以自己試試。