Google DeepMind 於 2026 年 4 月 2 日正式發布 Gemma 4 開源模型系列,一口氣推出四款不同規格的模型,全面覆蓋從旗艦級工作站到智慧型手機的應用場景。此次發布在技術規格上大幅超越前代 Gemma 3,更標誌著 Google 在開源授權策略上的重大轉向:Gemma 4 全面採用 Apache 2.0 許可,正式與過往客製化使用條款分道揚鑣。

Gemma 4 四款模型亮相:從旗艦到邊緣的全方位佈局

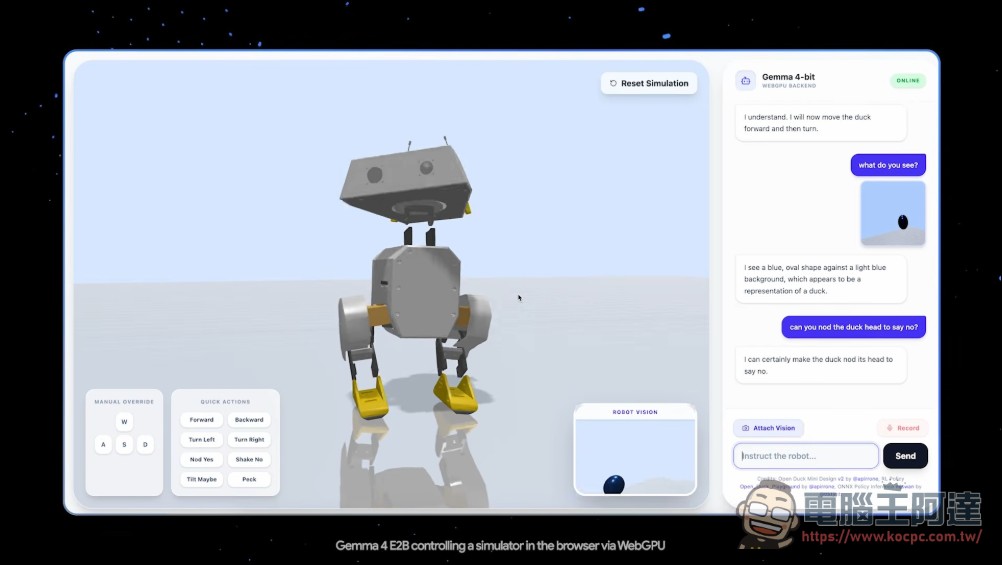

Gemma 4 系列共發表四款型號:旗艦級 31B Dense 瞄準高效能工作站,支援高達 256K 上下文窗口,在未量化的 bfloat16 格式下可完整容納於單張 80GB NVIDIA H100 GPU;26B MoE(混合專家)採用稀疏激活架構,推論時僅啟動 3.8 億參數,卻能提供不成比例的高速推論效率;E4B(有效 4B)以相當於 40 億參數的 footprint 運作,強調「近零延遲」表現;E2B(有效 2B)則專為手機與邊緣裝置而生,支援 128K 上下文窗口,可在 Raspberry Pi 5 上以完全離線狀態驅動智慧家庭控制器或語音助理。

| 型號 | 類型 | 總參數量 | 實際啟用參數 | Context Window | 目標硬體 |

|---|---|---|---|---|---|

| E2B | Effective 2B | 2B | 2B | 128K | 手機、IoT、Raspberry Pi |

| E4B | Effective 4B | 4B | 4B | 128K | 手機、Qualcomm/聯發科晶片 |

| 26B | MoE | 26B | 3.8B | 256K | 消費級 GPU、專業工作站 |

| 31B | Dense | 31B | 31B | 256K | 單卡 H100 (80GB) |

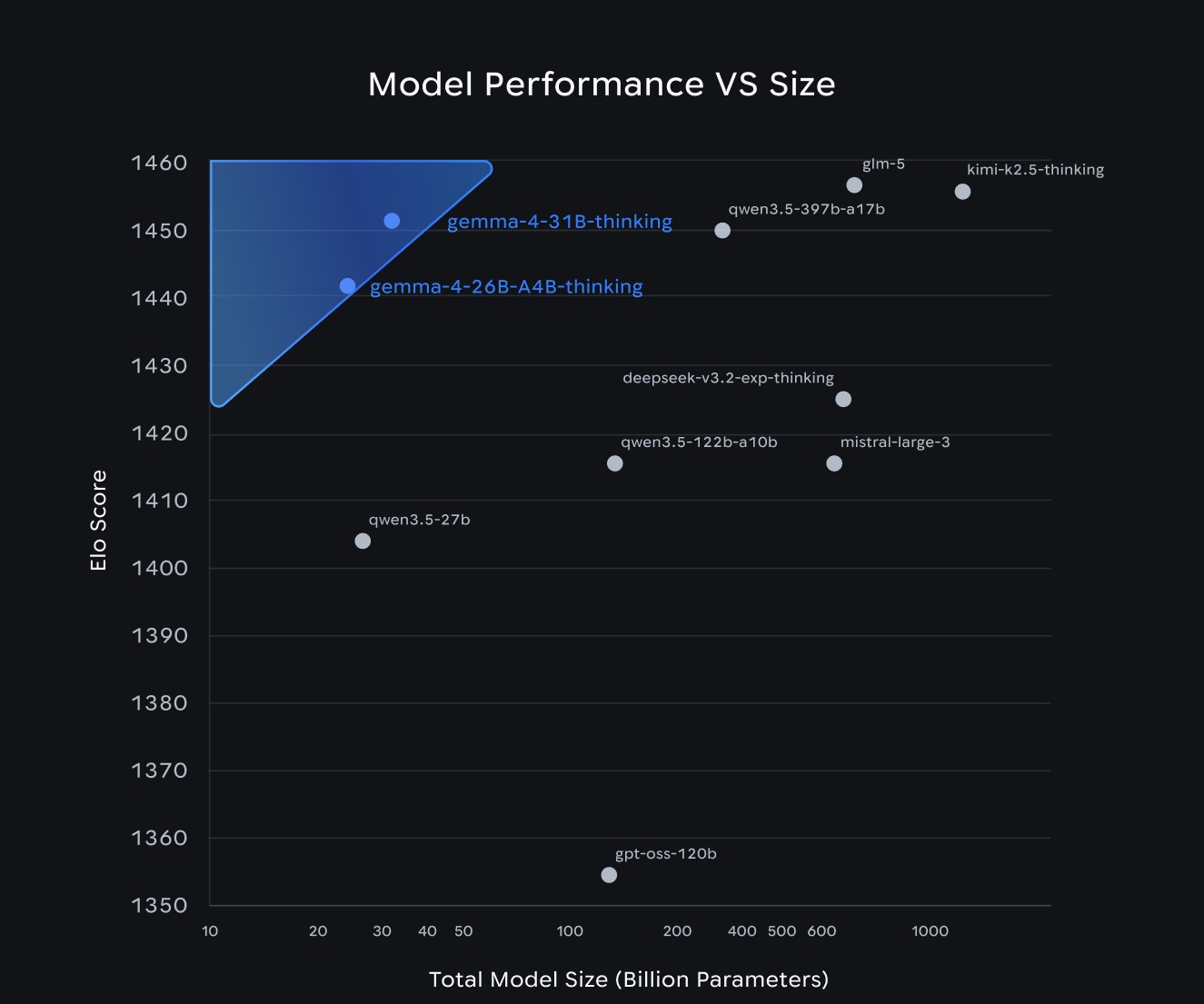

根據 Google 公布的資料,31B 模型在 Arena AI 文字排行榜的開放授權模型類別中暫居第三,僅次於 GLM-5 與 Kimi 2.5;26B MoE 型號則拿下第六名,且在各自參數量級中擊敗了尺寸逾 20 倍的競爭對手。Hugging Face 團隊預發布測試後直言:「它們開箱即用表現就已經如此出色,我們很難找到需要微調的良好範例」。

授權策略大轉向:拋開客製條款,全面擁抱 Apache 2.0

過往幾代 Gemma 模型採用 Google 自訂的「Gemma 使用條款」(Gemma Terms of Use),而非標準開放原始碼授權。該條款允許 Google 單方面更新禁止用途,甚至被解讀為允許 Google 對 Gemma 生成之合成資料所訓練出的其他 AI 模型主張權利,令不少開發者對商業使用抱持觀望態度。

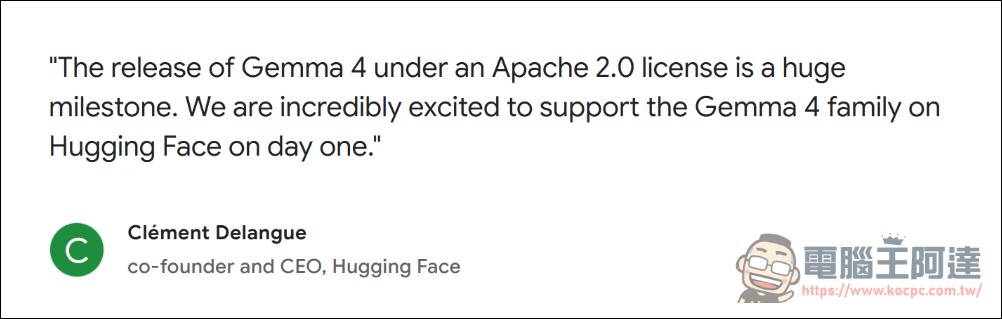

Gemma 4 的 Apache 2.0 授權則徹底扭轉了這一切。使用者可自由將模型用於任何目的(個人、商業或企業用途),無需支付任何權利金;可自由修改、再散布,甚至創作衍生作品,且 Google 無法單方面變更授權條款。此外,Apache 2.0 附帶專利保護,使用者自動獲得與貢獻內容相關的專利授權,不必擔心專利侵權控告。這一轉變被業界視為 Google 擴大「Gemmaverse」生態系號召力的關鍵一步。

原生 Agent 能力:從聊天邁向自主任務執行

2025 年以來,AI 產業的主流敘事已從「單次問答」轉向「Agent 工作流」(Agentic Workflow):讓 AI 能規劃多步驟任務、自主呼叫工具、搜尋資料庫、觸發外部 API,並在複雜情境中持續推理。Gemma 4 支援原生函式呼叫(Native Function Calling)、結構化 JSON 輸出,以及原生系統指令,開發者無需複雜微調即可構建能自主執行多步驟任務的 Agent 應用。

在 Google AI Edge Gallery 中,基於 Gemma 4 的「Agent Skills」功能已展示多個具體場景:查詢維基百科等知識庫以延伸模型即時資訊能力、將語音輸入轉化為睡眠與情緒趨勢圖表,甚至結合文字轉語音、影像生成或音樂合成,打造完整的離線端對端體驗。

多模態、邊緣部署與手機端藍圖

在多模態能力方面,Gemma 4 全系列均原生支援圖片與影片輸入,並能進行 OCR 文件識別、圖表理解等視覺任務。E2B 與 E4B 兩個邊緣模型更配備原生音訊輸入功能,可直接執行語音辨識與理解。上下文窗口方面,邊緣型號提供 128K Tokens,旗艦型號(31B 與 26B MoE)則提升至 256K Tokens,得以一次處理整個程式碼庫或長篇文件,無需分塊。Gemma 4 原生支援超過 140 種語言,無需額外訓練即可覆蓋全球主要市場的應用需求。

在手機端方面,Google 下一代 Pixel 手機的 Gemini Nano 4 將基於 Gemma 4 E2B 與 E4B 建構,規模為 2B 與 4B 兩種版本。開發者現已可在 Android AI Core 開發者預覽版中,以 Gemma E2B/E4B 為基礎提前原型化 Agent 工作流,待 Gemini Nano 4 正式發布時即可無縫接軌。

有興趣的朋友也可以看官方的介紹影片:

生態系全面上線:Hugging Face、Ollama、Kaggle 同步支援

在模型部署方面,Google 選擇全面擁抱開源生態系。Gemma 4 旗艦型號進駐 Google AI Studio,邊緣型號則透過 Google AI Edge Gallery 提供下載。模型權重同步釋出於 Hugging Face、Kaggle 與 Ollama,並已針對 Transformers、llama.cpp、MLX(Apple Silicon)、WebGPU 以及 Rust 等主流推論框架提供原生整合。

自 2024 年 2 月首代 Gemma 問世以來,開發者社群已累計下載 Gemma 模型超過 4 億次,催生出超過 10 萬個衍生變體,構建出蓬勃發展的「Gemmaverse」生態系。Google 表示,Gemma 4 的設計初衷正是為了解決開發者最迫切的需求:在自有硬體上,以合理成本,享有接近封閉式旗艦模型的推理能力與 Agent 構建彈性。