當 OpenClaw 將 AI Agent 從單純的對話框走向 24/7 全天候運行的「數位助理」時,原本與一般人沒什麼關係的 Token 用量被浮上台面。近日,開源專案 OpenClaw 遭到 AI 巨頭 Anthropic 的強硬封殺,引發了科技圈對第三方工具與模型供應商邊界的熱烈討論。然而,比較沒人關心的是,這場封殺大戲的背後核心原因並不是單純的 Anthropic 排外。最近超夯的小米 MiMo 大模型開發者負責人Fuli Luo(羅福莉) 在 X(原 Twitter)上指出,OpenClaw 被封殺的核心原因之一,其實源於其極其糟糕的上下文(Context)管理設計,這不僅浪費了驚人的運算資源,更讓 Claude 的負擔達到崩潰邊緣。

Two days ago, Anthropic cut off third-party harnesses from using Claude subscriptions — not surprising. Three days ago, MiMo launched its Token Plan — a design I spent real time on, and what I believe is a serious attempt at getting compute allocation and agent harness…

— Fuli Luo (@_LuoFuli) April 5, 2026

Token 消耗超一般用戶數十倍被封殺:解析 OpenClaw 技術債問題

「24/7 運作」的代價:永不停止的 Token 燃燒

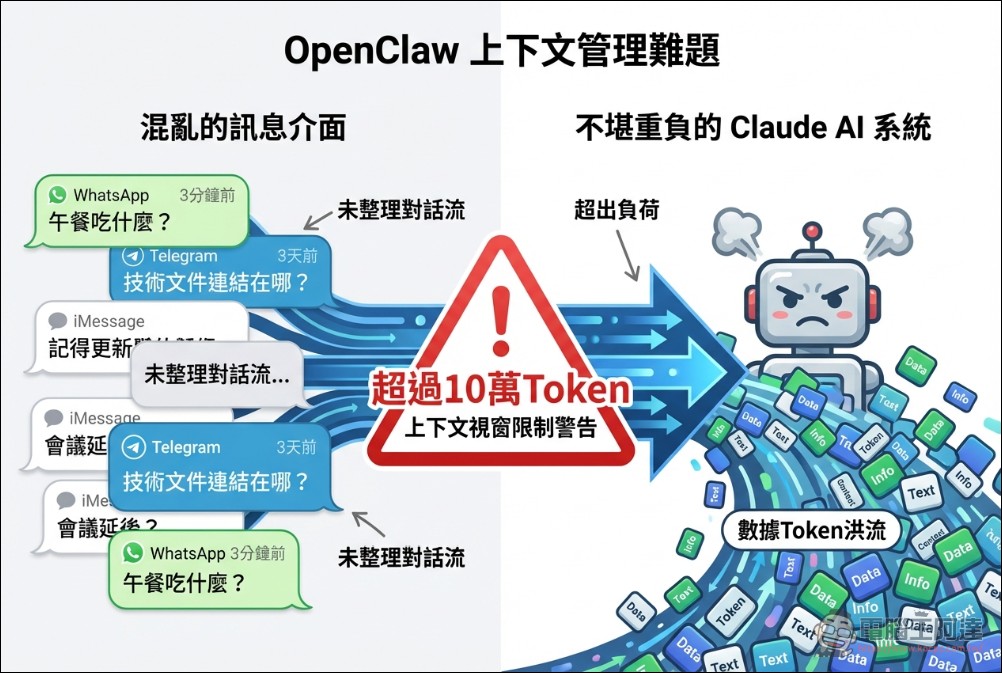

OpenClaw 的設計初衷是打造一個能夠在 WhatsApp、Telegram 或 iMessage 上持續運行的 AI 代理。這意味著它不像網頁版的 Claude 或 ChatGPT,使用者在完成一段對話後會關閉視窗、開啟新的主題;OpenClaw 是與使用者的通訊軟體深度綁定,對話歷史會隨著時間不斷累積。

問題在於,OpenClaw 本身缺乏一套智慧的上下文管理機制。根據羅福莉的觀察,OpenClaw 在處理每次互動時,幾乎是採取「暴力」策略:將當前的對話歷史,無論是三分鐘前討論的午餐內容,還是三天前處理的技術文件,全部一股腦地塞進當前的上下文視窗(Context Window)中,而且通常超過 10 萬以上 Token。

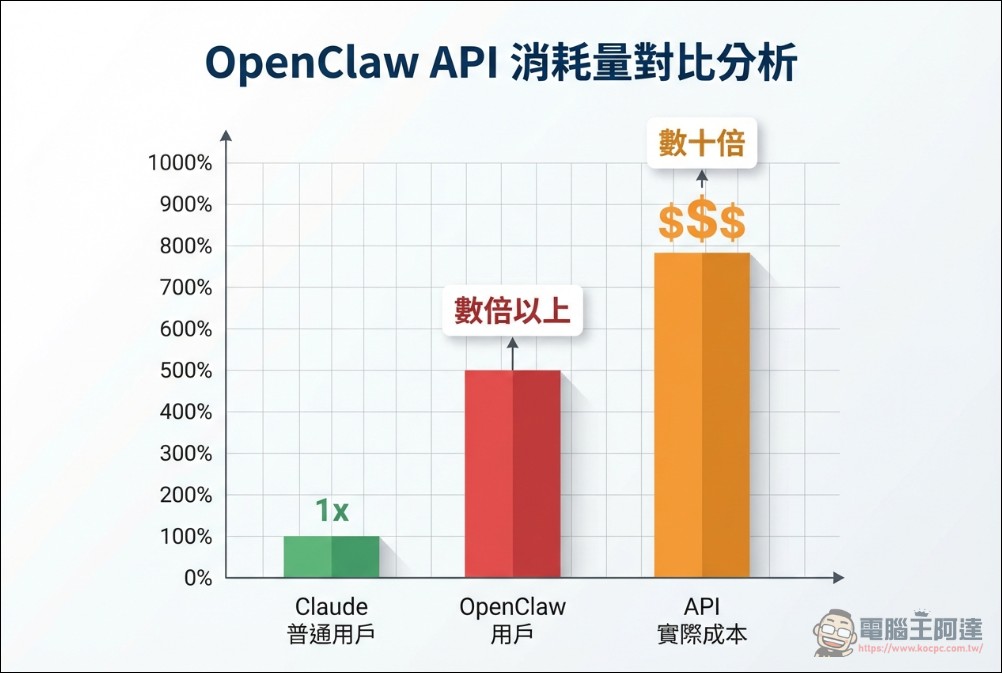

對於 Claude 這類服務商而言,這意味著每一次接收到 OpenClaw 使用者的簡短指令,它都必須重新閱讀數萬甚至數十萬 token 的不相關歷史。這種設計導致 OpenClaw 的 API 消耗量達到 Claude Code 普通用戶的好幾倍以上,如果換算成 API 定價,實際成本可能是訂閱價格的數十倍(更何況她也評估 Claude Max 其實也是賠錢的,還被 OpenClaw 這樣搞當然更加受不了)。

技術分析:被遺忘的壓縮與智慧丟棄機制

在現代 AI Agent 的開發規範中,上下文管理(Memory Management)是決定效能與成本的關鍵。成熟的系統通常具備以下三種核心機制,但 OpenClaw 卻在這些領域顯得極為匱乏:

- 上下文壓縮(Context Compression):將冗長的對話內容進行語意壓縮,保留關鍵訊息而去除贅字。

- 自動總結(Recursive Summarization):當對話歷史達到一定長度時,由模型自動生成一份「摘要」來替代原始對話,釋放 token 空間。

- 智慧丟棄(Smart Pruning):識別哪些資訊已過時或與當前任務無關,主動將其從上下文視窗中剔除。

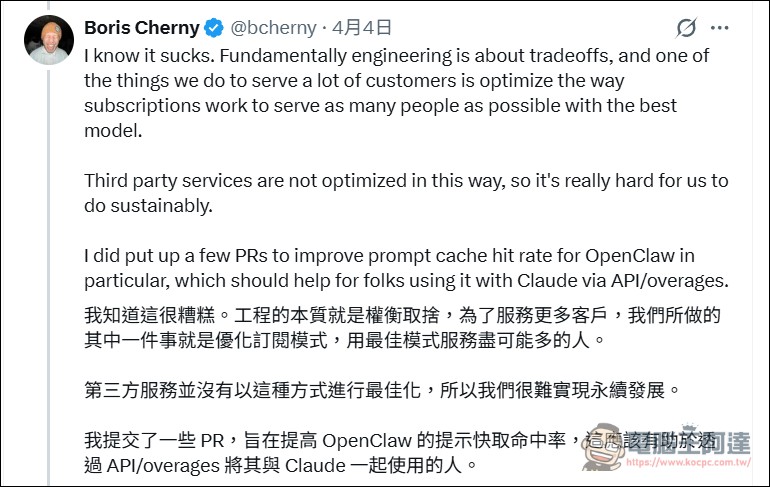

由於 OpenClaw 並未實作這些有效機制,其運作模式被業界形容為「在金閣寺裡放火」。Boris Cherny(Anthropic 旗下 Claude Code 的負責人)曾公開說明,部分第三方工具對系統造成了過大壓力,這些工具往往沒有針對用量進行最佳化,導致伺服器資源被無謂地空耗。 這種技術上的「便宜行事」,最終成了壓垮駱駝的最後一根稻草。

對比實驗:正常的 Claude 使用 vs. OpenClaw 瘋狂模式

為了理解這「數十倍」的消耗差距,我們可以建立一個簡單的對比場景。在正常的 Claude 網頁版或官方 App 中,當用戶開啟新對話時,上下文是從零開始計數的。即使在長對話中,Anthropic 官方也會透過後端演算法對過往對話進行快取與管理。然而,OpenClaw 作為一個中間層,它在每次請求時都會強制傳送完整的歷史紀錄給 API。

根據業界分析,一個支付 200 美元月費的 Claude Max 訂閱用戶,如果透過 OpenClaw 這種未經最佳化的工具進行高頻互動,其背後產生的算力成本可能等效於 5000 美元。 對於 Anthropic 而言,這不再只是商業授權的問題,而是一個嚴重的技術濫用漏洞。官方對 OpenClaw 的指控中明確提到該工具「未針對用量進行最佳化」(not optimized in this way)導致服務無法永續運行,這與其說是商業藉口,不如說是對 OpenClaw 開發團隊技術債務的公開指控。

結語:技術債務與 AI 生態的永續性

OpenClaw 的案例給所有 AI Agent 開發者敲響了警鐘。在 API 計費的時代,代碼的優劣不再僅僅體現在功能是否實現,更體現在資源的利用率上。OpenClaw 雖然實現了 24/7 的便捷存取,卻忽略了作為底層設施的 Claude 所承載的負擔。這不單純是 Anthropic 是否容許第三方客戶端的問題,更是一個單純的工程品質問題。

當開發者選擇走捷徑、不處理複雜的記憶體管理與上下文壓縮時,這些債務最終會由模型供應商支付。或者,如我們今日所見,由整個專案的生存權來償還。未來的 AI 代理若要實現真正的普及,如何在有限的上下文空間內發揮最大的智慧,將是比模型規模更為關鍵的競賽。OpenClaw 被 Anthropic 的封殺,標誌著「暴力堆疊 token」的方向可能需要重新檢視,也希望 OpenClaw 能夠處理改善這個問題。