傳統印象裡,如果要 AI 模型更聰明,就必須把它的規模做的更大,相對的就是更多參數、更多 GPU、更多電力、更多記憶體與更高的成本。這條路確實走得通,也催生出許多能夠進行長上下文推理、解決複雜問題、生成軟體、研究報告與創意內容的大模型。然而,這也鑄造了一道深層的結構性限制:最強大的智慧被困在巨大的資料中心叢集與專業基礎設施之中,邊緣裝置如:手機、筆電、車輛、機器人…幾乎沒機會使用好一點的本地端模型。近日一家從加州理工學院(Caltech)孵化的 AI 新創公司「PrismML」正式發表一款顛覆產品:1-bit Bonsai 8B 模型。這款模型將先進 LLM 模型濃縮至僅有 1.15 GB 的極小體積,能直接在 iPhone 17 Pro 上運行對話速度約每秒 40 個 token,被稱為「全球首款商業可行的 1 位元 LLM」。

什麼是 1 位元模型?

要理解 Bonsai 8B 的突破性,先得了解傳統模型與 1 位元模型的本質差異。

基於 Transformer 架構的 AI 模型,內含數百萬甚至數十億個「權重」(weights),這些權重控制著神經元之間連接的強度,並在訓練過程中決定模型執行任務的方式。傳統模型以 16 位元或 32 位元浮點數來表示每個權重:這意味著龐大的儲存空間與算力需求。

而 Bonsai 8B 採用了革命性的 1 位元架構:每個權重僅用 {-1, +1} 兩個值表示,配合分組共享的縮放因子(scale factor)來維持模型表現。Embedding 層、注意力層、MLP 層與 LM head 全部採用 1 位元設計,無任何更高精度的「逃生艙」。這是真正從頭到尾的 1 位元模型,橫跨 82 億個參數。

這個概念並非憑空而生。1 位元網路的研究可追溯至 2017 年 BitNet 論文,而 2024 年的「The Era of 1-bit LLMs」論文(又稱 BitNet b1.58)則確立了 1.58 位元的設計方向。PrismML 的突破在於,由 Caltech 電機工程學系教授 Babak Hassibi 領導的團隊,花費數年開發出必要的數學理論,終於能在壓縮神經網路的同時不喪失其推理能力。

智慧密度:重新衡量 AI 效率的關鍵指標

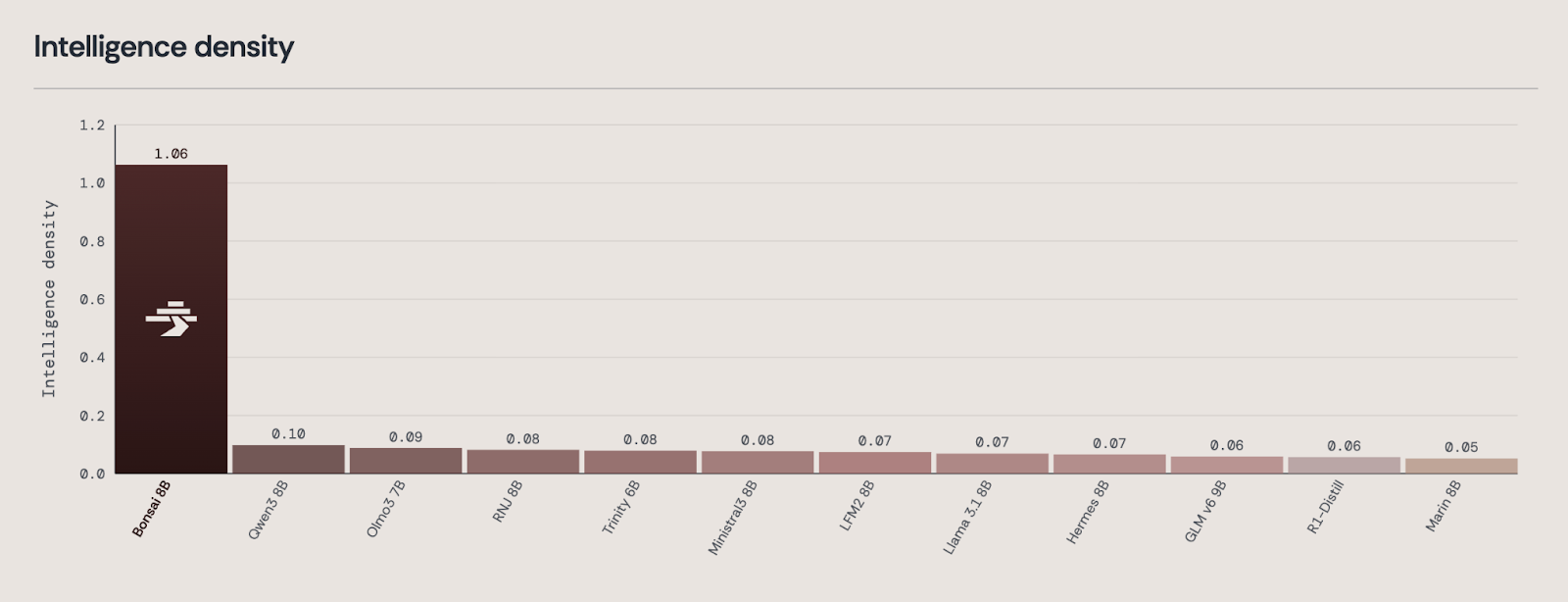

PrismML 提出了一個新的衡量標準:「智慧密度」(Intelligence Density)。傳統上,我們習慣用 benchmark 分數來比較模型能力,但這忽略了模型大小帶來的效率差異。PrismML 將智慧密度定義為:模型平均錯誤率之負對數值,除以模型大小(以 GB 為單位)。用這個指標來衡量,Bonsai 8B 的智慧密度達到 1.06/GB,而同參數級別的 Qwen3 8B 僅有 0.10/GB。Bonsai 不只是在這個指標領先,而是進入了完全不同的量級。

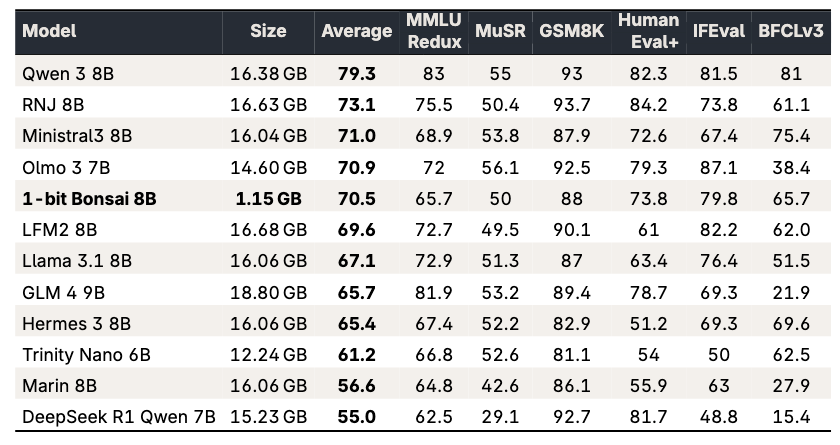

根據 PrismML 公布的測試數據,Bonsai 8B 的實際表現同樣令人印象深刻:

- 體積僅 1.15 GB,比同性能模型小約 14 倍

- 推理速度提升約 8 倍

- 在邊緣硬體上能源效率提升約 5 倍

- 能在 iPhone 17 Pro 上以每秒約 40 token 的速度運行(對比:16 位元 8B 模型在任何 iPhone 上都無法容納)

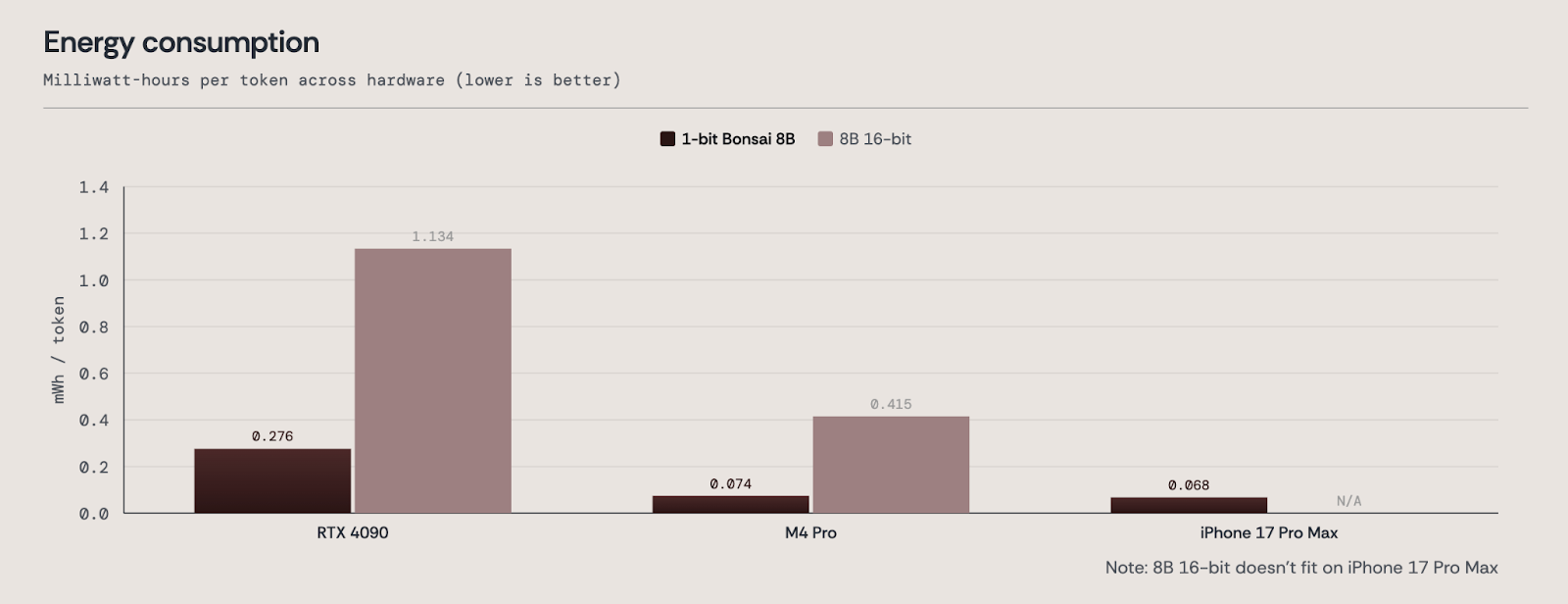

能耗部分也有相當顯著的差異,1 位元 Bonsai 8B 的能耗遠低於其 16 位元全精度版本,能源效率約提升 4-5 倍。在 M4 Pro 上,其能耗為 0.074 毫瓦時/秒,而在 iPhone 17 Pro Max 上,其能耗僅為 0.068 毫瓦時/秒。

官方的測試範例,他們在 iPhone 17 Pro 上運行的 1 位元 Bonsai 8B 機型速度約為 40 toks/秒,標準的 16 位元 8B 模型無法在任何 iPhone 上運作。為了進行比較,還展示了在相同的 MATH-500 提示下運行的 16 位元 1B 模型,速度為 23 toks/秒,突顯了精度和速度的巨大差距:

在各種裝置上,Bonsai 的吞吐量也有顯著提升。在 M4 Pro Mac 上,其吞吐量可達每秒 131 個 Tokens;在 RTX 4090 上,可達每秒 368 個Tokens;在 iPhone 17 Pro Max 上,其吞吐量約為每秒 44 個 Tokens,以下是在 M4 Pro Mac 上運行的 1 位元 Bonsai 8B 與標準的 16 位元 8B 模型的表現:

Agent 能力測試,在 M4 Pro Mac 上執行 1 位元 Bonsai 8B,同時執行一個標準的 16 位元 8B 模型,模擬在本地運行的長期智能體任務:

Bonsai 8B 的智慧密度得分是 Qwen3 8B 的 10.6 倍;若只看原始 benchmark 平均分數,提升幅度更可達 12.7 倍。PrismML 解釋,智慧密度指標更重視高精確度區間的改進,因為越接近完美表現,每一分進步都越困難。

打破「壓縮必降能」的黑咒

過去模型壓縮技術始終伴隨著痛苦的取捨。低位元模型往往在指令遵循、多步推理與可靠的工具使用上喪失過多能力,無法作為主力模型的基礎。但 Bonsai 扭轉了這個局面。PrismML 宣稱,1 位元模型不必是狹隘的犧牲品:它們可以是有能力的、可部署於生產環境的系統。Bonsai 8B 在標準 benchmark 測試中,與同參數級別的 16 位元模型相比毫不遜色,卻以極小的體積與功耗實現了這一切。

「我們將 1 位元視為終點,更視為起點。」PrismML 執行長兼創辦人 Babak Hassibi 表示:「我們相信,未來 AI 的重大突破,將由智慧密度的數量級提升所驅動,而非僅僅依靠參數計數的膨脹。」

邊緣 AI 的時代正式來臨

當先進模型變得足夠小、足夠快、足夠節能,能在本地運行時,AI 的設計空間將立即改變。

PrismML 描繪了 Bonsai 開啟的應用藍圖:

產品回應更快:智慧能在裝置上運行,大幅降低延遲。

系統更注重隱私:敏感資料無需離開裝置或跨越組織邊界。

應用更可靠:不再依賴持續的雲端連線。

偏遠地區 AI 終於可行:過去伺服器端部署成本過高的場景,如今都能承擔。

全新的應用類別也將相繼浮現:持久化本地代理(persistent on-device agents)、即時機器人技術、安全企業 Copilot、離線智慧,以及為頻寬、電力或合規限制而過去無法使用先進模型的 AI 原生產品。AI 的未來不會僅限於雲端。它將橫跨雲端、邊緣,以及兩者之間的一切。

PrismML 的成立理念,正是為了解決 AI 發展中一個根本性的失衡問題:最強大的智慧被困在最昂貴的基礎設施中。執行長 Hassibi 指出,AI 的部署位置與其真正需要發生的場所之間,存在著深刻的錯位。

目前,Bonsai 模型已可在 Hugging Face 上下載,支援 GGUF 格式與 MLX 格式,開發者可將其部署至各類邊緣裝置與本地環境。

結語

從 DeepSeek 掀起的高效率模型風潮,到現在 PrismML 的 1 位元 LLM,AI 產業正在經歷一場典範轉移。過去那種「越大越好」的線性成長邏輯正在受到挑戰,取而代之的是對「智慧密度」的追求:在更小的體積、更低的功耗下,提供更強大的 AI 能力。Bonsai 8B 的出現,證明了這條路不僅可行,而且已經準備好走向商業化。AI 的下一步,將不再只是雲端軍備競賽,而是遍及每台手機、每輛汽車、每個工廠與每間辦公室的智慧網路。這場革命的鳴槍聲,已經響起。