影視後製業界有一個公開的秘密:從影片中移除一個物體很容易,但讓畫面看起來「它從來不存在」卻極度困難。拿掉畫面中拿著樂器的演員,畫面可能會留下一把懸空的樂器的詭異畫面(正常來說吉他應該要調落到地面)。過去,好萊塢視覺特效團隊往往需要耗費數週時間,才能修復這類問題。2026 年 4 月,Netflix 研發團隊攜手索菲亞大學「St. Kliment Ohridski」的 INSAIT 機構,共同發布了開源影片物體移除框架「VOID」(Video Object and Interaction Deletion)。這個模型不只能「P 掉」畫面中的物體:它還能理解該物體消失後,場景中其他物件應該有什麼樣的物理反應。

過往技術的盲點:只修像素,不懂物理

要理解 VOID 的突破性,必須先了解現有技術的局限。目前大多數影像編輯工作流程中使用的標準影片修補模型(video inpainting),本質上是一種極度精密的「背景繪畫師」。它們被訓練來填補物體被移除後的像素區域,但從不推理因果關係:如果我移除一個拿著道具的演員,那個道具接下來該怎麼樣?

現有的影片物體移除方法擅長修補物體「背後」的內容,並能修正陰影、倒影等外觀層面的瑕疵。然而,一旦被移除的物體與場景中其他物件有更實質的互動:例如碰撞:現有模型就會失敗,產生不合邏輯的畫面。

VOID 的核心創新:物理感知的神經網路

VOID 建構在 CogVideoX 架構之上,並針對具有互動感知遮罩條件的影片修補進行了微調。其關鍵創新在於模型理解場景的方式——不僅問「我應該填補哪些像素?」,更問:「這個物體消失後,什麼在物理上才是合理的?」

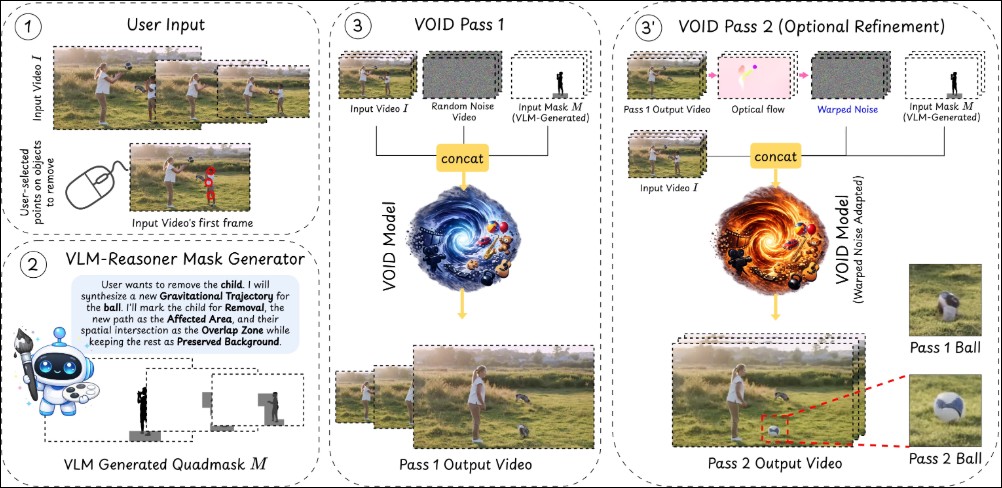

VOID 的工作流程分為兩個階段:

第一階段(First Pass): 使用者點選要移除的物體後,系統內建的 VLM(視覺語言模型)推理管線會識別場景中哪些區域會受到因果影響:哪些物件會倒下、碰撞或改變軌跡。這些區域被編碼成所謂的「四極遮罩」(quadmask),引導擴散模型生成物理上一致、反事實的影片結果。

第二階段(Pass 2 Refinement): 若第一階段產生所謂的「物體變形」(object morphing)瑕疵:這是小型影片擴散模型的已知失敗模式:系統會使用來自第一階段的流量變形噪聲重新執行推理,沿新合成的軌跡穩定化物體形狀。

研究論文中的經典範例完美展示了 VOID 的能力:如果移除畫面中拿著烏克麗麗的人,VOID 也會移除這個人對吉他的影響:讓吉他自然落地。

這看起來簡單,實則極度複雜。模型必須理解吉他是被這個人支撐著的:也就是所謂的「支撐關係」(support relationship)。唯有理解這種物理因果,移除後的畫面才會自然可信,而非出現懸浮道具這種明顯的瑕疵。

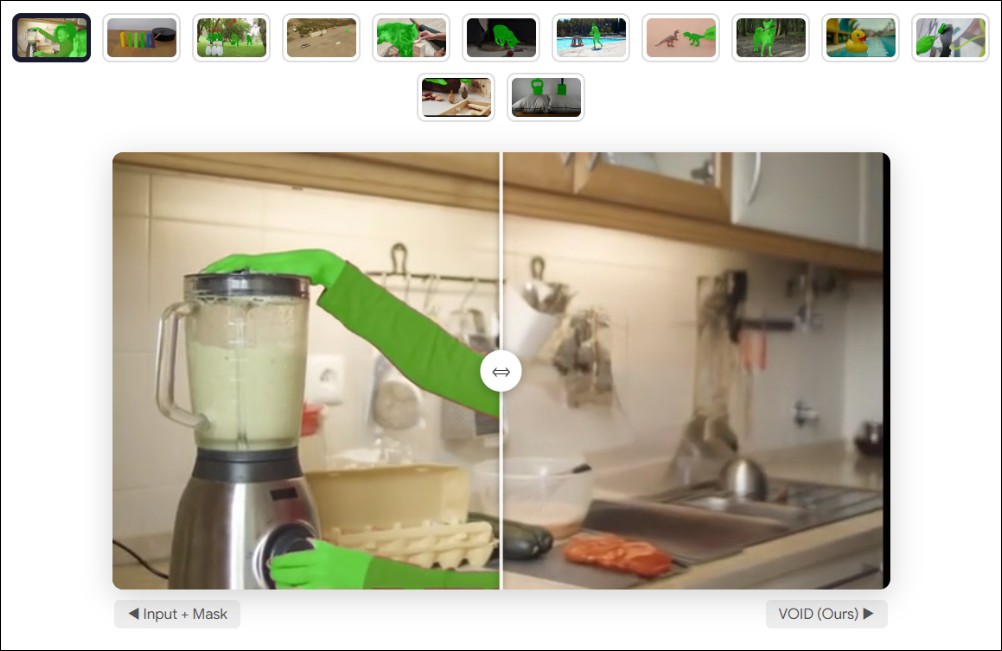

VOID 的官方網站提供了多個互動式比較展示,包含保齡球、堆疊的多米諾骨牌、汽車碰撞、貓咪玩積木等多種場景。使用者可以拖曳滑桿,親眼對比輸入畫面與 VOID 輸出之間的差異(建議大家去官網看看,互動範例很多)。

訓練數據:Kubric 與 HUMOTO

VOID 的訓練採用了兩個重要的合成數據集:

Kubric: 一個用於生成具有物理模擬的合成影片數據的框架,用於創建包含物體碰撞、倒塌等物理互動的場景。

HUMOTO: 用於人類動作的物理模擬數據集,專門處理人體與物件互動的場景。

每個訓練範例都包含三部分:輸入影片、四極遮罩,以及作為地面事實(ground truth)的反事實影片。這種成對的數據設計,使模型能夠精確學習「移除某物後,正確的物理結果應該是什麼」。

開源授權:Apache 2.0,免費商業使用

VOID 採用 Apache 2.0 授權,免費開放全球商業使用,所有影視製作公司、特效工作室或任何規模的創作團隊,都可以自由下載、使用並將其整合進商業產品中,無需支付任何授權費用。

影視後製的遊戲規則改變者

對於影視產業而言,VOID 的出現代表著後製成本與時間門檻的根本性改變。過去,拍攝完成後若發現某個道具、演員或元素需要移除,劇組通常只有兩個選項:花費高昂成本進行補拍,或接受畫面中無可挽回的瑕疵。現在,VOID 提供了一個全新的捷徑——不只移除物體本身,更自動計算並填補其物理互動所留下的空白。

除了影視特效之外,VOID 的技術潛力也延伸至遊戲過場動畫、直播影片修正、教育影片製作乃至虛擬實境內容生成等多個領域。