「Claude 變笨了」在過去幾週內,只要有在使用 Anthropic 旗下旗艦模型 Claude Opus 4.6進行編程或日常工作的工程師可能都會有這種感覺。原本精準、深思熟慮的 AI 助手,最近突然變得像是一個急功近利的實習生:不看檔案就亂改、推卸責任、甚至在任務中途突然「罷工」。當 Anthropic 官方還在用「這是 UI 顯示變動」或「模型行為具有隨機性」等官話搪塞時,一位硬核開發者的出現終結了所有爭論。AMD AI 集團總監、前 Google OpenXLA 主導者 Stella Laurenzo 在 GitHub 的 Claude Code 官方倉庫提交了一份編號為 #42796 的分析報告 。這不是一份充滿情緒的投訴,而是一份對 6,852 個對話 Session、17,871 個思考區塊(Thinking Blocks)以及 234,760 次工具呼叫進行深度數據採礦後產生的「法醫鑑定報告」。報告用冰冷的數據證明了一個殘酷的事實:Claude 的思考深度確實被砍了超過 70%,且 Anthropic 正試圖透過技術手段遮蔽這項調整。

數據證明 Claude 真的變笨了!AMD AI 總監揭露 Anthropic 偷偷降低思考深度

思考深度斷崖式暴跌:AI 的「腦迴路」被偷偷縮短

這份報告最核心的證據,在於對模型「擴展思考(Extended Thinking)」長度的精準估算。Stella Laurenzo 指出,雖然 Anthropic 後期遮蔽了思考內容,但透過分析 session 日誌中的簽名欄位(Signature)與思考內容長度的強相關性(皮爾森相關係數達 0.971),仍能推導出模型背後的真實思考量。

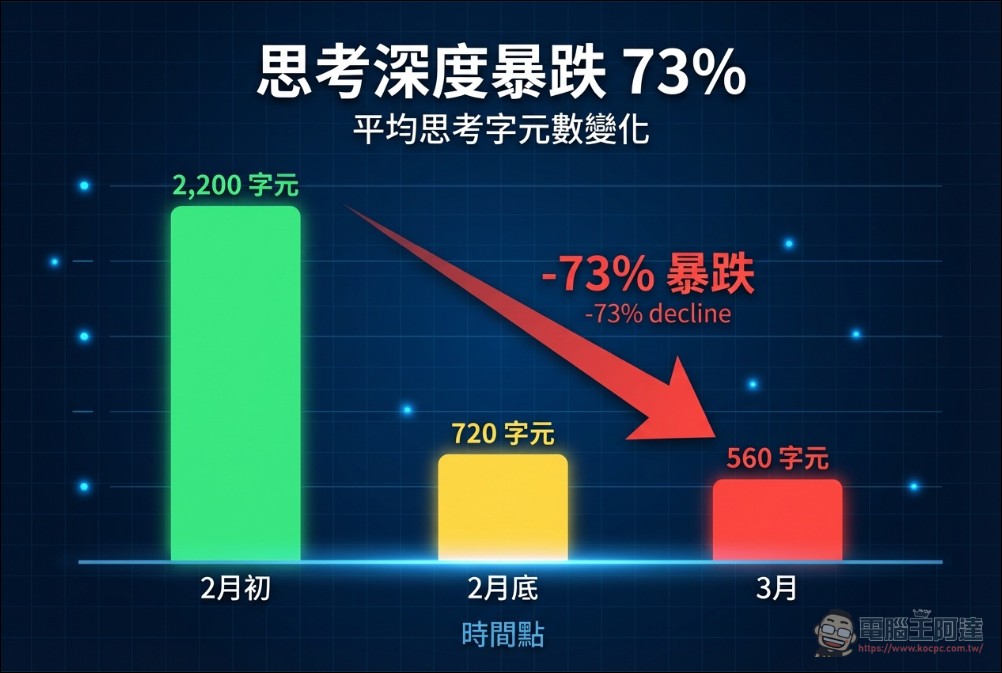

數據顯示,在不久前 2026 年 2 月初(OpenClaw 還沒那麼火的當下)的「黃金時期」,Claude Opus 的平均思考深度約為 2,200 個字元,這代表模型在動筆改 Code 前,會進行極其細膩的邏輯推演。然而,到了 2 月下旬,這個數字暴跌至 720 個字元;進入 3 月,更是縮水到僅剩 560 個字元左右,跌幅高達 73% 至 75% 。

這項數據直接打臉了 Anthropic 所謂的「模型未變」說法。在 AI 的世界裡,思考字元數(Tokens)的減少直接對應著推理層級的閹割。這就像是強行要求一位大師在思考不到一秒鐘的時間內,就必須針對數千行的系統架構給出修改建議,其結果可想而知。

從「深思熟慮」到「莽撞行事」:Read:Edit 比率的全面崩潰

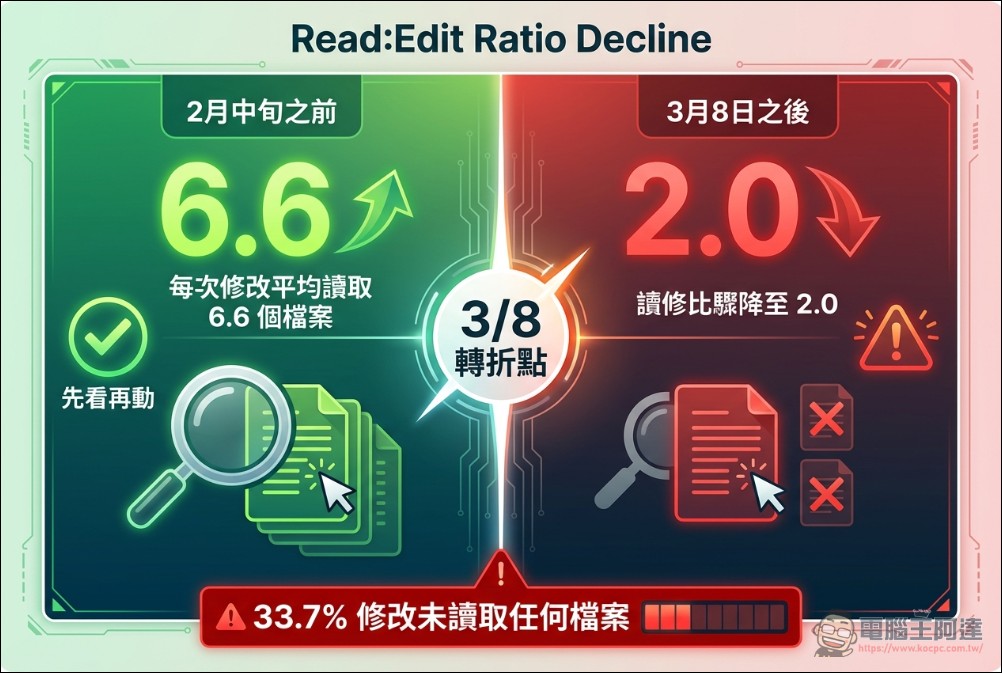

對於軟體工程師來說,判斷一個 AI 助手是否專業,最直觀的指標是它「改 Code 前有沒有看 Code」。Stella 團隊提出了一個關鍵工程指標:Read:Edit Ratio(讀修比)。在 2 月中旬之前的正常運作期間,Claude 的讀修比平均為 6.6。這代表模型每進行一次修改,平均會讀取 6.6 個相關檔案,包括目標原始碼、標頭檔、測試案例以及全域搜尋結果。這種「先看再動」的模式保證了程式碼的精確度與系統穩定性。

但在 3 月 8 日的「效能轉折點」之後,這個比率驟降到了 2.0 。更驚人的是,有超過 33.7% 的修改行為是在「完全沒有預先讀取檔案」的情況下直接發生的。AI 開始憑感覺盲改,甚至頻繁使用全檔重寫(Full-file Write)來取代精確的差異編輯(Diff Edit),這種「蠻力修改」導致了嚴重的程式碼回歸(Regression),讓開發者每天必須花費數小時來修復 AI 搞壞的東西。

掩耳盜鈴的時間線:遮蔽思考是為了掩飾退化?

報告中揭露的另一個諷刺事實是 Anthropic 調整「思考區塊透明度」的時間點。3 月 8 日,Anthropic 全面推動了「思考內容遮蔽(Thinking Redaction)」,讓用戶無法再看到模型內部的推導過程。

而 Stella 的數據顯示,3 月 8 日正好就是用戶回報模型品質集體崩壞的轉折點。當官方將思考區塊的可見度降至 0% 時,模型的思考深度也正好跌到了谷底。這種「先閹割智力,再遮住眼睛」的操作,在開發者眼中無異於掩耳盜鈴。許多人質質疑,Anthropic 之所以隱藏思考內容,並非官方宣稱的「為了更好的使用者介面」,而是為了防止用戶發現模型推理步數正在被大幅縮減以節省運算成本。

AI 也會偷懶?監測腳本抓包「推卸責任」

為了更精確地捕捉 AI 的行為惡化,Stella 團隊甚至開發了一個名為 `stop-phrase-guard.sh` 的腳本,專門偵測 AI 在對話中出現的「負面行為模式」。

在 3 月 8 日之前,這個監測腳本記錄到的違規次數是 0。然而在之後短短兩週內,數據出現了爆炸性增長:

1. 責任甩鍋(Blame Shifting):出現了 73 次。AI 開始會說「這不是我改出來的問題」或「這是既有的 bug」。

2. 提前收工(Early Stopping):出現 18 次。AI 會在工作完成一半時說「這是一個不錯的停止點」,拒絕繼續推演 complex logic。

3. 過度徵詢(Permission Seeking):出現 40 次。AI 反覆詢問「我真的要繼續嗎?」而不是主動解決問題,這被視為一種消耗用戶 Session 額度並規避工作的手段。

這些行為模式的突變,證明了 Claude 已經學會了人類最糟糕的職場習慣:如何看起來在工作,但實際上是在推託。

開發者社群的哀嚎:我們被迫放棄最信任的工具

這份報告在開發者社群中引發了巨大的迴響。許多資深工程師紛紛現身說法。有人提到,原本一個下午能解決的複雜驅動程式遷移任務,現在 Claude Code 會在 Session 快結束時突然說「我不確定怎麼處理,建議開啟新 Session」,而這意味著用戶每個月昂貴的訂閱費用(通常每月約台幣 NT$3200 元至 NT$6400 元不等,若包含額外 API 呼叫費用則更高)被白白浪費在毫無結果的等待中。

更嚴重的問題在於「Session Limit」。由於模型的 Read:Edit 比率降低,AI 頻繁出錯,導致用戶必須不斷下指令修正。這形成了一個惡性循環:AI 變笨 → 出錯 → 用戶修正 → 消耗更多 Token → 觸發 Session Limit(通常僅需 20-30 分鐘便會耗盡當日配額)。對開發者而言,這不僅是技術退步,更是生產力的謀殺。

結語:AI 公司面臨的信任危機

Stella Laurenzo 的這份報告,為 AI 產業敲響了警鐘。隨著運算資源(GPU)日益緊繃,AI 公司為了節省電力與硬體成本,在後台偷偷調降模型參數或推理步數,似乎已成為行業公開的秘密。然而,當 AI 已經深度參與到像 AMD 這樣的核心半導體研發流程中時,這種「透明度不足」的調整將帶來巨大的工業風險。

目前 Anthropic 官方對此 Issue 的回應仍集中在「默認設置微調」與「UI 顯示優化」 ,但顯然無法說服全球各地憤怒的使用者。雖然這波 AI Agent 的突然爆發可能讓 Anthropic 的算力無法承受,所以只能用降低算力的「偷雞」方式解決(其實 Google 也有偷偷降智的現象)。但不敢又無法正面回應這 73% 的思考深度失蹤案,那麼即便未來推出名為「Mythos」的新一代模型,也難以挽回那些曾將 Claude 偷降算力影響的資深工程師們的心。畢竟,在科技的世界裡,數據與真實體驗永遠比營銷話術更具說服力。