在開源界頗受好評的中國 AI 新創 MiniMax(稀宇科技)正式於 Hugging Face 開源自家最新的 MiniMax M2.7 模型。這是 MiniMax 迄今最強大的開源大語言模型,也是該公司首個能深度參與自身開發流程的「自主進化型」模型。根據官方公布的基準測試數據,M2.7 在軟體工程、專業辦公與多代理協作三大領域均有突破性表現,部分指標已與全球頂級封閉模型並駕齊驅。

We’re delighted to announce that MiniMax M2.7 is now officially open source.

With SOTA performance in SWE-Pro (56.22%) and Terminal Bench 2 (57.0%).You can find it on Hugging Face now. Enjoy!🤗

huggingface:https://t.co/lyDLCyPqsy

Blog: https://t.co/tTzoxgUTud

MiniMax API:… pic.twitter.com/qzIW5fX8X7— MiniMax (official) (@MiniMax_AI) April 12, 2026

MoE 架構加持:只啟動必要的專家神經元

M2.7 採用混合專家(Mixture-of-Experts, MoE)架構,透過動態激活所需的專家神經元區塊,而非全模型運行,大幅降低推論成本與延遲。這種設計讓 M2.7 在保持高效能的同時,具備更具競爭力的部署成本。

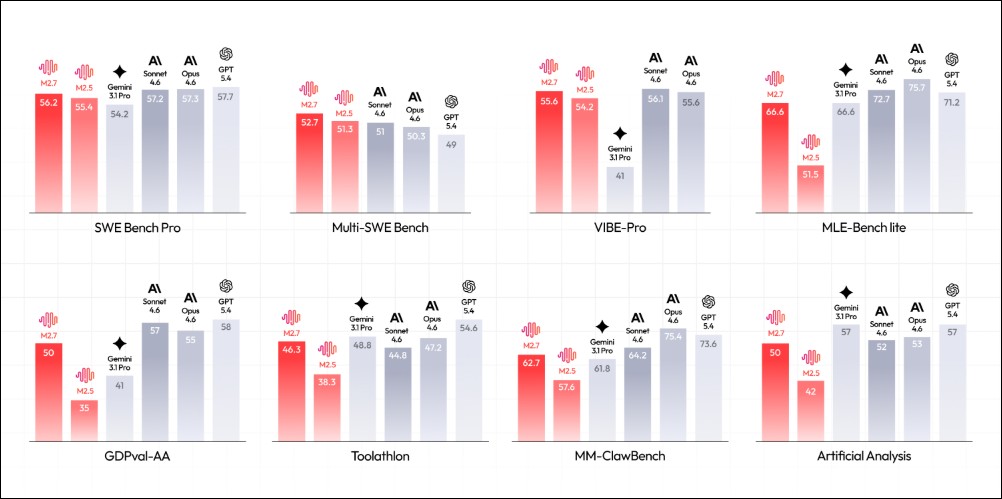

SWE-Pro 基準測試:56.22%,追上 GPT-5.3-Codex

在軟體工程領域最具指標性的 SWE-Pro 基準測試中,M2.7 拿下 56.22% 的準確率,號稱與 GPT-5.3-Codex 並駕齊驅。SWE-Pro 涵蓋日誌分析、Bug 排查、程式碼安全審查與機器學習除錯等任務,比一般演算法解題更接近真實生產環境。

在其他關鍵評測中:

- Terminal Bench 2(複雜系統理解):57.0%

- VIBE-Pro(完整專案交付):55.6%,幾乎與 Opus 4.6 持平

- SWE Multilingual:76.5%

- Multi SWE Bench:52.7%

生產環境實測:故障修復時間壓縮至 3 分鐘內

M2.7 的能力不僅停留在基準測試。MiniMax 團隊記錄了模型在真實生產環境中的表現:當系統發出監控警報時,M2.7 能自動關聯監控指標與部署時間線,進行因果推理、執行追蹤數據的統計分析並提出假設、主動連接資料庫驗證根本原因,找出程式碼中缺失的索引遷移檔案,並使用非阻塞式索引建立來止血,整個流程結束後再提交合併請求。MiniMax 指出,該模型已多次將生產事故的修復時間縮短至 3 分鐘以內。

自主進化:100 輪最佳化循環、30% 效能提升

M2.7 最備受矚目的特性,在於其「自我進化」能力。MiniMax 團隊讓 M2.7 自行負責模型程式設計效能的優化工作:模型以完全自主的方式,執行「分析失敗軌跡→規劃變更→修改框架程式碼→運行評估→比較結果→決定保留或回滾」的最佳化循環,總共運行超過 100 輪。

在這個過程中,M2.7 自動發現了多項有效優化策略:系統性搜索溫度(temperature)、頻率 penalty 與 presence penalty 等採樣參數的最優組合;設計更精確的工作流程指引(例如在修復某個 Bug 之後,自動在同一專案其他檔案中搜索相同問題模式);為代理迴圈新增循環偵測機制。最終,M2.7 在內部評估集中達成 30% 的效能提升。

在 MiniMax 自身的強化學習研究流程中,M2.7 目前已能獨立完成 30%–50% 的端到端工作,人類研究員只需在關鍵環節參與決策與討論。

MiniMax 工程負責人 Skyler Miao 在 X 上表示:「我們刻意訓練模型在規劃與使用者需求確認上表現更好。下一步是引入更複雜的使用者模擬器,進一步擴展這項能力。」

Great observation. We intentionally trained the model to be better at planning and at clarifying requirements with the user. Next step is a more complex user simulator to push this even further. https://t.co/JwT4UifJ98

— Skyler Miao (@SkylerMiao7) March 18, 2026

MLE Bench Lite:機器學習競賽奪牌率 66.6%

MiniMax 團隊也將 M2.7 投入 MLE Bench Lite 測試:這是 OpenAI 開源的評測套件,內含 22 項可在單張 A30 GPU 上運行的機器學習競賽,涵蓋幾乎所有 ML 工作流程階段。

實驗設計極為精簡:僅配備短期記憶、自我回饋與自我優化三個元件。每輪迭代結束後,代理會生成短期記憶標記檔、針對當前結果進行自我批評,並為下一輪提供優化方向。三次獨立實驗,每次給予 24 小時的迭代演化時間。

最終結果:最佳一次實驗奪下 9 金、5 銀、1 銅。三次實驗的平均奪牌率為 66.6%,僅次於 Opus 4.6(75.7%)與 GPT-5.4(71.2%),與 Google Gemini 3.1 並駕齊驅。

專業辦公表現:幻覺率大幅压低至 34%

在專業辦公領域,M2.7 於 GDPval-AA 評測拿下 ELO 1495 分,為目前所有開源可及模型中之最高分。

M2.7 在幻覺控制上也有顯著進步:AA-Omniscience Index 從前代 M2.5 的負 40 分一躍升至正 1 分;幻覺率僅 34%,低於 Claude Sonnet 4.6 的 46% 以及 Gemini 3.1 Pro Preview 的 50%。

Agent Teams:原生多代理協作框架

M2.7 支援 MiniMax 所提出的 Agent Teams 框架,實現原生多代理協作。模型能構建複雜的 Agent 框架,結合動態工具搜索、複雜技能調用,完成高度專業化的生產力任務。

此外,該模型還配備 OpenRoom 互動系統,將 AI 交互從純文字擴展至視覺化介面,支援即時場景反饋與高度擴展性。

模型取得方式

M2.7 現已開源,模型權重已於 Hugging Face 公開,有條件的人可以嘗試自己部屬使用,同時也可透過 MiniMax API 使用。