近日,NVIDIA GEAR Lab 負責人、傑出科學家 Jim Fan 在紅杉資本(Sequoia Capital)4 月舉辦的 AI Ascent 2026 大會講座中,分享了「Robotics’ End Game」的 20 分鐘演講。與去年談及「物理圖靈測試」的謹慎樂觀不同,這次他帶來了一份更為大膽的路線圖:直接宣告過去三年主導機器人領域的 VLA(Vision-Language-Action,視覺-語言-動作)架構已經過時,並提出了一套名為世界行動模型(World Action Models,WAM)的全新範式。這不僅是技術路線的轉向,更是一份直指 2040 年完成「物理 AGI」的戰略宣言。

從 DGX-1 簽名到底層同構:一場跨越十年的平行複製

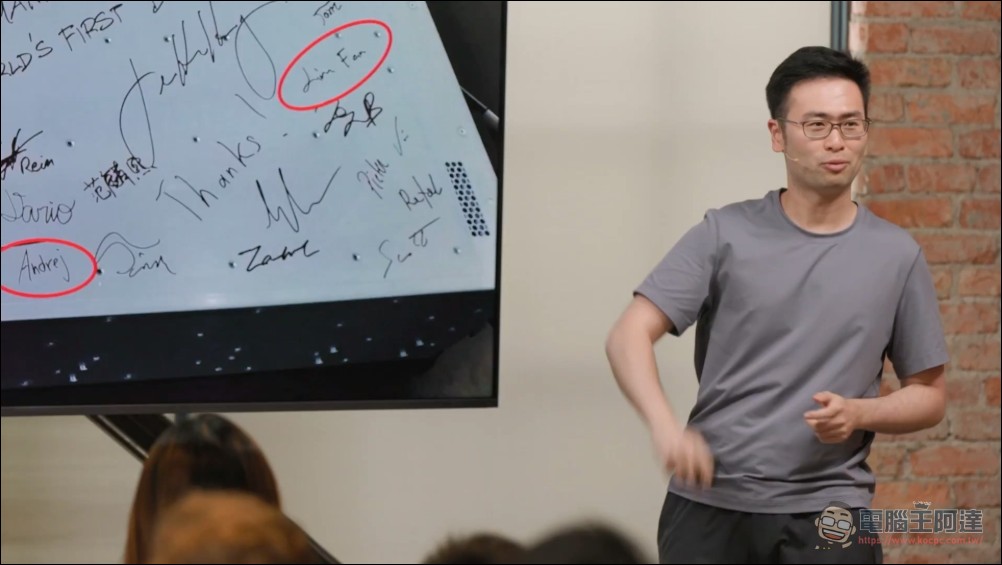

Jim Fan 以一段極具象徵意義的個人經歷開場。2016 年夏天,就在 OpenAI 當時的辦公室裡,NVIDIA 創辦人黃仁勳穿著標誌性的皮夾克,抱著一塊大金屬托盤走進來,上頭寫著:「致 Elon 和 OpenAI 團隊,致運算和人類的未來——我為你們獻上世界第一台 DGX-1。」當時 Jim Fan 還是 OpenAI 的第一個實習生,趕緊排隊在上面簽了名;旁邊一起簽的還有 Andrej Karpathy。這台 DGX-1 如今陳列在電腦歷史博物館中。Jim Fan 笑說,感覺自己像恐龍一樣老了。

這個故事不只是感性開場,更是整場演講的核心比喻。Jim Fan 引用他的導師 Ilya Sutskever 那句知名的「如果你相信深度學習,深度學習也會相信你」,然後指出大型語言模型(LLM)只用了三次階躍、六年時間就走到今天:GPT-3 的預訓練、InstructGPT 的監督微調、o1 風格的強化學習,再到自動研究。於是他做出了一個關鍵決定:抄 LLM 的作業,換個名字,稱為「底層同構」(the Great Parallel)。與其模擬字串的下一個狀態,不如模擬物理世界的下一個狀態;透過動作微調收斂到機器人需要的那一小塊,最後讓強化學習來完成最後一哩路。正如他所說:「打不過,就加入。」

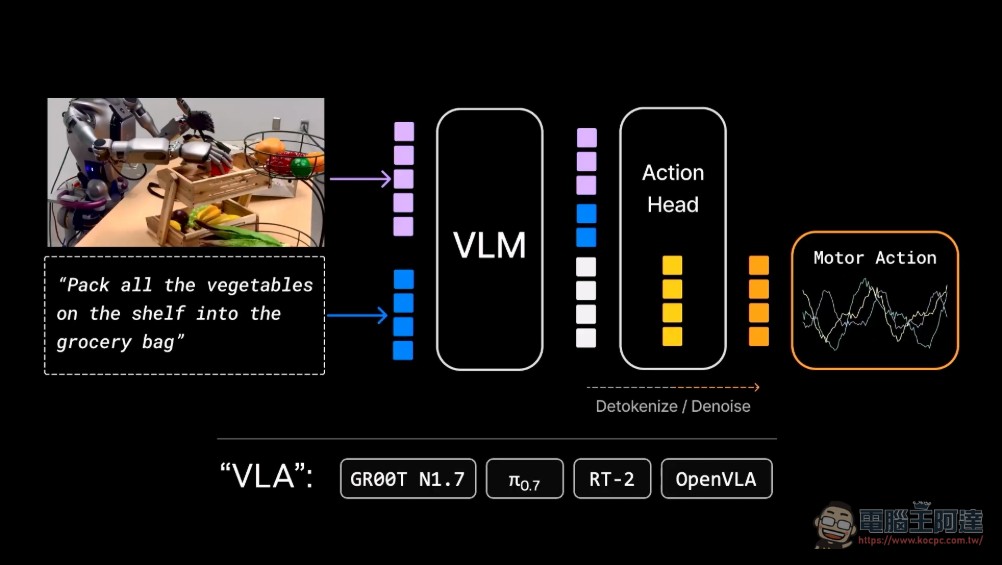

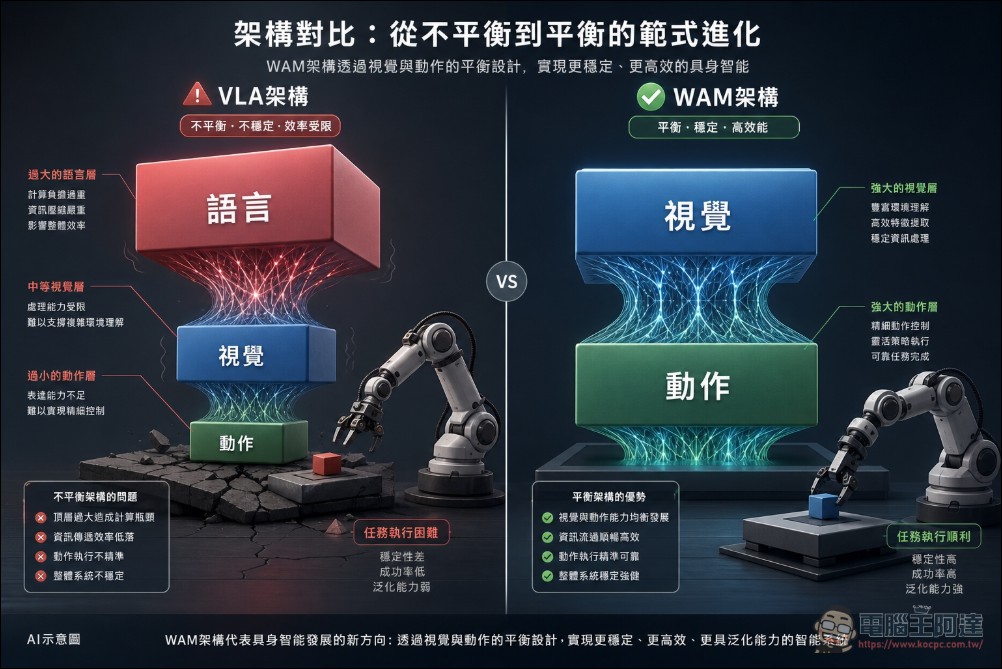

VLA 時代落幕:語言不是萬能

過去三年,機器人領域的主流架構是 VLA(Vision-Language-Action)。NVIDIA 自家的 GR00T 人形機器人基礎模型、Physical Intelligence 的 π0 都屬於這個類別。理論上,語言模型提供的常識與推理能力應該能賦能機器人,但 Jim Fan 點出了結構性的問題。

他直言,這些模型其實應該叫 LVA(Language-Vision-Action),因為大多數參數都分配給了語言。語言是一等公民,其次是視覺,動作只能墊底。「VLA 很擅長編碼知識和名詞,但在物理和動詞方面就沒有那麼擅長了。重心放在不對的地方。」

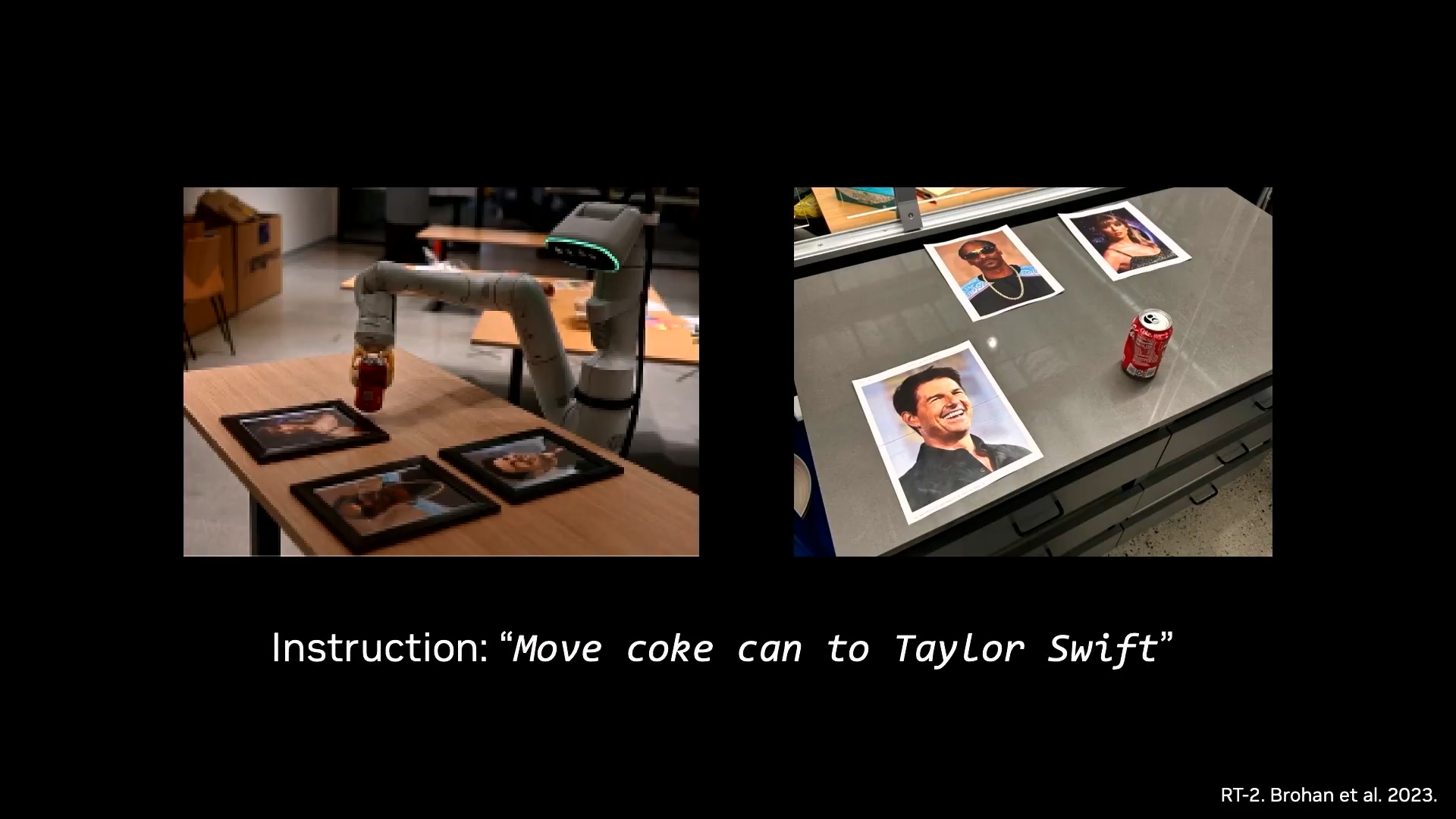

他舉了 RT-2 原始論文中的經典範例:讓機器人把可樂罐推到 Taylor Swift 的照片旁邊。模型確實做到了,問題是它能泛化的是「Taylor Swift」這個名詞,而不是「該怎麼推、找什麼角度、用多大力」這個動詞。這正是 VLA 體系的天生限制:參數配置頭重腳輕,導致物理理解能力始終無法突破。Jim Fan 在演講中明確表示,雖然這條路線完成了階段性歷史使命,但已不適合繼續走下去。

DreamZero 與世界行動模型(WAM)登場

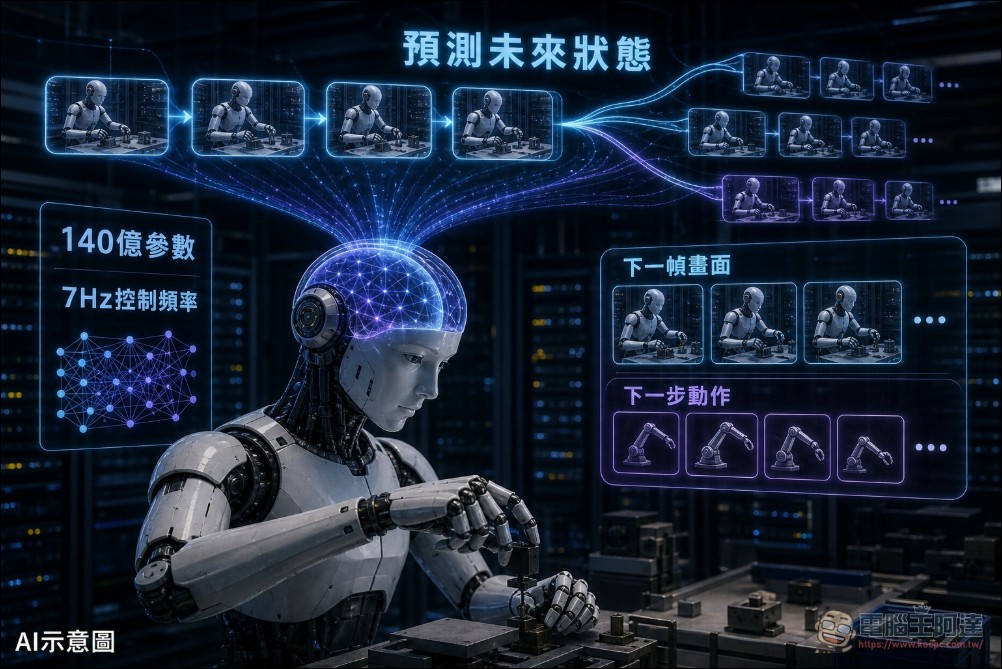

既然 VLA 不是最終答案,那下一階段的預訓練範式是什麼?Jim Fan 團隊的答案是影片模型。研究發現,影片擴散模型在內部已經學會了模擬物理世界的下一個狀態。關鍵問題是:怎麼把這些世界模型變成可用的機器人策略?

NVIDIA 的答案是一款 140 億參數的模型:DreamZero。這是一種新型策略模型,在執行動作之前先往未來「做夢」幾秒鐘,根據夢境行動,同時解碼下一幀畫面與下一步動作。在這裡,視覺與動作第一次真正成為了「一等公民」。Jim Fan 將這個新架構命名為世界行動模型(World Action Models,WAM),並坦率地承認 DreamZero 目前大約相當於 GPT-2 的階段:方向對了,但表現還不夠穩定可靠。

值得注意的是,DreamZero 的實際部署門檻極高。根據論文披露,這款 14B 模型必須經過 38 倍的系統級最佳化,搭配 GB200 硬體,才能將閉環控制壓到 7Hz。這意味著在現階段,WAM 路線更像是一份技術宣言,而非立即可以落地的產品。然而,學術界對此路線的反應相當積極:2026 年 3 月已出現 Fast-WAM 等後續研究,試圖探討世界行動模型是否需要測試階段的未來想像。

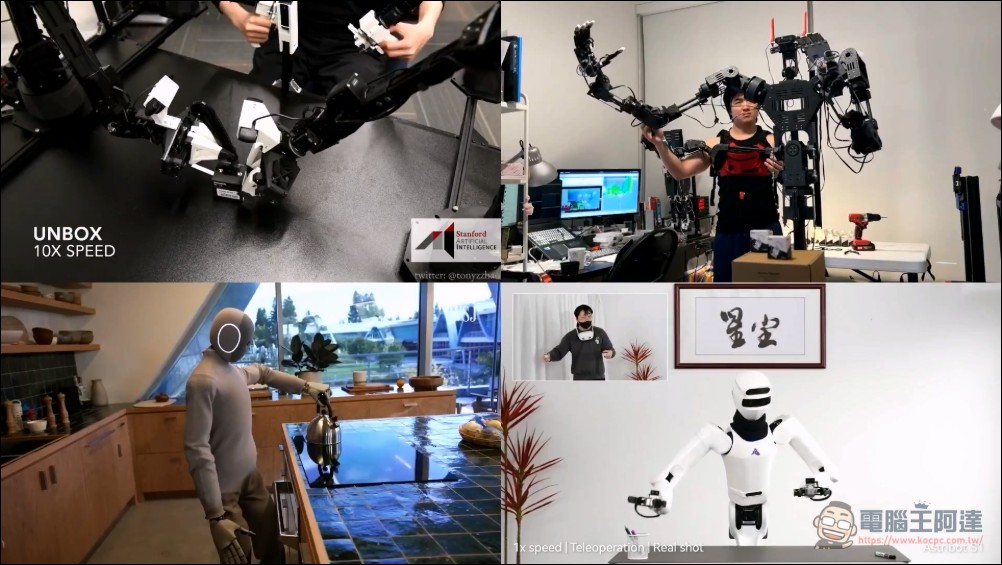

資料革命:從遙操作到機器人不必參與的資料採集

過去三年是遙操作(teleoperation)的黃金時代,但 Jim Fan 點出了這條路的硬上限:每台機器人每天最多 24 小時。「我說是 24 小時,那是騙自己的。實際一天能幹 3 小時就不錯了,還得看當天的『機器人之神』賞不賞臉,畢竟這幫機器天天鬧脾氣出毛病。」

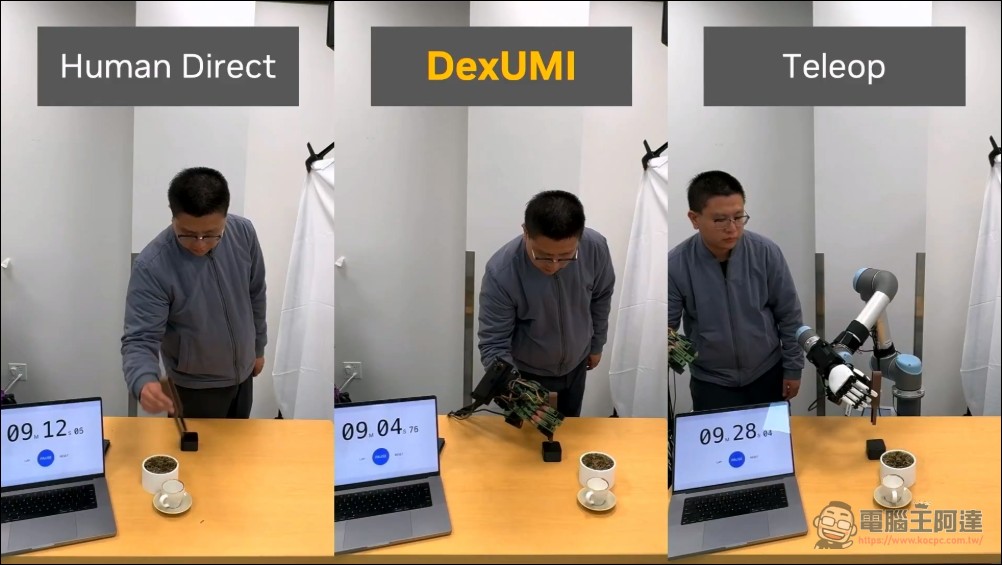

為了解決這個瓶頸,NVIDIA 提出了截然不同的策略:完全繞過機器人本體,直接從人類身上採集資料。具體方案是 DexUMI:一種外骨骼裝置,直接戴在人手上記錄手指運動。用外骨骼資料訓練出的機器人策略可以完全自主運行,訓練資料中完全沒有任何遙操作資料。機器人第一次可以不必參與資料採集的過程。

這項技術的意義深遠。典型的資料採集產能瓶頸從機器人硬體的物理限制(要維修、要充電、會故障),轉移到了人類的參與上限,而人類理論上可以大規模複製。這為下一階段的規模化奠定了基礎。

EgoScale 與靈巧操作的縮放定律

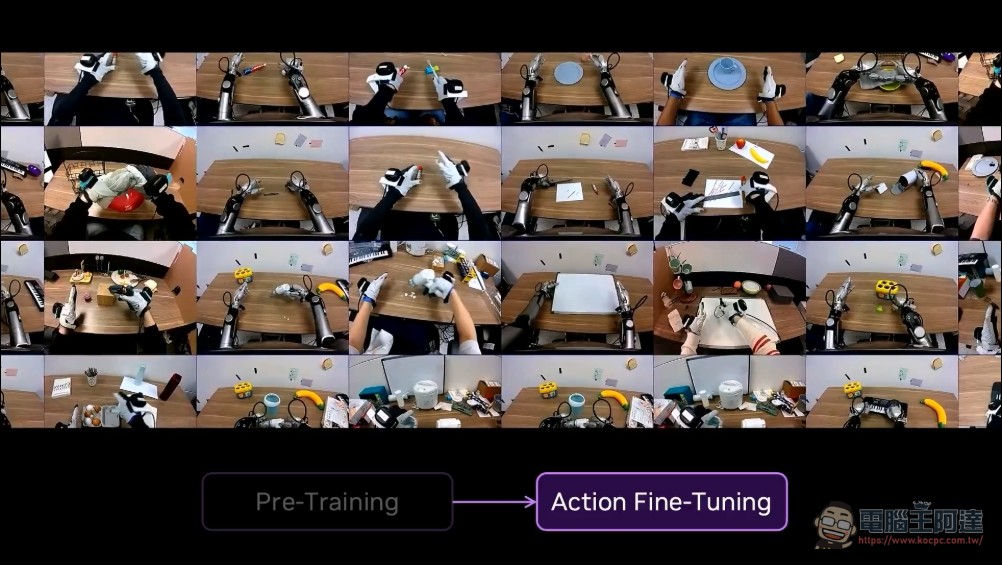

如果 DexUMI 解決的是採集方式的問題,EgoScale 解決的就是資料量的問題。NVIDIA 推出的 EgoScale 方案中,99.9% 的訓練資料來自人類第一人稱影片(egocentric video):預訓練用了 21,000 小時的野外人類資料,完全不涉及任何機器人資料。動作微調階段僅用了 50 小時的高精度動捕手套資料,外加 4 小時的遙操作資料,加起來連訓練總量的 0.1% 都不到。

這項研究最重要的發現是:靈巧操作的神經縮放定律(Neural Scaling Law)確實存在。預訓練投入的運算時數與最優驗證損失之間,存在一條極其清晰的對數線性關係,相關係數 R² 高達 0.998。這意味著只要持續增加人類影片資料,機器人的靈巧操作能力就可以可預測地持續提升。

Jim Fan 把所有資料策略的可擴展性放在一起對比:遙操作處在最不可擴展的角落;而第一人稱影片如果能轉動類似 FSD 的資料飛輪,一年內可以累積到 1,000 萬小時。

Dream Dojo:無物理引擎的純資料模擬器

機器人領域也需要像 LLM 一樣花大錢購買數百萬個訓練環境來做強化學習。傳統做法是 real-to-sim-to-real,但模擬到真實的差距始終無法完全消除。NVIDIA 的進一步方案是 Dream Dojo:不要物理引擎,直接把影片世界模型變成一個完整的神經模擬器。輸入是連續動作訊號,即時輸出下一幀 RGB 畫面和感測器狀態。沒有物理方程式,沒有繪圖引擎,完全由資料驅動,正如 Jim Fan 所說:「你看到的畫面裡,沒有一個像素是真實的。」

這句話不僅聽起來驚人,背後還藏著一層商業邏輯:算力 = 環境 = 資料。用 Jim Fan 自己的話來說:「或者用某位智者的話:買得越多,省得越多。這條訊息已獲得我老闆批准。」這句玩笑話直接點出了 NVIDIA 在這盤棋局中的核心商業策略:無論 WAM 還是神經模擬器,對算力的需求都遠遠超過傳統 VLA 架構,而這正好是 NVIDIA 晶片業務的甜蜜點。

終局路線圖:2040 年前的三大里程碑

在演講的最後,Jim Fan 將機器人的剩餘路徑比擬為必須解鎖的三個科技樹成就:

第一,物理圖靈測試(Physical Turing Test):2-3 年內,你無法分辨執行任務的是人類還是機器人。這是他去年同一場演講的主題,如今已被納入更完整路線圖中的第一步。

第二,物理 API(Physical API):用軟體和大模型編排機器人配置,建造「熄燈工廠」(Lights Out Factories)和自動化科學實驗室。這一步的核心在於將機器人從硬體問題轉變為軟體問題。

第三,物理自動研究(Physical Auto Research):機器人開始自己設計、改進並製造出下一代的機器人。這是終極目標,對齊 LLM 路線中的「自動研究」階段。

至於時間表,Jim Fan 給出了 2040 年的預測,可信度高達 95%。他的論證邏輯是:AI 從 AlexNet(2012)到智慧體代理(2026)用了 14 年;再給機器人 14 年,正好是 2040 年。他引用了一段相當引人深思的話作為結語:「我們這一代人,生得太晚,沒趕上大航海時代去探索地球;又生得太早,夠不著星辰大海去探索宇宙。但我們生得剛剛好,趕上了攻克機器人難題的時代。」

以上的講座影片我們也做了翻譯,有興趣的朋友可以看看: