Electron.js 創辦人、現任 Apple MLX 維護者的 Cheng Zhao(@zcbenz)昨日在 X 平台上發表一則貼文:「MLX 的 CUDA 後端,所有測試已全數通過。」這則簡短的貼文,在開發者社群中引發了不小的漣漪。主要原因是:MLX 是 Apple 專為 Apple Silicon 設計的機器學習框架,而 CUDA 是 NVIDIA 的獨家 GPU 運算平台。當 Apple 的 ML 框架宣布能完整支援 NVIDIA 的生態時,背後代表的意義遠不止技術里程碑那麼簡單。

MLX 從「Apple Silicon 獨佔玩具」到跨平台框架

MLX 最早於 2023 年底由 Apple 機器學習研究團隊開源,採用類似 NumPy 的陣列運算介面,深度整合 Apple Silicon 的統一記憶體架構(Unified Memory),讓開發者能在 Mac 上高效運行 LLM 推論甚至微調模型。

然而長期以來,MLX 一直被視為「Apple Silicon 專属玩具」,因為它在 Mac 上跑得很順,但出了 Apple 生態系就英雄無用武之地。相較之下,PyTorch 雖然跨平台但效能調校複雜,NVIDIA 的 CUDA 雖然強大但綁定自家顯卡。MLX 的 CUDA 後端從 2025 年中開始由 zcbenz 主導開發,歷經近一年的打磨,如今終於達到 full parity。

zcbenz:從 Electron 到 MLX 的傳奇開發者

Cheng Zhao 這個名字,對資深開發者來說首先聯想到的是 Electron.js:那個讓網頁技術跨界桌面應用的框架。而在加入 Apple 全職投入 MLX 維護後,他再次扮演了「串聯生態」的關鍵角色。

We have achieved a milestone in MLX that all tests are passing in CUDA backend now. pic.twitter.com/MgeUWwYXBT

— Cheng (@zcbenz) May 13, 2026

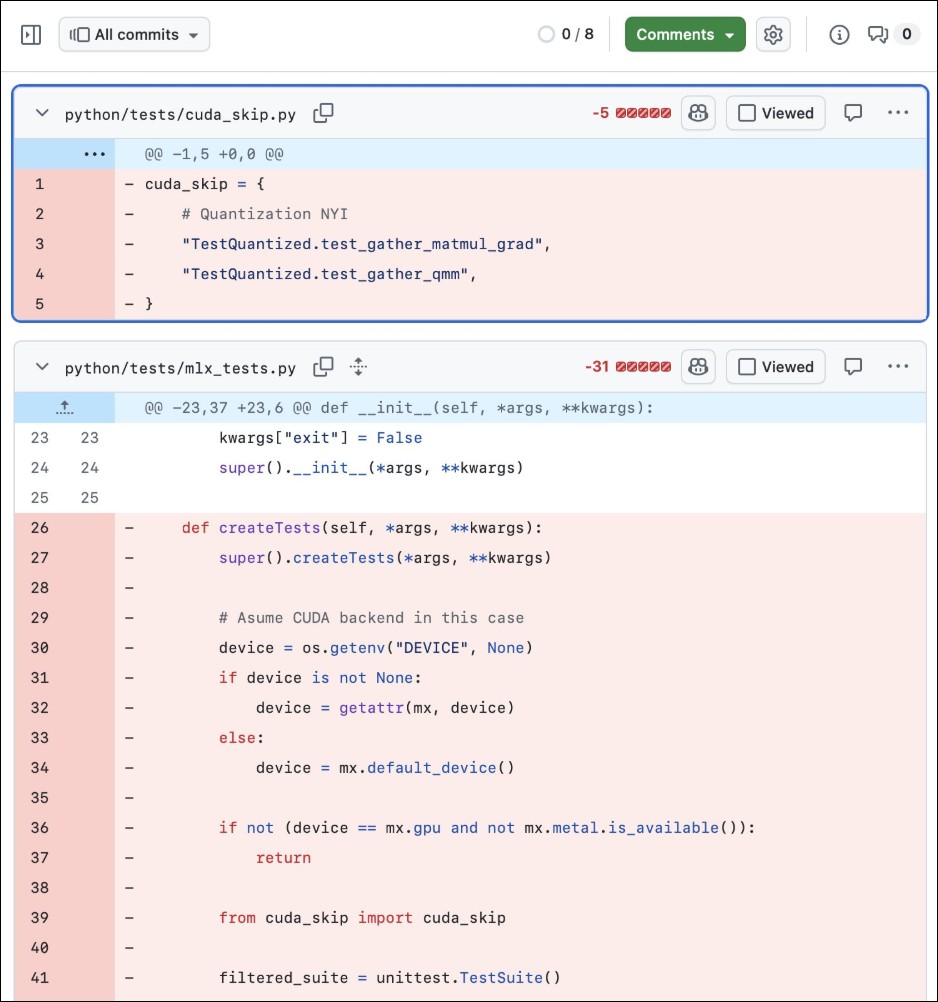

從他貼出的 GitHub diff 截圖可以看到,這次里程碑的具體內容是刪除了 python/tests/cuda_skip.py 這個檔案——裡面原本列著 TestQuantized.test_gather_matmul_grad 和 TestQuantized.test_gather_qmm 等因「量化尚未實作」(Quantization NYI)而需要跳過 CUDA 測試的案例。如今這些例外全部移除,代表 MLX 的 CUDA 後端功能已完整到位。

Apple 擁抱 CUDA:開放還是算計?

從戰略角度來看,這個發展頗具玩味。多年來,Apple 在 GPU 策略上始終走自己的路,Metal API、自家 GPU 架構、對 CUDA 敬而遠之。如今 MLX 反過來支援 CUDA,代表 Apple 承認 NVIDIA 的 GPU 生態在 AI 領域的重要性,選擇「打不過就加入」的策略(其實由最近 Apple 開放外接 NVIDIA 顯卡驅動就可見一斑)。

然而這並非單純的妥協。MLX 的設計哲學是「同一套程式碼,隨處運行」,開發者在 MacBook 上用 MLX 開發與測試,部署時可以直接在搭載 NVIDIA GPU 的雲端伺服器上運行,無需任何移植工作。這與 PyTorch 的「寫一次、到處除錯」形成了鮮明對比。

正如 Apple ML 研究團隊在官方部落格所說:「MLX 的設計目標是讓研究人員能快速迭代,同時保持模型在 Apple Silicon 上的最佳效能。」CUDA 後端的加入,無疑擴大了這個 vision 的邊界。

此外,MLX 生態也在快速擴張。2026 年 3 月,Ollama 宣布 Apple Silicon 推理引擎將改用 MLX,這對 MLX 來說是重要的生態認證。 從 pip install "mlx[cuda]" 就能啟用 CUDA 支援的簡潔設計,也降低了開發者的採用門檻。

本地 AI 跨平台時代來了?

MLX CUDA 後端全線通過測試,對於本地 AI 開發者來說意味著什麼?最直接的影響是:如果你同時擁有 MacBook 和搭配 NVIDIA GPU 的桌上型電腦或雲端實例,現在可以用 MLX 同一套程式碼無縫切換,不再需要維護兩套不同的 PyTorch/CUDA 環境。

對於 Mac 使用者來說,這也是一個好消息:MLX 在 Apple Silicon 上的效能持續精進,而且開發者社群寫的 MLX 套件(如 mlx-lm、mlx-snn 等)現在也能在 NVIDIA GPU 上運行,擴大了生態系的吸引力。

當然,MLX 要真正挑戰 PyTorch 的霸主地位,還有很長的路要走:PyTorch 的生態成熟度、社群規模、第三方套件數量都遠非 MLX 能比。但 MLX 走的是一條不同的路:簡潔的 API 設計、深度硬體整合、以及現在跨平台的 CUDA 支援,它在「開發體驗」這個維度上,確實提供了 PyTorch 做不到的絲滑感。

結語

「MLX 的 CUDA 時代,正式拉開序幕。」這句話或許稍嫌誇張,但這一小步,確實讓 MLX 從 Apple Silicon 的舒適圈跨出了一大步。當 Apple 的 ML 框架開始擁抱 NVIDIA 的生態,本地 AI 開發的版圖正在悄悄重組。接下來值得關注的是:MLX 能否吸引更多開發者與開源專案加入,真正打開那個「跨平台時代」。