Claude AI 的輸出成本究竟有多高?若以性價比來算,Claude Opus 4.6 的輸出單價高達每百萬 tokens 25 美元(約新台幣 810 元),難怪開發者直言「比黃金還貴」。然而,一群技術玩家透過自訂 Skill 與優化技巧,成功將 Token 消耗砍半甚至更多,有人更聲稱透過「省 token.skill」一口氣減少 65% 的用量。本篇整理 10 個經過實戰驗證的省 Token 技巧,幫助開發者在不犧牲輸出品質的前提下,大幅壓低 AI 使用成本。

Claude 為何「比黃金還貴」?先搞懂計費機制

在探討省錢方法之前,必須先了解 Claude 的計費邏輯。Token 是 AI 模型處理文字的基本單位,簡單理解為:1 個 Token 約等於 0.75 個英文單詞,或 0.5 個中文字元。最主要原因是,中文相對「更貴」:同樣的字數,中文消耗的 Token 數量是英文的將近兩倍。

Claude 採用輸入 Tokens + 輸出 Tokens 雙向計費模式。以下為 2026 年 3 月最新公布的 Anthropic Claude 4.6 系列官方定價 :

| 模型 | 輸入價格(每百萬 Tokens) | 輸出價格(每百萬 Tokens) | 上下文視窗 |

|---|---|---|---|

| Claude Opus 4.6 | $5.00 | $25.00 | 200K(標準),1M(Beta) |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 200K(標準),1M(Beta) |

| Claude Haiku 4.5 | $1.00 | $5.00 | 200K |

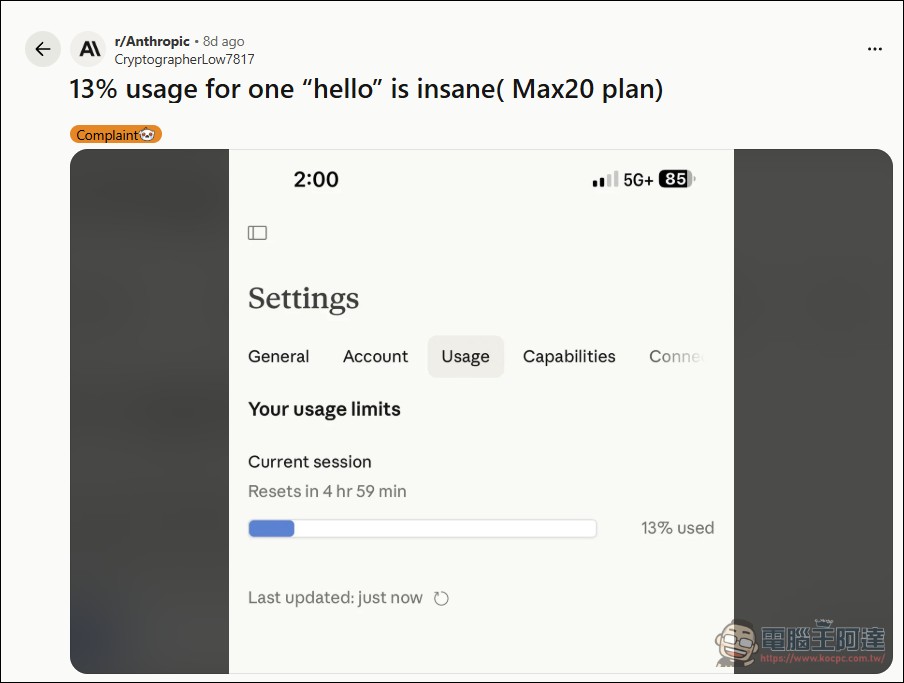

以 Claude Opus 4.6 為例,輸出單價每百萬 Tokens 25 美元,約合新台幣 810 元。對比今日黃金價格每克約新台幣 2,800 元,表面上兩者難以直接比較,但若以一個深度推理任務消耗數十萬輸出 Tokens 計算,單次呼叫的成本的確相當可觀,難怪社群中有人開玩笑說「用 Claude Opus 寫 code,錢包會哭」。甚至還有只是說個 Hello 就用到 13% 的Token用量(Max 20美金訂閱方案)的誇張案例。

典型使用場景:成本如何悄悄失控?

理解計費機制後,來看兩個常見場景的成本失控案例。

場景一:程式碼審查(500 行程式碼)

未優化的情況下:

- 輸入:完整程式碼(1,500 tokens)+ 詳細指令(300 tokens)+ 歷史對話(2,000 tokens)= 3,800 tokens

- 輸出:詳細報告 = 800 tokens

- 單次成本(Sonnet 等級):約 $0.0234(約新台幣 0.76 元)

優化後:

- 輸入:精簡程式碼(1,500 tokens)+ 簡潔指令(50 tokens)+ 清理歷史(0 tokens)= 1,550 tokens

- 輸出:結構化報告 = 600 tokens

- 單次成本:約 $0.0136(約新台幣 0.44 元)

- 節省:42%

場景二:寫作助手(持續對話)

未優化的情況下,10 輪對話累積下來,每輪都要載入全部歷史。第 10 輪輸入瞬間膨脹至 9,100 tokens,總成本飆升至約 $0.15(約新台幣 4.9 元)。

優化後,定期清理歷史並使用 Skill 固化指令,第 10 輪輸入壓縮至 600 tokens,總成本降至約 $0.045(約新台幣 1.5 元),節省幅度高達 70% 。

關鍵在於:對話越長,成本會以指數級成長,因為每次請求都會累積載入對話歷史。

10 個實用技巧:從菜鳥到高手都在用

以下整理 10 個經過開發者社群實戰驗證的省 Token 技巧,部分技巧可疊加使用,效果驚人。

技巧 1:選擇合適的模型

不是每個任務都需要 Opus。根據任務難度選擇模型,是最基本也最有效的省錢方法:

| 模型 | 適用場景 | 成本 | 品質 |

|---|---|---|---|

| Haiku | 簡單任務、資料提取、格式轉換 | 最低 | 中等 |

| Sonnet | 日常開發、程式碼審查、內容創作 | 中等 | 優秀 |

| Opus | 複雜推理、架構設計、高品質創作 | 最高 | 頂級 |

簡單任務用 Haiku,每百萬 Tokens 輸入只要 $1、輸出只要 $5,與 Opus 相比節省 80% 的輸出成本。

技巧 2:優化提示詞結構

冗長的系統提示詞是隱性成本殺手。建議:

- 移除重複說明的廢話

- 將多個要求合併為單一明確指令

- 使用條列式結構取代冗長敘述

- 避免在每次請求中重複相同的上下文資訊

技巧 3:使用 Skill 固化常用指令

所謂「省 token.skill」,是指將常用的複雜指令封裝為可重複呼叫的 Skill。CC Academy 的實測資料顯示 ,同一個行程驗碼任務,懶人工程師只能用 3 小時,而善用 Skill 的工程師可以爽用一整天:兩者差異高達 7 倍。

在 Claude Code 中,Skill 可以將重複性高的指令集(系統提示詞、相關檔案路徑、輸出格式規範)一次載入多次使用,大幅減少每次對話的輸入 Token 消耗。

技巧 4:管理對話歷史

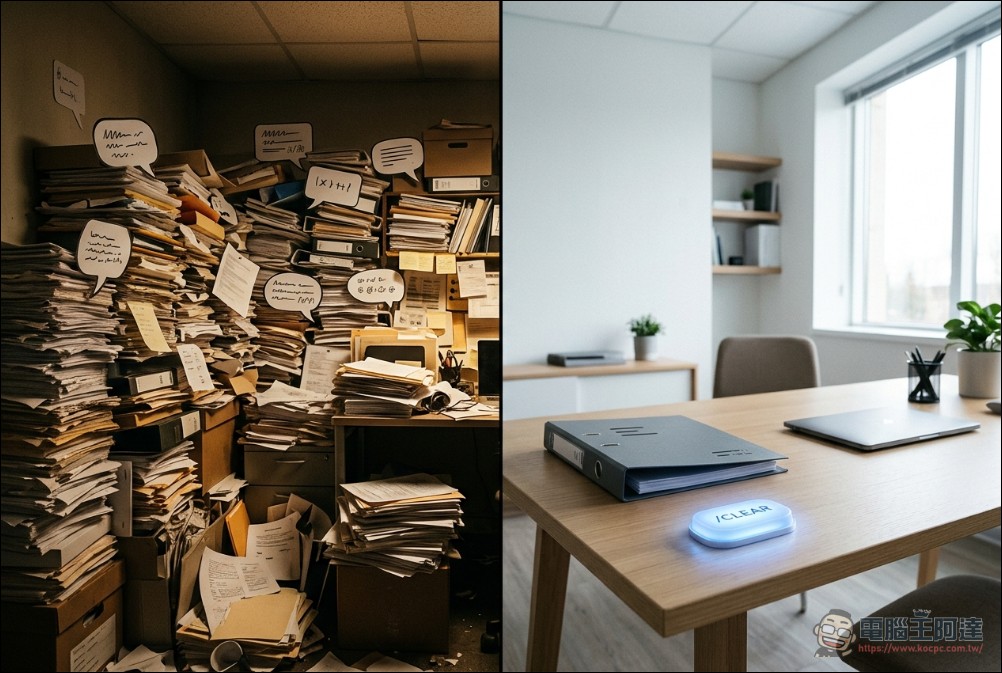

CC Academy 特別強調「/clear 習慣」的重要性 :

實測資料:經過 200+ 小時的編程實測,合理使用 MCP 並保持良好的 /clear 習慣,7 美金可以用 2 小時。按一天開發 10 小時計算,也只需約 35 美金(約新台幣 1,135 元)。

長期對話不清理歷史,會讓每次請求的輸入 Tokens 持續膨脹。建議:

- 每完成一個階段性任務,執行一次 /clear 開新對話

- 重要的對話結論手動保存,勿依賴歷史上下文

- 使用 /compact 主動壓縮歷史,保留關鍵資訊、移除冗餘內容

技巧 5:批量處理而非多次詢問

把多個相關請求合併為一次批量處理,可顯著降低總消耗。例如,不要問「這個函數的作用是什麼?」再問「它有什麼優化空間?」,而是直接問:「請說明這個函數的作用,並提出具體優化建議。」

一次請求同時獲得兩項答案,輸入輸出一魚兩吃,總 Token 消耗反而更低。

技巧 6:善用 MCP 工具

Model Context Protocol(MCP)工具是雙面刃:用對了省錢,用錯了燒錢更快。CC Academy 的建議是:

關閉不必要的 MCP Server。每個啟用的 MCP 工具都會消耗系統資源與 Tokens,務必定期檢查並移除閒置的工具。

只保留當前任務真正需要的 MCP 工具,其他一律禁用。

技巧 7:優化專案檔案管理

不要每次對話都丟進整個程式碼庫。建議:

- 只載入與當前任務直接相關的檔案

- 大檔案手動拆分成多個小模組,逐一處理

- 利用 CLAUDE.md 設定明確的專案範圍,減少模型理解成本

技巧 8:利用 Prompt Caching

Prompt Caching 是 2026 年 Claude API 最重要的成本優化功能。Anthropic 針對快取命中提供折價 90% 的優惠:

| 模型 | 快取寫入價格 | 快取讀取(命中)價格 |

|---|---|---|

| Opus 4.6 | $6.25/M | $0.50/M(原價 $5.00,節省 90%) |

| Sonnet 4.6 | $3.75/M | $0.30/M(原價 $3.00,節省 90%) |

| Haiku 4.5 | $1.25/M | $0.10/M(原價 $1.00,節省 90%) |

對於需要重複載入大量上下文的開發者來說,這項功能可以幫你省下近九成的費用。

技巧 9:避免無效對話

常見的無效對話模式包括:

- 目標不明確的開放式提問

- 來回修正偏離主題的對話

- 未確認上一步結果就急著問下一步

每避免一次無效來回,大約可省下 100-500 Tokens,相當於新台幣 3-15 元的開銷。

技巧 10:使用 API 精細控制

透過 API 參數設定,可進一步優化成本:

- 設定

max_tokens限制單次輸出上限,避免模型嘮叨 - 使用

temperature控制隨機性,一般任務設 0.5-0.7 即可 - 啟用 Batch API 處理非緊急任務,定價更優惠

實戰案例:有人靠 Skill 減少 65% 消耗

回到文章標題提到的「省 token.skill」:這並非空穴來風。根據開發者社群的討論 ,有使用者透過自訂 Skill 封裝完整的開發工作流,將過往需要數十次來回對話才能完成的任務,壓縮至 3-5 次精準呼叫,Token 消耗一口氣降低 65%。

這個「省 token.skill」的核心概念是:不是讓 AI 少做事,而是讓 AI 做事的方式更有效率。

總結:省錢的關鍵在於「意識」

Claude 的 Token 計費雖然看似複雜,但只要掌握以下幾個核心原則,就能有效控制成本:

- 選對模型:Haiku 能解決的問題,不要浪費 Opus

- 清理歷史:養成 /clear 習慣,別讓對話默默長大

- 活用 Skill:將常用流程封裝,一次定義多次使用

- 善用快取:Prompt Caching 可節省高達 90% 的重複載入成本

- 批量思維:一次問清楚,不要分段反覆提問

AI 工具的價值不在於「用得越多越好」,而在於「用得越精準性價比越高」。在當前的 AI 開發環境裡,學會與 Token 成本共處,將是每個軟體工程師的必修課。