很多人都會想買顯卡來跑本地 LLM,只不過現在新顯卡價格都很貴,不是每個人都有這預算,因此就可能會改找 RTX 3060、RX 7800 XT 這種二手入門中階顯卡。事實上除了消費級顯卡,過去的伺服器卡搞不好 CP 值更高。

最近國外一位 YouTuber 就測試一張 8 年前的伺服器顯卡「NVIDIA Tesla V100」,跑 gpt-oss-20b、Google Gemma 4 這類模型的速度跟效率,都壓過 RTX 3060 12GB 跟 RX 7800 XT,當年這張顯卡可是要一萬美元,現在國外 eBay 上的 SXM2 版本只要 100 美元。

8 年前的 NVIDIA V100 二手價只要 100 美金,改裝後跑本地 LLM 比 RTX 3060 還快 42%

國外 YouTube 頻道 Hardware Haven 近日上傳一部「這張 200 美元的 AI GPU 不應該這麼好用才對」的影片,內容分享他們實測一張 NVIDIA Tesla V100 16GB 的 LLM 效能,結果非常驚艷。

不過你要先知道的是,NVIDIA Tesla V100 16GB 有兩個版本:PCIe 和 SXM2 介面,他們的這張是 SXM2 介面,因此要裝在消費型主機板的話,需要「SXM2 轉 PCIe x16 的轉接器」,也沒有自帶風扇,還要添購一顆 80mm Noctua 風扇配上他們自己 3D 列印的風扇罩,所以總成本實際上是 234.64 美元。V100 也完全沒有影像輸出,只是純運算卡,所以這張卡不能拿來當一般顯示卡用,只能用來跑 AI 推論或 HPC 計算。

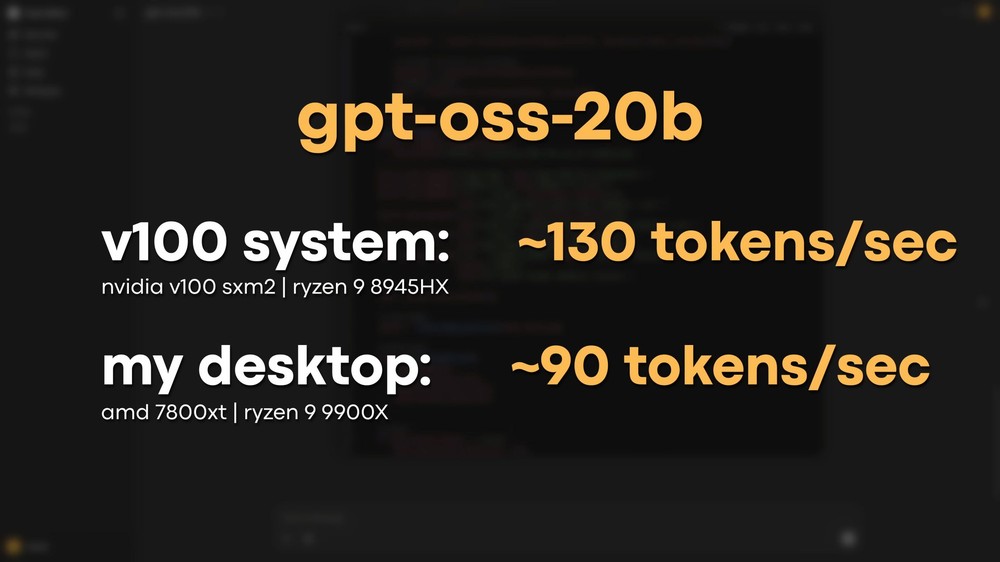

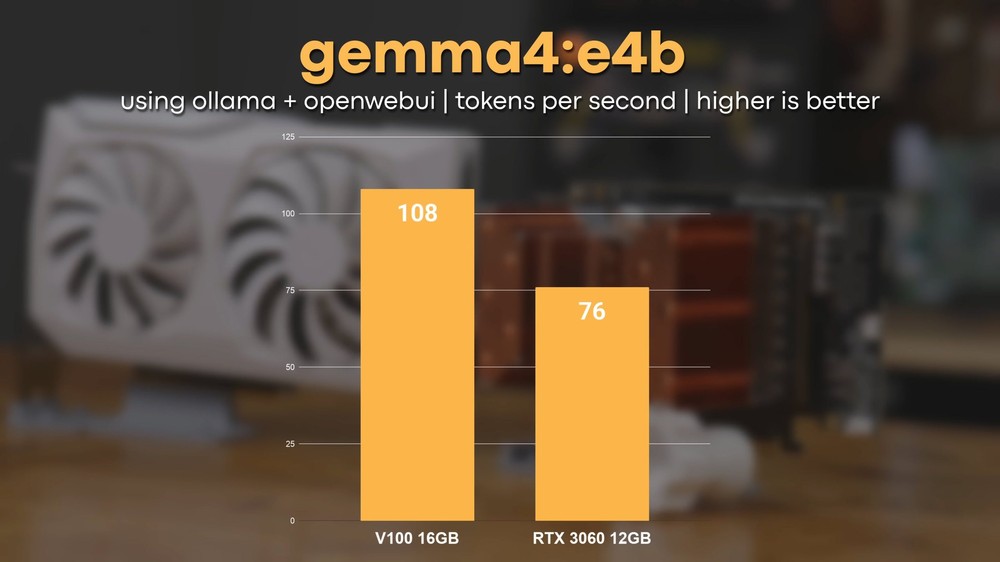

下方是實測數據,Hardware Haven 把 V100 系統跟自己日常用的 RX 7800 XT、以及 RTX 3060 12GB 拿來比較,在 Ollama 上跑兩個開源模型。

gpt-oss-20b 部分,V100 跑出 130 tokens/s,RX 7800 XT 只有約 90 tokens/s,差距約 44%:

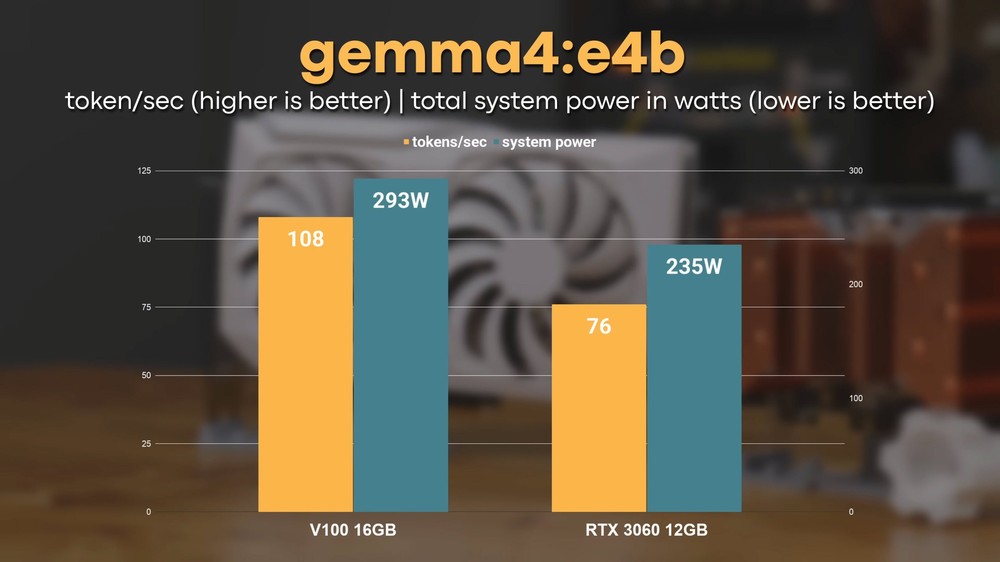

Google Gemma 4 e4b(Ollama + OpenWebUI)部分,V100 的成績是 108 tokens/s,RTX 3060 12GB 則是 76 tokens/s,差距約 42%:

不過整機功耗 V100 比較高,來到 293W,RTX 3060 12GB 則是 235W:

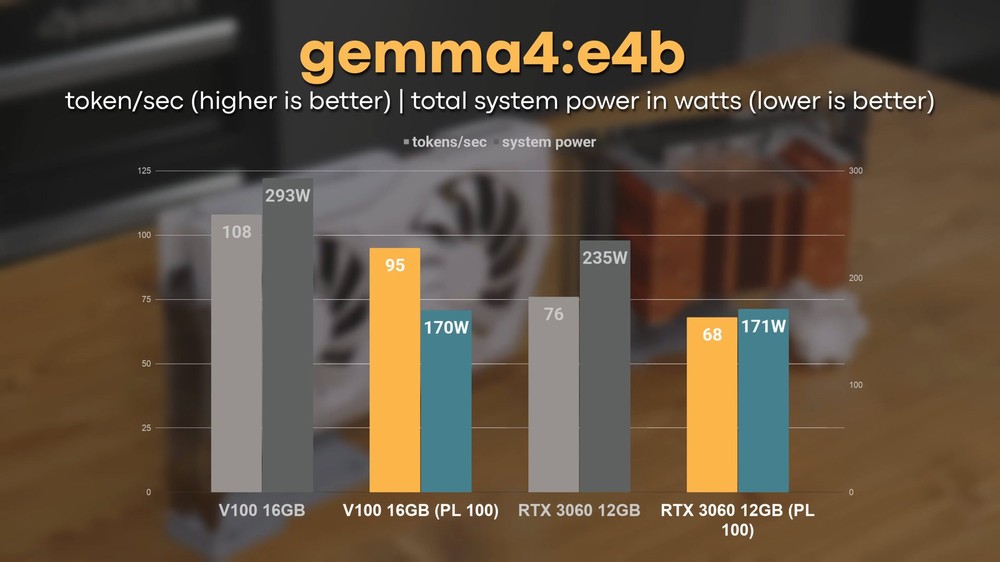

為了讓功耗公平,Hardware Haven 將整機系統功耗設置在 170W,V100 跑出 95 tokens/s,RTX 3060 為 68 tokens/s,還是領先近 40%:

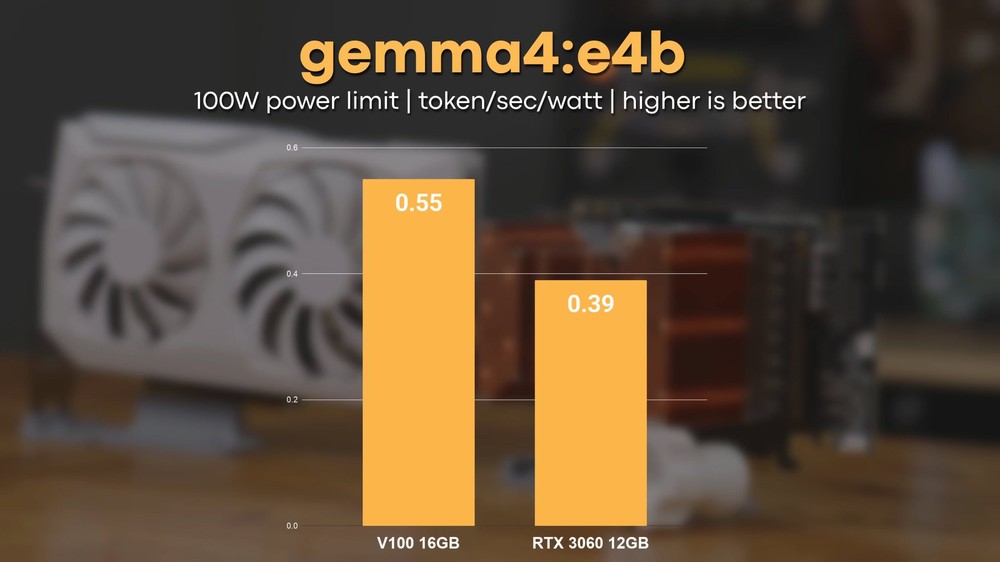

功耗壓到 100W,來比較能源效率(每 1W 電力可以產生多少 token),V100 為 0.55 tokens/s/w、RTX 3060 是 0.39 tokens/s/w,因此 V100 明顯效率更高,約領先 41%:

真沒想到,一張 2017 年的伺服器卡,在特定 LLM 推論測試中能大幅超越 2021 年的 RTX 3060 跟 2023 年的 RX 7800 XT。

V100 SXM2 16GB 採用的是 HBM2 高頻寬記憶體,記憶體頻寬高達 900 GB/s;RTX 3060 12GB 是 GDDR6、192-bit 通道,頻寬只有 360 GB/s。LLM 推論這種工作負載對記憶體頻寬非常敏感。

再加上 V100 是 NVIDIA 早期導入 Tensor Core 的資料中心 GPU,本來就是為深度學習與 HPC 工作負載設計,所以在這類 LLM 推論測試中勝出並不意外。

完整影片: