每個月花數十至數百美元訂閱 Claude Code、GitHub Copilot 或 Cursor 讓你有點肉疼?其實你手上的 Mac 可能已經足夠跑出一套完全本機的 AI 程式編碼助手,而且效能比你想象中好。近期在 YouTube 上 Tech-Practice 分享了一套以 MacBook M5 Max 為底,搭配 oMLX + OpenCode + Qwen 3.6 的本地端 AI 組合,號稱可以讓 Mac 用戶在本地端流暢執行 AI 程式設計助手,不需連網、不需付月費、資料完全留在本機,因為解說的相當詳細,在此分享他的完整教學給有需要的朋友參考。

oMLX + OpenCode + Qwen 3.6 完整設定教學

什麼是 oMLX?

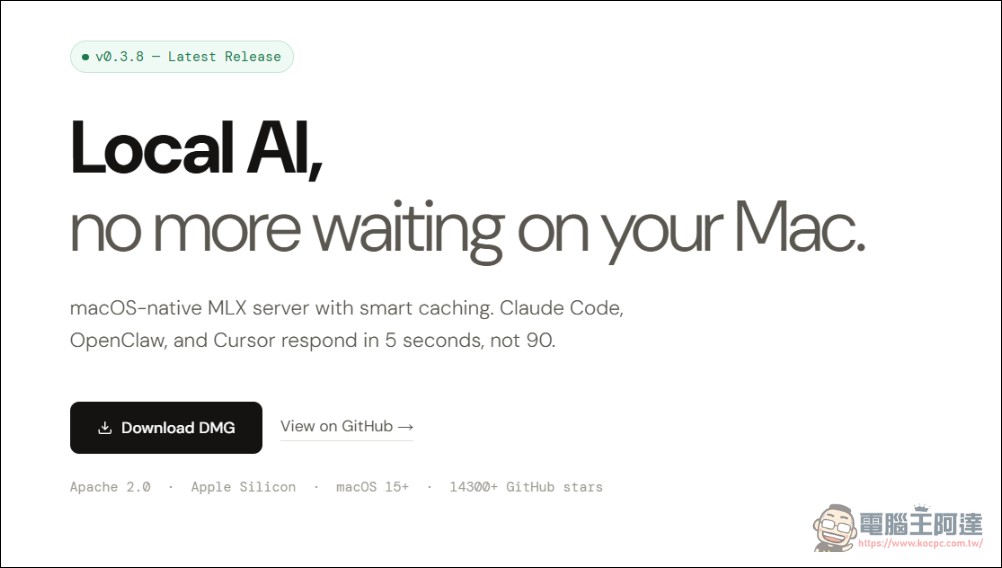

oMLX 是一個專為 Apple Silicon(M1/M2/M3/M4)設計的本地 LLM 推理伺服器。它基於 Apple 的 MLX 框架,透過連續批次處理(continuous batching)和智慧快取機制,大幅提升了 Mac 上運行大語言模型的效率。根據 oMLX 官方網站的說法,搭配 Claude Code、OpenClaw 或 Cursor 使用時,回應時間可壓在 5 秒以內。

與 Ollama 或 LM Studio 等通用方案不同,oMLX 的設計特別針對編碼 agent 的使用場景,也就是「頻繁的短輪詢互動」進行了優化。這使得它在與 OpenCode、Claude Code 等工具搭配時,能提供比其他本地端推理引擎(LM Studio、ollama)更流暢的體驗,網路上的評價非常不錯。

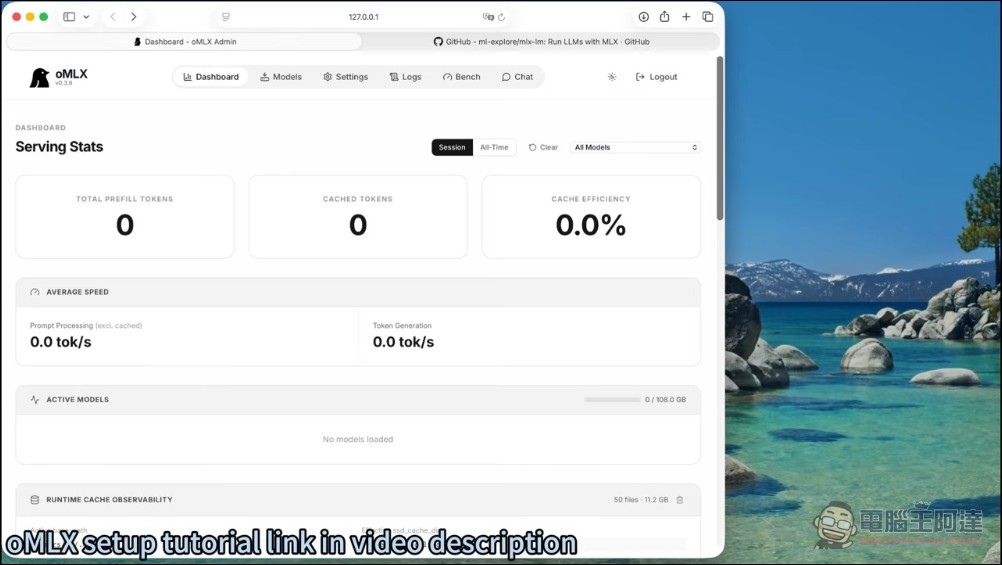

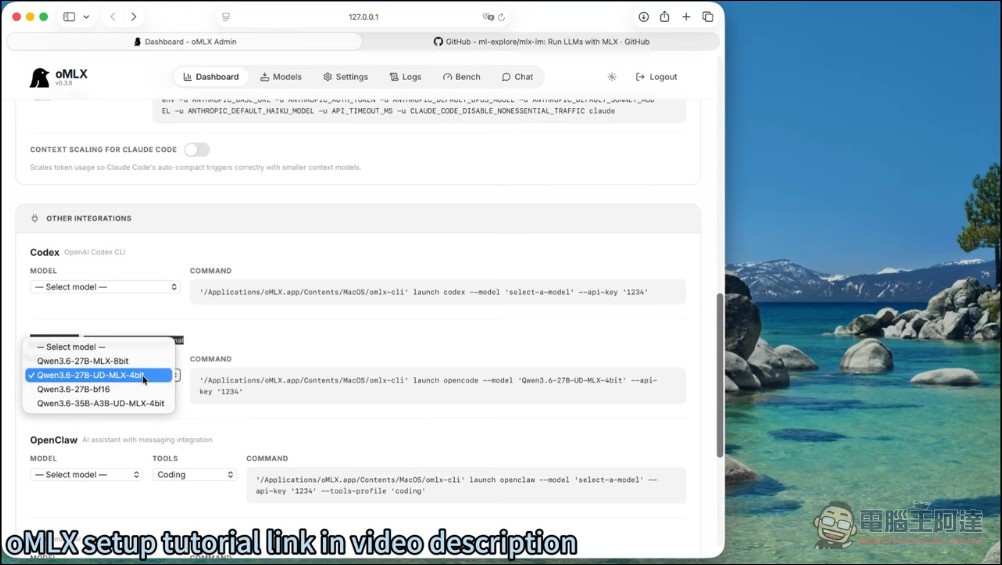

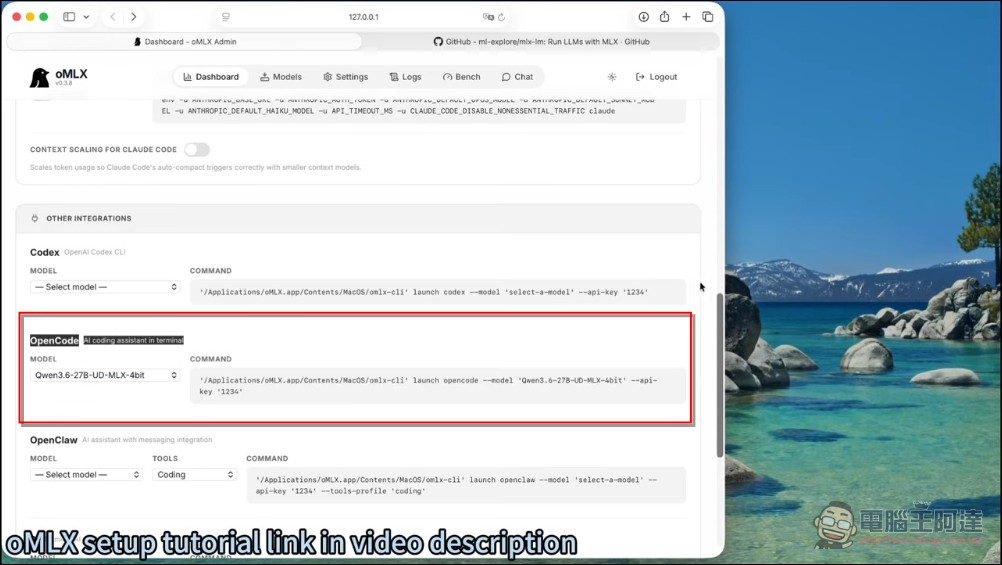

此外,oMLX 提供了直覺的網頁管理介面,讓使用者可以輕鬆切換模型、監控 token 生成速度、檢視快取命中率等即時數據,大幅降低了命令列操作門檻。

OpenCode:開源編碼 agent

OpenCode 是一個開源的 AI 編碼 agent,支援連接到多種模型提供商:包括 OpenAI、Anthropic、Google Gemini,以及完全本機的模型。它的核心優勢在於:

- 完全免費:開源專案,無隱藏費用

- 模型無關:可自由切換雲端 API 或本機模型

- 工具呼叫:支援讀取檔案、編輯程式碼、執行命令等操作

- 多 agent 協作:可建立 planner、coder、reviewer 等多 agent 工作流程

事實上,OpenCode 的定位與 Claude Code 類似,但由於它是開源的,使用者可以完全控制程式碼與資料,不依賴任何商業服務的 API 端點。

硬體需求:你需要什麼規格的 Mac?

要順暢運行本機 AI 編碼 agent,最重要的硬體規格是 統一記憶體(Unified Memory),根據影片中的實際測試:

- Qwen 3.6 27B(4-bit 量化):約佔用 27.7 GB 記憶體,GPU 使用率 98%,生成速度約 12 token/s

- Qwen 3.6 35B A3B(MoE 專家混合模型):約佔用 20 GB 記憶體,生成速度達 84.5 token/s,快了 7 倍

簡單來說:建議至少 32GB 以上的 Mac。如果使用 48GB 或 64GB 機型,甚至可以嘗試更大的模型。MoE(專家混合)架構的模型(如 35B A3B)由於每次只啟用部分參數,記憶體占用更低、速度更快,是 Mac 本地運行的理想選擇。

Step-by-Step 搭建流程

以下是從零開始搭建本機 AI 編碼環境的完整步驟:

Step 1:安裝 oMLX

前往 oMLX 官網(omlx.ai)下載 macOS 版本並安裝。安裝完成後啟動 oMLX,它會自動在背景運行推理伺服器,並在瀏覽器中打開管理後台。

Step 2:下載模型

在 oMLX 管理介面中,瀏覽並選擇你想要使用的模型。建議初學者先從 Qwen 3.6 27B(4-bit 量化版)開始,它對編碼任務有很好的支援,且多數 32GB Mac 都能流暢運行。如果硬體規格更高,可以嘗試 35B A3B 等 MoE 模型。oMLX 支援從 Hugging Face 直接下載量化模型,無需手動轉檔。

Step 3:安裝 OpenCode

透過 npm 或 Homebrew 安裝 OpenCode 指令列工具:

npm install -g @opencode/cli

# 或

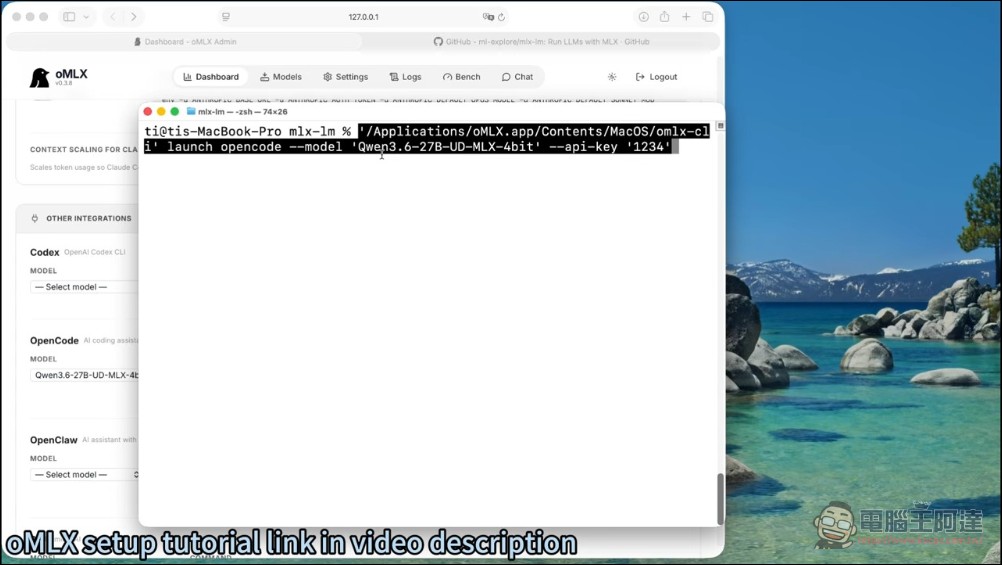

brew install opencodeStep 4:取得 oMLX API 端點

在 oMLX 管理後台中,找到 API 端點資訊。oMLX 提供與 OpenAI 相容的 API 格式,因此 OpenCode 可以直接連接,只需在 OpenCode 的設定中指向 oMLX 的本地端點即可。

Step 5:啟動 OpenCode 並開始編程

在終端機中導航到你的專案目錄,執行:

opencode首次啟動時,OpenCode 會要求選擇模型提供商,選擇「本機模型」或「自訂端點」,並填入 oMLX 的 API 位址。配置完成後,你就可以直接透過 OpenCode 使用本機 LLM 進行程式碼生成、審閱、重構等操作。

效能實測:27B vs 35B A3B

根據影片作者的實測數據:

- Qwen 3.6 27B(Dense):12 token/s,佔用 ~27.7 GB RAM,GPU 98% — 適合複雜的程式碼生成與重構任務

- Qwen 3.6 35B A3B(MoE):84.5 token/s,佔用 ~20 GB RAM 快了 7 倍,適合快速迭代的日常編程

影片中也展示了實際應用場景,使用 27B 模型時,OpenCode 成功讀取一個 Python 檔案、理解其中的 quick sort 演算法,並在檔案中追加了 merge sort 實作。

而切換到 35B A3B 模型後,同樣流暢地完成了 HTML 頁面生成,甚至透過工具呼叫功能抓取了 Hacker News 的最新內容,並將結果寫入專案目錄。

詳細的內容有興趣的朋友也可以看一下教學影片,原則上任何市面上的程式編寫應用只要能指定模型的都可以用這套方案,相當實用:

有開發者在 LinkedIn 上分享,使用 oMLX 0.3.6 搭配 Hermes Agent 進行了 24 小時的本機編碼測試,認為其表現優於其他推理引擎,特別是在編碼 agent 和工具呼叫的場景下。(編按:我們也有實測本地端用 LM STUDIO 跑 Hermes,調用工具與執行任務表現也不錯,就是比雲端速度慢了些)

與其他雲端方案 Claude Code、Cursor 的比較

本機方案的優勢顯而易見:

- 成本:零月費,只需一次性硬體投資

- 隱私:程式碼完全留在本機,不外傳

- 離線可用:不需要網路連線

雖然 Qwen 3.6 27B 在編碼任務上表現不俗,但與 Claude Opus 4.7 或 GPT-5.5 等雲端頂尖模型相比,能力上限仍有明顯差距。根據 Reddit 上 r/opencodeCLI 社群的討論,許多開發者採用「混合策略」:日常小任務走本機模型,複雜任務才切到雲端 API。

結語

oMLX + OpenCode + Qwen 3.6 這套組合,代表了 Apple Silicon 的統一記憶體架構完全能勝任在本地運行中大型 LLM 的消費級平台,而 oMLX 的優化讓這個體驗從「勉強可用」進化到了「流暢實用」。對於每月雲端 API 帳單持續增長的開發者而言,這無疑是一個值得嘗試的替代方案。