先前我們曾介紹過一款「llmfit 一秒就能檢測出電腦能順暢運行哪些 AI 模型」的免費工具,但這個需要下載,同時其互動式 TUI 對某些人來說可能用不慣,再加上僅限電腦,手機沒辦法檢測,使用上還是有些不便。而這篇要介紹的「CanIRun.ai」就是一個更簡單方案,只需打開網頁,就能立刻得知能順暢運行哪些 LLM 模型,而且是只要有瀏覽器的裝置就能測,電腦、筆電、平板、手機等都行。

CanIRun.ai 介紹和操作教學

CanIRun.ai 是一款專為本地 AI 玩家打造的免費線上工具,主要用來判斷你的電腦、手機能不能順利運行各種 AI 模型。 對於現在越來越多人開始嘗試在本機跑 LLM 來說,這個工具可以說非常實用。透過檢測硬體規格的方式,直接判斷實際能跑哪些模型,省去大量測試與踩雷時間。

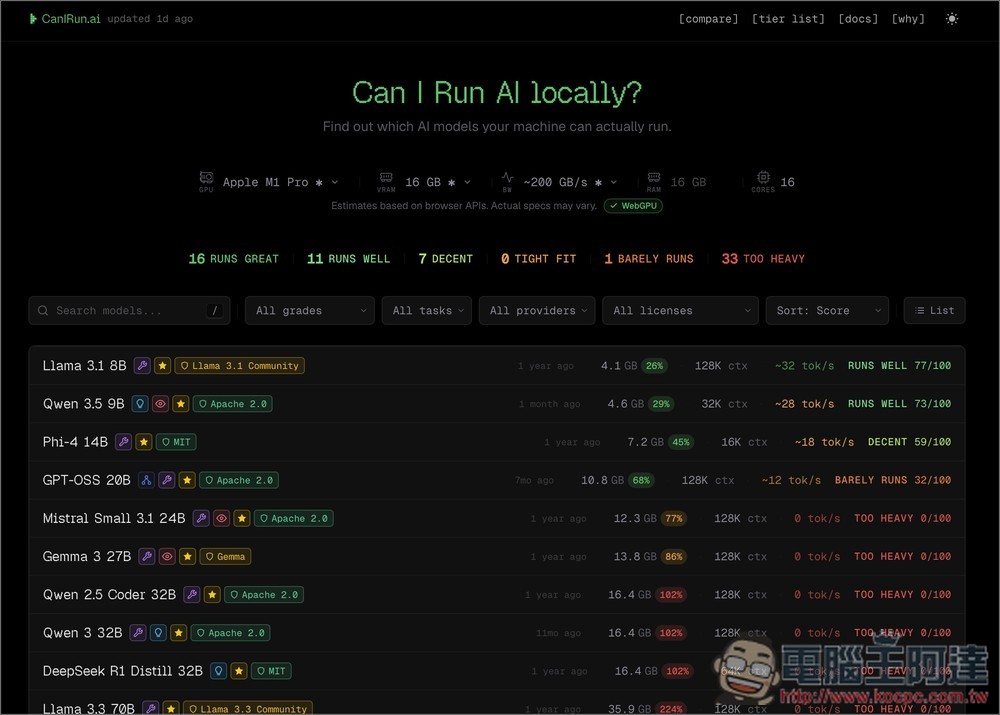

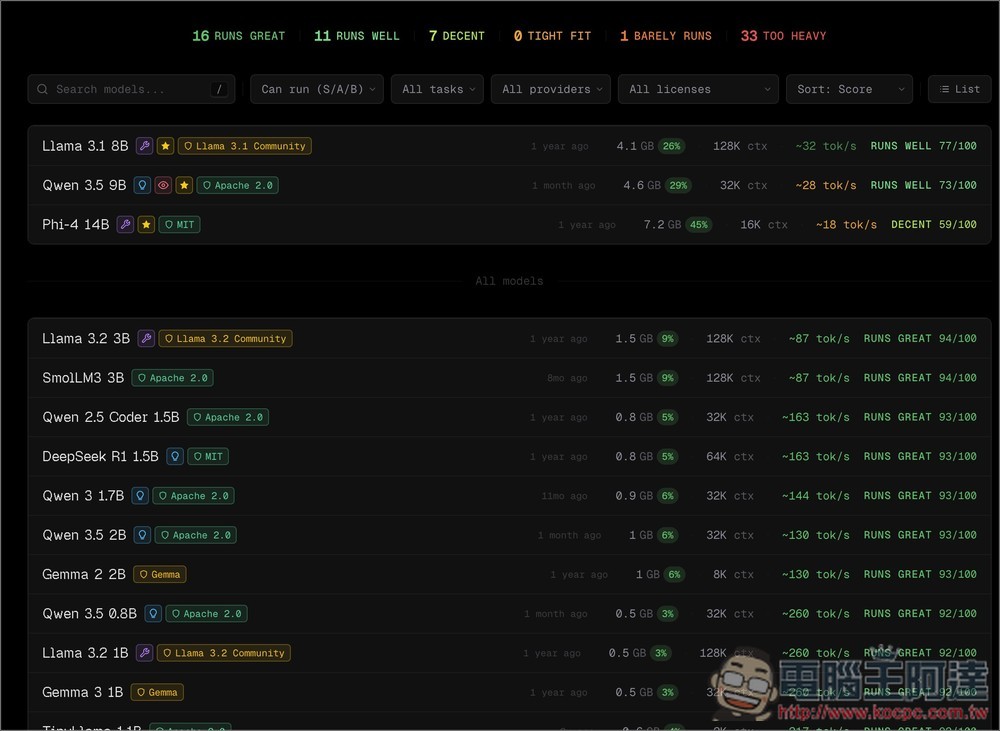

使用方式也非常簡單,進入網站後,就會立刻偵測你的 GPU、VRAM、記憶體頻寬等資訊(當然也能手動調整),接著就會列出一整排 AI 模型,並清楚標示「Runs great、Runs well、Decent、Too heavy」等評級。你可以快速知道哪些模型可以順跑、哪些勉強可以、哪些根本不用試。

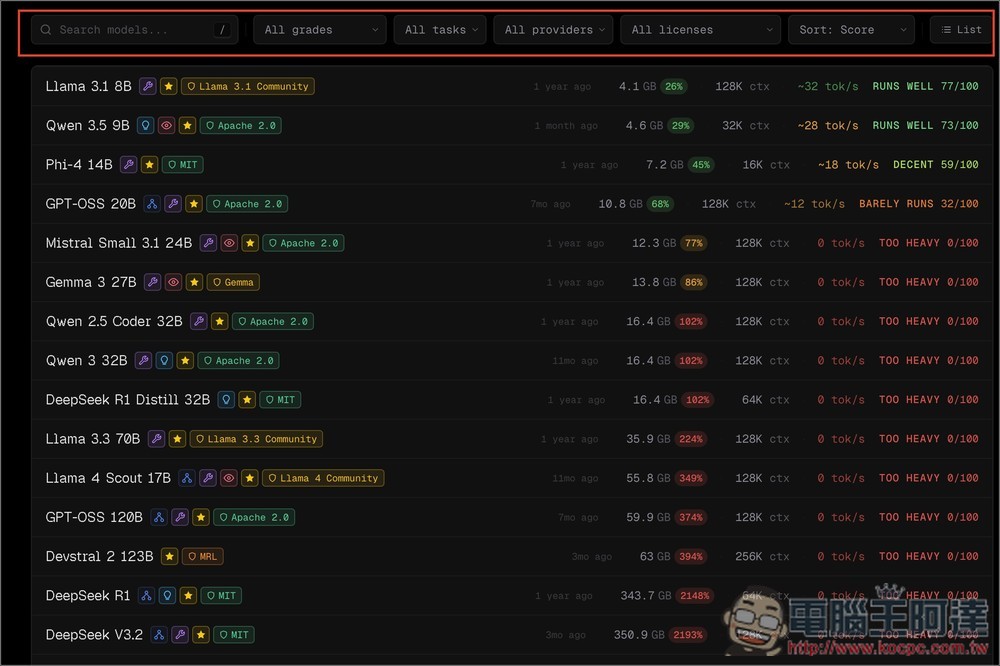

更棒的是,它不只是列出模型名稱,還會附上每個模型所需 VRAM、推論速度(token/s)、上下文長度等資訊,甚至還支援不同量化格式(如 Q4、Q5、Q8),讓進階玩家可以更精準評估效能與資源使用。

主要特色

- 自動偵測電腦 GPU、VRAM、記憶體頻寬等硬體資訊

- 支援手動調整硬體配置,模擬不同設備效能

- 直接列出可運行的 AI 模型(Llama、Qwen、Mistral 等)

- 提供清楚的運行等級(Runs great / Runs well / Too heavy)

- 顯示模型所需 VRAM、推論速度(token/s)、上下文長度

- 支援多種量化格式(Q2~Q8、F16)效能評估

- 可依任務分類篩選模型

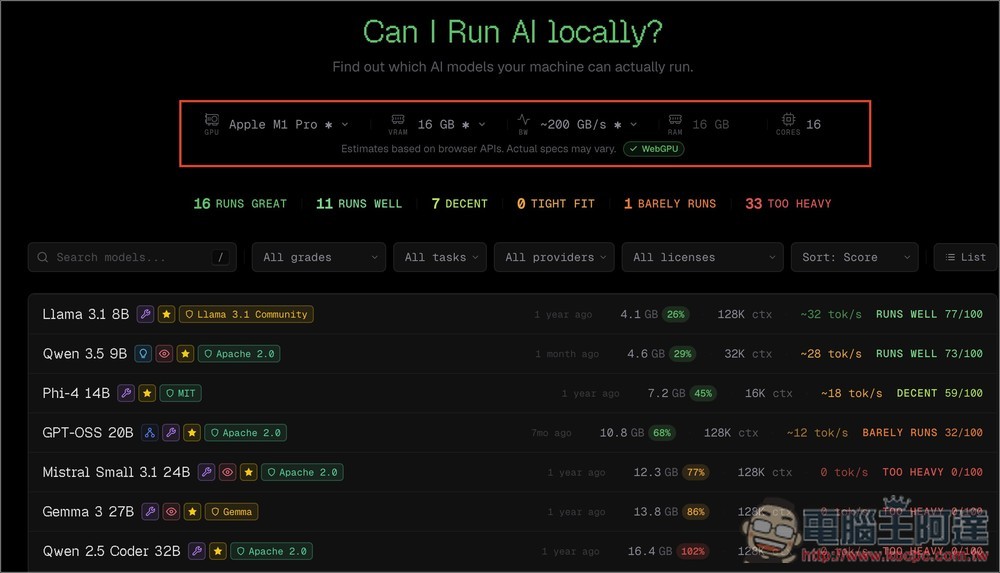

按上方連結進到 CanIRun.ai 後,最上方就會立刻顯示你目前裝置的硬體規格,包括 CPU、VRAM、頻寬等資訊,如果有錯誤,你也可以手動修改。下方也會立刻統計你可以順暢運行的 LLM 模型有多少個,像我的 Apple M1 Pro 16GB 有 16 個,11 個還可以:

如果數量太多或太雜不太好閱讀,可以使用上方的過濾器,像是輸入模型的關鍵字、運行等級、適合的任務、提供商等等:

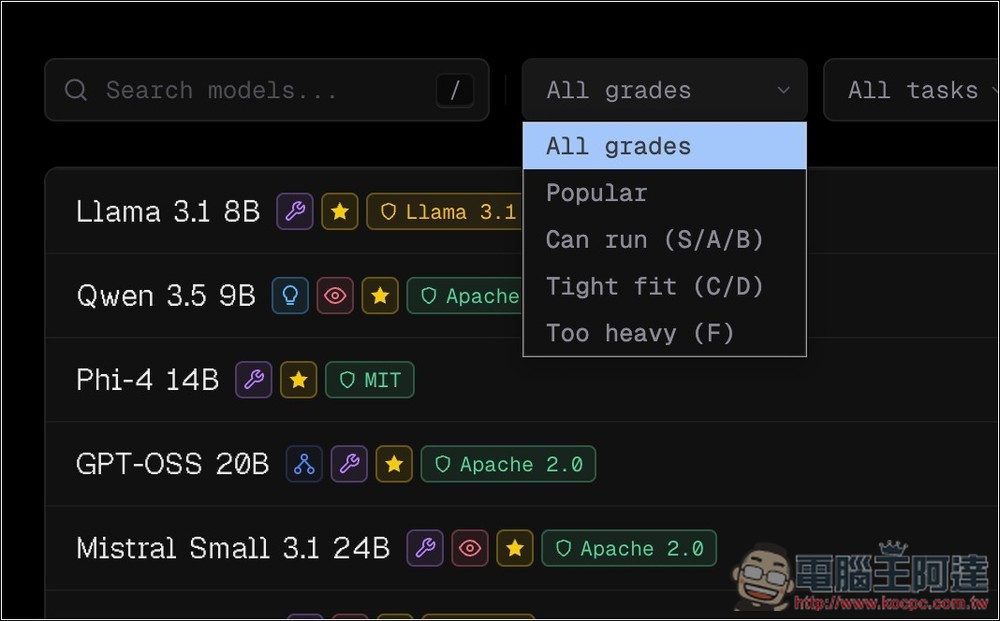

只想知道可以順暢運行哪些模型的話,就把 All grades 切換成 Can run:

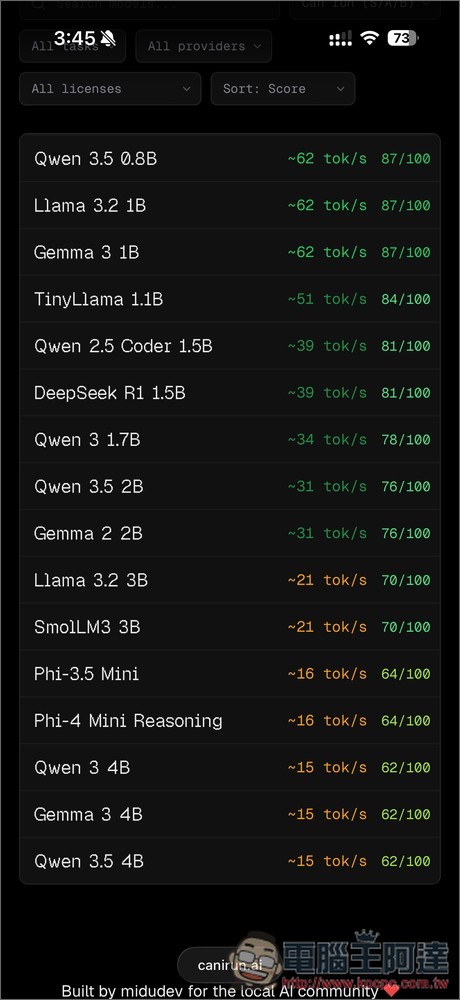

下方列出的清單,就是你可以順暢運行的,可以參考得分:

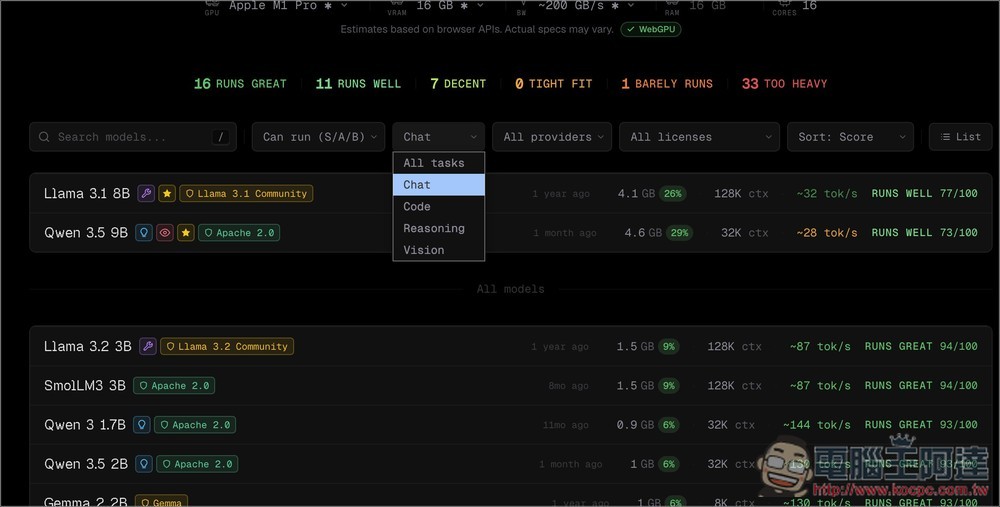

任務部分有聊天、程式、推理、視覺:

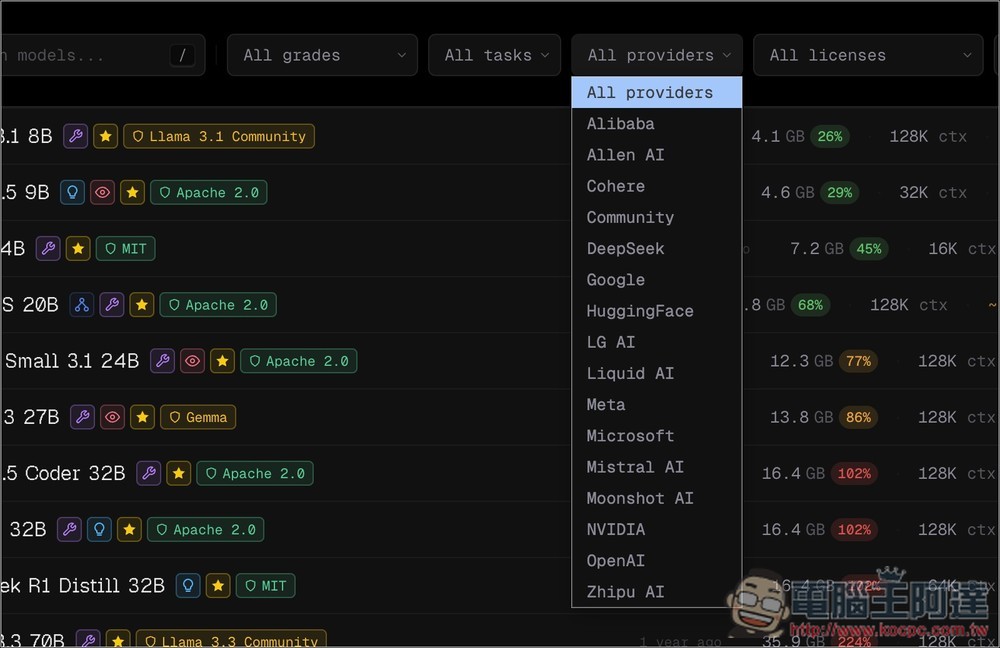

主要的模型提供商都有,如:Google、DeepSeek、OpenAI、NVIDIA、Alibaba 等:

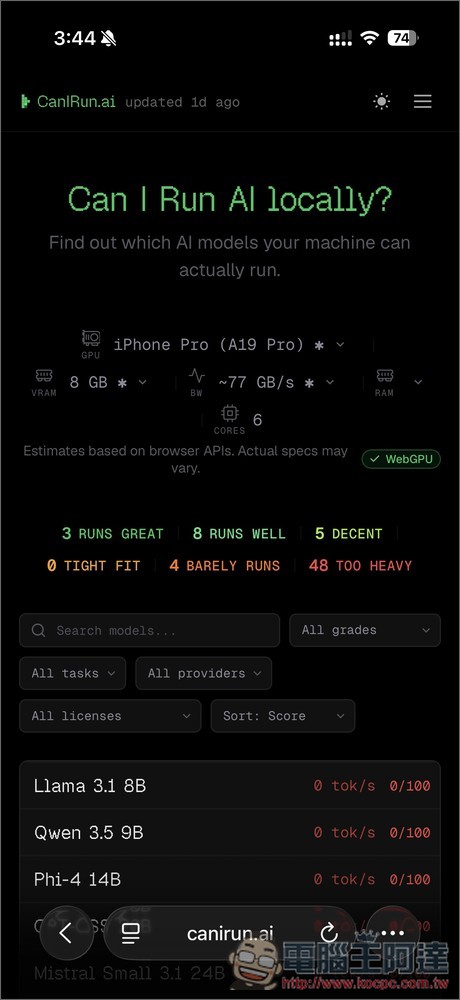

手機部分使用方式也一樣,我用我的 iPhone 打開 CanIRun.ai 後,最上方也精準辨識出我的硬體規格:

沒想到 iPhone 16 Pro 只有 6 個模型的運行速度在 80 分以上: